چین کی Zhipu AI کی جانب سے اس ہفتے منظرِ عام پر آنے والی GLM-5 کی ریلیز بڑے ماڈلز کی تیز رفتار جاری کاری میں ایک اور قدم کی نشان دہی کرتی ہے۔ نئے ماڈل کو Zhipu کا فلیگ شپ قرار دیا جا رہا ہے: حجم میں بڑا، طویل افق والے ایجنٹک کاموں کے لیے ٹیون کیا گیا، اور ایسی انجینئرنگ ترجیحات کے ساتھ تیار کیا گیا ہے جو انفیرینس لاگت کم کرتے ہوئے طویل کانٹیکسٹ محفوظ رکھیں۔ ابتدائی صنعتی رپورٹنگ اور ڈویلپرز کے عملی نوٹسز کے مطابق سابقہ GLM ورژنز کے مقابلے میں کوڈنگ، کثیر مرحلہ استدلال، اور ایجنٹ آرکسٹریشن میں معنی خیز بہتریاں ظاہر ہوتی ہیں — اور بعض ٹیسٹس میں یہ Claude 4.5 کو بھی چیلنج کرتا ہے۔

GLM-5 کیا ہے اور اسے کس نے بنایا؟

GLM-5، GLM خاندان میں تازہ ترین بڑا اجرا ہے: ایک بڑا، اوپن سورس فاؤنڈیشن ماڈل جو Z.ai (GLM سیریز کے پیچھے والی ٹیم) نے تیار اور شائع کیا ہے۔ فروری 2026 کے اوائل میں اعلان کیا گیا، GLM-5 کو اگلی نسل کا ماڈل پیش کیا گیا ہے جسے خاص طور پر "ایجنٹک" کاموں کے لیے ٹیون کیا گیا ہے — یعنی کثیر مرحلہ، طویل افق والے ورک فلو جہاں ماڈل کو منصوبہ بندی کرنی، ٹولز کال کرنے، عملدرآمد کرنا، اور طویل گفتگو یا خودکار ایجنٹس کے لیے کانٹیکسٹ برقرار رکھنا ہوتا ہے۔ یہ ریلیز نہ صرف ماڈل ڈیزائن کے لحاظ سے نمایاں ہے بلکہ تربیت کے طریقے اور مقام کے حوالے سے بھی: Z.ai نے خود کفالت کے مقصد کے تحت مقامی چینی ہارڈویئر اور ٹول چینز کے امتزاج کا استعمال کیا۔

رپورٹ کردہ آرکیٹیکچر اور تربیتی اعدادوشمار میں شامل ہیں:

- پیرامیٹر اسکیلنگ: GLM-5 تقریباً 744B پیرامیٹرز تک اسکیل کرتا ہے (کچھ تکنیکی نوٹس میں چھوٹے "active" ایکسپرٹ کاؤنٹ کا حوالہ ہے، مثلاً 40B active)، جبکہ پہلے GLM-4 خاندان کے سائز تقریباً 355B/32B active تھے۔

- پری ٹریننگ ڈیٹا: تربیتی کارپس کا حجم مبینہ طور پر ~23 ٹریلین ٹوکنز (GLM-4 جنریشن) سے بڑھ کر GLM-5 کے لیے ~28.5 ٹریلین ٹوکنز ہو گیا ہے۔

- اسپارز اٹینشن / DeepSeek Sparse Attention (DSA): ایک اسپارس اٹینشن اسکیم جو طویل کانٹیکسٹ محفوظ رکھتے ہوئے انفیرینس کے دوران کمپیوٹ لاگت کم کرے۔

- ڈیزائن پر زور: انجینئرنگ فیصلے جو ایجنٹ آرکسٹریشن، طویل کانٹیکسٹ میں استدلال، اور کم لاگت انفیرینس پر مرکوز ہیں۔

ماخذ اور پوزیشننگ

GLM-5، GLM-4.5 (وسط 2025 میں جاری) اور چند تدریجی اپڈیٹس جیسے 4.7 پر مبنی ہے۔ Z.ai، GLM-5 کو "vibe coding" (تیز، ایک قدمی کوڈ آؤٹ پٹس) سے “agentic engineering” کی طرف ایک جست کے طور پر پوزیشن کرتا ہے: طویل کانٹیکسٹ ونڈوز میں مسلسل استدلال، کثیر ٹول آرکسٹریشن، اور سسٹم سینتھیسز۔ عوامی مواد اس بات پر زور دیتا ہے کہ GLM-5 پیچیدہ سسٹمز انجینئرنگ کے کاموں کو سنبھالنے کے لیے ڈیزائن کیا گیا ہے — یعنی الگ تھلگ سوالات کے جوابات دینے کے بجائے کثیر مرحلہ ایجنٹ برتاؤ کو تعمیر، مربوط اور برقرار رکھنا۔

GLM-5 میں نئی خصوصیات کیا ہیں؟

نمایاں معماری تبدیلیاں

- وسیع اسپارس اسکیلنگ (MoE): GLM-5 ایک بڑے اسپارس Mixture-of-Experts آرکیٹیکچر کی طرف منتقل ہوتا ہے۔ ڈویلپر صفحات اور آزادانہ تحریروں کے عوامی اعدادوشمار ماڈل کو تقریباً 744B کل پیرامیٹرز اور فی ٹوکن ~40B active بتاتے ہیں — جو GLM-4.5 کی ~355B / 32B active ترتیب سے ایک نمایاں اضافہ ہے۔ یہ اسپارس اسکیلنگ ماڈل کو بہت بڑی کل صلاحیت پیش کرنے دیتی ہے جبکہ فی ٹوکن کمپیوٹ کو قابلِ برداشت رکھتی ہے۔

- DeepSeek Sparse Attention (DSA): طویل کانٹیکسٹ صلاحیت کو محفوظ رکھتے ہوئے انفیرینس لاگت کو لکیری طور پر بڑھنے سے روکنے کے لیے، GLM-5 ایک اسپارس اٹینشن میکانزم (برانڈڈ DeepSeek) کو ضم کرتا ہے جو بڑے طول و عرض میں اہم طویل فاصلے کی انحصاریوں کو برقرار رکھتا ہے جبکہ میگا لمبائی کانٹیکسٹس پر اٹینشن کی لاگت کم کرتا ہے۔

بنیادی ڈیزائن مقصد کے طور پر ایجنٹک انجینئرنگ

GLM-5 کی نمایاں خصوصیات میں سے ایک یہ ہے کہ یہ واضح طور پر ایجنٹک انجینئرنگ کے لیے ڈیزائن کیا گیا ہے — یعنی ماڈل کا مقصد صرف سنگل ٹرن چیٹ یا خلاصہ سازی کے بجائے ایسے کثیر مرحلہ ایجنٹس کا “دماغ” ہونا ہے جو منصوبہ بندی کر سکیں، ٹولز کال کریں، حالت (state) کو منظم کریں، اور طویل کانٹیکسٹس میں استدلال کر سکیں۔ Z.ai، GLM-5 کو آرکسٹریشن لوپس میں خدمت کے لیے پوزیشن کرتا ہے: پیچیدہ مسائل کو توڑنا، بیرونی ٹولز/APIs کو کال کرنا، اور کئی ٹرنز پر طویل کاموں کا سراغ رکھنا۔

ایجنٹک ڈیزائن کیوں اہم ہے

ایجنٹک ورک فلو حقیقی دنیا کی خودکاری کے مرکز میں ہیں: خودکار تحقیقی اسسٹنٹس، خودمختار سافٹ ویئر انجینئرز، آپریشنز آرکسٹریشن، اور سمولیشن کنٹرول۔ اس دنیا کے لیے بنایا گیا ماڈل مضبوط منصوبہ بندی، مستحکم ٹول کالنگ برتاؤ، اور ہزاروں ٹوکنز کے کانٹیکسٹ پر مضبوطی کا متقاضی ہوتا ہے۔

بہتر کوڈنگ، استدلال اور “طویل افق” والا برتاؤ

GLM-5 کوڈ جنریشن اور استدلال میں بہتری پر زور دیتا ہے۔ Z.ai کا دعویٰ ہے کہ ماڈل کی کوڈ لکھنے، ریفیکٹر کرنے، اور ڈی بگ کرنے کی صلاحیت میں ہدفی بہتریاں کی گئی ہیں، نیز طویل تعاملات میں کثیر مرحلہ استدلال زیادہ مستقل ہو گیا ہے۔ آزادانہ ابتدائی رسائی رپورٹیں اور پارٹنر ایویلیوایشنز نے پایا کہ ماڈل ڈویلپر مرکوز کاموں میں سابقہ GLM نسلوں سے نمایاں طور پر مضبوط ہے۔

عملی ڈویلپر فیچرز

- بڑے کانٹیکسٹ ونڈوز تاکہ دستاویزی مواد، کوڈ بیسز، اور گفتگو کی حالت رکھی جا سکے۔

- محفوظ ٹول انووکیشن اور نتائج ہینڈلنگ کے لیے ٹولنگ پرائمیٹو۔

- پیچیدہ کاموں کو ڈی کمپوز اور ایکزیکیوٹ کرنے کے لیے بہتر فیوشاٹ اور چین آف تھاٹ کارکردگی۔

- ایجنٹک فیچرز اور ٹول کالنگ: GLM-5 ایجنٹس کے لیے نیٹو سپورٹ پر زور دیتا ہے: فنکشن/ٹول کالنگ، اسٹیٹ فل سیشنز، اور طویل مکالمات و ٹول استعمال سلسلوں کا بہتر نظم۔ اس سے ایسے ایجنٹس بنانا آسان ہوتا ہے جو ویب سرچ، ڈیٹا بیسز، یا ٹاسک آٹومیشن کو یکجا کریں۔

بینچ مارکس پر GLM-5 کی کارکردگی کیسی ہے؟

مخصوص بینچ مارک نمایاں پہلو

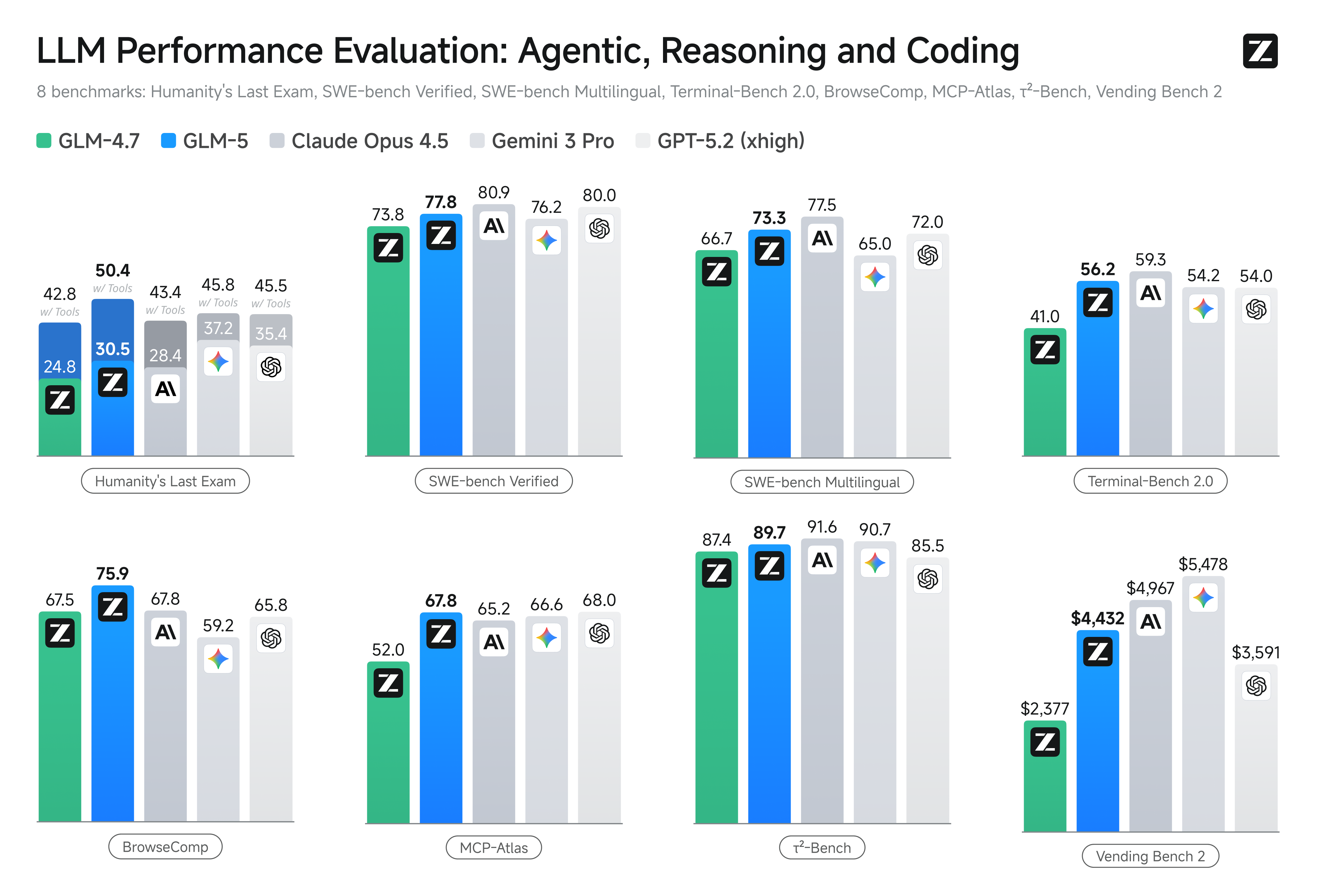

- کوڈنگ بینچ مارکس: GLM-5 مخصوص کوڈنگ کاموں پر انتہائی بہتر پروپرائٹری ماڈلز جیسے Anthropic’s Claude Opus 4.5 کے قریب پہنچتا ہے (اور بعض حالات میں مماثلت بھی دکھاتا ہے)۔ یہ نتائج کام پر منحصر ہیں (یونٹ ٹیسٹس، الگورتھمک کوڈنگ، API استعمال)، مگر یہ GLM-4.5 کے مقابلے میں واضح بہتری کی نشان دہی کرتے ہیں۔

- استدلال اور ایجنٹک ٹیسٹس: کثیر مرحلہ استدلال اور ایجنٹک ایویلیوایشن سوئیٹس (مثلاً ملٹی ٹرن پلاننگ، ٹاسک ڈی کمپوزیشن بینچ مارکس) پر، GLM-5 نے اوپن سورس ماڈلز کے لیے بہترین نتائج حاصل کیے اور کچھ میٹرکس میں مخصوص کاموں پر مسابقتی کلوزڈ ماڈلز سے بھی آگے نکل گیا۔

میں GLM-5 تک کیسے پہنچوں اور اسے کیسے آزماؤں؟

GLM-5، Zhipu AI (Z.ai) کا پانچویں نسل کا بڑا لینگوئج ماڈل ہے، جو Mixture-of-Experts آرکیٹیکچر (~745 B کل، ~44 B active) کے ساتھ بنایا گیا ہے اور مضبوط استدلال، کوڈنگ، اور ایجنٹک ورک فلو کو ہدف بناتا ہے۔ یہ تقریباً 12 فروری، 2026 کو باضابطہ طور پر لانچ ہوا۔

اس وقت لوگ اسے حاصل کرنے کے دو بنیادی طریقے استعمال کر رہے ہیں:

A) آفیشل API رسائی (Z.ai یا Aggregators)

Zhipu AI خود اپنے ماڈلز کے لیے APIs فراہم کرتا ہے، اور آپ ان APIs کے ذریعے GLM-5 کو کال کر سکتے ہیں۔

عام مراحل:

- Z.ai/Open BigModel API اکاؤنٹ کے لیے سائن اپ کریں۔

- ڈیش بورڈ سے API کی حاصل کریں۔

- OpenAPI طرز یا REST API اینڈ پوائنٹ کو ماڈل نام کے ساتھ استعمال کریں (مثلاً

glm-5)۔

(بالکل اسی طرح جیسے آپ OpenAI کے GPT ماڈلز کو کال کرتے ہیں)۔ - پرامپٹس سیٹ کریں اور HTTP درخواستیں بھیجیں۔

👉 Z.ai کے پرائسنگ پیج پر GLM-5 کے آفیشل ٹوکن نرخ درج ہیں:

- ~$1.0 فی ملین ان پٹ ٹوکنز

- ~$3.2 فی ملین آؤٹ پٹ ٹوکنز

B) تھرڈ پارٹی API ریپرز —— CometAPI

CometAPI یا WaveSpeed جیسے APIs متعدد AI ماڈلز (OpenAI، Claude، Z.ai وغیرہ) کو ایک متحدہ انٹرفیس کے پیچھے لپیٹتے ہیں۔

- CometAPI جیسی سروسز کے ساتھ آپ ماڈل ID بدل کر GLM ماڈلز کو کال کر سکتے ہیں۔

(CometAPI فی الحال GLM-5/GLM-4.7 کو سپورٹ کرتا ہے۔) - CometAPI کا glm-5 سرکاری قیمت کے 20% پر دستیاب ہے۔

| استعمال کی قسم | قیمت |

|---|---|

| ان پٹ ٹوکنز | ~$0.8 فی 1M ٹوکنز |

| آؤٹ پٹ ٹوکنز | ~$2.56 فی 1M ٹوکنز |

یہ کیوں اہم ہے: آپ اپنا موجودہ OpenAI-کمپیٹیبل کلائنٹ کوڈ برقرار رکھتے ہیں اور صرف بیس URL/ماڈل ID تبدیل کرتے ہیں۔

C) Hugging Face / Weights کے ذریعے خود ہوسٹنگ

Hugging Face ماڈل لسٹنگز میں GLM-5 ویٹ ریپوزیٹریز (مثلاً glm-5/glm-5-fp8 نامی ورژنز) غیر رسمی طور پر دکھائی دیتی ہیں۔

ان کے ساتھ آپ یہ کر سکتے ہیں:

- ماڈل ویٹس ڈاؤن لوڈ کریں۔

- vLLM، SGLang، xLLM، یا Transformers جیسے ٹولز سے لوکل یا اپنی کلاؤڈ GPU فلیٹ پر سرونگ کریں۔

فوائد: زیادہ سے زیادہ کنٹرول، کوئی جاری API لاگت نہیں۔

نقصانات: بہت بڑے کمپیوٹ تقاضے — غالباً متعدد ہائی اینڈ GPUs اور میموری (سینکڑوں GB)، جو چھوٹے سسٹمز پر عملیتاً مشکل ہے۔

تو — کیا GLM-5 قابلِ قدر ہے، اور کیا آپ کو GLM-4.7 برقرار رکھنی چاہیے؟

مختصر جواب (انتظامی خلاصہ)

- اگر آپ کے کام کو مضبوط، کثیر مرحلہ ایجنٹک برتاؤ، پروڈکشن گریڈ کوڈ جنریشن، یا سسٹم لیول خودکاری کی ضرورت ہے: GLM-5 کو فوراً جانچنا قابلِ قدر ہے۔ اس کی آرکیٹیکچر، اسکیل اور ٹیوننگ انہی نتائج کو ترجیح دیتی ہے۔

- اگر آپ کو کم لاگت، ہائی تھروپٹ مائیکروسروسز (مختصر چیٹ، کلاسیفکیشن، ہلکے پرامپٹس) درکار ہیں: بہت سے پرووائیڈرز کی فہرستوں میں GLM-4.7 غالباً سب سے کم خرچ انتخاب رہے گا۔ GLM-4.7 کم فی ٹوکن قیمت پر مضبوط صلاحیتیں برقرار رکھتا ہے اور پہلے سے آزمودہ ہے۔

طویل جواب (عملی سفارش)

ایک درجہ بند ماڈل حکمتِ عملی اپنائیں: روزمرہ، ہائی والیوم تعاملات کے لیے GLM-4.7 استعمال کریں اور GLM-5 کو ہائی ویلیو انجینئرنگ مسائل اور ایجنٹک آرکسٹریشن کے لیے مخصوص رکھیں۔ GLM-5 کو ایک چھوٹے پروڈکٹ حصے پر پائلٹ کریں جو طویل کانٹیکسٹ، ٹولنگ انٹیگریشن اور کوڈ درستگی کو آزمائے؛ انجینئرنگ وقت کی بچت اور ماڈل کی اضافی لاگت دونوں ناپیں۔ وقت کے ساتھ آپ جان لیں گے کہ GLM-5 کی صلاحیت میں اضافہ وسیع پیمانے پر ہجرت کو جائز ٹھہراتا ہے یا نہیں۔

CometAPI کے ساتھ، آپ کسی بھی وقت GLM-4.7 اور GLM-5 کے درمیان سوئچ کر سکتے ہیں۔

حقیقی دنیا کے استعمال جہاں GLM-5 ممتاز ثابت ہوتا ہے

1. پیچیدہ ایجنٹ آرکسٹریشن

GLM-5 کا کثیر مرحلہ پلاننگ اور ٹول کالنگ پر ڈیزائن فوکس اسے ان سسٹمز کے لیے موزوں بناتا ہے جنہیں سرچ، API کالز، اور پروگرام ایکزیکیوشن کو مربوط کرنا ہوتا ہے (مثال کے طور پر: خودکار تحقیقی اسسٹنٹس، تکراری کوڈ جنریٹرز، یا ملٹی اسٹیپ کسٹمر سروس ایجنٹس جنہیں ڈیٹا بیسز اور بیرونی APIs سے مشاورت کرنی ہوتی ہے)۔

2. طویل فارم انجینئرنگ اور کوڈ بیس پر استدلال

جب آپ کو ماڈل سے بہت سی فائلوں یا بڑے کوڈ بیس پر تجزیہ، ریفیکٹر یا سینتھیسز کرانا ہو، GLM-5 کے وسیع کانٹیکسٹ اور اسپارس اٹینشن براہِ راست فائدہ دیتے ہیں — کانٹیکسٹ کے کٹ جانے سے ہونے والی ناکامیوں کم اور طویل اسپین پر مستقل مزاجی بہتر۔

3. علم کا زیادہ تقاضا رکھنے والی سینتھیسز

وہ تجزیہ کار اور پروڈکٹ ٹیمیں جو پیچیدہ رپورٹس تیار کرتی ہیں — کثیر سیکشن تحقیقی بریفز، قانونی خلاصے، یا ریگولیٹری فائلنگز — وینڈر رپورٹڈ ٹیسٹس میں ماڈل کے مستحکم کثیر مرحلہ استدلال اور کم ہالیوسینیشنز سے فائدہ اٹھا سکتی ہیں۔

4. ورک فلو کے لیے ایجنٹک آٹومیشن

وہ ٹیمیں جو ایسی خودکاری بنا رہی ہیں جسے متعدد سسٹمز کو آرکسٹریٹ کرنا ہوتا ہے (مثلاً پلاننگ + ٹکٹنگ + ڈپلائمنٹ پائپ لائنز)، وہ GLM-5 کو مرکزی پلانر اور ایکزیکیوٹر کے طور پر استعمال کر سکتی ہیں، جسے ٹول کالنگ فریم ورکس اور حفاظتی ریپرز کا سہارا حاصل ہو۔

نتیجہ

GLM-5 تیزی سے ارتقا پذیر فرنٹیر ماڈل لینڈاسکیپ میں ایک اہم ریلیز ہے۔ اس کا ایجنٹک انجینئرنگ، بہتر کوڈنگ و استدلال، اور اوپن ویٹس دستیابی پر زور اسے ان ٹیموں کے لیے پُرکشش بناتا ہے جو طویل افق، ٹول-فعال AI سسٹمز بنا رہی ہیں۔ منتخب کاموں میں حقیقی بہتریاں اور حوصلہ افزا لاگت/کارکردگی توازن — مگر فیصلہ کن خریداری سے پہلے خریداروں کو اپنے مخصوص کاموں کے مقابل ماڈل کا جائزہ لینا اور کنٹرولڈ بینچ مارکس چلانا چاہیے۔

ڈویلپرز GLM-5 کو اب CometAPI کے ذریعے ایکسیس کر سکتے ہیں۔ آغاز کے لیے، ماڈل کی صلاحیتیں Playground میں ایکسپلور کریں اور تفصیلی ہدایات کے لیے API guide سے رجوع کریں۔ رسائی سے پہلے، براہ کرم یقینی بنائیں کہ آپ نے CometAPI میں لاگ ان کیا ہے اور API کی حاصل کر لی ہے۔ CometAPI کم لاگت پر آفیشل قیمت سے کہیں کم قیمت پیش کرتا ہے تاکہ آپ آسانی سے انٹیگریٹ کر سکیں۔

Ready to Go?→ آج ہی glm-5 کے لیے سائن اپ کریں !

اگر آپ AI پر مزید ٹپس، گائیڈز اور خبروں سے باخبر رہنا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!