Google DeepMind نے 2 اپریل 2026 کو باضابطہ طور پر Gemma 4 جاری کیا، جو اوپن سورس AI میں ایک بڑا سنگِ میل ہے۔ یہ ماڈلز کا خاندان فی پیرامیٹر فرنٹیئر سطح کی ذہانت فراہم کرتا ہے، اور وہی تحقیق اور ٹیکنالوجی استعمال کرتا ہے جو Gemini 3 کو تقویت دیتی ہے۔ سابقہ Gemma ورژنز کے کسٹم لائسنس کے برعکس، Gemma 4 ایک مکمل طور پر اجازت دینے والے Apache 2.0 لائسنس کے تحت فراہم کیا گیا ہے، جو غیر محدود کمرشل استعمال، ترمیم اور دوبارہ تقسیم کی اجازت دیتا ہے۔

Gemma 4 اپنی ملٹی موڈل صلاحیتوں کے سبب منفرد ہے (تمام سائز پر متن + تصویر ان پٹس، اور ایج ماڈلز پر آڈیو)، ایڈوانسڈ ریزننگ اور ایجنٹک ورک فلو کے لیے نیٹو سپورٹ، 256K ٹوکنز تک طویل کانٹیکسٹ ونڈوز، اور اسمارٹ فونز اور Raspberry Pi سے لے کر ہائی اینڈ GPUs تک ہر چیز کے لیے آپٹیمائزیشن۔ یہ 140 سے زائد زبانوں کو سپورٹ کرتا ہے اور افادیت پر زور دیتا ہے، جس سے طاقتور AI کو صارف اور ایج ہارڈویئر پر بغیر کلاؤڈ انحصار کے قابلِ رسائی بنایا جاتا ہے۔

CometAPI بہترین اوپن سورس اور کلوزڈ سورس ماڈل APIs فراہم کرتا ہے۔

Gemma 4 کیا ہے؟

Gemma 4 Google DeepMind کے تازہ ترین اوپن ملٹی موڈل بڑے لسانی ماڈلز (LLMs) کا خاندان ہے، جو ایڈوانسڈ ریزننگ، ایجنٹک AI ورک فلو، اور مؤثر آن-ڈیوائس ڈپلائمنٹ کے لیے مقصدی طور پر تیار کیا گیا ہے۔ یہ Gemini 3 کی ملکیتی تحقیق سے حاصل شدہ بصیرتوں سے فائدہ اٹھا کر “intelligence-per-parameter” کو زیادہ سے زیادہ کرتا ہے، جبکہ مکمل طور پر اوپن ویٹس اور اوپن سورس رہتا ہے۔

سابقہ Gemma ماڈلز کے مقابلے میں اہم پیش رفتیں:

- نیٹو ملٹی موڈیلیٹی: متن + تصویر کی سمجھ (تمام ماڈلز)، اور چھوٹے ایج ویریئنٹس پر آڈیو سپورٹ۔

- کنفیگریبل تھنکنگ موڈ: سٹیپ بائی سٹیپ ریزننگ جس میں ساختہ <|think|> آؤٹ پٹ ہوتا ہے۔

- نیٹو فنکشن کالنگ اور ٹول استعمال: خودکار ایجنٹس کے لیے موزوں۔

- وسیع کانٹیکسٹ: بڑے ماڈلز پر 256K ٹوکنز تک۔

- ہائبرڈ اٹینشن آرکیٹیکچر: افادیت اور طویل کانٹیکسٹ کارکردگی کے لیے لوکل سلائیڈنگ-ونڈو اور گلوبل اٹینشن کا امتزاج۔

- Per-Layer Embeddings (PLE) چھوٹے ماڈلز میں، اور میموری بچت کے لیے شیئرڈ KV کیش۔

- وسیع کثیر لسانی سپورٹ: 140+ زبانوں کے ڈیٹا پر پری ٹرینڈ، ثقافتی نزاکتوں سے آگاہی کے ساتھ۔

Apache 2.0 کے تحت جاری کیے جانے سے، Gemma 4 نے وہ سابقہ پابندیاں ختم کر دیں جو انٹرپرائز اپنانے کو محدود کرتی تھیں۔ ڈویلپرز اب بغیر رکاوٹ فائن ٹیون، ڈپلائے اور کمرشلائز کر سکتے ہیں—اسے Llama اور Qwen جیسے مکمل اوپن ایکوسسٹمز کا براہِ راست مدمقابل بناتے ہوئے۔

Gemma 4 متنوع ہارڈویئر کو ہدف بناتا ہے: ایج ڈیوائسز (فونز، IoT، Raspberry Pi، Jetson Nano) کم تاخیر والے آف لائن AI کے لیے، اور ورک سٹیشنز/GPUs ہائی پرفارمنس لوکل سرورز کے لیے۔ یہ “لوکل-فرسٹ” ڈیزائن پرائیویسی، لاگت میں بچت، اور زیرو لیٹنسی انفیرنس کو ترجیح دیتا ہے۔

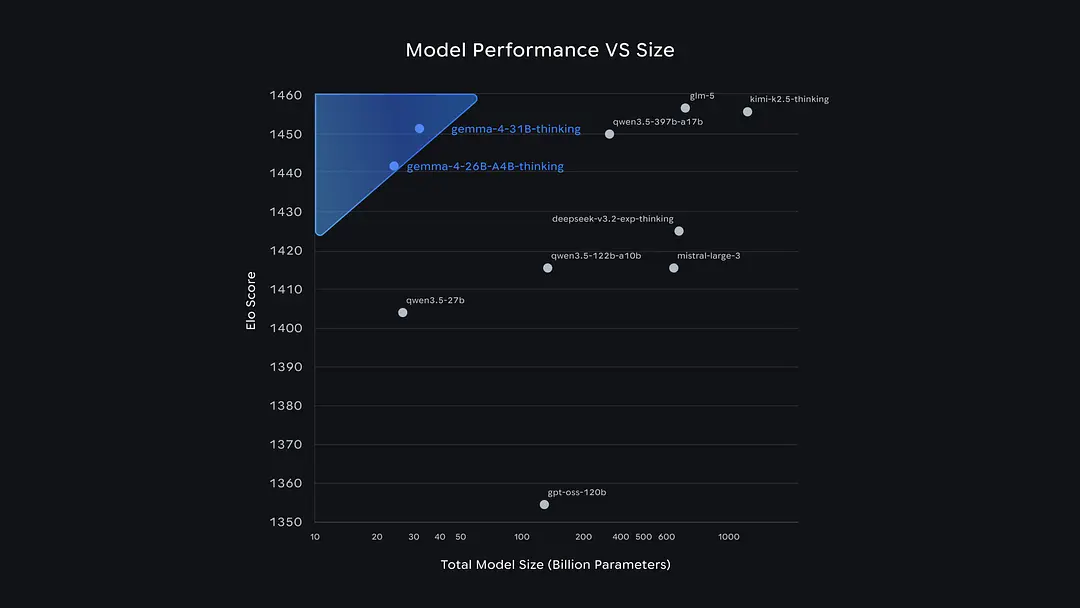

Arena لیڈر بورڈ پر اس سے آگے رینک کرنے والے اوپن سورس ماڈلز زیادہ تر چینی ٹیموں کے ہیں۔ Gemma 4، Qwen 3.5 اور GLM-5 سے زیادہ مختلف نہیں، لیکن یہ OpenAI کے GPT-OSS-120B سے نمایاں طور پر مختلف ہے۔

ڈویلپرز اب CometAPI پر GLM-5، Qwen 3.5 وغیرہ تلاش کر سکتے ہیں۔

Gemma 4 کے چار ورژنز

Google نے Gemma 4 کو چار محتاط انداز میں آپٹیمائزڈ سائزز میں جاری کیا، ہر ایک کارکردگی، افادیت، اور ڈپلائمنٹ منظرناموں کے مابین توازن فراہم کرتا ہے۔ دو ماڈلز نے ایج افادیت کے لیے جدید Per-Layer Embeddings (PLE) کے ساتھ ڈینس آرکیٹیکچر استعمال کیے؛ ایک Mixture-of-Experts (MoE) ہے جو فعال پیرامیٹر لاگت کم رکھتے ہوئے ہائی پرفارمنس دیتا ہے؛ اور ایک ڈینس فلیگ شپ ہے۔

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Text, Image, Audio | Smartphones, Raspberry Pi, edge IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Text, Image, Audio | Mobile devices, lightweight GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Image | Workstations, consumer GPUs, local servers |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Image | High-end GPUs (fits on single H100/A100 in FP16) |

Gemma 4 E2B اور E4B (ایج-آپٹیمائزڈ): PLE کا استعمال کرتے ہیں تاکہ کم سے کم پیرامیٹر اوور ہیڈ کے ساتھ ہر لیئر میں تخصیص کا اضافہ کیا جا سکے۔ بیٹری سے چلنے والی یا میموری محدود ڈیوائسز کے لیے موزوں۔ آڈیو انکوڈر (USM-style Conformer، ~300M params) اسپیچ-ٹو-ٹیکسٹ اور ترجمے کو ممکن بناتا ہے۔

Gemma 4 26B A4B (MoE): اگرچہ کل سائز 25B+ ہے، مگر انفیرنس کے دوران صرف ~4B پیرامیٹرز ایکٹیویٹ ہوتے ہیں۔ بہت کم کمپیوٹ لاگت کے ساتھ تقریباً 31B درجے کی کارکردگی دیتا ہے—کم لاگت پر توسیع کے لیے بہترین۔

Gemma 4 31B (Dense): زیادہ سے زیادہ صلاحیت کے لیے فلیگ شپ۔ فل پریسیژن میں ایک سنگل 80GB GPU پر فٹ ہو جاتا ہے اور لیڈر بورڈز پر اعلیٰ اوپن ماڈلز میں شمار ہوتا ہے۔

تمام ماڈلز میں انسٹرکشن-ٹیونڈ (“-it”) ویریئنٹس شامل ہیں جو چیٹ، ریزننگ اور ٹول استعمال کے لیے آپٹیمائزڈ ہیں، نیز پری ٹرینڈ بیس ورژنز فائن ٹیوننگ کے لیے موجود ہیں۔ دونوں بڑے ماڈلز مختلف طریقے اپناتے ہیں: 31B ڈینس ماڈل حتمی معیار کے تعاقب میں ہے اور فائن ٹیوننگ کے لیے بہترین بنیاد فراہم کرتا ہے؛ 26B MoE ماڈل رفتار کو ترجیح دیتا ہے، انفیرنس کے دوران صرف 3.8 بلین پیرامیٹرز ایکٹیویٹ کرتا ہے، جس کے نتیجے میں الفاظ کی جنریشن بہت تیز ہوتی ہے، مگر مجموعی معیار تھوڑا کم ہوتا ہے۔

دو چھوٹے ماڈلز، E2B اور E4B، خاص طور پر موبائل فونز اور IoT ڈیوائسز کے لیے ڈیزائن کیے گئے ہیں: یہ مکمل طور پر آف لائن چل سکتے ہیں، میموری اور پاور بچاتے ہیں۔ مزید یہ کہ ان چھوٹے ماڈلز میں ایک ایسی صلاحیت موجود ہے جو بڑے ماڈلز میں نہیں: نیٹو آڈیو ان پٹ، جو براہ راست اسپیچ ریکگنیشن کو ممکن بناتا ہے۔

Gemma 4 کی بنیادی صلاحیتیں

Gemma 4 ان شعبوں میں عمدہ ہے جو حقیقی دنیا کی AI ایپلی کیشنز کے لیے سب سے زیادہ اہم ہیں:

1. ایڈوانسڈ ریزننگ اور تھنکنگ موڈ

سسٹم پرامپٹس یا enable_thinking=True کے ذریعے ترتیب پذیر سٹیپ بائی سٹیپ ریزننگ۔ آؤٹ پٹس میں ساختہ <|think|> ٹیگز ہوتے ہیں، جن کے بعد حتمی جوابات آتے ہیں۔ بغیر اضافی فائن ٹیوننگ کے پیچیدہ کاموں پر کارکردگی میں نمایاں بہتری۔

2. ملٹی موڈل سمجھ بوجھ

- ویژن: آبجیکٹ ڈٹیکشن (JSON باؤنڈنگ باکسز)، OCR (کثیر لسانی)، دستاویز/PDF پارسنگ، چارٹ کی تفہیم، UI کی سمجھ، ہینڈ رائٹنگ ریکگنیشن، اور ویری ایبل ریزولوشن تصویر ہینڈلنگ (ٹوکن بجٹس: 70–1120 ٹوکنز)۔

- ویڈیو: 60 سیکنڈ تک (1 fps فریم پروسیسنگ)۔

- آڈیو (صرف E2B/E4B): آٹومیٹک اسپیچ ریکگنیشن (ASR) اور اسپیچ-ٹو-ٹیکسٹ ترجمہ (زیادہ سے زیادہ 30s)۔

- انٹرلیوڈ ان پٹس: متن، تصاویر، اور آڈیو کو کسی بھی ترتیب میں ملائیں۔

3. ایجنٹک ورک فلو اور فنکشن کالنگ

نیٹو ٹول-یوز سپورٹ خودمختار ایجنٹس کو ممکن بناتی ہے جو ملٹی سٹیپ پلاننگ، API کالز، ایپ نیویگیشن، اور ٹاسک مکمل کرنے کے قابل ہوں۔ τ2-bench (agentic tool use) پر مضبوط کارکردگی۔

4. کوڈنگ اور ڈویلپر ٹولز

کوڈ جنریشن، تکمیل، ڈی بگنگ، اور ریپوزٹری-سطح کی سمجھ میں شاندار۔ بآسانی انضمام کے لیے JSON-ساختہ آؤٹ پٹس کو سپورٹ کرتا ہے۔ یہ LiveCodeBench v6 پر 80.0% (31B) سکور کرتا ہے، جس سے یہ آف لائن ڈویلپمنٹ منظرناموں کے لیے موزوں لوکل-فرسٹ AI پروگرامنگ اسسٹنٹ بنتا ہے۔

5. طویل کانٹیکسٹ اور کثیر لسانی

128K–256K ٹوکنز کو قابلِ اعتماد طریقے سے ہینڈل کرتا ہے (MRCR needle-in-haystack پر ٹیسٹ شدہ)۔ جنوری 2025 کے کٹ آف تک متنوع ڈیٹا پر پری ٹرینڈ، مضبوط کراس-لِنگول کارکردگی کے ساتھ۔ یہ محض کثیر لسانی ترجمہ نہیں؛ یہ نیٹو طور پر ٹرینڈ ہے اور 140 سے زائد زبانوں کا احاطہ کرتا ہے۔

بینچ مارک ڈیٹا: Gemma 4 کی کارکردگی کی تفصیل

Gemma 4 اوپن ماڈلز کے لیے نئے معیارات قائم کرتا ہے۔ 31B اور 26B ویریئنٹس وہ سکور دیتے ہیں جو پہلے بہت بڑے ملکیتی سسٹمز کے لیے مخصوص تھے، جبکہ ایج ماڈلز Gemma 3 کے بڑے پیش رو سے بہتر کارکردگی دکھاتے ہیں۔

فل بینچ مارک نتائج (انسٹرکشن-ٹیونڈ ماڈلز)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | Reasoning & Knowledge | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | Math | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | Graduate-level Science | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | Agentic Tool Use | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | Coding | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | Competitive Coding | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | Multimodal Reasoning | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | Math + Vision | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | Long Context | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

اہم نکات:

- Gemma 3 سے بڑا جست: 31B ماڈل نے AIME میتھ کو 20.8% سے 89.2% تک اور LiveCodeBench کو 29.1% سے 80.0% تک بہتر کیا۔

- MoE کی افادیت: 26B A4B، بہت کم انفیرنس کمپیوٹ کے باوجود، 31B کے قریب کارکردگی دیتا ہے۔

- ایج کی برتری: E4B اور E2B، 6–10 گنا چھوٹے ہونے کے باوجود، کئی میٹرکس پر Gemma 3 27B سے آگے ہیں۔

- لیڈر بورڈ رینکنگز: 31B نے Arena AI (متن) پر تقریباً 1452 اسکور کیا؛ 26B A4B نے تقریباً 1441۔ رپورٹ کے مطابق 26B ویریئنٹ صارف ترجیح اور کوڈنگ میں Qwen 3.5 397B جیسے بہت بڑے ماڈلز سے بہتر ہے۔

ویژن اور آڈیو بینچ مارکس خصوصی فائن ٹیوننگ کے بغیر ہی مضبوط آؤٹ-آف-دی-باکس ملٹی موڈل کارکردگی کی تصدیق کرتے ہیں۔

ایکوسسٹم اور ٹول سپورٹ

Gemma 4 کو فوری اور وسیع ایکوسسٹم انضمام حاصل ہے:

- Hugging Face: پہلے ہی دن

transformers،pipeline("any-to-any")، GGUF، ONNX، اور ملٹی موڈل پروسیسرز کے ساتھ سپورٹ۔ - لوکل رن ٹائمز: Ollama، Llama.cpp (LM Studio, Jan)، MLX (Apple Silicon with TurboQuant)، Mistral.rs (Rust)، Transformers.js (WebGPU browser inference)۔

- فائن ٹیوننگ: TRL، Unsloth، PEFT، Vertex AI، اور مکمل ملٹی موڈل ڈیٹاسیٹ سپورٹ۔

- ہارڈویئر آپٹیمائزیشن: NVIDIA RTX/DGX Spark/Jetson (via TensorRT-LLM)، Google AI Edge ٹولز، اور Android/iOS آن-ڈیوائس ڈپلائمنٹ۔

- ایجنٹ فریم ورکس: OpenClaw، Hermes، Pi، اور CARLA سیمولیشن ٹیسٹنگ۔

- کلاؤڈ/اسٹوڈیو: Google AI Studio فوری ٹیسٹنگ کے لیے؛ Kaggle Models ڈاؤن لوڈ کے لیے۔

یہ ایکوسسٹم Gemma 4 کو منٹوں میں لیپ ٹاپس، سرورز یا ایج ڈیوائسز پر ڈپلائے کرنے کے قابل بناتا ہے۔

حدود اور حفاظتی امور:

- ٹریننگ ڈیٹا کٹ آف: جنوری 2025 (بغیر ٹولز کے حقیقی وقت کی معلومات نہیں)۔

- آڈیو صرف اسپیچ تک محدود (میوزک نہیں)؛ ویڈیو 60s تک محدود۔

- ہیلوسینیشن کا خطرہ برقرار—تھنکنگ موڈ اور توثیق استعمال کریں۔

- سیفٹی: Google AI Principles کے مطابق سخت فلٹرنگ اور ایویلیوایشن؛ ڈویلپرز کو ایپلیکیشن-اسپیسفک گارڈز شامل کرنے چاہئیں۔

2026 میں Gemma 4 کیوں اہم ہے

Gemma 4 فرنٹیئر AI کو عام دسترس میں لاتا ہے۔ ملٹی موڈل ذہانت، ایجنٹک صلاحیتیں، Apache 2.0 کی آزادی، اور ہارڈویئر سے غیر منحصر افادیت کو یکجا کر کے، یہ ڈویلپرز اور انٹرپرائزز کو بڑے پیمانے پر محفوظ، نجی، اور کم لاگت AI حل بنانے کے قابل بناتا ہے۔ فی پیرامیٹر ذہانت میں پیش رفت—خصوصاً ایج ماڈلز کے ذریعے جو گزشتہ روز کے فلیگ شپ اوپن ماڈلز کو پیچھے چھوڑ رہے ہیں—ایک حقیقی ہر جگہ موجود AI کی سمت تبدیلی کی نشاندہی کرتی ہے۔

چاہے فون پر 2B ماڈل چلانا ہو یا مقامی طور پر 31B پاور ہاؤس، Gemma 4 ثابت کرتا ہے کہ عملی افادیت میں اوپن سورس AI نے کلوزڈ متبادلات کے برابر (اور کئی صورتوں میں آگے) قدم رکھ دیا ہے۔