2025–2026년에 AI 툴링 환경은 계속해서 통합되는 흐름을 보였다. 게이트웨이 API(예: CometAPI)는 수백 개 모델에 대한 OpenAI 스타일 접근을 제공하도록 확장되었고, 최종 사용자용 LLM 앱(예: AnythingLLM)은 데스크톱 및 로컬 우선 앱이 모든 OpenAI 호환 엔드포인트를 호출할 수 있도록 “Generic OpenAI” 제공자를 지속적으로 개선했다. 그 결과, 오늘날에는 AnythingLLM 트래픽을 CometAPI를 통해 라우팅하여 모델 선택, 비용 라우팅, 통합 결제의 혜택을 얻는 동시에 AnythingLLM의 로컬 UI 및 RAG/에이전트 기능을 그대로 사용하는 것이 수월해졌다.

AnythingLLM이란 무엇이며, 왜 CometAPI에 연결해야 하나요?

AnythingLLM이란?

AnythingLLM은 오픈 소스의 올인원 AI 애플리케이션이자 로컬/클라우드 클라이언트로, 대화형 어시스턴트, 검색 증강 생성(RAG) 워크플로, LLM 기반 에이전트를 구축하기 위한 도구를 제공한다. 세련된 UI, 개발자 API, 워크스페이스/에이전트 기능, 로컬 및 클라우드 LLM 지원을 제공하며, 기본적으로 프라이버시 지향적이고 플러그인으로 확장 가능하도록 설계되어 있다. AnythingLLM은 OpenAI 호환 LLM API와 통신할 수 있게 해주는 Generic OpenAI 제공자를 노출한다.

CometAPI란?

CometAPI는 500+ AI 모델을 하나의 OpenAI 스타일 REST 인터페이스와 통합 결제로 제공하는 상업용 API 집계 플랫폼이다. 실제로는 여러 벤더(OpenAI, Anthropic, Google/Gemini 계열, 이미지/오디오 모델 등)의 모델을 동일한 https://api.cometapi.com/v1 엔드포인트와 단일 API 키(형식 sk-xxxxx)로 호출할 수 있게 해준다. CometAPI는 /v1/chat/completions, /v1/embeddings 등 표준 OpenAI 스타일 엔드포인트를 지원하므로, 이미 OpenAI 호환 API를 지원하는 도구를 손쉽게 적응시킬 수 있다.

AnythingLLM을 CometAPI와 통합해야 하는 이유는?

세 가지 실용적 이유:

- 모델 선택 및 벤더 유연성: AnythingLLM은 Generic OpenAI 래퍼를 통해 “모든 OpenAI 호환” LLM을 사용할 수 있다. 이 래퍼를 CometAPI에 지정하면 AnythingLLM의 UI나 흐름을 바꾸지 않고도 수백 개 모델에 즉시 접근할 수 있다.

- 비용/운영 최적화: CometAPI를 사용하면 중앙에서 모델을 전환(또는 더 저렴한 모델로 다운시프트)하여 비용을 제어하고, 여러 공급자 키를 관리하는 대신 결제를 통합할 수 있다.

- 더 빠른 실험: 동일한 AnythingLLM UI에서

gpt-4o,gpt-4.5, Claude 계열, 오픈소스 멀티모달 모델 등을 A/B 테스트할 수 있어, 에이전트, RAG 응답, 요약, 멀티모달 작업에 유용하다.

통합 전에 준비해야 하는 환경과 조건

시스템 및 소프트웨어 요구 사항(상위 수준)

- AnythingLLM이 실행되는 데스크톱 또는 서버(Windows, macOS, Linux) — 데스크톱 설치 또는 셀프 호스팅 인스턴스. LLM Preferences / AI Providers 설정이 노출되는 최신 빌드인지 확인.

- CometAPI 계정과 API 키(

sk-xxxxx스타일의 시크릿). 이 시크릿을 AnythingLLM의 Generic OpenAI 제공자에 사용한다. - 머신에서

https://api.cometapi.com으로의 네트워크 연결(아웃바운드 HTTPS가 방화벽에 의해 차단되지 않아야 함). - 선택 사항이지만 권장: 테스트용 최신 Python 또는 Node 환경(Python 3.10+ 또는 Node 18+), curl, HTTP 클라이언트(Postman / HTTPie)로 AnythingLLM에 연결하기 전에 CometAPI를 간단히 점검.

AnythingLLM 관련 조건

OpenAI API 표면을 모방하는 엔드포인트에는 Generic OpenAI LLM 제공자가 권장된다. AnythingLLM 문서에 따르면 이 제공자는 개발자 중심이므로 입력에 대한 이해가 필요하다. 스트리밍을 사용할 경우 또는 사용하려는 엔드포인트가 스트리밍을 지원하지 않을 경우, AnythingLLM에는 Generic OpenAI용 스트리밍 비활성화 설정이 포함되어 있다.

보안 및 운영 체크리스트

- CometAPI 키는 다른 시크릿과 동일하게 취급 — 저장소에 커밋하지 말고 가능하면 OS 키체인이나 환경 변수에 저장.

- 민감한 문서를 RAG에 사용할 계획이라면, 엔드포인트의 프라이버시 보장이 컴플라이언스 요구에 부합하는지 확인(CometAPI의 문서/정책 참조).

- 과도한 비용 발생을 막기 위해 최대 토큰과 컨텍스트 윈도우 한도를 미리 결정.

AnythingLLM을 CometAPI로 사용하도록 설정하려면? (단계별 안내)

아래는 구체적인 단계 순서이며 — AnythingLLM UI에서 설정을 저장하기 전에 연결을 테스트하기 위한 환경 변수 및 코드 스니펫 예시가 이어진다.

Step 1 — CometAPI 키 받기

- CometAPI에 가입하거나 로그인한다.

- “API Keys”로 이동하여 키를 생성한다 —

sk-xxxxx형태의 문자열이 발급된다. 비밀로 보관.

Step 2 — 간단한 요청으로 CometAPI 동작 확인

curl 또는 Python을 사용해 간단한 chat completion 엔드포인트를 호출하여 연결을 확인한다.

Curl example

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

200과 choices 배열이 포함된 JSON 응답이 반환되면, 키와 네트워크가 정상이라는 의미다. (CometAPI 문서에는 OpenAI 스타일의 표면과 엔드포인트가 명시되어 있다.)

Python example (requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

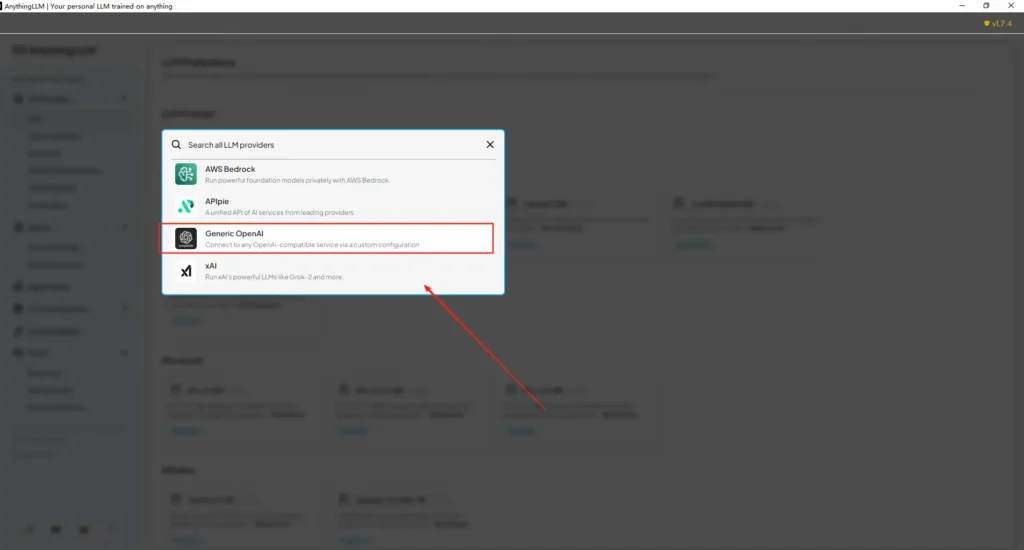

Step 3 — AnythingLLM 설정(UI)

AnythingLLM → Settings → AI Providers → LLM Preferences(버전에 따라 경로가 다를 수 있음)로 이동한다. Generic OpenAI 제공자를 사용하고 다음과 같이 입력한다:

API Configuration (example)

• AnythingLLM 설정 메뉴로 들어가 AI Providers 아래의 LLM Preferences를 찾는다.

• 모델 제공자로 Generic OpenAI를 선택하고, URL 필드에https://api.cometapi.com/v1를 입력한다.

• CometAPI에서 발급받은sk-xxxxx를 API key 입력란에 붙여 넣는다. Token context window와 Max Tokens는 실제 모델에 맞게 설정한다. 이 페이지에서 모델 이름을 커스터마이즈할 수도 있으며, 예를 들어gpt-4o모델을 추가할 수 있다.

이는 AnythingLLM의 “Generic OpenAI” 가이드(개발자용 래퍼)와 CometAPI의 OpenAI 호환 베이스 URL 접근 방식에 부합한다.

Step 4 — 모델 이름 및 토큰 한도 설정

동일한 설정 화면에서 CometAPI가 게시한 모델 이름과 정확히 일치하도록 모델 이름을 추가하거나 커스터마이즈한다(예: gpt-4o, minimax-m2, kimi-k2-thinking). 이렇게 하면 AnythingLLM UI가 해당 모델을 사용자에게 표시할 수 있다. CometAPI는 공급자별 모델 문자열을 제공한다.

Step 5 — AnythingLLM에서 테스트

새 채팅을 시작하거나 기존 워크스페이스를 사용하고, 여러 제공자를 설정했다면 Generic OpenAI 제공자를 선택한 뒤, 추가한 CometAPI 모델 이름 중 하나를 선택하여 간단한 프롬프트를 실행한다. 일관된 응답이 나타나면 통합이 완료된 것이다.

AnythingLLM이 내부적으로 해당 설정을 사용하는 방식

AnythingLLM의 Generic OpenAI 래퍼는 OpenAI 스타일 요청(/v1/chat/completions, /v1/embeddings)을 구성한다. 따라서 베이스 URL을 지정하고 CometAPI 키를 제공하면, 채팅, 에이전트 호출, 임베딩 요청이 투명하게 CometAPI를 통해 라우팅된다. AnythingLLM 에이전트(@agent 흐름)를 사용할 경우 동일한 제공자를 상속받는다.

모범 사례와 주의할 함정은 무엇인가?

모범 사례

- 모델에 맞는 컨텍스트 설정 사용: AnythingLLM의 Token Context Window와 Max Tokens를 CometAPI에서 선택한 모델과 일치시키라. 불일치하면 예기치 않은 잘림이나 호출 실패가 발생할 수 있다.

- API 키 보안 강화: CometAPI 키는 환경 변수나 Kubernetes/시크릿 매니저에 저장하고, git에 절대 커밋하지 말 것. UI에 키를 입력하면 AnythingLLM이 로컬 설정에 저장하므로 호스트 저장소를 민감 정보로 취급해야 한다.

- 실험 단계에서는 저렴/소형 모델부터: 개발에는 더 저렴한 모델을 시험하고, 프로덕션에는 프리미엄 모델을 사용하라. CometAPI는 비용 전환과 통합 결제를 명확히 제공한다.

- 사용량 모니터링 및 알림 설정: CometAPI의 사용량 대시보드를 활용해 예산/알림을 설정하여 예상치 못한 비용을 방지한다.

- 에이전트와 도구는 격리 테스트: AnythingLLM 에이전트는 동작을 촉발할 수 있으므로, 안전한 프롬프트와 스테이징 인스턴스에서 먼저 테스트하라.

흔한 함정

- UI와

.env충돌: 셀프 호스팅 시 UI 설정이.env변경 사항을 덮어쓰는 경우(또는 그 반대)가 있다. 재시작 후 설정이 되돌아가면 생성된/app/server/.env를 확인하라. 커뮤니티 이슈에서LLM_PROVIDER초기화가 보고되었다. - 모델 이름 불일치: CometAPI에서 제공하지 않는 모델 이름을 사용하면 게이트웨이에서 400/404가 발생한다. CometAPI의 모델 목록에서 사용 가능한 모델을 항상 확인하라.

- 토큰 한도와 스트리밍: 스트리밍 응답이 필요하다면, 해당 CometAPI 모델이 스트리밍을 지원하는지(그리고 사용하는 AnythingLLM UI 버전이 이를 지원하는지) 확인하라. 일부 제공자는 스트리밍 동작이 다르다.

이 통합이 열어주는 실제 활용 사례

검색 증강 생성(RAG)

AnythingLLM의 문서 로더 + 벡터 DB를 CometAPI LLM과 결합해 컨텍스트 기반 답변을 생성한다. 저렴한 임베딩 + 고급 채팅 모델의 조합을 실험하거나, 모든 것을 CometAPI로 일원화하여 결제를 통합할 수 있다. AnythingLLM의 RAG 흐름은 핵심 내장 기능이다.

에이전트 자동화

AnythingLLM은 @agent 워크플로(페이지 탐색, 도구 호출, 자동화 실행)를 지원한다. 에이전트의 LLM 호출을 CometAPI로 라우팅하면, 에이전트 코드를 수정하지 않고도 제어/해석 단계의 모델을 선택할 수 있다.

멀티모델 A/B 테스트 및 비용 최적화

워크스페이스나 기능별로 모델을 전환(예: 프로덕션 응답에는 gpt-4o, 개발에는 gpt-4o-mini)할 수 있다. CometAPI를 통해 모델 교체가 간단해지고 비용이 중앙에서 관리된다.

멀티모달 파이프라인

CometAPI는 이미지, 오디오 및 특화 모델을 제공한다. AnythingLLM의 공급자 기반 멀티모달 지원과 CometAPI 모델을 결합하면 동일한 인터페이스를 통해 이미지 캡셔닝, 멀티모달 요약, 오디오 전사 흐름을 구현할 수 있다.

결론

CometAPI는 다중 모델 게이트웨이(500+ 모델, OpenAI 스타일 API)로서의 입지를 강화하고 있으며, 이는 이미 Generic OpenAI 제공자를 지원하는 AnythingLLM과 자연스러운 파트너십을 이룬다. 마찬가지로 AnythingLLM의 Generic 제공자와 최신 구성 옵션 덕분에 이러한 게이트웨이에 연결하는 과정이 간단해졌다. 이러한 수렴은 2025년 후반의 실험 및 프로덕션 마이그레이션을 단순화한다.

How to get started with Comet API

CometAPI는 OpenAI의 GPT 시리즈, Google의 Gemini, Anthropic의 Claude, Midjourney, Suno 등 주요 제공업체의 500개가 넘는 AI 모델을 하나의 개발자 친화적 인터페이스로 집계한 통합 API 플랫폼이다. 일관된 인증, 요청 포맷, 응답 처리 방식을 제공함으로써, CometAPI는 애플리케이션에 AI 기능을 통합하는 과정을 크게 단순화한다. 챗봇, 이미지 생성기, 음악 생성기, 데이터 기반 분석 파이프라인을 구축하든, CometAPI는 최신 AI 생태계의 돌파구를 폭넓게 활용하면서 벤더 종속을 피하고, 더 빠르게 반복하고, 비용을 통제할 수 있도록 돕는다.

시작하려면 CometAPI의 모델 기능을 Playground에서 살펴보고, 자세한 안내를 위해 API guide를 참고하라. 접근 전에 CometAPI에 로그인하여 API 키를 발급받았는지 확인하라. CometAPI는 통합을 돕기 위해 공식 가격보다 훨씬 낮은 가격을 제공한다.

Ready to Go?→ Sign up for CometAPI today !