5 فروری، 2026 کو Anthropic نے Claude Opus 4.6 کو متعارف کرایا، جو Claude فیملی کا نیا فلیگ شپ ہے۔ Opus 4.6 طویل المعیاد نالج ورک اور ایجنٹک سافٹ ویئر ورک فلو پر مزید توجہ دیتا ہے: اس میں بیٹا 1,000,000 token کانٹیکسٹ ونڈو، بہتر ملٹی ایجنٹ ہم آہنگی جسے Agent Teams کہا جاتا ہے، اور adaptive reasoning سسٹم (Adaptive Thinking) شامل ہے جو effort کنٹرول کے تحت چلتا ہے۔ یہ ماڈل Claude Developer Platform اور تھرڈ پارٹی ایگریگیٹر APIs (مثال کے طور پر، CometAPI) کے ذریعے دستیاب ہے اور بہت سے Claude استعمالات کے لیے ڈراپ اِن اپ گریڈ کے طور پر پیش کیا جاتا ہے۔

Claude Opus 4.6 کیا ہے

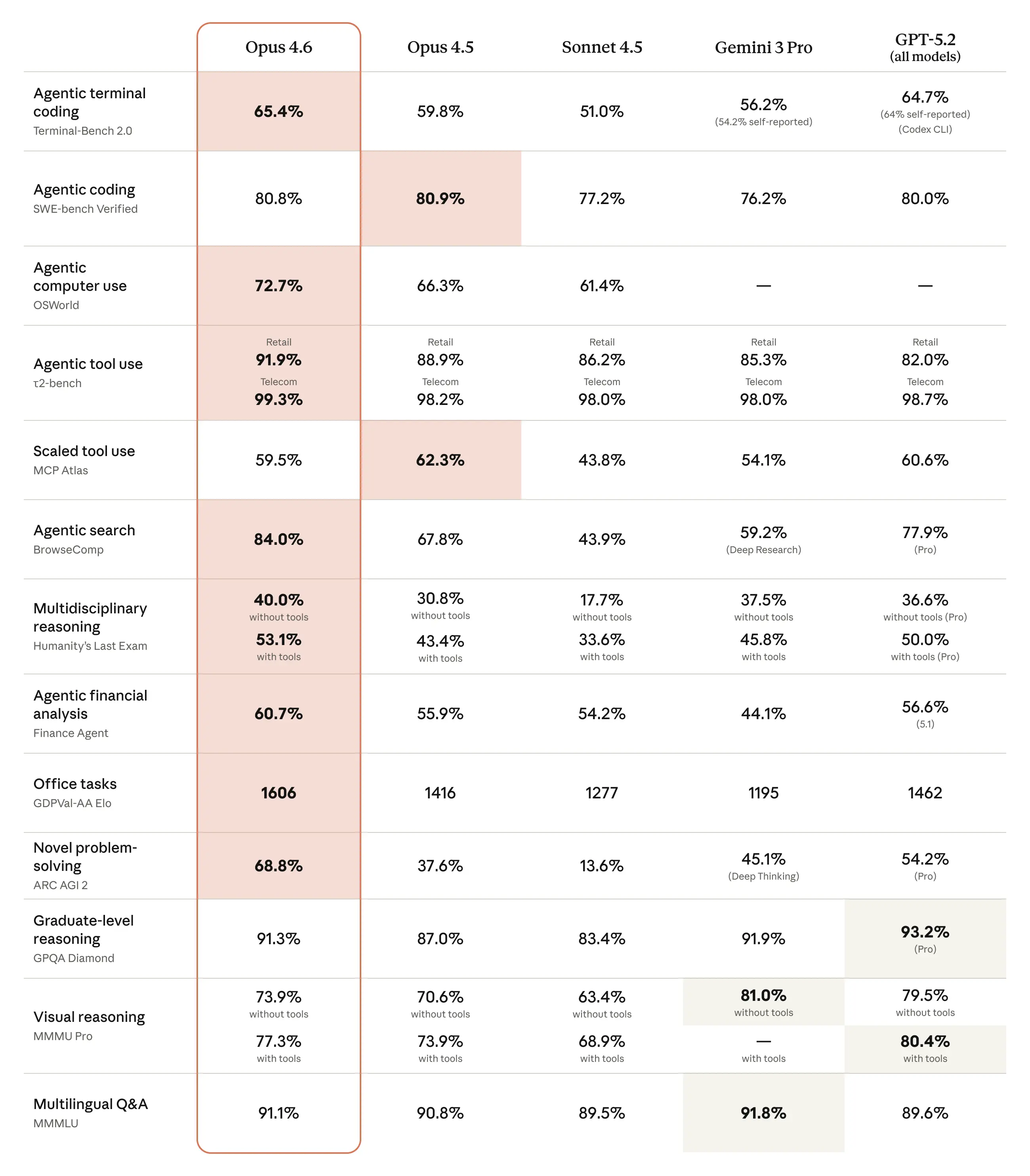

Claude Opus 4.6 Anthropic کا تازہ ترین Opus-class ماڈل ہے، جسے اب تک ان کے سب سے قابل ماڈل کے طور پر پیش کیا گیا ہے—کوڈنگ، ایجنٹک ورک فلو، اور لانگ-کانٹیکسٹ ریزننگ کے لیے۔ یہ ریلیز طویل مدت کے “agentic” کاموں (جیسے staged کوڈ مائیگریشنز، ملٹی-فائل ریفیکٹرز، یا مربوط ریسرچ ایجنٹس)، بھاری دستاویزی پراسیسنگ، اور انٹرپرائز انٹیگریشنز کو ترجیح دیتی ہے۔ Anthropic کے مطابق Opus 4.6، 4.5 سے تقریباً ڈراپ اِن اپ گریڈ ہے، مگر عمل درآمد کرنے والوں کے لیے رویے اور صلاحیت میں چند اہم تبدیلیاں لاتا ہے۔

Claude Opus 4.6 کی اہم خصوصیات — فوری طور پر جاننے کے لیے

- 1M token کانٹیکسٹ ونڈو (بیٹا): Opus 4.6 ایک بہت بڑا کانٹیکسٹ ونڈو متعارف کراتا ہے (Anthropic اسے بیٹا میں پیش کرتا ہے)، جس سے ماڈل انتہائی بڑے ڈاکیومنٹس یا پوری کوڈ بیس کو ایک ہی سیشن میں دیکھ اور سمجھ سکتا ہے۔ اس سے پورے ریپوزٹری کے ریفیکٹرز، طویل قانونی جائزے، اور ملٹی-ڈاکیومنٹ سنتھیسس جیسے کام کہیں زیادہ عملی ہو جاتے ہیں۔

- Agent Teams: Opus 4.6 ایجنٹس کی صلاحیتوں کو بڑھا کر مربوط گروپس (Agent Teams) کی اجازت دیتا ہے — متعدد Claude ایجنٹس جو مختلف ذیلی کاموں پر متوازی طور پر کام کرتے ہیں اور اسٹیٹ شیئر کرتے ہیں۔ اس کا مقصد مشکل مسائل کو تقسیم کر کے حل کرنا ہے (مثلاً، ایک ایجنٹ ٹیسٹ بنانے پر، دوسرا ریفیکٹرنگ پر، تیسرا QA پر) اور ان کے نتائج کو مربوط بنانا۔

- Adaptive Thinking (effort levels): بائنری “thinking” ٹوگل کے بجائے، Opus 4.6 متعدد effort لیولز (مثلاً low/medium/high/max) پیش کرتا ہے جو لیٹنسی اور لاگت کو گہرے chain-of-thought اور زیادہ غور و فکر پر مبنی ریزننگ کے ساتھ توازن دیتے ہیں۔ Anthropic کانٹیکسٹ کمپیکشن جیسے کنٹرول میکانزم بھی فراہم کرتا ہے تاکہ طویل گفتگوؤں کو مؤثر طریقے سے چلایا جا سکے۔

- 128K Output Token Budget: Opus 4.6 سابقہ زیادہ سے زیادہ آؤٹ پٹ بجٹ کو دوگنا کرتا ہے (64K → 128K) تاکہ ماڈل بغیر کٹاؤ کے طویل، مسلسل آؤٹ پٹس دے سکے — یہ ملٹی پارٹ رپورٹس یا کئی فائلوں میں پھیلی کوڈ جنریشن کے لیے مفید ہے۔ اتنے بڑے آؤٹ پٹس کے لیے سٹریمنگ کی سفارش کی جاتی ہے۔

دیگر عملی بہتریوں میں بہتر کوڈنگ اور ڈیبگنگ صلاحیتیں، اور انٹرپرائز و انٹیگریٹڈ ورک فلو کے لیے موڈ/پرائیوریٹی آپشنز شامل ہیں (Copilot انٹیگریشن GitHub Copilot جیسے مقامات پر پہلے ہی رول آؤٹ ہو رہی ہے)۔

یہ خصوصیات کیوں اہم ہیں (مختصر جائزہ)

- 1M token ونڈو بار بار ریٹریول سائیکلز یا متعدد کالز میں دستاویزات کو جوڑنے کی ضرورت کو کم کرتی ہے — آپ ایک ہی کال میں زیادہ کانٹیکسٹ رکھ سکتے ہیں، جو بہت سے نالج-انٹینسو ورک فلو کے لیے ایپلیکیشن لاجک کو آسان بناتا ہے۔

- Agent Teams آرکیٹیکچر بدل دیتی ہیں: واحد مونو لیتھک اسسٹنٹ کے بجائے، آپ چھوٹے ماہر ایجنٹس ڈیزائن کرتے ہیں جو تعاون کرتے ہیں — آسان پیریلائزیشن، واضح ذمہ داریاں، اور پیچیدہ کاموں پر ممکنہ طور پر بہتر قابلِ اعتماد نتائج۔

- Adaptive Thinking آپ کو وقت بمقابلہ معیار کے لیے پیشگوئی کے قابل کنٹرولز دیتا ہے۔ یہ پروڈکشن سسٹمز کے لیے ضروری ہے جہاں لیٹنسی، ڈیٹرمَنزم، اور لاگت اہم پابندیاں ہیں۔

CometAPI کے ذریعے Claude Opus 4.6 کو کال کرنے کا طریقہ — مرحلہ وار

CometAPI استعمال کرتے ہوئے Opus 4.6 کو کال کرنا

بہت سی ٹیمیں متحدہ ملٹی-ماڈل گیٹ وے کو ترجیح دیتی ہیں (جب آپ وینڈرز کے درمیان کلائنٹ کوڈ کو نارملائز کرنا چاہتے ہیں)۔ CometAPI ایک ایسا فراہم کنندہ ہے جو متعدد وینڈر ماڈلز کو ایک ہی OpenAI-compatible سطح کے ذریعے ایکسپوز کرتا ہے؛ اور Anthropic کا میسج فارمیٹ بھی فراہم کیا جاتا ہے (جب آپ کو Anthropic کی API-specific کمپریشن صلاحیتیں درکار ہوں اور آپ CometAPI کے ذریعے Claude Code استعمال کرنا چاہیں)۔ ذیل کی مثالیں پروڈکشن استعمال کے پیٹرنز دکھاتی ہیں: تصدیق، ماڈل کا انتخاب، لانگ کانٹیکسٹ فیچرز کو فعال کرنا، سٹریمنگ، اور لاگت پر کنٹرولز۔ (اگر Comet ماڈل identifiers بدلتا ہے تو نام اور ہیڈرز پرووائیڈر کے ماڈل رجسٹری سے ملا کر ایڈجسٹ کریں۔)

آغاز کرنا (ڈیویلپر چیک لسٹ)

- CometAPI پر رجسٹر کریں،

COMET_API_KEYحاصل کریں، اور کلائنٹ کاbase_urlhttps://api.cometapi.com/v1سیٹ کریں (Comet OpenAI-compatible کلائنٹس اور مثالیں فراہم کرتا ہے)۔ Comet کا کنسول دستیاب ماڈلز اور کسی بھی provider-specific flags کی فہرست دیتا ہے جو آپ پاس کر سکتے ہیں۔ - صلاحیت کی سیٹنگز پہلے سے طے کریں:

thinking: {type: "adaptive"},output_config.effortلیول،max_tokens(آؤٹ پٹ بجٹ)، بڑے آؤٹ پٹس کے لیے سٹریمنگ، اور آیا context compaction درکار ہے یا نہیں۔

Claude API (Python-style pseudo):

import anthropic

import os

# Get your CometAPI key from https://api.cometapi.com/console/token, and paste it here

COMETAPI_KEY = os.environ.get("COMETAPI_KEY") or "<YOUR_COMETAPI_KEY>"

BASE_URL = "https://api.cometapi.com"

client = anthropic.Anthropic(

base_url=BASE_URL,

api_key=COMETAPI_KEY,

)

message = client.messages.create(

model="claude-opus-4-6",

max_tokens=1024,

messages=[{"role": "user", "content": "Hello, Claude"}],

)

print(message.content[0].text)

CometAPI کے ذریعے (OpenAI-compatible shim example):

# Example using an OpenAI-like client pointed at CometAPI

from openai import OpenAI # or compatible client

client = OpenAI(api_key="COMET_KEY", base_url="https://api.cometapi.com/v1")

resp = client.responses.create(

model="claude-opus-4-6",

reasoning={"type":"adaptive"}, # if shim supports same param name

output_config={"effort":"medium"},

messages=[{"role":"user","content":"Generate a migration plan for this monorepo."}]

)

print(resp.output_text)

نوٹ: CometAPI رَیپرز میں پیرامیٹر نام SDK کے لحاظ سے مختلف ہو سکتے ہیں۔ CometAPI ایک سادہ انٹیگریشن ماڈل دستاویز کرتا ہے اور عام طور پر

model="claude-opus-4-6"کو سپورٹ کرتا ہے؛ درست فیلڈ میپنگ اور کسی بھی درکار ریکوئسٹ شیپ ایڈجسٹمنٹس کے لیے CometAPI کی دستاویزات دیکھیں۔

بہترین طریقہ کار اور استعمال

Agent Teams: ڈیزائن پیٹرنز اور ایک مختصر ترکیب

Agent Teams کب استعمال کریں: بڑے کوڈ بیس ریفیکٹرز، ملٹی اسٹیج ڈاکیومنٹ پراسیسنگ، اور وہ ورک فلو جو قدرتی طور پر الگ ماہر ایجنٹس سے میپ ہوتے ہیں (مثلاً، آرکیٹیکٹ، امپلیمینٹر، ریویوئر)۔

سادہ Agent Teams پیٹرن:

- Orchestrator ایجنٹ مجموعی ٹاسک وصول کرتا ہے اور اسے ذیلی کاموں میں تقسیم کرتا ہے۔

- Worker ایجنٹس (ہر ایک Claude انسٹینس) فوکسڈ پرامپٹس اور واضح کامیابی کے معیارات کے ساتھ لانچ کیے جاتے ہیں۔

- متوازی کام: ورکرز آزاد کانٹیکسٹس میں متوازی طور پر چلتے ہیں؛ نتائج orchestrator کو واپس کیے جاتے ہیں۔

- مرج اور ریویو: orchestrator آؤٹ پٹس کو کمپیکٹ کرتا ہے، سنتھیسس پاس چلاتا ہے اور آخری سیفٹی/ریویو چیک کرتا ہے (ضرورت ہو تو آخری پاس کے لیے

effort=maxاستعمال کریں)۔

عملی تجاویز:

- ہر ذیلی ایجنٹ کو سخت سسٹم پرامپٹ اور محدود

max_tokensدیں تاکہ لاگت بے قابو نہ ہو۔ - متوازی کالز اور ریٹرائز کے انتظام کے لیے CometAPI یا کسی orchestration فریم ورک کا استعمال کریں۔

- orchestrator ہسٹری کے لیے context compaction استعمال کریں تاکہ آپ فیصلوں کو محفوظ رکھتے ہوئے مکمل تاریخ کی قیمت ادا نہ کریں۔

کانٹیکسٹ مینجمنٹ: بڑے ان پٹس اور 1M token ونڈو کو ہینڈل کرنا

- ترجیحاً ساختہ ingestion استعمال کریں: دستاویزات کو سیگمنٹڈ حصوں (دستاویزی میٹا ڈیٹا + کانٹینٹ بلاکس) کے طور پر فیڈ کریں۔ اینکر پوائنٹس (دستاویز کے عنوانات، انڈیکسز) برقرار رکھیں اور ماڈل سے کہیں کہ مآخذ کو انڈیکس کے ذریعے حوالہ دے۔ یہ خام فائلیں پیسٹ کرنے کے مقابلے میں زیادہ مضبوط ہے۔

- context compaction (جہاں دستیاب ہو) طویل انٹرایکٹو سیشنز کے لیے استعمال کریں: ماڈل کو پرانی ٹرنز کو summarize کرنے دیں تاکہ آپ ٹوکن بجٹ ختم کیے بغیر اہم حقائق برقرار رکھ سکیں۔ Anthropic کمپیکشن بطور بیٹا صلاحیت فراہم کرتا ہے۔

- اگر آپ کو ڈیٹرمَنِسٹِک recall درکار ہو تو معیاری آرٹیفیکٹس کو اپنی DB میں محفوظ کریں اور ہر ریکوئسٹ میں پوری فائلیں دوبارہ بھیجنے کے بجائے انہیں ID کے ذریعے ریفرنس کریں۔ ہر مرحلے کے لیے درکار حصوں کا خلاصہ یا اخذ کرنے کے لیے ماڈل استعمال کریں۔

لاگت، لیٹنسی اور معیار کے توازن — effort اور دیگر کنٹرولز کا استعمال

- Effort: لاگت بمقابلہ صلاحیت کے توازن کے لیے سب سے مؤثر کنٹرول۔ پروڈکشن سسٹمز میں جو کارکردگی چاہتے ہیں ان کے لیے

mediumسے آغاز کریں؛ اہم آڈٹس، فائنل ریویوز، یا پیچیدہ سنتھیسس ٹاسکس کے لیےhighیاmaxاستعمال کریں۔lowرُوٹین ریٹریول یا مختصر Q&A کے لیے مفید ہے۔ بہت سی ٹیمیںmediumکو ڈیفالٹ رکھ کر اور صرف ضرورت پرeffortبڑھا کر بہترین لاگت کی بچت رپورٹ کرتی ہیں۔ - بیچ اور کیش: دہرائے جانے والے سوالات کے لیے prompt caching اور بہت سے چھوٹے ملتے جلتے کاموں کے لیے batch processing استعمال کریں تاکہ ٹوکن re-ingestion لاگت کم ہو۔ Anthropic کا پلیٹ فارم اور تھرڈ پارٹی پرووائیڈرز prompt caching/batch موڈز کو سپورٹ کرتے ہیں۔

- سٹریمنگ اور chunked آؤٹ پٹس: جب بہت بڑے آؤٹ پٹس (طویل کوڈ جنریشن، کتاب کے ڈرافٹس) کی درخواست کریں تو سٹریمنگ استعمال کریں تاکہ میموری پریشر کم ہو اور early acceptance/abort ممکن ہو۔

آخری خیال — جہاں Opus 4.6 ڈیویلپر کیلکولس کو بدلتا ہے

Opus 4.6 بڑے، پائیدار، ایجنٹک ورک فلو بنانے کی سمت ایک واضح قدم ہے—بغیر اس کے کہ بہت سی چھوٹی ریکوئسٹس کو آپس میں جوڑنا پڑے۔ 1M token ونڈو اور Agent Teams ایپلیکیشنز کی نئی اصناف کو کھولتے ہیں (بڑے کوڈ بیس کی خودکار کاری، طویل قانونی/مالیاتی جائزے، ملٹی-ڈاکیومنٹ ریسرچ اسسٹنٹس)، مگر یہ ڈیزائن کے فوکس کو پرامپٹ انجینئرنگ کی مائیکرو-آپٹیمائزیشنز سے ہٹا کر سسٹم ڈیزائن پر لاتے ہیں: آپ آرٹیفیکٹس کیسے محفوظ کرتے ہیں، ماہرین کو کیسے مربوط کرتے ہیں، لاگت کیسے ماپتے اور قابو میں رکھتے ہیں، اور ایجنٹ کے رویے کی نگرانی کیسے کرتے ہیں۔

ڈیویلپرز Opus 4.6 کو اب CometAPI کے ذریعے ایکسیس کر سکتے ہیں۔ آغاز کے لیے، Playground میں ماڈل کی صلاحیتیں دریافت کریں اور تفصیلی ہدایات کے لیے API guide سے رجوع کریں۔ ایکسیس سے پہلے، براہ کرم یقینی بنائیں کہ آپ CometAPI میں لاگ اِن ہیں اور API key حاصل کر چکے ہیں۔ CometAPI انٹیگریشن میں مدد کے لیے باضابطہ قیمت سے کہیں کم قیمت پیش کرتا ہے۔

Ready to Go?→ Sign up fo openclaw today

اگر آپ AI سے متعلق مزید ٹپس، گائیڈز اور خبریں جاننا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!

.png&w=3840&q=75)