ڈیپ سیک جاری کی گئی۔ ڈیپ سیک V3.2 اور ایک ہائی کمپیوٹ ویرینٹ DeepSeek-V3.2-Speciale, ایک نئے اسپارس-اٹینشن انجن (DSA) کے ساتھ، بہتر ایجنٹ/ٹول کے رویے اور ایک "سوچ" (سوچ کا سلسلہ) موڈ جو اندرونی استدلال کو ظاہر کرتا ہے۔ دونوں ماڈلز ڈیپ سیک کے API (اوپن اے آئی کے موافق اختتامی نقطہ) کے ذریعے دستیاب ہیں اور ماڈل نمونے / تکنیکی رپورٹس عوامی طور پر شائع کی جاتی ہیں۔

DeepSeek V3.2 کیا ہے؟

DeepSeek V3.2 DeepSeek V3 فیملی میں پروڈکشن جانشین ہے - ایک بڑا، طویل سیاق و سباق پیدا کرنے والا ماڈل فیملی جس کے لیے واضح طور پر انجنیئر کیا گیا ہے۔ استدلال - سب سے پہلے ورک فلو اور ایجنٹ کا استعمال۔ V3.2 سابقہ تجرباتی بہتریوں (V3.2-Exp) کو ایک مرکزی دھارے میں شامل ماڈل لائن میں یکجا کرتا ہے جسے DeepSeek کی ایپ، ویب UI اور API کے ذریعے ظاہر کیا گیا ہے۔ یہ تیز، بات چیت کے نتائج اور ایک سرشار دونوں کی حمایت کرتا ہے۔ سوچ (چین کی سوچ) موڈ کثیر مرحلہ استدلال کے کاموں جیسے کہ ریاضی، ڈیبگنگ، اور منصوبہ بندی کے لیے موزوں ہے۔

V3.2 کیوں اہمیت رکھتا ہے (فوری سیاق و سباق)

DeepSeek V3.2 تین عملی وجوہات کی بناء پر قابل ذکر ہے:

- طویل سیاق و سباق: 128k ٹوکن سیاق و سباق کی ونڈوز، جو اسے طویل دستاویزات، قانونی معاہدوں، یا کثیر دستاویزی تحقیق کے لیے موزوں بناتی ہے۔

- استدلال - پہلا ڈیزائن: یہ ماڈل چین آف تھاٹ ("سوچ") کو ورک فلو اور ٹول کے استعمال میں ضم کرتا ہے - ایجنٹ ایپس کی طرف ایک تبدیلی جس کے لیے درمیانی استدلال کے اقدامات کی ضرورت ہوتی ہے۔

- لاگت اور کارکردگی: ڈی ایس اے کا تعارف (فضول توجہ) طویل سلسلے کے لیے کمپیوٹ کو کم کرتا ہے، جس سے بڑے سیاق و سباق کے لیے بہت سستا اندازہ لگایا جا سکتا ہے۔

DeepSeek-V3.2-Speciale کیا ہے اور یہ بیس v3.2 سے کیسے مختلف ہے؟

"Speciale" ویرینٹ کو کیا خاص بناتا ہے؟

DeepSeek V3.2-Speciale is a اعلیٰ حساب، اعلیٰ استدلال v3.2 فیملی کا مختلف قسم۔ متوازن v3.2 ویریئنٹ کے مقابلے میں، اسپیشل کو خاص طور پر ملٹی سٹیپ استدلال، ریاضی، اور ایجنٹی کاموں کے لیے بنایا گیا ہے (اور بعد از تربیت یافتہ)۔ یہ تربیت کے دوران ہیومن فیڈ بیک (RLHF) سے اضافی کمک سیکھنے کا استعمال کرتا ہے اور اندرونی سوچ کو بڑھاتا ہے۔ اس عارضی اختتامی نقطہ اور اسپیشل API تک رسائی کا اعلان وقت کے پابند کے طور پر کیا گیا تھا (اسپیشل پاتھ کے لیے 15 دسمبر 2025 کے اختتامی نقطہ کی میعاد کا حوالہ)۔

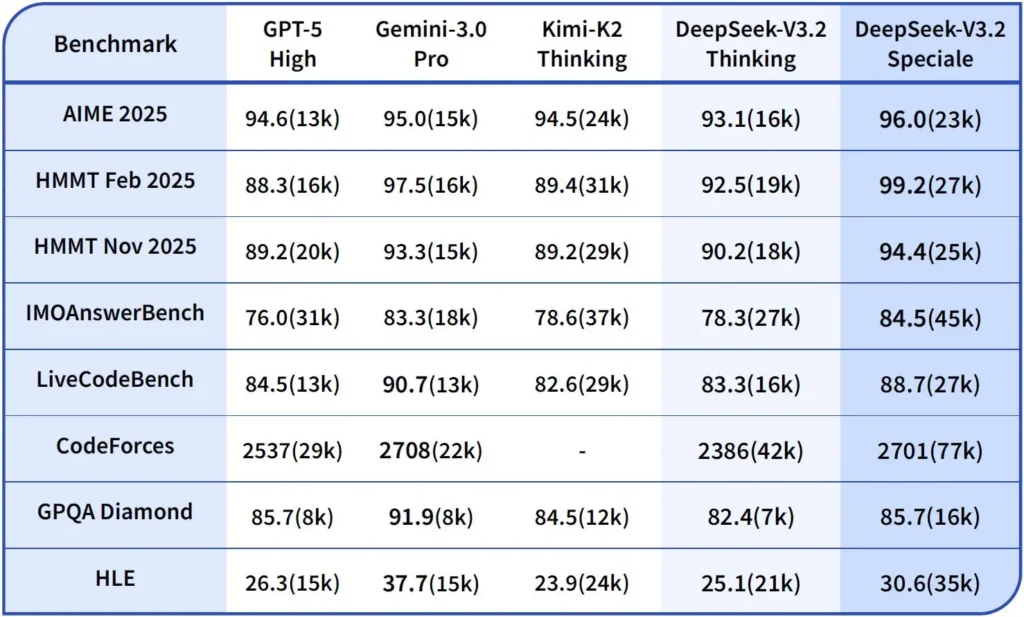

کارکردگی اور معیارات

DeepSeek-V3.2-Speciale V3.2 کا ہائی کمپیوٹ، استدلال کے لیے موزوں قسم ہے۔ اسپیشل ورژن پچھلے ریاضی کے ماڈل ڈیپ سیک-میتھ-وی2 کو مربوط کرتا ہے، اسے اس ماڈل کے طور پر استعمال کیا جاتا ہے جب کام کے بوجھ کی ضرورت ہو گہرا ممکنہ سلسلہ فکر، کثیر مرحلہ مسئلہ حل کرنا، مسابقتی استدلال (مثلاً، ریاضی کا اولمپیاڈ انداز)، اور پیچیدہ ایجنٹی آرکیسٹریشن.

یہ ریاضی کے نظریات کو ثابت کر سکتا ہے اور اپنے طور پر منطقی استدلال کی تصدیق کر سکتا ہے۔ اس نے متعدد عالمی سطح کے مقابلوں میں نمایاں نتائج حاصل کیے ہیں:

- IMO (انٹرنیشنل میتھمیٹیکل اولمپیاڈ) گولڈ میڈل

- CMO (چینی ریاضی اولمپیاڈ) گولڈ میڈل

- آئی سی پی سی (انٹرنیشنل کمپیوٹر پروگرامنگ مقابلہ) دوسرا مقام (انسانی مقابلہ)

- IOI (انفارمیٹکس میں بین الاقوامی اولمپیاڈ) 10 واں مقام (انسانی مقابلہ)

ڈیپ سیک v3.2 میں ریزننگ موڈ کیا ہے؟

ڈیپ سیک نے ایک واضح انکشاف کیا۔ سوچ / استدلال موڈ جس کی وجہ سے ماڈل a پیدا کرتا ہے۔ سوچ کا سلسلہ (CoT) آؤٹ پٹ کے مجرد حصے کے طور پر اس سے پہلے حتمی جواب. API اس CoT کو ظاہر کرتا ہے تاکہ کلائنٹ ایپلی کیشنز اس کا معائنہ، ڈسپلے، یا ڈسٹل کر سکیں۔

مکینکس - جو API فراہم کرتا ہے۔

reasoning_contentمیدان: جب سوچ موڈ کو فعال کیا جاتا ہے تو ردعمل کی ساخت میں شامل ہوتا ہے areasoning_contentفیلڈ (CoT) فائنل کی سطح پرcontent. یہ کلائنٹس کو پروگرام کے مطابق داخلی مراحل تک رسائی حاصل کرنے دیتا ہے۔- سوچ کے دوران ٹول کال کرتا ہے۔: V3.2 ٹول کالز کو سپورٹ کرنے کا دعوی کرتا ہے۔ کے اندر سوچ کی رفتار: ماڈل استدلال کے مراحل اور ٹول کی درخواستوں کو ایک دوسرے سے الگ کر سکتا ہے، جو پیچیدہ کام کی کارکردگی کو بہتر بناتا ہے۔

ڈیپ سیک v3.2 API استدلال کو کیسے نافذ کرتا ہے۔

ورژن 3.2 ایک معیاری استدلال چین API میکانزم متعارف کرایا ہے تاکہ کثیر موڑ کی گفتگو میں مستقل استدلال کی منطق کو برقرار رکھا جا سکے۔

- ہر استدلال کی درخواست میں a

reasoning_contentماڈل کے اندر میدان؛ - اگر صارف چاہتا ہے کہ ماڈل استدلال جاری رکھے، تو اس فیلڈ کو اگلی موڑ پر واپس جانا چاہیے۔

- جب کوئی نیا سوال شروع ہوتا ہے تو پرانا

reasoning_contentمنطقی آلودگی کو روکنے کے لیے صاف کیا جانا چاہیے؛ - ماڈل ریزننگ موڈ میں "ریزننگ → ٹول کال → ری ریزننگ" لوپ کو کئی بار چلا سکتا ہے۔

میں DeepSeek v3.2 API تک کیسے رسائی اور استعمال کروں؟

: مختصر CometAPI ایک OpenAI طرز کا گیٹ وے ہے جو بہت سے ماڈلز (بشمول ڈیپ سیک فیملیز) کے ذریعے سامنے لاتا ہے۔ https://api.cometapi.com/v1 تاکہ آپ ماڈلز کو تبدیل کر کے تبدیل کر سکیں model درخواستوں میں تار۔ CometAPI پر سائن اپ کریں اور پہلے اپنی API کلید حاصل کریں۔

CometAPI بمقابلہ براہ راست DeepSeek کیوں استعمال کریں؟

- CometAPI بلنگ، شرح کی حدود اور ماڈل کے انتخاب کو مرکزی بناتا ہے (اگر آپ کوڈ کو تبدیل کیے بغیر فراہم کنندگان کو تبدیل کرنے کا ارادہ رکھتے ہیں)۔

- ڈائریکٹ ڈیپ سیک اینڈ پوائنٹس (جیسے،

https://api.deepseek.com/v1) اب بھی موجود ہے اور بعض اوقات فراہم کنندہ کی مخصوص خصوصیات کو ظاہر کرتا ہے۔ سہولت کے لیے CometAPI یا فراہم کنندہ کے مقامی کنٹرولز کے لیے براہ راست وینڈر اینڈ پوائنٹ کا انتخاب کریں۔ ان پر بھروسہ کرنے سے پہلے تصدیق کریں کہ کون سی خصوصیات (مثلاً اسپیشل، تجرباتی اینڈ پوائنٹس) CometAPI کے ذریعے دستیاب ہیں۔

مرحلہ A - ایک CometAPI اکاؤنٹ بنائیں اور ایک API کلید حاصل کریں۔

- CometAPI (سائن اپ / کنسول) پر جائیں اور ایک API کلید بنائیں (ڈیش بورڈ عام طور پر دکھاتا ہے

sk-...)۔ اسے خفیہ رکھیں۔ CometAPI

مرحلہ B — دستیاب ماڈل کے عین مطابق نام کی تصدیق کریں۔

- ماڈلز کی فہرست سے استفسار کریں تاکہ درست ماڈل سٹرنگ CometAPI کے سامنے آئے (ماڈل کے ناموں میں متغیر لاحقے شامل ہو سکتے ہیں)۔ ہارڈ کوڈنگ ناموں سے پہلے ماڈل اینڈ پوائنٹ کا استعمال کریں:

curl -s -H "Authorization: Bearer $COMET_KEY" \

https://api.cometapi.com/v1/models | jq .

ڈیپ سیک اندراج تلاش کریں (جیسے deepseek-v3.2 or deepseek-v3.2-exp) اور عین مطابق آئی ڈی نوٹ کریں۔ CometAPI کو بے نقاب کرتا ہے a /v1/models لسٹنگ.

مرحلہ C - ایک بنیادی چیٹ کال کریں (کرل)

بدل <COMET_KEY> اور deepseek-v3.2 ماڈل آئی ڈی کے ساتھ جس کی آپ نے تصدیق کی ہے:

curl https://api.cometapi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer <COMET_KEY>" \

-d '{

"model": "deepseek-v3.2",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize DeepSeek v3.2 in two sentences."}

],

"max_tokens":300

}'

یہ وہی OpenAI طرز کا کال پیٹرن ہے — CometAPI منتخب فراہم کنندہ کو فارورڈ کرتا ہے۔

مطابقت اور احتیاطی تدابیر

- کلاڈ کوڈ ماحول میں تھنک موڈ کو فعال کرنے کی حمایت کرتا ہے۔

- کمانڈ لائن (CLI) میں، صرف ماڈل کا نام deepseek-reasoner درج کریں۔

- تاہم، یہ اس وقت کے لیے غیر معیاری ٹولز جیسے کلائن اور رو کوڈ کے ساتھ مطابقت نہیں رکھتا۔

- عام کاموں کے لیے نان تھنک موڈ اور پیچیدہ منطقی استدلال کے لیے تھنک موڈ استعمال کرنے کی سفارش کی جاتی ہے۔

عملی اپنانے کے نمونے: فن تعمیر کی چند مثالیں۔

1 — ڈویلپر ورک فلو کے لیے معاون ایجنٹ

- موڈ: پیچیدہ کوڈ جنریشن اور ٹیسٹ تخلیق کے لیے خصوصی (سوچ موڈ) کا استعمال ان لائن اسسٹنٹ کے لیے فاسٹ چیٹ موڈ۔

- سیفٹی: تیار کردہ کوڈ کے لیے CI پائپ لائن چیک اور سینڈ باکسڈ ٹیسٹ ایگزیکیوشن کا استعمال کریں۔

- ہوسٹنگ: API یا بڑے سیاق و سباق کے لیے vLLM + ملٹی-GPU کلسٹر پر خود میزبان۔

2 - قانونی/مالیاتی ٹیموں کے لیے دستاویز کا تجزیہ

- موڈ: طویل معاہدوں پر کارروائی کرنے اور ساختی خلاصے اور کارروائی کی فہرستیں تیار کرنے کے لیے DSA طویل سیاق و سباق کی اصلاح کے ساتھ V3.2۔

- سیفٹی: بہاو کے فیصلوں کے لیے انسانی اٹارنی سائن آف؛ میزبانی کے اختتامی پوائنٹس پر بھیجنے سے پہلے PII کی تخفیف۔

3 - خود مختار ڈیٹا پائپ لائن آرکیسٹریٹر

- موڈ: ملٹی سٹیپ ای ٹی ایل کاموں کی منصوبہ بندی کرنے کے لیے سوچنے کا موڈ، ڈیٹا بیس سے استفسار کرنے کے لیے کال ٹولز اور کال کی توثیق کے ٹیسٹ۔

- سیفٹی: کسی بھی ناقابل واپسی آپریشن سے پہلے ایکشن کی تصدیق اور قابل تصدیق چیک لاگو کریں (مثال کے طور پر، تباہ کن DB تحریر)۔

مندرجہ بالا پیٹرن میں سے ہر ایک آج V3.2 فیملی ماڈلز کے ساتھ قابل عمل ہے، لیکن آپ کو ماڈل کو تصدیقی ٹولنگ اور قدامت پسند گورننس کے ساتھ جوڑنا چاہیے۔

میں v3.2 کے ساتھ لاگت اور کارکردگی کو کیسے بہتر بنا سکتا ہوں؟

جان بوجھ کر دوہری طریقوں کا استعمال کریں۔

- مائیکرو تعاملات کے لیے فاسٹ موڈ: مختصر بازیافتوں، فارمیٹ کے تبادلوں، یا ڈائریکٹ API کالز کے لیے غیر سوچنے والے ٹول موڈ کا استعمال کریں جہاں تاخیر کی اہمیت ہو۔

- منصوبہ بندی اور تصدیق کے لیے سوچنے کا موڈ: پیچیدہ کاموں، ملٹی ایکشن ایجنٹس، یا حفاظت کے لیے حساس فیصلوں کو سوچنے کے موڈ میں لے جائیں۔ اہم کارروائیوں کو انجام دینے سے پہلے درمیانی مراحل پر قبضہ کریں اور تصدیقی پاس (خودکار یا انسانی) چلائیں۔

مجھے کون سا ماڈل مختلف قسم کا انتخاب کرنا چاہئے؟

- deepseek-v3.2 — عام ایجنٹی کاموں کے لیے متوازن پروڈکشن ماڈل۔

- deepseek-v3.2-Speciale — خصوصی ہیوی ریزننگ ویرینٹ؛ ابتدائی طور پر صرف API ہو سکتا ہے اور اس وقت استعمال کیا جا سکتا ہے جب آپ کو بہترین ممکنہ استدلال/بینچ مارک کارکردگی کی ضرورت ہو (اور ممکنہ طور پر زیادہ قیمت قبول کریں)۔

عملی لاگت کے کنٹرول اور نکات

- فوری انجینئرنگ: سسٹم کی ہدایات کو مختصر رکھیں، بے کار سیاق و سباق بھیجنے سے گریز کریں۔ سسٹم کی واضح ہدایات: سسٹم پرامپٹس کا استعمال کریں جو موڈ کے ارادے کا اعلان کرتے ہیں: مثال کے طور پر، "آپ سوچنے کے موڈ میں ہیں — کال کرنے سے پہلے اپنے پلان کی فہرست بنائیں۔" ٹول موڈ کے لیے، "کیلکولیٹر API کے ساتھ تعامل کرتے وقت، مندرجہ ذیل فیلڈز کے ساتھ صرف JSON آؤٹ پٹ" جیسی رکاوٹیں شامل کریں۔

- چنکنگ + بازیافت بڑھانا: ہر صارف کے سوال کے لئے صرف سب سے زیادہ متعلقہ حصوں کو بھیجنے کے لئے ایک بیرونی بازیافت کا استعمال کریں۔

- درجہ حرارت اور نمونے لینے: عزم کو بڑھانے کے لیے آلے کے تعامل کے لیے کم درجہ حرارت؛ اسے تلاشی یا نظریاتی کاموں میں بلند کریں۔

بینچ مارک اور پیمائش

- تصدیق ہونے تک آؤٹ پٹس کو ناقابل اعتماد سمجھیں: یہاں تک کہ استدلال کے نتائج بھی غلط ہو سکتے ہیں۔ ناقابل واپسی کارروائیاں کرنے سے پہلے ڈیٹرمنسٹک چیکس (یونٹ ٹیسٹ، ٹائپ چیک) شامل کریں۔

- مختلف قسم کا ارتکاب کرنے سے پہلے نمونے کے کام کے بوجھ پر A/B ٹیسٹ چلائیں۔ v3.2 نے استدلال کے معیارات پر بڑے فوائد کی اطلاع دی ہے، لیکن حقیقی ایپ کا رویہ فوری ڈیزائن اور ان پٹ کی تقسیم پر منحصر ہے۔

اکثر پوچھے گئے سوالات

س: ماڈل سے CoT حاصل کرنے کا تجویز کردہ طریقہ کیا ہے؟

A: استعمال کریں deepseek-reasoner ماڈل یا سیٹ thinking/thinking.type = enabled آپ کی درخواست میں. جواب میں شامل ہے۔ reasoning_content (CoT) اور فائنل content.

سوال: کیا ماڈل سوچنے کے موڈ میں ہوتے ہوئے بیرونی ٹولز کو کال کر سکتا ہے؟

A: ہاں — V3.2 نے سوچنے اور غیر سوچنے کے دونوں طریقوں میں استعمال کیے جانے والے ٹولز کی صلاحیت متعارف کرائی۔ ماڈل اندرونی استدلال کے دوران ساختی ٹول کالز کا اخراج کر سکتا ہے۔ استعمال کریں۔ strict خراب کالوں سے بچنے کے لیے JSON اسکیموں کو موڈ اور صاف کریں۔

سوال: کیا سوچنے کا انداز استعمال کرنے سے لاگت بڑھ جاتی ہے؟

A: ہاں — سوچنے کا موڈ انٹرمیڈیٹ CoT ٹوکن نکالتا ہے، جس سے ٹوکن کے استعمال میں اضافہ ہوتا ہے اور اس وجہ سے لاگت آتی ہے۔ اپنے سسٹم کو صرف ضرورت کے وقت سوچنے کے قابل بنانے کے لیے ڈیزائن کریں۔

سوال: مجھے کون سا اختتامی نقطہ اور بنیادی URL استعمال کرنا چاہئے؟

A: CometAPI OpenAI کے موافق اختتامی پوائنٹس فراہم کرتا ہے۔ ڈیفالٹ بیس یو آر ایل ہے۔ https://api.cometapi.com اور بنیادی بات چیت کا اختتامی نقطہ ہے۔ /v1/chat/completions (یا /chat/completions آپ کے منتخب کردہ بنیادی URL پر منحصر ہے)۔

سوال: کیا ٹول کالنگ استعمال کرنے کے لیے خصوصی ٹولنگ کی ضرورت ہے؟

A: نہیں — API JSON میں ساختی فنکشن ڈیکلریشن کو سپورٹ کرتا ہے۔ آپ کو فراہم کرنے کی ضرورت ہے۔ tools پیرامیٹر، ٹول اسکیماس اور آپ کی درخواست میں JSON-فنکشن لائف سائیکل کو ہینڈل کریں: فنکشن-کال JSON وصول کریں، فنکشن کو انجام دیں، پھر تسلسل یا بندش کے لیے ماڈل پر نتائج واپس کریں۔ سوچنے کا موڈ واپس پاس کرنے کی ضرورت کا اضافہ کرتا ہے۔ reasoning_content آلے کے نتائج کے ساتھ ساتھ۔

نتیجہ

DeepSeek V3.2 اور DeepSeek-V3.2-Speciale کی طرف واضح دھکا کی نمائندگی کرتے ہیں کھلا، استدلال پر مبنی LLMs جو چین کی سوچ کو واضح بناتے ہیں اور ایجنٹ ٹول ورک فلو کو سپورٹ کرتے ہیں۔ وہ طاقتور نئے پرائمیٹوز (DSA، سوچنے کا موڈ، ٹول کے استعمال کی تربیت) پیش کرتے ہیں جو قابل اعتماد ایجنٹوں کی تعمیر کو آسان بنا سکتے ہیں — بشرطیکہ آپ کو ٹوکن لاگت، محتاط ریاستی انتظام، اور آپریشنل کنٹرولز کا حساب دیا جائے۔

ڈویلپرز رسائی حاصل کر سکتے ہیں۔ ڈیپ سیک v3.2 API CometAPI کے ذریعے وغیرہ، جدید ترین ماڈل ورژن ہمیشہ سرکاری ویب سائٹ کے ساتھ اپ ڈیٹ کیا جاتا ہے۔ شروع کرنے کے لیے، میں ماڈل کی صلاحیتوں کو دریافت کریں۔ کھیل کے میدان اور مشورہ کریں API گائیڈ تفصیلی ہدایات کے لیے۔ رسائی کرنے سے پہلے، براہ کرم یقینی بنائیں کہ آپ نے CometAPI میں لاگ ان کیا ہے اور API کلید حاصل کر لی ہے۔ CometAPI آپ کو انضمام میں مدد کے لیے سرکاری قیمت سے کہیں کم قیمت پیش کریں۔

جانے کے لیے تیار ہیں؟→ ڈیپ سیک کا مفت ٹرائل v3.2 !

اگر آپ AI پر مزید ٹپس، گائیڈز اور خبریں جاننا چاہتے ہیں تو ہمیں فالو کریں۔ VK, X اور Discord!