MiniMax-M2.5 ایک نیا، پیداواریت پر مرکوز بڑا لینگویج ماڈل ہے جو MiniMax کی جانب سے کوڈنگ، ایجنٹک ٹول استعمال، اور آفس ورک فلوز کے لیے بہتر بنایا گیا ہے۔ آپ اسے اس کے نیٹو MiniMax پلیٹ فارم کے ذریعے یا CometAPI جیسے API ایگریگیٹرز کے ذریعے کال کر سکتے ہیں۔ آپ کو API استعمال کرنے کے لیے صرف CometAPI کی API key حاصل کرنے کی ضرورت ہے، کیونکہ Minimax-M2.5 بھی چیٹ فارمیٹ کو سپورٹ کرتا ہے۔

MiniMax-M2.5 کیا ہے؟

MiniMax-M2.5، MiniMax کی تازہ ترین بڑی ماڈل ریلیز ہے: M2 فیملی کی ایک ارتقائی شکل جسے کمپنی ایک جنرل پرپز، ایجنٹ-قابل ماڈل کے طور پر پوزیشن کرتی ہے، جس کی خاص طور پر کوڈ جنریشن، ٹول استعمال، اور کثیر مرحلہ استدلال میں مضبوط کارکردگی ہے۔ M2.5 فیملی کو فروری 2026 کی ریلیز کے طور پر اعلان کیا گیا اور اس میں معیاری M2.5 اور “highspeed” دونوں ویرینٹس شامل ہیں جو کم لیٹنسی کے لیے بہتر کیے گئے ہیں جبکہ بنیادی صلاحیتیں یکساں رکھتی ہیں۔ M2.5 فیملی نے سافٹ ویئر انجینئرنگ کے بینچ مارکس میں بہتر اسکورز اور بیرونی ٹولز (سرچ، ایجنٹس وغیرہ) سے تعامل کے دوران بہتر رویہ دکھایا ہے۔

وینڈر M2.5 کو پہلے کے M2.x ریلیزز سے ایک قدم آگے بتاتا ہے، جس میں زیادہ مضبوط استدلال، بہتر کوڈ جنریشن، اور ٹول کالنگ کی زیادہ قابلِ اعتماد کارکردگی شامل ہے۔ MiniMax کے فروری 2026 کے اوائل کے لیے عوامی ریلیز نوٹس میں M2.5 کو ایک سنگ میل قرار دیا گیا: ہدایات کی بہتر ٹیوونگ، کوڈ کی مزید مضبوط سمجھ، اور کئی کوڈ-مرکوز بینچ مارکس پر قابلِ پیمائش اضافہ۔ اس ریلیز میں شامل ہیں:

- ایک معیاری M2.5 ماڈل (درستگی اور استدلال پر زور کے ساتھ)۔

- ایک M2.5-highspeed ویرینٹ جو انٹرایکٹو ڈویلپر ورک فلو کے لیے کم لیٹنسی فراہم کرتا ہے۔

- بھاری کوڈ جنریشن کے استعمال کے لیے “Coding Plan” کی واضح رہنمائی اور بلنگ آپشنز۔

کلیدی تکنیکی نمایاں نکات

- معماری: MoE (کل پیرا میٹر کاؤنٹ بڑا مگر انفرنس کے دوران فعال سیٹ بہت چھوٹا)، جو بھاری ٹاسکس کے لیے لاگت/کارکردگی کا متوازن امتزاج فراہم کرتا ہے۔

- مضبوطیاں: جدید ترین کوڈنگ کارکردگی، ملٹی ٹرن استدلال، طویل سیاق ہینڈلنگ اور ایجنٹس/ٹول انٹیگریشنز۔

- ذائقے/ویرینٹس: MiniMax تھروپٹ بمقابلہ لیٹنسی کے لیے ٹیون کیے گئے ویرینٹس شائع کرتا ہے (مثلاً

MiniMax-M2.5اورM2.5-highspeed)۔

آج اس کی اہمیت: بہت سی ٹیمیں جو ڈویلپر ٹولز، پروگرامنگ اسسٹنٹس، اور ایجنٹک آٹو میشنز بناتی ہیں، ایسے ماڈل کو اہمیت دیتی ہیں جو متعدد ٹرنز میں استدلال کر سکے، ٹولز کو محفوظ طریقے سے کال کرے، اور اعلیٰ معیار کا کوڈ خارج کرے۔ M2.5 — اپنی معماری اور تربیتی انتخاب کی بدولت — واضح طور پر انہی منظرناموں کے لیے مارکیٹ کیا گیا ہے۔

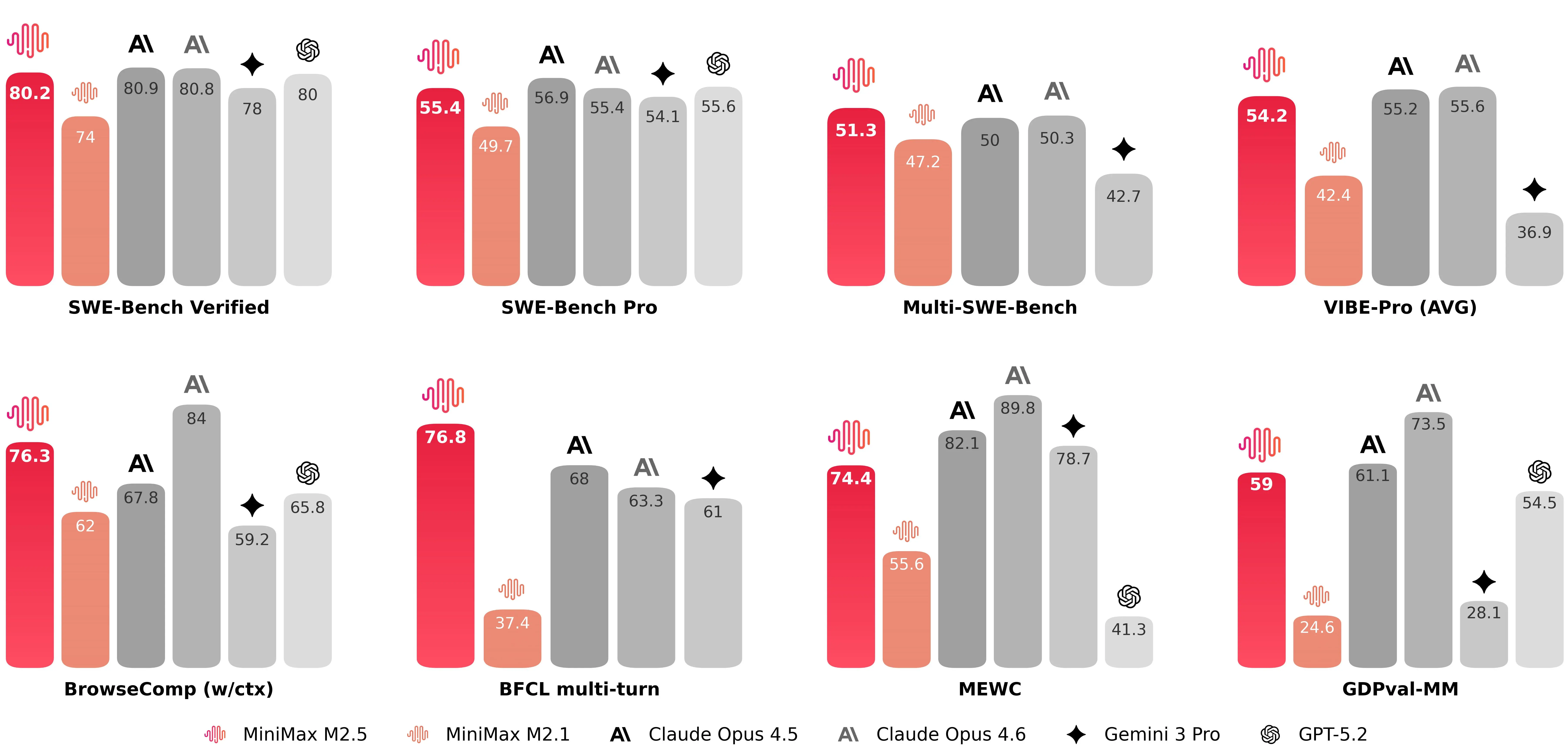

MiniMax-M2.5 کی بینچ مارکنگ

کوڈنگ-اسپیسیفک بینچ مارکس پر M2.5 کی پوزیشن

MiniMax-M2.5 نے SWE-Bench Verified پر 80.2% اسکور کیا، اور ملٹی ٹاسک کوڈنگ اور براؤزنگ-ایگمینٹڈ بینچ مارکس پر بھی مضبوط نمبرز دکھائے (کمپنی کے جاری کردہ قابلِ ذکر اعداد میں Multi-SWE-Bench پر 51.3% اور BrowseComp پر 76.3% شامل ہیں جب کانٹیکسٹ مینجمنٹ فعال ہو)۔ یہ اعداد و شمار لانچ کے وقت M2.5 کو کوڈ جنریشن اور مسئلہ حل کرنے کے لیے دستیاب اعلیٰ کارکردہ ماڈلز میں رکھتے ہیں۔ MiniMax-M2.5 کی لانچ اس امر کی تصدیق کرتی ہے کہ M2.5 اعلیٰ درجے کے کوڈنگ ماڈلز کے ساتھ مقابلہ کر رہا ہے۔

ڈویلپرز کے لیے فائدہ دوہرا ہے:

- پہلے ہی پاس میں زیادہ کامیابی کی شرح: کم ترمیمی چکر، کم انسانی ڈیبگنگ، اور خودمختار کوڈنگ ایجنٹس کے لیے کم “نگرانی” کا بوجھ۔

- بہتر فل اسٹیک کوریج: M2.5 کو ڈیسک ٹاپ ایپس، موبائل، اور کراس پلیٹ فارم ٹول چینز کے پار فل اسٹیک ورک فلو کی سپورٹ کے طور پر بیان کیا گیا ہے، یعنی یہ صرف اسنیپٹس نہیں بلکہ مربوط ملٹی-فائل حل اور بلڈ اسکرپٹس بنانے کا ہدف رکھتا ہے۔

ایجنٹک ورک فلو کے لیے تیار

M2.5 کو “فطری طور پر Agent منظرناموں کے لیے ڈیزائن شدہ” بتایا جاتا ہے۔ عملی طور پر، اس کا مطلب ہے کہ معماری اور تربیتی طریقہ کار ترجیح دیتے ہیں:

- ٹول کال کرنے کی درستگی: صحیح نحو اور پیرا میٹرز کے ساتھ API کالز یا shell/SQL کمانڈز جاری کرنا۔

- کانٹیکسٹ سوئچنگ اور میموری: رکی ہوئی کثیر مرحلہ کارروائی کو پچھلی حساب شدہ حالت کھوئے بغیر جاری رکھنا۔

- فائل ہیرا پھیری: عام آفس فارمیٹس کو پروگرام کے ذریعے بنانا اور ترمیم کرنا (مثلاً ایک پاورپوائنٹ تیار کرنا اور پھر فالو اپ درخواست کی بنیاد پر اس میں ترمیم کرنا)۔

سرچ اور براؤزنگ ایگمینٹیشن

جب M2.5 کو براؤزنگ یا ریٹریول لیئرز کے ساتھ جوڑا جاتا ہے، تو MiniMax براؤزنگ بینچ مارکس پر نمایاں بہتر اسکورز رپورٹ کرتا ہے، جو آؤٹ پٹس میں بیرونی معلومات اور حوالہ جات کے مضبوط انضمام کی عکاسی کرتا ہے۔ اس سے M2.5 ان ٹولز کے لیے موزوں بنتا ہے جنہیں تازہ ترین مواد لانا، API نتائج کی کراس چیکنگ کرنا، یا حقیقی دنیا کے ڈیٹا کے ساتھ کوڈ جنریشن کو تقویت دینا ضروری ہو (مثال کے طور پر تازہ ترین SDK ڈاکس لانا اور کوڈجن کے دوران انہیں درست طریقے سے استعمال کرنا)۔ یہ صلاحیتیں ان ٹیموں کے لیے اہم ہیں جو “ایجنٹک” فیچرز جیسے خودکار QA، CI ٹول چینز، یا ڈاکومنٹ-ڈریون اسسٹنٹس بناتی ہیں۔

میں MiniMax-2.5 API (CometAPI کے ذریعے) کیسے استعمال کر سکتا/سکتی ہوں؟

CometAPI ایک API ایگریگیشن پلیٹ فارم ہے جو سینکڑوں ماڈلز کو ایک واحد، OpenAI-مطابقت رکھنے والے REST انٹرفیس کے ذریعے فراہم کرتا ہے۔ چونکہ CometAPI کا انٹرفیس OpenAI کے chat/completions اینڈ پوائنٹس سے مشابہ ہے، آپ اکثر موجودہ OpenAI-اسٹائل کلائنٹس کو صرف api_base اور API key بدل کر دوبارہ استعمال کر سکتے ہیں۔ اگر آپ براہِ راست MiniMax کے پلیٹ فارم کے ساتھ انٹیگریٹ نہیں کرنا چاہتے (وجوہات جیسے متحدہ بلنگ، ملٹی ماڈل A/B ٹیسٹنگ، یا وینڈر ابسٹریکشن)، تو آپ CometAPI کی “chat” سرفیس کے ذریعے MiniMax-M2.5 کو کال کر سکتے ہیں۔ CometAPI پلیٹ فارم ایک مستقل ریکویسٹ فارمیٹ، ایک SDK اور ویب پلیگراؤنڈ فراہم کرتا ہے — اور یہ فی-ماڈل نام اور پیرا میٹرز ایکسپوز کرتا ہے (تاکہ آپ کال کرتے وقت درست provider/model سٹرنگ منتخب کریں)۔

ذیل میں CometAPI کے ذریعے MiniMax-M2.5 کو کال کرنے کے لیے ایک مختصر، عملی رہنما ہے، curl اور Python مثالوں کے ساتھ۔

شروع کرنے کے بنیادی مراحل کیا ہیں؟

- CometAPI اکاؤنٹ کے لیے سائن اپ کریں اور API key حاصل کریں۔ (CometAPI ماڈلز کو ٹیسٹ کرنے کے لیے پلیگراؤنڈ اور SDKs فراہم کرتا ہے۔)

- MiniMax-M2.5 کے لیے درست ماڈل نام تلاش کرنے کو CometAPI کی ماڈل فہرست یا CometAPI پلیگراؤنڈ چیک کریں۔

- ایک مستند POST ریکویسٹ بنائیں جس میں

modelپیرا میٹر منتخب MiniMax ماڈل پر سیٹ ہو اور پے لوڈ CometAPI کے chat/completion اسکیمہ کی پیروی کرے۔ - اپنے ورک فلو کے مطابق پیرا میٹرز (temperature، max_tokens، system messages، streaming) ٹیون کریں۔

توثیق اور اینڈ پوائنٹ کی بنیادی باتیں

- Base URL:

https://api.cometapi.com/v1(OpenAI-اسٹائل راستے جیسے/chat/completionsسپورٹڈ ہیں)۔ - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Model فیلڈ: CometAPI کے ماڈل کیٹلاگ میں دکھائے گئے عین ماڈل سٹرنگ استعمال کریں (مثالیں:

"minimax-m2.5")

مثال 1 — تیز curl (REST، OpenAI انداز)

// Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

نوٹس:

- CometAPI کے کیٹلاگ میں دکھائی گئی ماڈل سٹرنگ کو بالکل اسی طرح استعمال کریں؛ s.

stream: trueسٹریمنگ آؤٹ پٹس کے لیے سپورٹڈ ہے (اگر آپ جزوی ٹوکنز چاہتے ہیں تو server-sent events یا chunked responses کو ہینڈل کریں)۔

مثال 2 — Python (requests) کے ذریعے ایک چیٹ کمپلیشن

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

مثال 3 — litellm / CometAPI انٹیگریشن استعمال کرنا (Python کنونینس لیئر)

CometAPI کو متعدد کمیونٹی SDKs اور اڈاپٹرز سپورٹ کرتے ہیں۔ liteLLM ڈاکس ایک مختصر فلو دکھاتے ہیں جہاں آپ COMETAPI_KEY سیٹ کرتے ہیں اور ماڈل کو نام سے کال کرتے ہیں۔ یہ پروٹو ٹائپنگ کے لیے عمدہ ہے:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Litellm / Comet انٹیگریشنز مفید یوٹیلٹیز فراہم کرتے ہیں (سٹریمنگ، async، واضح api_key پیرامیٹر) جو بہت سے موجودہ OpenAI SDK پیٹرنز کی عکاسی کرتے ہیں۔

آپ کو M2.5 کے لیے پرامپٹس اور سسٹم میسجز کیسے ڈیزائن کرنے چاہئیں

کردار اور پابندیوں کے بارے میں واضح رہیں

کوڈ مانگتے وقت M2.5 کو ایک واضح سسٹم رول دیں۔ مثال:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

پیچیدہ مسائل کے لیے قدم بہ قدم تقسیم استعمال کریں

جب M2.5 سے پیچیدہ فیچرز نافذ کروائیں، تو ایک مختصر ڈیکمپوزیشن استعمال کریں:

- پہلے ڈیزائن آؤٹ لائن مانگیں۔

- انٹرفیس سِگنیچرز کی درخواست کریں۔

- امپلیمینٹیشن اور ٹیسٹس مانگیں۔

یہ ہیلوسینیشن کے خطرے کو کم کرتا ہے اور ماڈیولر، ریویو کے قابل آؤٹ پٹس دیتا ہے۔

Temperature، max_tokens اور سیفٹی

- فیصلہ کن کوڈ کے لیے:

temperatureکو 0.0 کے قریب رکھیں۔ - ایکسپلورٹری ڈیزائن کے لیے: 0.2–0.5 میں

temperatureتخلیقی طریقے سامنے لا سکتی ہے۔ - بڑے ریفیکٹرز یا طویل ٹیسٹ سوٹس کے لیے

max_tokensفراخ رکھیں۔

یونٹ ٹیسٹس اور استدلال کی درخواست کریں

جب کوڈ مانگیں، تو یونٹ ٹیسٹس اور الگورتھم کی مختصر وضاحت بھی مانگیں۔ یہ آپ کو پہلی ہی کوشش میں قابلِ اجرا آرٹیفیکٹس دلانے اور باریک بگز پکڑنے میں مدد دیتا ہے۔

طویل-مدتی انفرنس اور اسٹیٹ ٹریکنگ

M2.5 ماڈل ایک عمدہ اسٹیٹ ٹریکنگ میکانزم پیش کرتا ہے، جو ہر بار محدود تعداد کے مقاصد پر توجہ دے کر طویل زمانی سلسلوں پر سوچ کی تسلسل اور سمت کو مؤثر طور پر یقینی بناتا ہے بجائے اس کے کہ سب کچھ بہ یک وقت پروسیس کرے۔ M2.5 کانٹیکسٹ کے شعور کی صلاحیت سے لیس ہے، جو مؤثر ٹاسک ایگزیکیوشن اور بہتر کانٹیکسٹ مینجمنٹ کو ممکن بناتا ہے۔

پروڈکشن میں M2.5 کے عملی استعمال کے نکات

MiniMax-M2.5 کو کثیر مرحلہ ٹولنگ اور کوڈ کے لیے ٹیون کیا گیا ہے۔ ذیل میں پروڈکشن میں بہترین نتائج حاصل کرنے کے لیے عملی، تجربہ-آزمودہ نکات ہیں۔

پرامپٹ انجینئرنگ اور سسٹم میسجز

- رول اور پابندیوں کے لیے واضح سسٹم میسجز استعمال کریں۔ کوڈ ٹاسکس کے لیے درکار رن ٹائم/ٹیسٹ فریم ورکس شامل کریں (مثلاً “Python 3.11 کے مطابق pytest واپس کریں”)۔

- کانٹیکسٹ فراہم کریں: ایجنٹک یا کثیر مرحلہ کاموں کے لیے مرحلہ میٹا ڈیٹا اور ٹول کی تفصیل بطور ساختہ JSON یا بلٹ لسٹس میں دیں۔ M2.5 ساختہ ان پٹس پر اچھا ردعمل دیتا ہے کیونکہ یہ ٹول استعمال کے لیے بہتر بنایا گیا ہے۔

فنکشن / ٹول کالنگ

- اگر آپ ٹول کالنگ کے لیے CometAPI کو گیٹ وے کے طور پر استعمال کر رہے ہیں، تو یقینی بنائیں کہ آپ کے اضافی فیلڈز (مثلاً OpenAI اسٹائل میں

function_call) CometAPI/ماڈل کی توقعات کے مطابق ہوں۔ ماڈل سپورٹ کی تصدیق Comet کے ماڈل پیج پر کریں کیونکہ ٹول سیمنٹکس پرووائیڈر کے لحاظ سے مختلف ہو سکتے ہیں۔ - مضبوط آرکسٹریشن کے لیے، بڑے کاموں کو چھوٹی کالز میں تقسیم کریں اور ڈیٹرمنسٹک چیک پوائنٹس برقرار رکھیں۔ M2.5 کثیر مرحلہ ہدایات کی پیروی میں مضبوط ہے، مگر آپ ہر مرحلے کے بعد توثیق کر کے سب سے زیادہ قابلِ اعتماد رویہ حاصل کریں گے۔

Temperature، max_tokens، اور لاگت کنٹرول

- کوڈ جنریشن یا ریفیکٹرنگ کے لیے،

temperatureکم رکھیں (0.0–0.2) اورmax_tokensتوقع شُدہ آؤٹ پٹ سائز کے مطابق۔ - ایکسپلورٹری پرامپٹس کے لیے،

temperatureبڑھائیں مگر بڑھتے ہوئے ٹوکن استعمال پر نظر رکھیں۔ جب CometAPI کے ذریعے روٹنگ کریں، تو پرووائیڈر پرائسنگ اور فالبیک رولز کا موازنہ کریں — CometAPI اپنے کیٹلاگ میں فی ماڈل انسٹینس ٹوکن پرائسنگ لسٹ کرتا ہے۔

کانٹیکسٹ ونڈو اور طویل دستاویزات

- M2.5 ویرینٹس عموماً طویل کانٹیکسٹ کو سپورٹ کرتے ہیں (کانٹیکسٹ لینتھ کے لیے ماڈل اسپیک دیکھیں)۔ بہت طویل دستاویزات کے لیے، چنکس بنائیں اور خلاصہ کریں — پھر خلاصے اور متعلقہ چنکس فراہم کریں، بجائے اس کے کہ ایک ہی کال میں پوری فائلیں بھیجیں۔

سیفٹی، زہریلا مواد، اور ہیلوسینیشن میں کمی

- گارڈ ریلز استعمال کریں: سسٹم میسجز، بیرونی ویلیڈیٹرز، اور ٹیسٹ سوٹس (مثلاً تیار کردہ کوڈ کے لیے یونٹ ٹیسٹس) خطرہ کم کرتے ہیں۔

- بیرونی حوالہ جات کی توثیق کریں: اگر ماڈل ویب سے حقائق یا کوڈ نقل کرے، تو نتائج پر بھروسہ کرنے یا انہیں شیپ کرنے سے پہلے پروگرام کے ذریعے تصدیق کریں۔

عام غلطیاں اور ان سے بچنے کے طریقے

غلطی: ایک واحد ماڈل آؤٹ پٹ پر حد سے زیادہ بھروسہ

تدارک: ٹیسٹس، اسٹیٹک چیکس چلائیں، اور اہم لاجک کے لیے متعدد آزاد کمپلیشنز کی درخواست کر کے تقابل کریں۔ CometAPI کئی ماڈلز کے درمیان سوئچنگ کی اجازت دیتا ہے، اور آپ کسی بھی وقت OpenAI کے چیٹ فارمیٹ کا استعمال کرتے ہوئے ان کے درمیان سوئچ کر سکتے ہیں۔

غلطی: پروڈکشن کوڈ کے لیے زیادہ temperature استعمال کرنا

تدارک: temperature کم رکھیں؛ اگر آپ کو تخلیقی متبادلات درکار ہیں، تو کم temperature کے ساتھ متعدد ویری ایشنز مانگیں یا ماڈل سے اختلافات کی وضاحت کرنے کو کہیں۔

غلطی: ماڈل ورژننگ کو نظر انداز کرنا

تدارک: اپنے ڈپلائمنٹ منیفیسٹس میں ماڈل نام اور پرووائیڈر سٹرنگز ٹریک کریں۔ جب MiniMax-M2.5 سے MiniMax-M2.5-highspeed یا کسی اور پرووائیڈر پر سوئچ کریں، تو اسے ایک ریلیز تبدیلی کے طور پر لیں اور ریگریشن ٹیسٹس چلائیں۔

حتمی سفارشات اور حقیقت پسندانہ توقعات

MiniMax-M2.5 کوڈ-مرکوز، ایجنٹک LLMs کے لیے ایک قابلِ ذکر پیش رفت ہے — یہ مضبوط کوڈ جنریشن، ملٹی ٹرن استدلال، اور ٹول-سیف رویے کا وعدہ کرتا ہے۔ اگر آپ کی ٹیم کی ترجیحات مضبوط ڈویلپر ٹولز، ایجنٹ فریم ورکس، یا کوڈ اسسٹنٹس بنانا ہیں، تو M2.5 آپ کی کمپیریزن میٹرکس میں جگہ کا مستحق ہے۔ CometAPI کو ایک متحدہ گیٹ وے کے طور پر استعمال کرنے سے تجربات تیز ہو سکتے ہیں اور آپ کو اپنے پورے انٹیگریشن کو دوبارہ بنانے کے بغیر پرووائیڈرز یا A/B ماڈلز کے درمیان سوئچ کرنے کی اجازت ملتی ہے۔

چند عملی نکات:

- CometAPI کے پلیگراؤنڈ سے تیزی سے پروٹو ٹائپ کریں، پھر کوڈ میں ماڈل شناخت کنندگان کو لاک ڈاؤن کریں۔

- کم temperature استعمال کریں، ٹیسٹس اور وضاحتیں مانگیں، اور ہمیشہ خودکار ویلیڈیشن چلائیں۔

- ماڈل کو ایک طاقتور شریک-ڈویلپر سمجھیں — نہ کہ ایک خطا ناپذیر: انسانی ریویو، CI پائپ لائنز، اور ٹیلی میٹری لگائیں۔

ڈویلپرز MInimax-M2.5 کو CometAPI کے ذریعے ابھی ایکسیس کر سکتے ہیں۔ شروع کرنے کے لیے، ماڈل کی صلاحیتیں Playground میں دریافت کریں اور تفصیلی ہدایات کے لیے API guide سے رجوع کریں۔ ایکسیس سے پہلے، براہِ کرم یقینی بنائیں کہ آپ CometAPI میں لاگ اِن ہیں اور API key حاصل کر چکے ہیں۔ CometAPI آپ کی انٹیگریشن میں مدد کے لیے سرکاری قیمت سے کہیں کم قیمت پیش کرتا ہے۔

Ready to Go؟ → آج ہی M2.5 کے لیے سائن اپ کریں !

اگر آپ AI پر مزید ٹپس، رہنما اور خبریں جاننا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!