GPT-5.2 API کیا ہے

GPT-5.2 API، ChatGPT میں GPT-5.2 Thinking کے برابر ہے۔ GPT-5.2 Thinking، OpenAI کے GPT-5.2 فیملی کا ایک درمیانی درجے کا ورژن ہے جو زیادہ گہرے کام کے لیے ڈیزائن کیا گیا ہے: کثیر مرحلہ استدلال، طویل دستاویزات کا خلاصہ، معیاری کوڈ جنریشن، اور وہ پیشہ ورانہ نالج ورک جہاں خام تھروپُٹ کے مقابلے میں درستی اور قابلِ استعمال ساخت زیادہ اہم ہو۔ API میں یہ ماڈل gpt-5.2 (Responses API / Chat Completions) کے طور پر دستیاب ہے، اور کم تاخیر والے Instant ویریئنٹ اور زیادہ معیاری مگر مہنگے Pro ویریئنٹ کے درمیان واقع ہے۔

بنیادی خصوصیات

- بہت طویل کانٹیکسٹ اور کمپیکشن: 400K مؤثر ونڈو اور کمپیکشن ٹولز جو طویل گفتگوؤں اور دستاویزات میں مطابقت کو منظم کرنے میں مدد دیتے ہیں۔

- قابلِ تشکیل استدلالی کوشش:

none | medium | high | xhigh(xhigh مشکل استدلال کے لیے زیادہ سے زیادہ اندرونی compute فعال کرتا ہے)۔xhigh، Thinking/Pro ویریئنٹس میں دستیاب ہے۔ - مزید مضبوط ٹول اور فنکشن سپورٹ: فرسٹ کلاس ٹول کالنگ، گرامرز (CFG/Lark) تاکہ ساختہ آؤٹ پُٹس کو محدود کیا جا سکے، اور بہتر ایجنٹک رویے جو پیچیدہ کثیر مرحلہ آٹومیشن کو سادہ بناتے ہیں۔

- ملٹی موڈل فہم: تصاویر + متن کی زیادہ بھرپور فہم اور اسے کثیر مرحلہ کاموں میں یکجا کرنا۔

- بہتر سیفٹی / حساس مواد کی ہینڈلنگ: مخصوص مداخلتیں تاکہ خود کو نقصان پہنچانے جیسے موضوعات اور دیگر حساس تناظرات میں ناگوار جوابات کم ہوں۔

تکنیکی صلاحیتیں اور مشخصات (ڈویلپر نقطۂ نظر)

- API endpoints اور ماڈل IDs: Thinking کے لیے

gpt-5.2(Responses API)، چیٹ/انسٹنٹ ورک فلو کے لیےgpt-5.2-chat-latestاور Pro ٹیئر کے لیےgpt-5.2-pro؛ جہاں بتایا گیا ہو وہاں Responses API اور Chat Completions کے ذریعے دستیاب۔ - Reasoning tokens اور کوشش کا انتظام: API، ہر ریکویسٹ کے لیے compute (استدلالی کوشش) مختص کرنے کے صریح پیرا میٹرز مہیا کرتا ہے؛ زیادہ کوشش سے تاخیر اور لاگت بڑھتی ہے مگر پیچیدہ کاموں کے لیے آؤٹ پُٹ کا معیار بہتر ہوتا ہے۔

- ساختہ آؤٹ پُٹ ٹولز: گرامرز (Lark / CFG) کی سپورٹ تاکہ ماڈل آؤٹ پُٹ کو کسی DSL یا عین نحو تک محدود کیا جا سکے (SQL، JSON، DSL generation کے لیے مفید)۔

- پیرالل ٹول کالنگ اور ایجنٹک ہم آہنگی: بہتر parallelism اور زیادہ صاف tool orchestration جس سے پیچیدہ سسٹم پرامپٹس اور ملٹی ایجنٹ اسکیفولڈنگ کی ضرورت کم ہوتی ہے۔

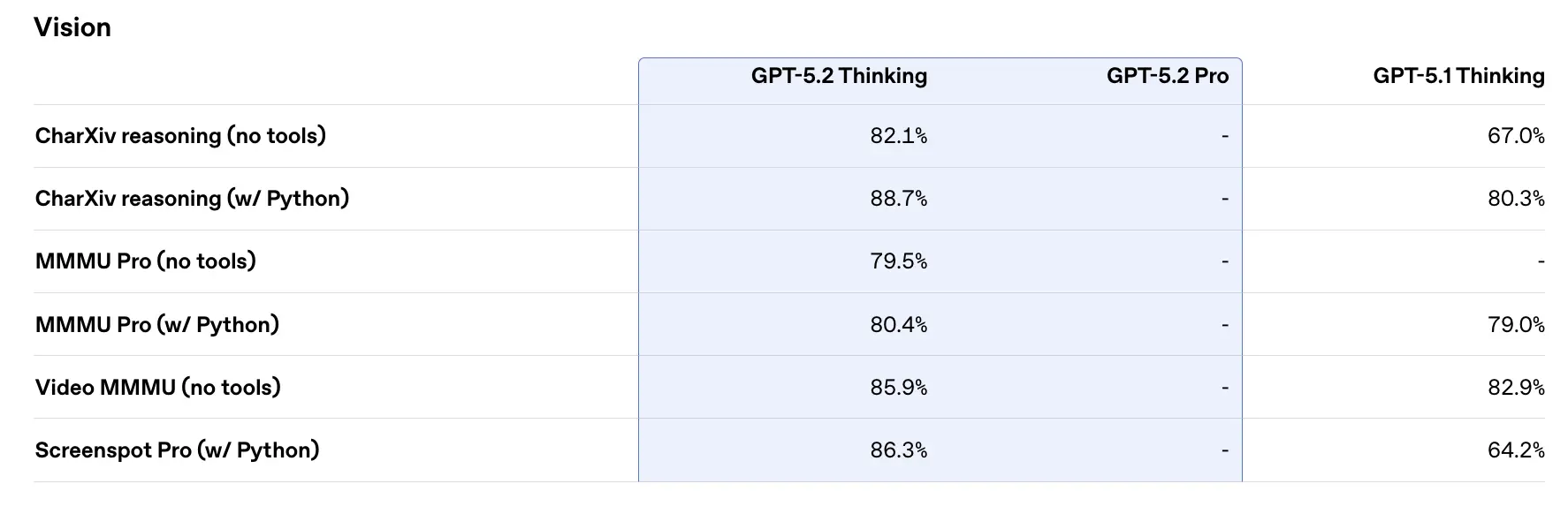

بینچ مارک کارکردگی اور معاون ڈیٹا

OpenAI نے GPT-5.2 کے لیے متعدد داخلی اور خارجی بینچ مارک نتائج شائع کیے ہیں۔ منتخب نمایاں نکات (OpenAI کے رپورٹ کردہ اعداد و شمار):

- GDPval (44 مشاغل، نالج ورک) — GPT-5.2 Thinking “70.9% موازنوں میں اعلیٰ صنعت کار پیشہ وروں کو پیچھے چھوڑتا یا ان کے برابر رہتا ہے”; OpenAI کے مطابق آؤٹ پُٹس >11× رفتار اور ماہر پیشہ وروں کے GDPval ٹاسکس پر <1% لاگت پر تیار ہوئے (رفتار اور لاگت کے تخمینے تاریخی اعداد پر مبنی ہیں)۔ ان ٹاسکس میں اسپریڈشیٹ ماڈلز، پریزنٹیشنز اور مختصر ویڈیوز شامل ہیں۔

- SWE-Bench Pro (coding) — GPT-5.2 Thinking نے SWE-Bench Pro پر ≈55.6% اور SWE-Bench Verified (صرف Python) پر ~80% حاصل کیا، جس سے ان کے ٹیسٹس میں کوڈ جنریشن/انجینئرنگ جانچ کے لیے نیا state of the art قائم ہوا۔ اس کا عملی مطلب زیادہ قابلِ اعتماد ڈیبگنگ اور اینڈ ٹو اینڈ فکسز ہے، جیسا کہ OpenAI کی مثالیں ظاہر کرتی ہیں۔

- GPQA Diamond (graduate-level science Q&A) — GPT-5.2 Pro: 93.2%، GPT-5.2 Thinking: 92.4% GPQA Diamond پر (کوئی ٹولز نہیں، زیادہ سے زیادہ استدلال)۔

- ARC-AGI سیریز — ARC-AGI-2 (زیادہ مشکل سیال استدلال بینچ مارک) پر، GPT-5.2 Thinking نے 52.9% اور GPT-5.2 Pro نے 54.2% اسکور کیا (OpenAI کے مطابق یہ chain-of-thought اسٹائل ماڈلز کے لیے نئے state-of-the-art نشانات ہیں)۔

- لانگ کانٹیکسٹ (OpenAI MRCRv2) — GPT-5.2 Thinking نے 4-needle MRCR ویریئنٹ پر 256k tokens تک قریباً 100% درستی دکھائی اور لانگ کانٹیکسٹ سیٹنگز میں GPT-5.1 کے مقابلے میں نمایاں بہتری دیکھی گئی۔ (OpenAI نے MRCRv2 کے چارٹس اور ٹیبلز شائع کیے ہیں۔)

ہم عصروں کے ساتھ موازنہ

- بمقابلہ Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro کو ~1,048,576 (≈1M) token کانٹیکسٹ ونڈو، وسیع ملٹی موڈل ان پٹس (متن، تصویر، آڈیو، ویڈیو، PDFs) اور Vertex AI / AI Studio کے ذریعے مضبوط ایجنٹک انٹیگریشنز کے ساتھ پیش کیا گیا ہے۔ کاغذی طور پر، Gemini 3 کی بڑی کانٹیکسٹ ونڈو انتہائی بڑے سنگل سیشن ورک لوڈز کے لیے ایک امتیاز ہے؛ توازن میں ٹولنگ سطح اور ایکو سسٹم فِٹ جیسے عوامل شامل ہیں۔

- بمقابلہ Anthropic Claude Opus 4.5: Anthropic کا Opus 4.5 انٹرپرائز کوڈنگ/ایجنٹ ورک فلو پر زور دیتا ہے اور SWE-bench نتائج اور طویل ایجنٹک سیشنز کے لیے مضبوطی رپورٹ کرتا ہے؛ Anthropic، Opus کو آٹومیشن اور کوڈ جنریشن کے لیے 200k کانٹیکسٹ ونڈو اور مخصوص ایجنٹ/Excel انٹیگریشنز کے ساتھ پوزیشن کرتا ہے۔ Opus 4.5 انٹرپرائز آٹومیشن اور کوڈ ٹاسکس میں مضبوط حریف ہے۔

عملی خلاصہ: GPT-5.2 کا ہدف متوازن بہتریاں ہیں (400k کانٹیکسٹ، زیادہ ٹوکن آؤٹ پُٹس، بہتر استدلال/کوڈنگ)۔ Gemini 3 کا ہدف انتہائی بڑے سنگل سیشن کانٹیکسٹس (≈1M) ہیں، جبکہ Claude Opus انٹرپرائز انجینئرنگ اور ایجنٹک مضبوطی پر توجہ دیتا ہے۔ انتخاب کرتے وقت کانٹیکسٹ سائز، ماڈیلیٹی کی ضرورت، فیچر/ٹولنگ فِٹ، اور لاگت/لیٹنسی کے توازن کو مدِنظر رکھیں۔

GPT-5.2 API تک رسائی اور استعمال کا طریقہ

مرحلہ 1: API Key کے لیے سائن اپ کریں

cometapi.com میں لاگ اِن کریں۔ اگر آپ ہمارے صارف نہیں ہیں تو پہلے رجسٹر کریں۔ اپنے CometAPI console میں سائن اِن کریں۔ انٹرفیس کی رسائی اسناد API key حاصل کریں۔ personal center میں API token کے تحت “Add Token” پر کلک کریں، ٹوکن key حاصل کریں: sk-xxxxx اور سبمٹ کریں۔

مرحلہ 2: GPT-5.2 API کو درخواستیں بھیجیں

“gpt-5.2” endpoint منتخب کریں، API ریکویسٹ بھیجیں اور ریکویسٹ باڈی سیٹ کریں۔ ریکویسٹ میتھڈ اور ریکویسٹ باڈی ہماری ویب سائٹ کے API ڈاک سے حاصل کیے جا سکتے ہیں۔ ہماری ویب سائٹ آپ کی سہولت کے لیے Apifox ٹیسٹ بھی فراہم کرتی ہے۔ <YOUR_API_KEY> کو اپنے اکاؤنٹ کے اصل CometAPI key سے تبدیل کریں۔ ڈیویلپرز انہیں Responses API / Chat endpoints کے ذریعے کال کرتے ہیں۔

اپنا سوال یا درخواست content فیلڈ میں داخل کریں—یہی وہ چیز ہے جس کا ماڈل جواب دے گا۔ API ریسپانس کو پروسیس کریں تاکہ تیار کردہ جواب حاصل ہو سکے۔

مرحلہ 3: نتائج حاصل کریں اور توثیق کریں

API ریسپانس کو پروسیس کریں تاکہ تیار کردہ جواب حاصل ہو۔ پروسیسنگ کے بعد، API ٹاسک اسٹیٹس اور آؤٹ پُٹ ڈیٹا کے ساتھ جواب دیتی ہے۔

مزید دیکھیں Gemini 3 Pro Preview API