GLM-4.6 Z.ai (سابقہ Zhipu AI) کے GLM خاندان کا تازہ ترین بڑا ریلیز ہے: چوتھی نسل کا بڑا لسانی MoE (Mixture-of-Experts) ماڈل جو ایجنٹ پر مبنی ورک فلو، طویل سیاق میں استدلال، اور حقیقی دنیا کی کوڈنگ کے لیے ٹیون کیا گیا ہے۔ یہ ریلیز عملی ایجنٹ/ٹول انٹیگریشن، بہت بڑی کانٹیکسٹ ونڈو، اور مقامی ڈیپلائمنٹ کے لیے اوپن ویٹس دستیابی پر زور دیتی ہے۔

اہم خصوصیات

- طویل سیاق — مقامی 200K ٹوکن کانٹیکسٹ ونڈو (128K سے توسیع شدہ)۔ (docs.z.ai)

- کوڈنگ اور ایجنٹک صلاحیت — حقیقی دنیا کی کوڈنگ ٹاسکس پر مارکیٹنگ کے مطابق بہتریاں اور ایجنٹس کے لیے بہتر ٹول کالنگ۔

- کفایت — Z.ai کے ٹیسٹس میں GLM-4.5 کے مقابلے ~30% کم ٹوکن استعمال رپورٹ ہوا۔

- ڈیپلائمنٹ اور کوانٹائزیشن — Cambricon چِپس کے لیے FP8 اور Int4 انٹیگریشن کا اولین اعلان؛ vLLM کے ذریعے Moore Threads پر مقامی FP8 سپورٹ۔

- ماڈل سائز اور ٹینسر قسم — شائع شدہ آرٹیفیکٹس ظاہر کرتے ہیں کہ Hugging Face پر ~357B-parameter ماڈل (BF16 / F32 ٹینسرز) موجود ہے۔

تکنیکی تفصیلات

طرز اور فارمیٹس۔ GLM-4.6 ایک صرف متن والا LLM ہے (ان پٹ اور آؤٹ پٹ موڈیلٹیز: متن)۔ کانٹیکسٹ لمبائی = 200K ٹوکن؛ زیادہ سے زیادہ آؤٹ پٹ = 128K ٹوکن۔

کوانٹائزیشن اور ہارڈویئر سپورٹ۔ ٹیم رپورٹ کرتی ہے کہ Cambricon چپس پر FP8/Int4 کوانٹائزیشن اور vLLM استعمال کرتے ہوئے Moore Threads GPUs پر مقامی FP8 انفرنس چل سکتا ہے — جو انفرنس لاگت کم کرنے اور آن-پریم و ملکی کلاؤڈ ڈیپلائمنٹس ممکن بنانے کے لیے اہم ہے۔

ٹوولنگ اور انٹیگریشنز۔ GLM-4.6 Z.ai کی API، تھرڈ پارٹی پرووائیڈر نیٹ ورکس (مثلاً، CometAPI) کے ذریعے تقسیم کیا جاتا ہے، اور کوڈنگ ایجنٹس (Claude Code، Cline، Roo Code، Kilo Code) میں ضم ہے۔

تکنیکی تفصیلات

طرز اور فارمیٹس۔ GLM-4.6 ایک صرف متن والا LLM ہے (ان پٹ اور آؤٹ پٹ موڈیلٹیز: متن)۔ کانٹیکسٹ لمبائی = 200K ٹوکن؛ زیادہ سے زیادہ آؤٹ پٹ = 128K ٹوکن۔

کوانٹائزیشن اور ہارڈویئر سپورٹ۔ ٹیم رپورٹ کرتی ہے کہ Cambricon چپس پر FP8/Int4 کوانٹائزیشن اور vLLM استعمال کرتے ہوئے Moore Threads GPUs پر مقامی FP8 انفرنس چل سکتا ہے — جو انفرنس لاگت کم کرنے اور آن-پریم و ملکی کلاؤڈ ڈیپلائمنٹس ممکن بنانے کے لیے اہم ہے۔

ٹوولنگ اور انٹیگریشنز۔ GLM-4.6 Z.ai کی API، تھرڈ پارٹی پرووائیڈر نیٹ ورکس (مثلاً، CometAPI) کے ذریعے تقسیم کیا جاتا ہے، اور کوڈنگ ایجنٹس (Claude Code، Cline، Roo Code، Kilo Code) میں ضم ہے۔

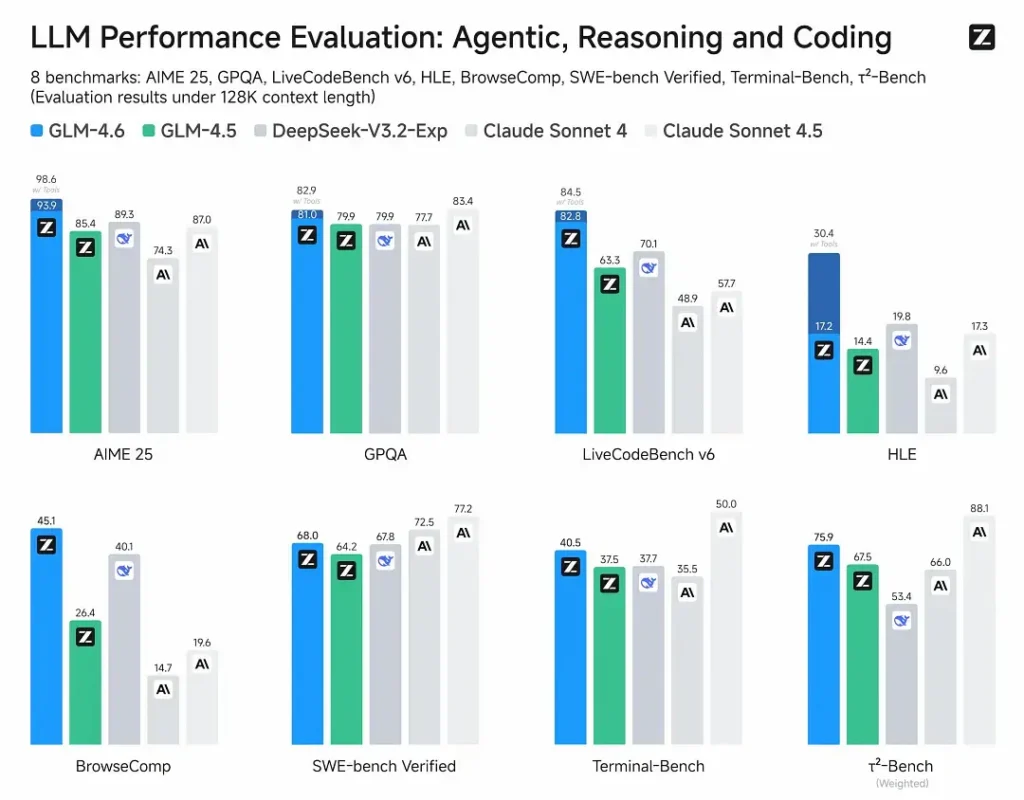

بینچ مارک کارکردگی

- شائع شدہ تشخیصات: GLM-4.6 کو ایجنٹس، استدلال اور کوڈنگ کو کور کرنے والے آٹھ عوامی بینچ مارکس پر جانچا گیا اور GLM-4.5 پر واضح بہتریاں دکھائیں۔ انسانی جانچ شدہ، حقیقی دنیا کی کوڈنگ ٹیسٹس (extended CC-Bench) میں، GLM-4.6 نے GLM-4.5 کے مقابلے ~15% کم ٹوکن استعمال کیے اور Anthropic کے Claude Sonnet 4 کے مقابلے ~48.6% جیت کی شرح حاصل کی (کئی لیڈر بورڈز پر قریب برابری)۔

- پوزیشننگ: نتائج کے مطابق GLM-4.6 ملکی اور بین الاقوامی سرِفہرست ماڈلز کے ساتھ مسابقتی ہے (مثالوں میں DeepSeek-V3.1 اور Claude Sonnet 4 شامل ہیں)۔

حدود و خطرات

- خیالی جوابات اور غلطیاں: دیگر موجودہ LLMs کی طرح، GLM-4.6 حقیقتی غلطیاں کر سکتا ہے — Z.ai کی دستاویزات واضح طور پر خبردار کرتی ہیں کہ آؤٹ پٹس میں غلطیاں ہو سکتی ہیں۔ صارفین کو اہم مواد کے لیے توثیق اور retrieval/RAG اپنانا چاہیے۔

- ماڈل پیچیدگی اور سرو کرنے کی لاگت: 200K کانٹیکسٹ اور بہت بڑے آؤٹ پٹس میموری اور لیٹنسی مطالبات کو نمایاں طور پر بڑھاتے ہیں اور انفرنس لاگت میں اضافہ کر سکتے ہیں؛ بڑے پیمانے پر چلانے کے لیے کوانٹائزیشن/انفرنس انجینیئرنگ درکار ہے۔

- ڈومین میں خلا: اگرچہ GLM-4.6 مضبوط ایجنٹ/کوڈنگ کارکردگی رپورٹ کرتا ہے، کچھ عوامی رپورٹس میں بتایا گیا کہ مخصوص مائیکرو بینچ مارکس میں یہ ابھی بھی کچھ ورژنز کے پیچھے ہے (مثلاً، بعض کوڈنگ میٹرکس میں Sonnet 4.5 کے مقابلے)۔ پروڈکشن ماڈلز کی جگہ لینے سے پہلے فی ٹاسک جانچ کریں۔

- سلامتی اور پالیسی: اوپن ویٹس رسائی بڑھاتے ہیں مگر اس سے نگہداشت کے سوالات بھی اٹھتے ہیں (کم کرنے کے اقدامات، گارڈ ریلز، اور ریڈ ٹیمنگ کی ذمہ داری صارف پر رہتی ہے)۔

استعمال کے کیسز

- ایجنٹک سسٹمز اور ٹول آرکیسٹریشن: طویل ایجنٹ ٹریسز، متعدد ٹول پلاننگ، ڈائنیمک ٹول کالنگ؛ ماڈل کی ایجنٹک ٹیوننگ ایک اہم سیلنگ پوائنٹ ہے۔

- حقیقی دنیا کے کوڈنگ اسسٹنٹس: ملٹی ٹرن کوڈ جنریشن، کوڈ ریویو اور انٹرایکٹو IDE اسسٹنٹس (Z.ai کے مطابق Claude Code، Cline، Roo Code میں ضم)۔ ٹوکن کفایت میں بہتریاں اسے ہیوی یوز ڈیولپر پلانز کے لیے پرکشش بناتی ہیں۔

- طویل دستاویزات کے ورک فلو: خلاصہ سازی، کثیر دستاویزاتی ترکیب، طویل قانونی/تکنیکی ریویوز — 200K ونڈو کی بدولت۔

- مواد تخلیق اور ورچوئل کردار: توسیعی مکالمات، ملٹی ٹرن منظرناموں میں مستقل پرسنہ برقرار رکھنا۔

GLM-4.6 دیگر ماڈلز سے کیسے موازنہ کرتا ہے

- GLM-4.5 → GLM-4.6: کانٹیکسٹ سائز (128K → 200K) اور ٹوکن کفایت (~15% کم ٹوکن CC-Bench پر) میں واضح قدمی تبدیلی؛ ایجنٹ/ٹول استعمال میں بہتری۔

- GLM-4.6 بمقابلہ Claude Sonnet 4 / Sonnet 4.5: Z.ai کے مطابق کئی لیڈر بورڈز پر تقریباً برابری اور CC-Bench حقیقی دنیا کی کوڈنگ ٹاسکس میں ~48.6% جیت کی شرح (یعنی قریب مسابقت، کچھ مائیکرو بینچ مارکس میں Sonnet اب بھی آگے ہے)۔ بہت سی انجینیئرنگ ٹیموں کے لیے، GLM-4.6 کو کم خرچ متبادل کے طور پر پیش کیا جاتا ہے۔

- GLM-4.6 بمقابلہ دیگر طویل کانٹیکسٹ ماڈلز (DeepSeek، Gemini ویریئنٹس، GPT-4 خاندان): GLM-4.6 بڑے کانٹیکسٹ اور ایجنٹک کوڈنگ ورک فلو پر زور دیتا ہے؛ نسبتاً مضبوطیاں میٹرک پر منحصر ہیں (ٹوکن کفایت/ایجنٹ انٹیگریشن بمقابلہ خام کوڈ سنتھیسز درستگی یا سیفٹی پائپ لائنز)۔ انتخاب تجرباتی اور ٹاسک پر مبنی ہونا چاہیے۔

Zhipu AI کا تازہ ترین فلیگ شپ ماڈل GLM-4.6 جاری: 355B کُل پیرا میٹرز، 32B فعال۔ بنیادی صلاحیتوں میں GLM-4.5 سے سبقت۔

- کوڈنگ: Claude Sonnet 4 کے ہم پلہ، چین میں بہترین۔

- کانٹیکسٹ: 200K تک توسیع (128K سے)۔

- استدلال: بہتر، انفرنس کے دوران ٹول کالنگ کی سپورٹ۔

- تلاش: ٹول کالنگ اور ایجنٹ کارکردگی میں اضافہ۔

- تحریر: انداز، قابلِ مطالعہ ہونے، اور رول پلے میں انسانی ترجیحات سے بہتر ہم آہنگی۔

- کثیر لسانی: کراس لینگویج ترجمے میں اضافہ۔