CometAPI کو n8n کے ساتھ مربوط کرنے سے آپ صرف تین مراحل میں دنیا کے جدید ترین AI ماڈلز کے ساتھ اپنی آٹومیشنز کو طاقت دے سکتے ہیں۔ ایک ہی OpenAI-مطابق کریڈنشل استعمال کرکے، آپ کو 500 سے زائد ماڈلز تک فوری رسائی ملتی ہے، جن میں GPT 5.5، Claude Opus 4.7، اور DeepSeek V4 Pro شامل ہیں۔ یہ سیٹ اپ n8n کی کلاؤڈ اور سیلف-ہوسٹڈ دونوں انسٹینسز کے لیے یکساں ہے، جو آپ کے n8n AI ورک فلو آٹومیشن کے لیے ایک مستحکم، اعلی دستیابی کی بنیاد فراہم کرتا ہے۔

n8n کیا ہے اور یہ کیوں اہم ہے

n8n ایک اوپن سورس ورک فلو آٹومیشن ٹول ہے۔ یہ آپ کو مختلف ایپس، سروسز اور APIs کو جوڑ کر کم سے کم کوڈ لکھتے ہوئے کاموں کو خودکار بنانے دیتا ہے۔

یہ کیا کرتا ہے

n8n کو ویژول انداز میں آٹومیشن بنانے کا طریقہ سمجھیں:

- آپ ڈریگ اینڈ ڈراپ ایڈیٹر کے ذریعے ورک فلو بناتے ہیں

- ہر مرحلہ (جسے نوڈ کہا جاتا ہے) ایک ایکشن انجام دیتا ہے

- ڈیٹا خود بخود ایک مرحلے سے اگلے مرحلے تک بہتا ہے

اہم خصوصیات

- اوپن سورس (آپ اسے خود ہوسٹ کر سکتے ہیں)

- سینکڑوں انٹیگریشنز کی سپورٹ (APIs، ایپس، ڈیٹابیس)

- ورک فلو کے اندر کسٹم JavaScript لاجک کی اجازت

- آپ اپنے سرور پر چلا سکتے ہیں یا کلاؤڈ سروس کے ذریعے n8n کی آفیشل سائٹ سے استعمال کر سکتے ہیں

n8n کو CometAPI سے کیوں جوڑیں

n8n میں اپنے مرکزی گیٹ وے کے طور پر CometAPI استعمال کرنا اہم عملی فوائد فراہم کرتا ہے۔ OpenAI، Anthropic، اور Google کی الگ چابیاں ایک واحد کریڈنشل سے بدل کر، آپ کی ٹیم متعدد وینڈر اکاؤنٹس اور پیچیدہ بلنگ سائیکلز کے انتظامی بوجھ کو ختم کر سکتی ہے۔ یہ آرکیٹیکچر وینڈر لاک اِن سے محفوظ رکھتا ہے؛ آپ صرف نوڈ سیٹنگز میں ماڈل نام اپڈیٹ کرکے مختلف فراہم کنندگان کے تازہ ترین ماڈلز کے درمیان سوئچ کر سکتے ہیں، جس سے AI لینڈسکیپ کے بدلتے منظرنامے کے ساتھ آپ کے ورک فلو چست رہتے ہیں۔

CometAPI ایک متحد REST API ہے جو 500+ ماڈلز کو چیٹ، امیج، ویڈیو، آڈیو (TTS/STT)، اور ایمبیڈنگز کے لیے اکٹھا کرتا ہے۔ اہم فوائد میں شامل ہیں:

- OpenAI-مطابق اینڈ پوائنٹ (

https://api.cometapi.com/v1): OpenAI نوڈز یا HTTP Request کے ساتھ ڈراپ اِن مطابقت۔ - براہ راست وینڈرز کے مقابلے 20-40% کم قیمتیں، پے-ایز-یو-گو، بنیادی کے لیے کوئی ماہانہ فیس نہیں، اور متحد بلنگ۔

- ونڈر لاک اِن نہیں: صرف ایک پیرامیٹر کی تبدیلی سے ماڈلز کے درمیان سوئچ کریں۔

- انٹرپرائز فیچرز: فیل اوور راؤٹنگ، اینالیٹکس، پرائیویسی کنٹرولز (کچھ مباحثوں میں پرامپٹس جمع نہ کرنے کا دعویٰ)، اور قابل اعتماد رسائی۔

تازہ ترین پیش رفت (مئی 2026 تک): CometAPI n8n.io پر ایک تصدیق شدہ/پارٹنر انٹیگریشن برقرار رکھتا ہے، اور لوکل/سیلف-ہوسٹڈ انسٹینسز کے لیے npm کے ذریعے دستیاب ایک مخصوص کمیونٹی نوڈ (n8n-nodes-cometapi) موجود ہے۔ صارفین OpenAI نوڈ مطابقت میں ہموار تجربہ اور ملٹی ماڈل ورک فلو کے لیے بڑھتی اپنائیت رپورٹ کرتے ہیں۔ n8n کی حالیہ اپڈیٹس نے ٹول-کالنگ اور HTTP نوڈز کو بہتر بنایا ہے، جس سے انٹیگریشنز مزید مضبوط ہو گئی ہیں۔

شروعات: پیشگی ضروریات اور اکاؤنٹ سیٹ اپ

CometAPI کے لیے سائن اپ کریں

cometapi.com پر جائیں، ایک مفت اکاؤنٹ بنائیں، اور ڈیش بورڈ میں API کی جنریٹ کریں۔ نئے صارفین کو اکثر ٹرائل کریڈٹس ملتے ہیں۔ ماڈل فہرست اور پرائسنگ پیج دیکھیں۔

n8n سیٹ اپ کریں

- کلاؤڈ: n8n.cloud (منیجد، آسان اسکیلنگ)۔

- سیلف-ہوسٹڈ: Docker، npm، یا Kubernetes۔ ڈیٹا پرائیویسی اور لامحدود ایگزیکیوشنز کے لیے تجویز کردہ۔ حالیہ گائیڈز CometAPI نوڈز کو لوکل طور پر چلانے کا احاطہ کرتی ہیں۔

تازہ ترین ورژن (مثلاً، مئی 2026 تک 2.20+) پر اپڈیٹ کریں تاکہ AI اور استحکام میں بہتریاں حاصل ہوں۔

CometAPI نوڈ انسٹال کریں (اختیاری مگر سیلف-ہوسٹڈ کے لیے تجویز کردہ)

کمیونٹی نوڈ استعمال کریں:

npm install n8n-nodes-cometapi

n8n ری اسٹارٹ کریں۔ یہ نوڈز پینل میں نیٹو جیسے تجربے کے لیے ظاہر ہوگا۔

مرحلہ وار سیٹ اپ گائیڈ

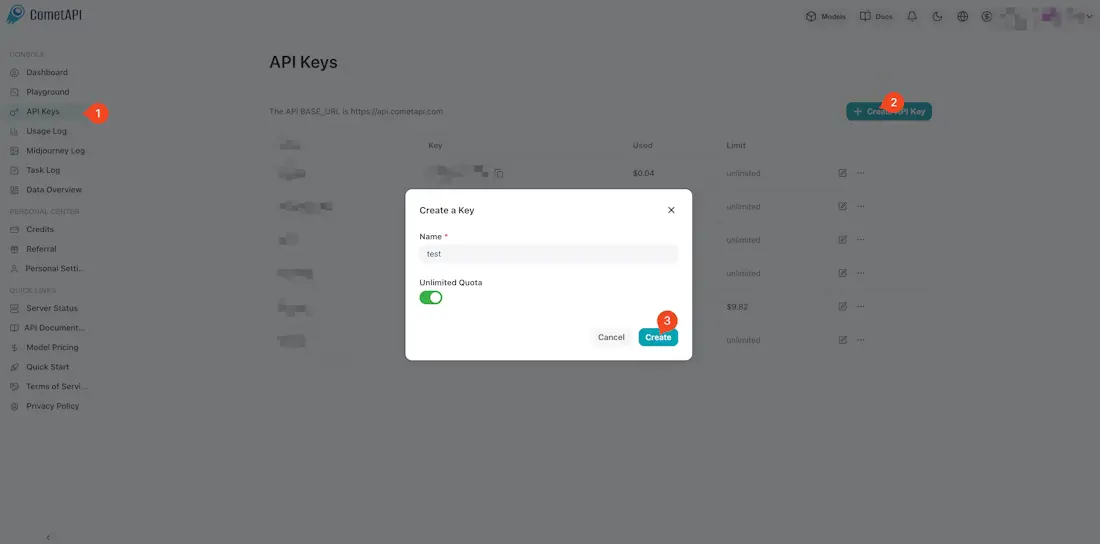

مرحلہ 1: اپنا CometAPI API Key حاصل کریں

CometAPI ڈیش بورڈ میں لاگ اِن کریں اور API Token سیکشن میں جائیں۔ Add API Key پر کلک کریں تاکہ آپ کا منفرد کریڈنشل جنریٹ ہو۔

اپنی کلید کاپی کریں (عمومی طور پر sk-xxxx کی شکل میں) اور بیس URL محفوظ رکھیں: https://api.cometapi.com/v1.

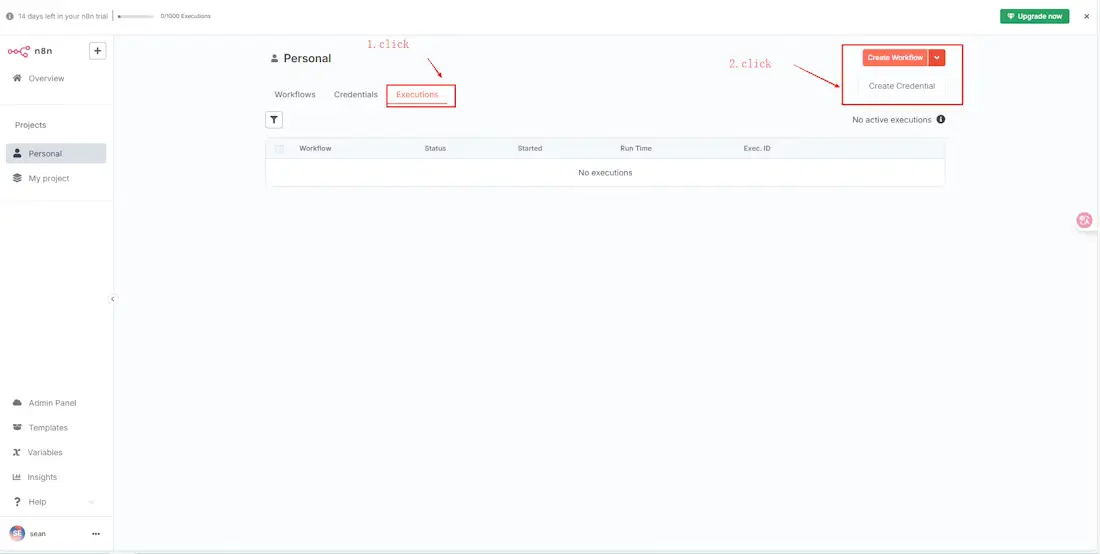

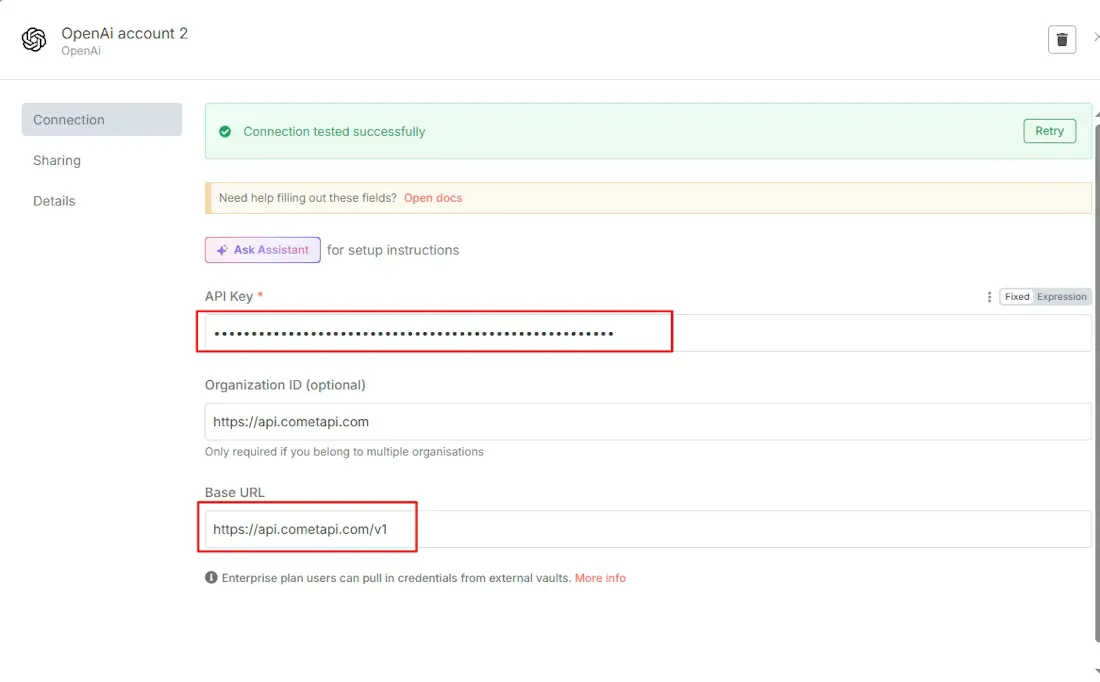

مرحلہ 2: n8n میں OpenAI Credential بنائیں

اپنی n8n انسٹینس کھولیں اور Credentials → Create Credential پر جائیں۔ تلاش کریں اور OpenAI API کریڈنشل ٹائپ منتخب کریں۔

- API Key: یہاں اپنا CometAPI ٹوکن پیسٹ کریں۔

- Base URL: درج کریں

https://api.cometapi.com/v1.

سیٹ اپ مکمل کرنے کے لیے Save پر کلک کریں۔

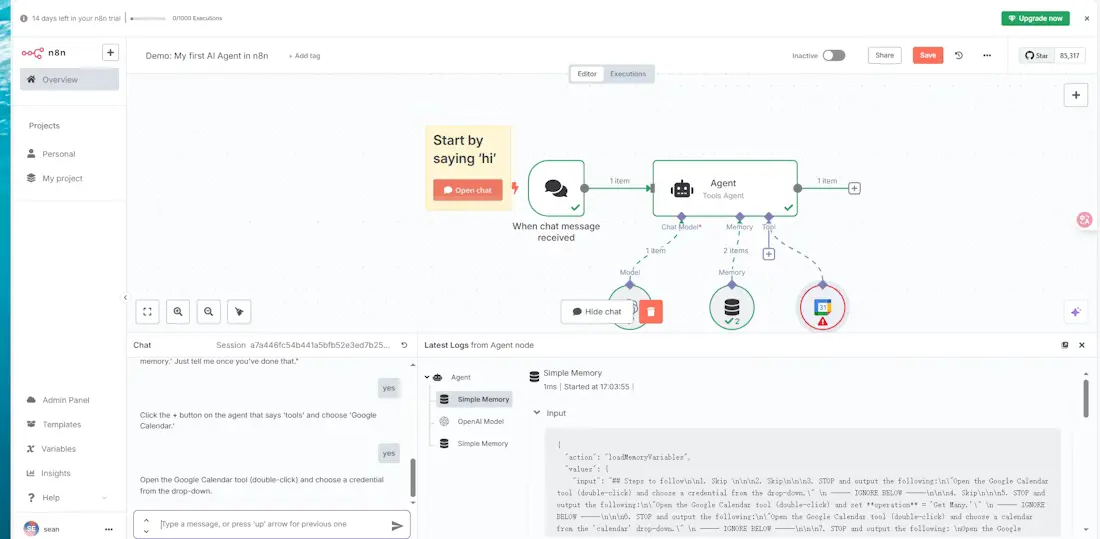

مرحلہ 3: اپنا کنکشن ٹیسٹ کریں

ایک نیا ورک فلو بنائیں اور ایک OpenAI نوڈ (جیسے Chat Model یا AI Agent نوڈ) شامل کریں۔ وہی CometAPI کریڈنشل منتخب کریں جو آپ نے ابھی بنایا ہے۔ ماڈل فیلڈ میں اب آپ کوئی بھی سپورٹڈ ماڈل ID داخل کر سکتے ہیں، جیسے gpt-5.5 یا claude-opus-4-7۔ نوڈ کو ایگزیکیوٹ کریں؛ کامیاب ریسپانس اس بات کی تصدیق کرتا ہے کہ آپ کا n8n OpenAI-Compatible API برج درست طور پر کنفیگر ہو چکا ہے۔

عام مسائل کی خرابیوں کا ازالہ

اگر آپ کی انٹیگریشن فوراً کام نہیں کرتی، تو ان تین عام علاقوں کی جانچ کریں:

API 401 Unauthorized ایرر واپس کرتی ہے

یہ ایرر عموماً اس بات کی علامت ہے کہ n8n گیٹ وے کے ساتھ تصدیق نہیں کر پا رہا۔ پہلے، یقین کر لیں کہ آپ نے اپنی API کی درست طور پر کاپی کی ہے اور اس کے آگے پیچھے کوئی اسپیس نہیں۔ دوسرے، یقینی بنائیں کہ آپ کے Base URL میں /v1 سفکس شامل ہے۔ ورژن پاتھ کے بغیر اینڈ پوائنٹ ریکوئسٹ مسترد کر سکتا ہے۔

ماڈل نام شناخت نہیں ہوا

CometAPI 500+ ماڈلز کی میزبانی کرتا ہے، اور ہر ایک کا ایک مخصوص شناخت کنندہ ہوتا ہے۔ اگر n8n "Model not found" ایرر لوٹاتا ہے، تو یقینی بنائیں کہ آپ CometAPI ڈاکیومنٹیشن سے عین ماڈل ID استعمال کر رہے ہیں۔ مثال کے طور پر، اگر موجودہ کیٹلاگ میں یہی شناخت ہو تو gpt-5.5-pro استعمال کریں نہ کہ صرف gpt-5-pro۔

ریسپانس کی رفتار سست ہے

ریئل ٹائم ایپلی کیشنز میں جہاں لیٹنسی اہم ہو، کچھ reasoning-heavy ماڈلز پروسیس کرنے میں زیادہ وقت لے سکتے ہیں۔ اگر آپ کے ورک فلو کو تقریباً فوری جوابات درکار ہیں، تو Gemini 3.1 Flash-Lite یا DeepSeek V4 Flash جیسے ہائی تھروپٹ ماڈلز آزمائیں، جو رفتار کے لیے آپٹیمائزڈ ہیں۔

n8n میں CometAPI کے ذریعے آپ کون سے ماڈلز استعمال کر سکتے ہیں

| ماڈل کیٹیگری | مثالیں | بہترین استعمال |

|---|---|---|

| ٹیکسٹ/چیٹ | GPT 5.5، Claude Opus 4.7، Gemini 3.1 Pro | پیشہ ورانہ استدلال اور پیچیدہ منطق |

| کوڈ | DeepSeek V4 Pro، GPT 5.3 Codex | ایجینٹک کوڈنگ اور ریپوزٹری پیمانے کی ریفیکٹرنگ |

| امیج | GPT Image 2، Flux 2 Max | اعلی معیار بصری مواد اور ڈیزائن |

| ویڈیو | Sora 2، Doubao-Seedance 2.0 | سینیما معیار آٹومیشن اور ویڈیو سوشل کلپس |

تیار شدہ n8n ورک فلو ٹیمپلیٹس

n8n میں CometAPI نافذ کرنے سے پیچیدہ ملٹی ماڈل لاجک ممکن ہوتی ہے۔ یہ تین ٹیمپلیٹس آج ہی بنائیں۔

سانچہ 1: کسٹمر سپورٹ آٹومیشن

- ٹرگر: ایک Webhook نوڈ آپ کی ویب سائٹ سے موصولہ کسٹمر سپورٹ ٹکٹ حاصل کرتا ہے۔

- پروسیسنگ: ایک CometAPI (OpenAI) نوڈ Claude Opus 4.7 استعمال کرتے ہوئے ٹکٹ کے متن کا تجزیہ کرتا ہے۔

- لاجک: ایک Switch نوڈ AI کے آؤٹ پٹ میں "شدت" یا "پیچیدگی" کا اندازہ کرتا ہے۔

- برانچنگ: سادہ استفسارات (مثلاً "میرا آرڈر کہاں ہے؟") کو ایک خودکار جواب نوڈ کی طرف بھیجا جاتا ہے۔ پیچیدہ تکنیکی مسائل کو انسانی مداخلت کے لیے Slack نوڈ یا Zendesk نوڈ کی طرف روٹ کیا جاتا ہے۔

- نوڈ کنفیگریشن: سیٹ کریں

thinking: {type: "adaptive"}تاکہ مشکل سینٹیمنٹ اینالیسس پر زیادہ وقت صرف ہو۔

سانچہ 2: خودکار مواد پائپ لائن

- ٹرگر: ایک RSS Feed نوڈ آپ کے شعبے میں نئی آرٹیکل کا پتہ لگاتا ہے۔

- پروسیسنگ 1: GPT 5.5 آرٹیکل پڑھ کر آپ کے اندرونی نیوز لیٹر کے لیے 200 الفاظ کا ایگزیکٹو خلاصہ بناتا ہے۔

- پروسیسنگ 2: اس خلاصے کو DeepSeek V3 کو پاس کریں تاکہ پانچ SEO-آپٹیمائزڈ ٹیگز اور کی ورڈز تیار کرے۔

- آؤٹ پٹ: خلاصہ اور ٹیگز ایک Notion ڈیٹابیس یا WordPress نوڈ پر پوسٹ کیے جاتے ہیں۔

- یہ امتزاج کیوں؟: اعلی معیار خلاصے کے لیے GPT 5.5 اور سادہ ٹیگنگ کے لیے کم لاگت DeepSeek V3 استعمال کرکے، آپ معیار برقرار رکھتے ہوئے مجموعی ٹوکن لاگت نمایاں طور پر کم کرتے ہیں۔

سانچہ 3: امیج جنریشن ورک فلو

- ٹرگر: ایک Google Sheets نوڈ نئی قطار کا پتہ لگاتا ہے جس میں پروڈکٹ کا نام اور وضاحت ہو۔

- پروسیسنگ: وضاحت کو CometAPI (OpenAI) نوڈ میں Flux 2 Max ماڈل کے ساتھ

/v1/images/generationsاینڈ پوائنٹ کے ذریعے بھیجا جاتا ہے۔ - اسٹوریج: بنے ہوئے امیج کا URL ایک Google Drive نوڈ کو پاس کیا جاتا ہے تاکہ فائل اپ لوڈ اور محفوظ کی جا سکے۔

- نوڈ کنفیگریشن:

nپیرامیٹر کو 1 پر سیٹ کریں اور1024x1024جیسا ریزولوشن منتخب کریں تاکہ اعلی معیار پروڈکٹ ماک اپس بنیں۔

n8n + CometAPI کے لیے لاگت کی آپٹیمائزیشن تجاویز

اپنی 20-40% بچت کو زیادہ سے زیادہ کرنے کے لیے یہ آرکیٹیکچرل حکمت عملیاں اپنائیں۔

کلاسفیکیشن اور راؤٹنگ کے لیے سستے ماڈلز استعمال کریں

سادہ "ہاں/نہیں" یا "کیٹیگری A/B" فیصلوں کے لیے GPT 5.5 Pro استعمال نہ کریں۔ DeepSeek V4 Flash یا GPT 5.4 nano استعمال کریں۔ یہ ماڈلز فلیگ شپ ماڈلز کے مقابلے بہت کم قیمت کے ہوتے ہیں اور عموماً تیز بھی، یعنی آپ کا n8n ورک فلو زیادہ مؤثر انداز میں ایگزیکیوٹ ہوتا ہے۔

n8n میں مشروط ماڈل انتخاب سیٹ کریں

Switch نوڈ یا If نوڈ استعمال کریں تاکہ ان پٹ لمبائی یا ترجیح کی بنیاد پر ماڈل منتخب ہو۔ مثال کے طور پر، اگر دستاویز 1,000 الفاظ سے کم ہے تو اسے ایک اسٹینڈرڈ ماڈل پر روٹ کریں۔ اگر یہ ایک بڑا 500,000-ٹوکن ریپوزٹری ہے، تو اسے لانگ-کانٹیکسٹ ماڈل جیسے Grok 4.20 یا Claude Opus 4.7 پر روٹ کریں۔

بیچنگ بمقابلہ ریئل ٹائم پروسیسنگ

اگر آپ کے n8n ورک فلو کو فوری جوابات درکار نہیں (مثلاً دن کے اختتام کی رپورٹ)، تو Wait نوڈ یا Schedule نوڈ استعمال کریں تاکہ ان پٹس جمع کرکے انہیں ایک ہی بیچ میں پروسیس کریں۔ CometAPI ہائی کنکرنسی سپورٹ کرتا ہے، لیکن چھوٹی، الگ الگ کالز کی فریکوئنسی کم کرنا آپ کو لوئر-ٹیئر ریٹ لمٹس کے اندر رکھنے اور یوزج لاگز کو سادہ بنانے میں مدد دیتا ہے۔

موازناتی جدول: n8n + CometAPI بمقابلہ متبادلات

| فیچر | n8n + CometAPI | Zapier + Multiple AIs | Make.com + Direct APIs | کسٹم کوڈ (Python/Node) |

|---|---|---|---|---|

| لاگت | کم (20-40% بچت + n8n مفت/سیلف-ہوسٹڈ) | زیادہ (فی ٹاسک + فی API) | درمیانی | متغیر (ڈویلپمنٹ وقت) |

| استعمال میں آسانی | بصری، لو-کوڈ | بہت آسان | بصری | زیادہ کوڈنگ درکار |

| لچک | غیر محدود (HTTP + 400+ نوڈز) | محدود ٹیمپلیٹس | اچھی | سب سے زیادہ |

| ماڈل رسائی | 500+ متحد | بکھرا ہوا | منحصر | دستی |

| سیلف-ہوسٹنگ/ڈیٹا پرائیویسی | بہترین | محدود | کلاؤڈ-فوکسڈ | مکمل کنٹرول |

| اسکیل ایبلٹی | اعلی (کیو موڈز، ورکرز) | یوزج پر مبنی قیمت حدیں | اچھی | انفرا پر منحصر |

| مینٹیننس | کم (ایک انٹیگریشن) | زیادہ (متعدد کنکشنز) | درمیانی | زیادہ |

| AI ایجنٹ سپورٹ | نیٹو + ٹولز | بنیادی | بڑھ رہی ہے | کسٹم |

فیصلہ: n8n + CometAPI ان ٹیموں کے لیے بہترین ہے جنہیں طاقت، کنٹرول، اور لاگت میں کفایت درکار ہے۔

مستقبل کا منظرنامہ اور آپٹیمائزیشن تجاویز

چونکہ 2026 میں AI ماڈلز تیزی سے بڑھ رہے ہیں، CometAPI جیسے متحد پلیٹ فارمز جب n8n جیسے لچکدار آرکسٹریٹرز کے ساتھ جوڑے جائیں تو ناگزیر بن جاتے ہیں۔ مزید گہرے نیٹو نوڈز، بہتر MCP/سرور انٹیگریشنز، اور ایڈوانسڈ ایجنٹ صلاحیتوں کی توقع رکھیں۔

Cometapi.com پر آپٹیمائزیشن:

- ROI تجزیے کے لیے ورک فلو میں ٹوکن یوزج کو ٹریک کریں۔

- CometAPI کے اینالیٹکس + n8n ایگزیکیوشنز ڈیٹا سے فائدہ اٹھائیں۔

- کم لاگت پر مخصوص کاموں کے لیے نئے ماڈلز (مثلاً DeepSeek-V4) کے ساتھ تجربہ کریں۔

- اختتامی سے اختتامی AI حل کے لیے دیگر CometAPI ٹولز کے ساتھ ملا کر استعمال کریں۔

فوری رہنما: آج ایک سادہ سممرائزر ورک فلو بنائیں۔ کل مکمل AI آپریشنز تک اسکیل کریں۔

شروع کرنے کے لیے تیار ہیں؟ اپنے مفت API کی اور کریڈٹس کے لیے CometAPI پر جائیں۔ سیلف-ہوسٹ یا کلاؤڈ n8n، اوپر دیے گئے مراحل کے ذریعے کنیکٹ کریں، اور اپنی آٹومیشنز کو بدل دیں۔ کسٹم ورک فلو یا انٹرپرائز مشاورت کے لیے، Cometapi.com پر آپشنز دیکھیں۔

یہ انٹیگریشن صرف تکنیکی نہیں—یہ AI کے دور میں پیداواریت اور اختراع کے لیے ایک اسٹریٹجک ملٹی پلائر ہے۔

عمومی سوالات

س: کیا مجھے ہر AI ماڈل کے لیے الگ کریڈنشل درکار ہے؟

ج: نہیں۔ ایک CometAPI کریڈنشل n8n میں 500+ ماڈلز تک رسائی دیتا ہے، GPT اور Claude سے لے کر DeepSeek اور Kimi تک۔

س: کیا n8n میں براہ راست OpenAI استعمال کرنے کے مقابلے CometAPI سستا ہے؟

ج: ہاں۔ CometAPI کی قیمتیں انہی ماڈلز کے آفیشل ریٹیل ریٹس سے 20% تا 40% کم مقرر کی گئی ہیں۔

س: کیا یہ سیلف-ہوسٹڈ n8n کے ساتھ کام کرتا ہے؟

ج: ہاں۔ سیٹ اپ کا عمل n8n کلاؤڈ اور سیلف-ہوسٹڈ Docker ورژنز دونوں کے لیے یکساں ہے۔

س: کون سے n8n نوڈز CometAPI کے ساتھ کام کرتے ہیں؟

ج: کوئی بھی نوڈ جو OpenAI کریڈنشل قبول کرتا ہے، بشمول AI Agent، Chat Model، اور اسٹینڈرڈ کمپلیشن نوڈز۔

س: کیا میں n8n کو دوبارہ کنفیگر کیے بغیر ماڈلز تبدیل کر سکتا/سکتی ہوں؟

ج: ہاں۔ صرف نوڈ سیٹنگز میں ماڈل نیم اسٹرنگ اپڈیٹ کریں (مثال کے طور پر، gpt-5.5 کو claude-opus-4-7 سے تبدیل کریں)؛ بنیادی کریڈنشل تمام پرووائیڈرز کے لیے درست رہتا ہے۔