Gemini Embedding 2 Google کا پہلا فطری طور پر ملٹی موڈل ایمبیڈنگ ماڈل ہے جو متن، تصاویر، آڈیو، ویڈیو اور PDFs کو ایک واحد 3,072-بعدی معنوی ویکٹر اسپیس میں میپ کرتا ہے (قابلِ تشکیل آؤٹ پٹ سائز کے ساتھ)۔ یہ Matryoshka Representation Learning متعارف کراتا ہے تاکہ نیسٹیڈ/ٹرنکیٹڈ ایمبیڈنگز فراہم کی جا سکیں، کثیر لسانی کارکردگی بہتر ہو (100+ زبانیں)، اور ٹاسک مخصوص ایمبیڈنگز کے لیے بہتر کنٹرولز فراہم ہوں (مثلاً task:search, task:code)۔

Gemini Embedding 2 کیا ہے؟

Gemini Embedding 2 Google کا ایک یکجا ایمبیڈنگ ماڈل ہے جو ایک سے زیادہ ان پٹ موڈیلٹیز — متن، تصاویر، آڈیو، ویڈیو اور دستاویزات — کو ایک ہی معنوی ویکٹر اسپیس میں میپ کرتا ہے۔ ہر ایمبیڈنگ (ڈیفالٹ کے طور پر) 3,072-بعدی فلوٹنگ پوائنٹ ویکٹر ہوتی ہے جو ان پٹ کے معنوی مفہوم کی نمائندگی کرتی ہے، تاکہ معنوی طور پر ملتی جلتی اشیا (موڈیلٹی سے قطع نظر) ویکٹر اسپیس میں ایک دوسرے کے قریب ہوں۔ نمایاں صلاحیتیں یہ ہیں:

- وسیع زبان اور فارمیٹ کوریج: ایک ہی ماڈل جو متن، تصاویر، آڈیو، ویڈیو اور دستاویزات کو قبول کرتا ہے اور انہیں ایک معنوی ویکٹر اسپیس میں رکھتا ہے۔ Gemini Embedding 2 کو 100+ زبانوں میں معنوی ارادے کو گرفت میں لینے اور عام فائل فارمیٹس (PNGs/JPEGs، MP4/MOV، MP3/WAV، PDF) قبول کرنے کے طور پر دستاویزی بنایا گیا ہے، ہر درخواست کے لیے واضح حدود کے ساتھ (مثلاً فی درخواست چند تصاویر یا آڈیو/ویڈیو کے چند درجن سیکنڈ — ذیل میں “How to use” دیکھیں)۔

- حقیقی ملٹی موڈلٹی: ایک ہی ماڈل جو متن، تصاویر، آڈیو، ویڈیو اور دستاویزات کو قبول کرتا ہے اور انہیں ایک معنوی ویکٹر اسپیس میں رکھتا ہے تاکہ آپ موڈیلٹیز کے درمیان موازنہ یا بازیافت کر سکیں (مثلاً متن → تصویر، آڈیو → متن)۔

- بڑا ڈیفالٹ ڈائمنشن اور لچکدار ٹرنکیشن: ماڈل ڈیفالٹ کے طور پر 3072-بعدی ویکٹرز آؤٹ پٹ کرتا ہے، لیکن Matryoshka Representation Learning (MRL) اہم ترین معنوی مواد کو ابتدائی ابعاد میں مرتکز کرتا ہے، لہٰذا آپ 1536، 768 (یا اس سے کم) تک ٹرنکیٹ کر سکتے ہیں اور بازیافت کے معیار میں صرف معمولی کمی آتی ہے۔ اس سے اسٹوریج اور کمپیوٹ لاگت کے توازن میں مدد ملتی ہے۔

یہ کیوں اہم ہے۔ ماضی میں ایمبیڈنگز زیادہ تر صرف متن تک محدود تھیں یا ہر موڈیلٹی کے لیے الگ انکوڈرز درکار ہوتے تھے جن کے ساتھ پیچیدہ کراس-موڈل الائنمنٹ لیئرز لازم تھیں۔ Gemini Embedding 2 اس رکاوٹ کو دور کرتا ہے کیونکہ یہ بنیادی طور پر متعدد فارمیٹس کو سپورٹ کرتا ہے — اس طرح ایک متن کوئری صرف معنوی مماثلت کی بنیاد پر کسی تصویر یا چھوٹے کلپ کو بازیافت کر سکتی ہے، بغیر درمیان میں ٹرانسکرپشن یا دستی میپنگ کے۔ اس سے RAG (retrieval-augmented generation)، معنوی سرچ، اور ملٹی موڈل ریٹریول پائپ لائنز سادہ ہو جاتی ہیں۔

کلیدی خصوصیات اور صلاحیتیں (نیا کیا ہے)

1. حقیقی، فطری ملٹی موڈلٹی (ایک ایمبیڈنگ اسپیس)

ایک ہی ماڈل جو متن، تصاویر، آڈیو، ویڈیو اور دستاویزات کو قبول کرتا ہے اور انہیں ایک معنوی ویکٹر اسپیس میں رکھتا ہے۔ Gemini Embedding 2 متن، تصاویر، آڈیو، ویڈیو اور دستاویزات کو ایک ہی ایمبیڈنگ اسپیس میں میپ کرتا ہے، لہٰذا کراس-موڈل ریٹریول (متن→تصویر، آڈیو→متن) براہِ راست ممکن ہے، بغیر کراس-ماڈل الائنمنٹ کے۔ اس سے پائپ لائن پیچیدگی کم ہوتی ہے اور RAG (Retrieval-Augmented Generation) اسٹیکس سادہ ہوتے ہیں۔

2. 3,072-بعدی ڈیفالٹ ویکٹرز، قابلِ ایڈجسٹ آؤٹ پٹ کے ساتھ

Gemini Embedding 2 ڈیفالٹ کے طور پر 3072-بعدی ویکٹرز آؤٹ پٹ کرتا ہے، لیکن Matryoshka Representation Learning (MRL) اہم ترین معنوی مواد کو ابتدائی ابعاد میں مرتکز کرتا ہے، لہٰذا آپ 1536، 768 (یا اس سے کم) تک ٹرنکیٹ کر سکتے ہیں اور بازیافت کے معیار میں صرف معمولی کمی آتی ہے۔ اس سے اسٹوریج اور کمپیوٹ لاگت کے توازن میں مدد ملتی ہے۔

3. Matryoshka Representation Learning (MRL)

MRL "نیسٹیڈ" ایمبیڈنگز پیدا کرتا ہے — روسی گڑیوں کی مانند — تاکہ کم ابعادی حصے بھی اعلیٰ سطحی معنویات کو برقرار رکھیں۔ اس سے سسٹمز کو ایک مناسب آپریٹنگ پوائنٹ (اسٹوریج/درستگی کا توازن) منتخب کرنے کی سہولت ملتی ہے، بغیر متعدد علیحدہ ایمبیڈنگ ماڈلز سنبھالے۔

4. ٹاسک ہنٹس / حسبِ ضرورت ایمبیڈنگ آبجیکٹو

API task ہنٹس قبول کرتا ہے (مثلاً task:search, task:code retrieval, task:semantic-similarity) تاکہ ماڈل مخصوص ڈاؤن اسٹریم تعلقات کے لیے ایمبیڈنگ جیومیٹری کو بہتر بنا سکے — یہ پہلے کے ایمبیڈنگ سسٹمز میں استعمال ہونے والے ٹاسک کنڈیشننگ سے ملتا جلتا ہے مگر اب ملٹی موڈل ان پٹس تک توسیع دی گئی ہے۔

5. زبان اور موڈیلٹی کی وسعت

Gemini Embedding 2 کو 100+ زبانوں میں معنوی ارادے کو گرفت میں لینے اور عام فائل فارمیٹس (PNGs/JPEGs، MP4/MOV، MP3/WAV، PDF) قبول کرنے کے طور پر دستاویزی بنایا گیا ہے، ہر درخواست کے لیے واضح حدود کے ساتھ (مثلاً فی درخواست چند تصاویر یا آڈیو/ویڈیو کے چند درجن سیکنڈ — ذیل میں “How to use” دیکھیں)۔

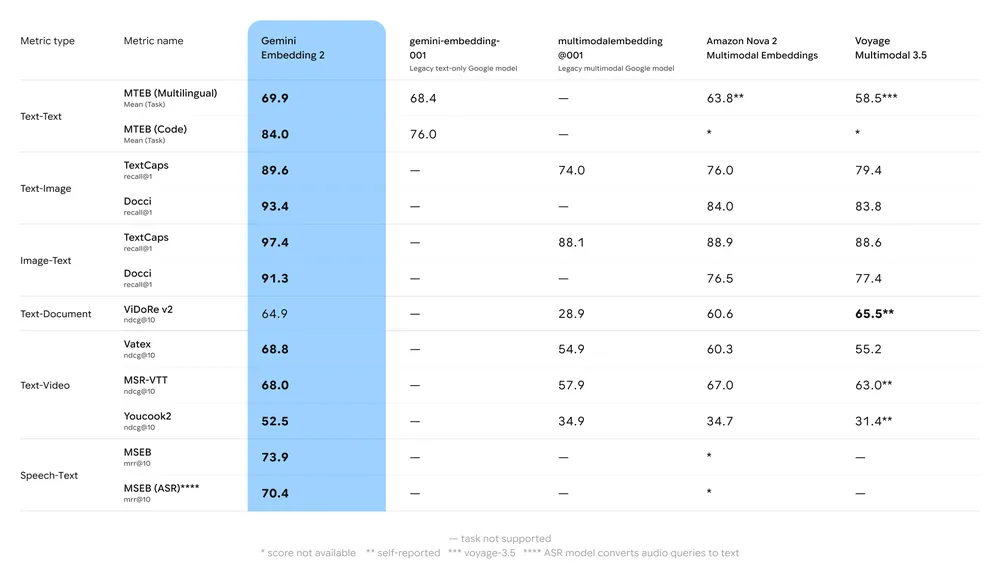

کارکردگی بینچ مارکس

اہم بینچ مارک خلاصہ:

- MTEB (Massive Text Embedding Benchmark): انگریزی اور کثیر لسانی ٹاسکس کے لیے ملٹی لنگول MTEB لیڈربورڈز پر مضبوط پوزیشن؛ تجزیات Gemini کے پچھلے ایمبیڈنگ ماڈلز اور متعدد پروپرائٹری متبادلوں کے مقابلے میں معنی خیز بہتری دکھاتے ہیں۔

- ملٹی موڈل ریٹریول: کراس-موڈل مماثلت (مثلاً متن→تصویر ریٹریول) میں استعمال کے وقت معروف سنگل-موڈل ایمبیڈنگز کے مساوی یا ان سے بہتر، فطری ملٹی موڈل ٹریننگ کے باعث۔

- لیٹنسی اور تھروپٹ: کلاؤڈ ہوسٹڈ ایمبیڈنگ جنریشن؛ تاہم لیٹنسی حساس استعمال کی صورتوں میں ٹرنکیٹڈ ویکٹرز یا متبادل ہلکے وزن کے ایمبیڈنگ ماڈلز آن-ایج ضروریات کے لیے ترجیح دیے جا سکتے ہیں۔

Gemini Embedding 2 بمقابلہ gemini-embedding-001 اور text-embedding-3-large

| Attribute | Gemini Embedding 2 (embedding-2) | Gemini Embedding (gemini-embedding-001) | OpenAI text-embedding-3-large |

|---|---|---|---|

| Release / availability | Mar 10, 2026 — public preview (Gemini API / Vertex AI). | Earlier Gemini embedding (text-only variants) — GA earlier. | Announced Jan 2024 (text-only GA). |

| Modalities supported | Text, images, audio, video, documents (PDF) — unified vector space. | Text (primarily). | Text only (high-quality multilingual). |

| Default embedding dim. | 3072 (MRL / truncation recommended: 1536, 768). | 3072 (for large) — text only. | 3072 (text-embedding-3-large). |

| Reported MTEB (example) | High-60s on MTEB; shows 68.17 at 1536 in vendor table (see docs). | gemini-embedding-001 reported ~68.32 mean in some leaderboards. | ~64.6 (MTEB average reported by OpenAI for text-embedding-3-large). |

| Native audio/video support | Yes (direct audio/video embedding). | No (text only). | No (text only). |

| Typical use cases | Multimodal retrieval, RAG, semantic search across file types, speech retrieval, video search. | Text retrieval, multilingual RAG. | Text retrieval, semantic search, RAG — strong multilingual text performance. |

تکنیکی تفصیلات اور حدود

ڈیفالٹ اور قابلِ ایڈجسٹ ایمبیڈنگ سائز

- Default: 3,072 ابعاد۔

- Adjustable:

output_dimensionalityپیرا میٹر کے ذریعے کم ابعاد کی آؤٹ پٹ مانگی جا سکتی ہے تاکہ اسٹوریج/CPU بچایا جا سکے۔ بڑے ویکٹر اسٹورز والے استعمالات عموماً لاگت کی خاطر ابعاد 512–1,024 تک کم کرتے ہیں، کچھ درستگی کی قربانی کے ساتھ۔

معاونت یافتہ موڈیلٹیز اور فی درخواست حدود

- Images: PNG, JPEG — فی درخواست زیادہ سے زیادہ 6 تصاویر (وینڈر-رپورٹڈ حدود)۔

- Video: MP4, MOV — ایک درخواست میں ایک ویڈیو کے لیے تقریباً 128 سیکنڈ تک (وینڈر رپورٹ)۔

- Audio: MP3, WAV — فی آڈیو ان پٹ تقریباً 80 سیکنڈ تک (وینڈر رپورٹ)۔

- Documents: PDFs — فی درخواست 6 صفحات تک (وینڈر رپورٹنگ)۔

- Token limit for textual content: ماڈل بڑے ٹوکن ان پٹس سپورٹ کرتا ہے؛ عملی فی درخواست ٹوکن کیپ موجود ہیں (API ڈاکس اور Vertex AI کوٹاز دیکھیں)۔

دستیابی اور رسائی

- Public preview: Gemini Embedding 2 بطور پبلک پری ویو جاری کیا گیا ہے اور Gemini API اور Google Cloud کے Vertex AI کے ذریعے فوری تجرباتی استعمال کے لیے دستیاب ہے

عمومی سوالات (FAQ)

Q1: Gemini Embedding 2 کن موڈیلٹیز کو سپورٹ کرتا ہے؟

A: متن، تصاویر (PNG/JPEG)، ویڈیو (MP4/MOV)، آڈیو (MP3/WAV) اور PDF دستاویزات — سب ایک ہی معنوی ویکٹر اسپیس میں میپ کیے جاتے ہیں۔

Q2: Gemini Embedding 2 کے لیے ڈیفالٹ ویکٹر سائز کیا ہے؟

A: ڈیفالٹ 3,072 ابعاد ہے۔ آپ API کے ذریعے کم آؤٹ پٹ ڈائمنشنلٹی مانگ سکتے ہیں۔

Q3: کیا Gemini Embedding 2 اس وقت دستیاب ہے؟

A: ہاں — اسے بطور پبلک پری ویو اعلان کیا گیا تھا اور یہ Gemini API اور Vertex AI کے ذریعے دستیاب ہے (ماڈل آئی ڈی gemini-embedding-2-preview اور موجودہ چینج لاگ چیک کریں)۔

Q4: یہ دیگر فراہم کنندگان کی ایمبیڈنگز سے کیسے موازنہ رکھتا ہے؟

A: آزاد وینڈر ٹیسٹس رپورٹ کرتے ہیں کہ Gemini Embedding 2 کثیر لسانی متن کے لیے ٹاپ پروپرائٹری ماڈلز میں شمار ہوتا ہے اور متعدد ملٹی موڈل ٹاسکس کے لیے اسٹیٹ آف دی آرتھ کارکردگی دکھاتا ہے۔ درست رینکنگز ٹاسک اور ڈیٹاسیٹ کے مطابق بدلتی ہیں؛ اپنے ڈیٹا پر ٹیسٹ کریں۔

Q5: کیا مجھے آڈیو استعمال کرنے کے لیے پہلے ٹرانسکرائب کرنا ہوگا؟

A: نہیں — Gemini Embedding 2 براہِ راست آڈیو قبول کر سکتا ہے اور بغیر متن میں ٹرانسکرائب کیے ایمبیڈنگز پیدا کرتا ہے، جس سے اینڈ ٹو اینڈ آڈیو معنوی ریٹریول ممکن ہوتا ہے۔

Q6: 3,072-بعدی ویکٹرز کے لیے اسٹوریج لاگت کیسے کم کروں؟

A: آپشنز میں کم output_dimensionality مانگنا، float16/کوانٹائزیشن/PQ کا استعمال، اور اپنے ویکٹر ڈی بی میں کمپریسڈ نمائندگیاں محفوظ کرنا شامل ہیں۔ وینڈر پوسٹس ورک فلو اور بہترین طریقوں کی رہنمائی فراہم کرتی ہیں۔

آگے کیا — کیا مجھے ابھی اسے اپنانا چاہیے؟

Gemini Embedding 2 ملٹی موڈل ریٹریول کو یکجا کرنے میں بڑا قدم ہے اور ان آرکیٹیکچرز کو سادہ بناتا ہے جنہیں پہلے متن، وژن اور اسپیچ کے لیے علیحدہ ریٹریورز درکار ہوتے تھے۔ اپنانے کے فیصلے کے اہم نکات:

- جلدی اپنائیں اگر آپ کی پراڈکٹ کو مضبوط کراس-موڈل ریٹریول (متن↔تصویر/ویڈیو/آڈیو) درکار ہے، یا متعدد سنگل-موڈیلٹی ریٹریورز کو سنبھالنا مہنگا اور پیچیدہ ہے۔

- ابھی پائلٹ کریں اگر آپ MRL ٹرنکیشن کا جائزہ لے کر لاگت بمقابلہ معیار ناپنا چاہتے ہیں (ہائبرڈ ڈپلائمنٹ رکھیں: 1536 بطور پرائمری، 3072 ریرینکنگ کے لیے)۔

- انتظار کریں اگر آپ کا ورک لوڈ انتہائی لاگت حساس ہے اور صرف متن ریٹریول درکار ہے — ٹاپ ٹیکسٹ-اونلی ماڈلز (مثلاً OpenAI text-embedding-3-large) مقابلے میں مضبوط رہتے ہیں اور بعض اوقات آپ کے پائپ لائن/کنٹریکٹ کے مطابق سستے پڑ سکتے ہیں۔

Developers اب Gemini Embedding 2 اور OpenAI text-embedding-3 API کو CometAPI کے ذریعے حاصل کر سکتے ہیں۔ آغاز کے لیے، Playground میں ماڈل کی صلاحیتیں ایکسپلور کریں اور تفصیلی ہدایات کے لیے API guide دیکھیں۔ رسائی سے قبل، براہِ کرم CometAPI میں لاگ ان کریں اور API key حاصل کریں۔ CometAPI انٹیگریشن میں مدد کے لیے سرکاری قیمت کے مقابلے میں کہیں کم قیمت پیش کرتا ہے۔

تیار ہیں شروع کرنے کے لیے؟ → آج ہی cometapi کے لیے سائن اپ کریں!

اگر آپ AI پر مزید ٹِپس، گائیڈز اور خبریں جاننا چاہتے ہیں تو ہمیں VK، X اور Discord پر فالو کریں!