Grok 3 và o3 đại diện cho ranh giới mới nhất trong mô hình hóa ngôn ngữ lớn từ hai trong số các phòng thí nghiệm AI được theo dõi chặt chẽ nhất hiện nay. Khi xAI và OpenAI cạnh tranh để giành quyền thống trị trong lý luận, đa phương thức và tác động trong thế giới thực, việc hiểu được sự khác biệt giữa Grok 3 và o3 là rất quan trọng đối với các nhà phát triển, nhà nghiên cứu và doanh nghiệp đang cân nhắc áp dụng. So sánh chuyên sâu này khám phá nguồn gốc, cải tiến về kiến trúc, hiệu suất chuẩn, ứng dụng thực tế và đề xuất giá trị của chúng, giúp bạn xác định mô hình nào phù hợp nhất với mục tiêu của mình.

Nguồn gốc và mốc thời gian phát hành của Grok 3 và o3 là gì?

Hiểu được nguồn gốc và tầm nhìn đằng sau Grok 3 và o3 sẽ giúp chúng ta đánh giá được vị trí của từng mô hình trong bối cảnh AI.

Grok 3 là gì

Chuỗi Grok của xAI bắt đầu như một chatbot không có sự bảo vệ, không có quy tắc trên X (trước đây là Twitter). Grok 2.0 đã giới thiệu tích hợp FLUX.1, nhưng Grok 3 đánh dấu một bước ngoặt: nó được tiếp thị rõ ràng là "Thời đại của các tác nhân lý luận" cung cấp chuyên môn sâu về lĩnh vực tài chính, mã hóa và trích xuất văn bản pháp lý. Tầm nhìn của Elon Musk nhấn mạnh vào cuộc tranh luận cởi mở và ít ràng buộc về nội dung hơn, cho phép Grok 3 tạo ra những hiểu biết gây tranh cãi hoặc chưa được lọc khi cần. Chế độ "Big Brain" khai thác các lần tính toán bổ sung, mô phỏng sự cân nhắc của con người và một công cụ DeepSearch mới sẽ tìm kiếm dữ liệu web và X theo thời gian thực để tìm ngữ cảnh chi tiết.

Chuỗi Grok của xAI được hình thành để vượt ra ngoài các tác nhân đàm thoại vào lĩnh vực lý luận tự chủ. Grok 3, được công bố ở dạng beta vào ngày 19 tháng 2025 năm 3, được quảng cáo là "mô hình tiên tiến nhất của chúng tôi cho đến nay", kết hợp các mô-đun lý luận vượt trội với kiến thức được đào tạo trước sâu rộng để hỗ trợ các cuộc đối thoại và nhiệm vụ sâu hơn, nhận thức được ngữ cảnh. Elon Musk nhấn mạnh rằng Grok 4 "vượt qua tất cả các đối thủ AI hiện tại", bao gồm GPT-XNUMXo, Gemini và Claude của Anthropic, coi đó là một thách thức trực tiếp đối với các dịch vụ của OpenAI.

o3 là gì

Dòng o của OpenAI bắt nguồn từ những thử nghiệm ban đầu trong việc nối các bước suy luận trước khi tạo ra phản hồi. Vào ngày 16 tháng 2025 năm 3, OpenAI chính thức phát hành o4 cùng với o3-mini, nhấn mạnh khả năng "suy nghĩ lâu hơn trước khi phản hồi" và khả năng kích hoạt các công cụ và API bên ngoài - những khả năng quan trọng đối với quy trình làm việc phức tạp, đa phương thức. Sam Altman ca ngợi oXNUMX là minh chứng cho "trí thông minh cấp độ thiên tài", thể hiện sự tự tin vào khả năng của mô hình trong việc giải quyết các nhiệm vụ theo truyền thống dành riêng cho các nhà điều hành con người chuyên gia.

Dòng O của OpenAI phát triển từ lần giới thiệu chuỗi suy nghĩ riêng tư của O1 vào cuối năm 2024. Kiến trúc của O3 vẫn giữ nguyên nền tảng của máy biến áp nhưng lên lịch các bước suy luận để "suy nghĩ" nội bộ trước khi đưa ra câu trả lời. Các vòng truy cập sớm trong khoảng thời gian từ tháng 2024 năm 2025 đến tháng 3 năm 1 đã thu thập phản hồi từ các nhà nghiên cứu bảo mật, tinh chỉnh các thông số để cân bằng độ trễ với độ chính xác của lý luận. O3-mini, nhắm mục tiêu vào các ứng dụng nhạy cảm với chi phí, duy trì các mục tiêu độ trễ tương tự như OXNUMX-mini trong khi tăng cường khả năng STEM. Bản thân OXNUMX, dành riêng cho người dùng Pro và doanh nghiệp, tăng thời gian suy luận cho các tác vụ phức tạp, thể hiện tinh thần phát triển gia tăng nhưng có ý thức về an toàn của OpenAI.

Kiến trúc mô hình và chiến lược đào tạo của họ khác nhau như thế nào?

Mặc dù cả hai mô hình đều được xây dựng trên nền tảng máy biến áp, nhưng chúng lại khác nhau về quy mô, cơ chế lý luận và tích hợp đa phương thức.

Kiến trúc cốt lõi

- Grok 3: Giữ lại xương sống máy biến áp quy mô lớn được tăng cường với các lớp lý luận riêng được thiết kế để sắp xếp các bước suy luận một cách rõ ràng. Kiến trúc này nhằm mục đích phản ánh chuỗi suy nghĩ giống con người nhưng ở quy mô máy móc.

- o3: Triển khai mô hình lý luận “đại lý” trong đó mô hình phân bổ động nỗ lực tính toán qua nhiều lần xử lý—thấp, trung bình hoặc cao—để tối ưu hóa sự cân bằng giữa độ trễ phản hồi và độ sâu của phân tích.

Dữ liệu đào tạo và quy mô

- Grok 3:Theo xAI, Grok 3 đã được đào tạo trên khoảng 200,000 GPU trong nhiều tuần, bao gồm hỗn hợp văn bản quy mô web, kho lưu trữ mã và các tập dữ liệu đa phương tiện được quản lý để cho phép hiểu cả về mặt ngôn ngữ và hình ảnh.

- o3: Được xây dựng trên kho dữ liệu web và bộ dữ liệu được cấp phép rộng lớn của OpenAI, chương trình đào tạo của o3 cũng kết hợp học tăng cường từ phản hồi của con người (RLHF) được điều chỉnh cụ thể cho các tác vụ lý luận cấp cao. Mặc dù OpenAI không tiết lộ số lượng GPU, nhưng các ghi chú phát hành nhấn mạnh đến khả năng mở rộng hiệu quả để hỗ trợ một tầng API cho cả nhà nghiên cứu và khách hàng doanh nghiệp.

khả năng đa phương thức

- Grok 3:Bản phát hành beta hé lộ chức năng tạo hình ảnh và tìm kiếm chuyên sâu, cho thấy xAI đang hướng tới một mô hình thống nhất có khả năng hiểu và tạo nội dung trực quan bên cạnh văn bản.

- o3: Hỗ trợ tích hợp công cụ đầy đủ, cho phép thực hiện các lệnh gọi theo chuỗi gốc đến hình ảnh, thực thi mã và API cơ sở kiến thức của OpenAI, do đó cung cấp phương pháp tiếp cận theo mô-đun cho đa phương thức thay vì mô hình đơn khối, tất cả trong một.

Mô hình tỷ lệ, phân bổ tính toán và suy luận

Tuyên bố của Grok 3 về "tính toán nhiều hơn 10 lần" so với Grok 2 tận dụng việc học tăng cường quy mô lớn để cho phép sửa lỗi lặp đi lặp lại trong vài giây hoặc vài phút, với kết quả được tổng hợp thông qua sự đồng thuận@64 để tăng cường độ chính xác. Cách tiếp cận này phản ánh các phương pháp tổng hợp: 64 câu trả lời ứng viên được tạo ra và chọn câu trả lời thường xuyên nhất. Ngược lại, O3 tích hợp chuỗi suy nghĩ như một bước lập kế hoạch nội bộ, tránh lấy mẫu bên ngoài nhưng tăng tính toán nội bộ cho mỗi mã thông báo. Độ sâu suy luận của O3 được điều chỉnh động: các truy vấn đơn giản hơn sử dụng ít bước "suy nghĩ" hơn, trong khi các lời nhắc phức tạp kích hoạt các cuộc cân nhắc nội bộ dài hơn.

Mẫu nào có hiệu suất chuẩn vượt trội hơn?

Tiêu chuẩn học thuật và mã hóa

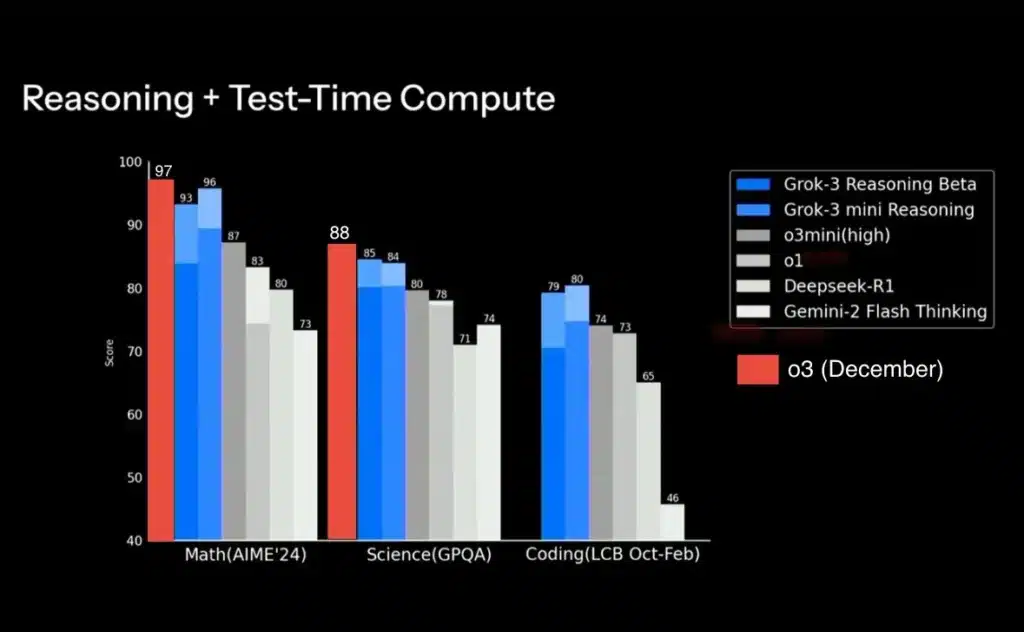

Trong bài kiểm tra lý luận toán học AIME 2025, phương pháp “consensus@3” của Grok 64 đạt độ chính xác 89.2%, nhỉnh hơn một chút so với 3% của O87.3-mini-high trong cùng kỳ thi. Trong các thử thách mã hóa, O3 ghi nhận Elo Codeforces là 2727, vượt qua cả Grok 3 (ước tính Elo ~2500) và O3-mini (Elo ~2300).

Sở thích của người dùng trong thế giới thực và thử nghiệm đối kháng

xAI báo cáo một Chatbot Arena Elo là 1402 cho Grok 3—đã được thử nghiệm với các đối thủ là con người và AI—vượt trội hơn điểm số 2 của Grok 1203 là x.ai. Đánh giá nội bộ của OpenAI cho thấy O3 đạt tỷ lệ hài lòng của người dùng là 91% trong các nghiên cứu so sánh với O1, với mức tăng đáng kể về số liệu "độ sâu giải thích" của OpenAI. Tuy nhiên, các cuộc kiểm toán độc lập đã đặt câu hỏi về phương pháp chuẩn của xAI khi thể hiện quá mức các lợi ích lấy mẫu đồng thuận của Grok 3 mà không có các biến thể tương đương cho O3, nhấn mạnh sự cần thiết của các giao thức đánh giá chuẩn hóa.

Những mô hình này có ứng dụng thực tế tuyệt vời như thế nào?

Ngoài các tiêu chuẩn, các nhiệm vụ thực tế sẽ làm sáng tỏ cách mỗi mô hình có thể thúc đẩy giá trị trong nhiều ngành.

Quy trình sáng tạo và nghiên cứu

- Grok 3: Những người đánh giá ban đầu khen ngợi tính năng "tìm kiếm sâu" của nó, tính năng này hiển thị các tài liệu tham khảo học thuật chuyên sâu và tạo ra các phác thảo chi tiết cho nội dung nặng về tư duy như các bài báo kỹ thuật và lời nhắc viết sáng tạo. Việc tạo hình ảnh tích hợp cho phép các chu kỳ ý tưởng liền mạch kết hợp văn bản và hình ảnh.

- o3:Các nhà phát triển tận dụng khả năng suy luận đa luồng của nó để tạo nguyên mẫu các mô-đun phần mềm phức tạp, gỡ lỗi đoạn mã và tạo hình ảnh dữ liệu thông qua các lệnh gọi nối tiếp—hợp lý hóa quy trình nghiên cứu đầu cuối mà không cần rời khỏi môi trường API.

Nhiệm vụ khoa học và phòng thí nghiệm

- Grok 3:Mặc dù phiên bản beta của xAI chưa được thử nghiệm rộng rãi trong bối cảnh phòng thí nghiệm, nhưng cốt lõi lý luận nâng cao của nó hứa hẹn khả năng tạo ra giả thuyết và đánh giá tài liệu, có khả năng giảm thời gian các nhà khoa học dành cho việc khai thác dữ liệu sơ bộ.

- o3: Được chứng minh trong việc khắc phục sự cố virus học có kiểm soát, o3 có thể hỗ trợ thiết kế giao thức, phân tích lỗi và giải thích dữ liệu, hoạt động hiệu quả như một trợ lý phòng thí nghiệm ảo. Tuy nhiên, các tổ chức phải thực hiện quản lý chặt chẽ để giảm thiểu rủi ro an ninh sinh học.

Hệ sinh thái và tích hợp nào thúc đẩy việc áp dụng?

Grok 3: Tích hợp X và thông tin chi tiết theo thời gian thực

Grok 3 được tích hợp sâu vào các gói Premium+ và SuperGrok của X, cung cấp trải nghiệm chatbot trong ứng dụng, chế độ xem trước bằng giọng nói và quyền truy cập API doanh nghiệp thông qua docs.x.ai. DeepSearch và sắp tới là DeeperSearch cho phép các chuyên gia truy vấn trực tiếp cảm xúc xã hội, hồ sơ pháp lý hoặc dữ liệu tài chính theo thời gian thực mà không cần rời khỏi X. Tuy nhiên, các lỗ hổng kiểm duyệt nội dung đã gây ra tranh cãi khi Grok 3 đưa ra thông tin sai lệch hoặc nội dung xúc phạm, khiến xAI phải gợi ý về các lớp rào chắn sắp tới.

O3: Triển khai đa nền tảng và tập trung vào nhà phát triển

OpenAI đã triển khai O3 trên ChatGPT (Plus, Pro, Enterprise) và các điểm cuối API, cũng như tích hợp với Microsoft Azure và GitHub Copilot. Các nhà phát triển tận dụng chuỗi suy nghĩ của O3 thông qua cờ SDK, cho phép các lượt suy luận có chọn lọc cho mỗi trường hợp sử dụng. Việc cung cấp miễn phí O3-mini cho tất cả người dùng ChatGPT (có giới hạn tốc độ) giúp dân chủ hóa quyền truy cập, trong khi những người đăng ký Pro mở khóa tầng suy luận "cao". Tải tệp và hình ảnh lên mở rộng thêm khả năng áp dụng của O3 vào phân tích tài liệu và trả lời câu hỏi trực quan.

Các mô hình định giá so sánh thế nào?

Giá cả tập trung vào mô hình của xAI

API doanh nghiệp của Grok 3 ra mắt với mức giá 3 đô la cho một triệu token đầu vào và 15 đô la cho một triệu token đầu ra vào tháng 2025 năm 3, với mức chiết khấu cho các cam kết về khối lượng. Grok 40 mini được cung cấp với mức giá khoảng một nửa, phục vụ cho các dự án có ngân sách thấp hơn. Người dùng X Premium+ trả XNUMX đô la/tháng để được quyền truy cập ưu tiên, trong khi những người đăng ký SuperGrok phải chịu mức phí bảo hiểm không được tiết lộ cho các truy vấn Grok "không giới hạn".

Chiến lược truy cập theo từng cấp độ của OpenAI

OpenAI đóng gói O3-mini trong các gói ChatGPT Plus (20 đô la/tháng) và Pro (30 đô la/tháng): Người dùng Plus có được lý luận cấp trung bình, Pro mở khóa cấp cao mà không mất thêm phí. Chi phí gọi API O3 là 6 đô la cho một triệu token—gấp đôi mức giá O1 nhưng bằng một nửa giá token đầu ra của Grok 3—phản ánh cam kết của OpenAI trong việc cân bằng chi phí và khả năng. Phương pháp tiếp cận theo từng cấp này đơn giản hóa việc lập ngân sách cho các công ty khởi nghiệp và nhà nghiên cứu, mặc dù phải đánh đổi bằng việc kiểm soát chặt chẽ các cấp độ lý luận mà xAI đưa ra.

Grok 3 so với O3: Bạn nên chọn cái nào?

So sánh hiệu suất: Tốc độ, khả năng mở rộng và độ tin cậy

| Chỉ số hiệu suất | o3 | Grok 3 |

|---|---|---|

| Thời gian đáp ứng | Trung bình 120ms khi tải | Trung bình 90ms khi tải |

| khả năng mở rộng | Mở rộng theo chiều ngang với Kubernetes | Mở rộng theo chiều dọc với bộ nhớ đệm được tối ưu hóa |

| Độ tin cậy về thời gian hoạt động | 99.95% SLA | 99.9% SLA |

| Thông lượng (yêu cầu/giây) | 5000 + | 4500 + |

| Độ trễ xử lý dữ liệu | 150ms (chế độ hàng loạt) | 80ms (phát trực tuyến thời gian thực) |

Việc lựa chọn giữa Grok 3 và o3 phụ thuộc vào các yêu cầu cụ thể, ưu tiên chiến lược và khả năng chấp nhận rủi ro.

Khuyến nghị theo trường hợp sử dụng

- Để nghiên cứu sâu sắc và sáng tạo đa phương thức: Khả năng tìm kiếm chuyên sâu và hình ảnh tích hợp của Grok 3 khiến nó trở nên lý tưởng cho các công ty nội dung, studio thiết kế và các tổ chức học thuật đang tìm kiếm một bảng phác thảo đa năng để lên ý tưởng và tạo mẫu.

- Dành cho quy trình làm việc và chuỗi công cụ của doanh nghiệp: Công cụ tích hợp tác lý của o3 và quyền truy cập API ngay lập tức phù hợp với các nhóm phần mềm, nhà phân tích tài chính và phòng thí nghiệm khoa học cần khả năng tăng cường đáng tin cậy, theo mô-đun trong các quy trình hiện có.

Sử dụng Grok 3 và O3 trong CometAPI

Sao chổiAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp Giao diện lập trình O3 (tên mẫu: o3/ o3-2025-04-16) Và API Grok 3 (tên mẫu: grok-3;grok-3-latest;), và bạn sẽ nhận được 1 đô la trong tài khoản của mình sau khi đăng ký và đăng nhập! Chào mừng bạn đến đăng ký và trải nghiệm CometAPI.

Để bắt đầu, hãy khám phá các khả năng của mô hình trong Sân chơi và tham khảo Hướng dẫn API để biết hướng dẫn chi tiết. Lưu ý rằng một số nhà phát triển có thể cần xác minh tổ chức của họ trước khi sử dụng mô hình.

Giá cả trong CometAPI được cấu trúc như sau:

| Phân loại | Giao diện lập trình O3 | Grok 3 |

| Định giá API | o3/ o3-2025-04-16 Mã thông báo đầu vào: 8 đô la/M mã thông báo Mã thông báo đầu ra: 32 đô la/M mã thông báo | grok-3;grok-3-latest Mã thông báo đầu vào: $1.6/M mã thông báo Mã thông báo đầu ra: 6.4 đô la/M mã thông báo grok-3-fast Mã thông báo đầu vào: $4/M mã thông báo Mã thông báo đầu ra: 20 đô la/M mã thông báo |

Kết luận

Grok 3 và O3 là hình mẫu tiêu biểu cho ranh giới hiện tại của lý luận AI. Grok 3 khẳng định tuyên bố của mình về tính toán thô, tích hợp mở với phương tiện truyền thông xã hội và đầu ra không được lọc, hấp dẫn người dùng có quyền lực và các doanh nghiệp đang tìm kiếm thông tin chi tiết theo thời gian thực. Mặt khác, O3 thể hiện một cách tiếp cận được cân nhắc đối với chuỗi suy nghĩ tích hợp, hỗ trợ nền tảng rộng rãi và giá theo từng tầng thúc đẩy việc áp dụng rộng rãi. Cuối cùng, sự lựa chọn phụ thuộc vào yêu cầu của dự án: Grok 3 vượt trội trong môi trường năng động, giàu dữ liệu, trong khi O3 cung cấp tính nhất quán, an toàn và độ trưởng thành của hệ sinh thái. Khi cả xAI và OpenAI đều tinh chỉnh các mô hình của mình, người dùng có thể mong đợi những tiến bộ liên tục về độ chính xác, hiệu quả và đa phương thức, định hình thế hệ trợ lý AI tiếp theo.