MiniMax-M2.5 là một mô hình ngôn ngữ lớn mới từ MiniMax, tập trung vào năng suất, được tối ưu cho lập trình, sử dụng công cụ theo kiểu agent và quy trình công việc văn phòng. Bạn có thể gọi nó qua nền tảng MiniMax gốc hoặc qua các bộ tổng hợp API như CometAPI. Bạn chỉ cần lấy khóa API của CometAPI để dùng API, vì Minimax-M2.5 cũng hỗ trợ định dạng chat.

MiniMax-M2.5 là gì?

MiniMax-M2.5 là bản phát hành mô hình lớn mới nhất từ MiniMax: sự phát triển của dòng M2 mà công ty định vị như một mô hình đa dụng, có khả năng agent, với hiệu năng đặc biệt mạnh ở sinh mã, sử dụng công cụ và suy luận nhiều bước. Dòng M2.5 được công bố phát hành vào tháng 2/2026 và gồm cả biến thể M2.5 tiêu chuẩn và “highspeed” tối ưu cho độ trễ thấp trong khi giữ nguyên các khả năng cốt lõi. Dòng M2.5 cải thiện điểm số benchmark trong các đánh giá kỹ nghệ phần mềm và hành vi tốt hơn khi tương tác với công cụ bên ngoài (tìm kiếm, agents, v.v.).

Nhà cung cấp định vị M2.5 là bước tiến so với các bản M2.x trước đó với khả năng suy luận mạnh hơn, sinh mã tốt hơn và độ tin cậy gọi công cụ được cải thiện. Ghi chú phát hành công khai của MiniMax đầu tháng 2/2026 đánh dấu M2.5 là một cột mốc: tinh chỉnh instruction tốt hơn, hiểu mã mạnh hơn và có cải thiện đo đếm được trên nhiều benchmark tập trung vào mã. Bản phát hành bao gồm:

- Một mô hình M2.5 tiêu chuẩn (nhấn mạnh độ chính xác và suy luận).

- Một biến thể M2.5-highspeed có độ trễ thấp hơn cho quy trình làm việc tương tác của lập trình viên.

- Hướng dẫn rõ ràng và tùy chọn tính phí cho “Coding Plan” hướng tới khối lượng sinh mã lớn.

Điểm nổi bật kỹ thuật chính

- Kiến trúc: MoE (tổng số tham số rất lớn với tập tham số hoạt động nhỏ hơn nhiều trong quá trình suy luận), cho phép đạt điểm cân bằng chi phí/hiệu năng cho các tác vụ nặng.

- Thế mạnh: hiệu năng lập trình tối tân, suy luận nhiều lượt, xử lý ngữ cảnh dài và tích hợp agents/công cụ.

- Biến thể: MiniMax phát hành các biến thể (ví dụ:

MiniMax-M2.5vàM2.5-highspeed) tinh chỉnh cho thông lượng so với độ trễ.

Vì sao điều này quan trọng hiện nay: nhiều đội ngũ xây dựng công cụ cho lập trình viên, trợ lý lập trình và tự động hóa agent đánh giá cao một mô hình có thể suy luận qua nhiều lượt, gọi công cụ an toàn và phát ra mã chất lượng cao. M2.5 — nhờ kiến trúc và lựa chọn huấn luyện — được tiếp thị rõ ràng cho các tình huống đó.

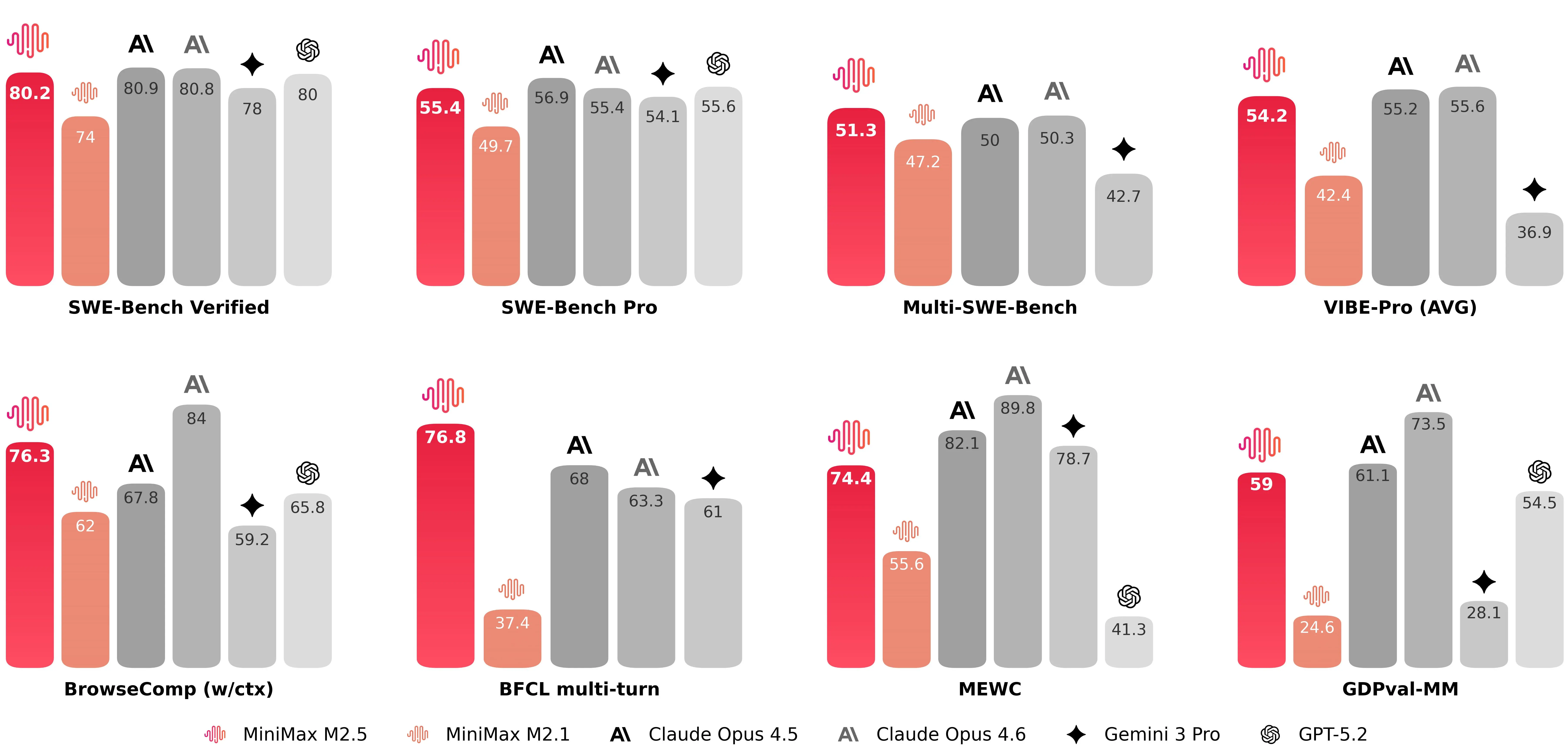

Đánh giá Benchmark của MiniMax-M2.5

Vị trí của M2.5 trên các benchmark chuyên về lập trình

MiniMax-M2.5 đạt 80,2% trên SWE-Bench Verified, cùng với điểm số mạnh trên các benchmark lập trình đa nhiệm và có tăng cường duyệt web (các số liệu đáng chú ý do công ty công bố bao gồm 51,3% trên Multi-SWE-Bench và 76,3% trên BrowseComp khi bật quản lý ngữ cảnh). Những con số này đặt M2.5 vào nhóm các mô hình có hiệu năng cao nhất, công khai, về sinh mã và giải quyết vấn đề tại thời điểm ra mắt. Việc ra mắt MiniMax-M2.5 củng cố rằng M2.5 đang cạnh tranh với nhóm đầu của các mô hình lập trình.

Đối với lập trình viên, lợi ích có hai mặt:

- Tỷ lệ thành công ngay lần đầu cao hơn: ít vòng sửa lỗi hơn, ít cần gỡ lỗi thủ công và giảm “trông chừng” cho các agent lập trình tự động.

- Bao phủ full‑stack tốt hơn: M2.5 được mô tả là hỗ trợ quy trình full‑stack trên ứng dụng desktop, di động và chuỗi công cụ đa nền tảng, nghĩa là nó hướng tới việc sinh không chỉ đoạn mã nhỏ mà còn các giải pháp nhiều tệp và script build mạch lạc.

Được xây dựng cho quy trình tác tử (agentic)

M2.5 được mô tả là “thiết kế gốc cho kịch bản Agent”. Trên thực tế, điều đó có nghĩa là kiến trúc và chế độ huấn luyện ưu tiên:

- Độ trung thực khi gọi công cụ: phát lệnh gọi API hoặc chạy lệnh shell/SQL với cú pháp và tham số chính xác.

- Chuyển đổi và ghi nhớ ngữ cảnh: tiếp tục một thao tác nhiều bước bị gián đoạn mà không làm mất trạng thái đã tính trước đó.

- Thao tác tệp: tạo và chỉnh sửa các định dạng văn phòng phổ biến bằng chương trình (ví dụ, tạo PowerPoint rồi hiệu chỉnh dựa trên yêu cầu theo sau).

Tăng cường tìm kiếm và duyệt

Khi M2.5 được ghép với các lớp duyệt hoặc truy xuất, MiniMax báo cáo điểm số cải thiện rõ rệt trên các benchmark duyệt, phản ánh hiệu năng mạnh hơn khi tích hợp thông tin bên ngoài và trích dẫn vào đầu ra. Điều đó làm M2.5 phù hợp cho các công cụ cần lấy nội dung cập nhật, đối chiếu kết quả API hoặc tăng cường sinh mã với dữ liệu thực tế (ví dụ, lấy tài liệu SDK mới nhất và dùng đúng trong quá trình sinh mã). Các khả năng này quan trọng cho đội ngũ xây dựng tính năng “agentic” như QA tự động, chuỗi công cụ CI, hoặc trợ lý dựa trên tài liệu.

Tôi có thể dùng API MiniMax-2.5 (qua CometAPI) như thế nào?

CometAPI là một nền tảng tổng hợp API cung cấp hàng trăm mô hình qua một bề mặt REST tương thích OpenAI. Vì giao diện của CometAPI phản chiếu các endpoint chat/completions của OpenAI, bạn thường có thể tái sử dụng client kiểu OpenAI hiện có chỉ bằng cách đổi api_base và khóa API. Nếu bạn không muốn tích hợp trực tiếp với nền tảng MiniMax (vì các lý do như gộp thanh toán, A/B test đa mô hình, hoặc trừu tượng hóa nhà cung cấp), bạn có thể gọi MiniMax-M2.5 qua bề mặt “chat” của CometAPI. Nền tảng CometAPI cung cấp định dạng request nhất quán, một SDK và playground web — và cung cấp tên/tham số theo từng mô hình (để bạn chọn đúng chuỗi nhà cung cấp/mô hình khi gọi).

Dưới đây là hướng dẫn ngắn gọn, thực tế để gọi MiniMax-M2.5 qua CometAPI, với ví dụ bằng curl và Python.

Các bước cơ bản để bắt đầu?

- Đăng ký tài khoản CometAPI và lấy khóa API. (CometAPI cung cấp playground và SDK để thử nghiệm mô hình.)

- Kiểm tra danh sách mô hình của CometAPI hoặc playground của CometAPI để tìm đúng tên mô hình cho MiniMax-M2.5.

- Thực hiện một POST có xác thực với tham số

modelđặt thành mô hình MiniMax đã chọn và payload theo schema chat/completion của CometAPI. - Điều chỉnh tham số (temperature, max_tokens, system messages, streaming) theo quy trình làm việc của bạn.

Xác thực & những điều cơ bản về endpoint

- Base URL:

https://api.cometapi.com/v1(hỗ trợ các đường dẫn kiểu OpenAI như/chat/completions). - Header:

Authorization: Bearer YOUR_COMETAPI_KEY - Content-Type:

application/json - Trường Model: dùng đúng chuỗi tên mô hình từ danh mục mô hình của CometAPI (ví dụ:

"minimax-m2.5"

Ví dụ 1 — curl nhanh (REST, kiểu OpenAI)

// Không chỉnh sửa nội dung trong khối mã này theo yêu cầu

# Replace $COMETAPI_KEY with your CometAPI key

curl -s -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer $COMETAPI_KEY" \

-H "Content-Type: "application/json" \

-d '{

"model": "minimax-m2.5",

"messages": [

{"role":"system","content":"You are a concise, safety-conscious coding assistant."},

{"role":"user","content":"Refactor this synchronous Python function to async and add basic error handling:\n\n```\ndef fetch(user_id):\n resp = http_get(f\"https://api.example.com/users/{user_id}\")\n return resp.json()\n```"}

],

"max_tokens": 800,

"temperature": 0.0,

"stream": false

}'

Ghi chú:

- Hãy dùng chuỗi tên model chính xác như hiển thị trong danh mục của CometAPI; s.

stream: trueđược hỗ trợ để stream đầu ra (xử lý server-sent events hoặc phản hồi theo từng khối nếu bạn muốn nhận từng phần token).

Ví dụ 2 — Python (requests) cho một chat completion

import os, requests

COMET_KEY = os.environ.get("COMETAPI_KEY") # recommended

URL = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "minimax-m2.5", # or "minimax/minimax-m2.5" — verify Comet's model page

"messages": [

{"role": "system", "content": "You are a helpful engineer who returns clear, tested code."},

{"role": "user", "content": "Write a pytest for the following function that asserts edge cases..."}

],

"temperature": 0.1,

"max_tokens": 1000,

}

r = requests.post(URL, json=payload, headers=headers, timeout=120)

r.raise_for_status()

out = r.json()

print(out["choices"][0]["message"]["content"])

Ví dụ 3 — Dùng litellm / tích hợp CometAPI (lớp tiện dụng Python)

CometAPI được hỗ trợ bởi nhiều SDK và adapter cộng đồng. Tài liệu liteLLM cho thấy một luồng gọn nhẹ nơi bạn đặt COMETAPI_KEY và gọi mô hình theo tên. Điều này rất phù hợp để dựng thử nhanh:

import os

from litellm import completion

os.environ["COMETAPI_KEY"] = "your_cometapi_key_here"

messages = [{"role":"user", "content":"Explain async/await in Python in 3 bullets."}]

resp = completion(model="minimax-m2.5", messages=messages)

print(resp.choices[0].message.content)

Tích hợp Litellm / Comet cung cấp các tiện ích hữu ích (streaming, async, tham số api_key tường minh) phản chiếu nhiều mẫu SDK OpenAI hiện có.

Bạn nên thiết kế prompt và system message cho M2.5 như thế nào

Nêu rõ vai trò và ràng buộc

Đặt một vai trò hệ thống rõ ràng khi yêu cầu viết mã. Ví dụ:

{"role": "system","content": "You are MiniMax M2.5, an assistant specialized in robust, readable, and well-documented code. Use Python 3.11 conventions, include type hints, and provide brief unit tests."}

Dùng phân rã bước cho các bài toán phức tạp

Khi yêu cầu M2.5 triển khai các tính năng phức tạp, hãy dùng phân rã ngắn:

- Yêu cầu dàn ý thiết kế.

- Yêu cầu chữ ký giao diện.

- Yêu cầu triển khai và kiểm thử.

Điều này giảm rủi ro bịa đặt và cho ra kết quả mô-đun, dễ review.

Temperature, max_tokens và an toàn

- Với mã mang tính quyết định: đặt

temperaturegần 0,0. - Với thiết kế mang tính khám phá:

temperaturetừ 0,2–0,5 có thể gợi mở các hướng tiếp cận sáng tạo. - Giữ

max_tokensrộng rãi cho các refactor lớn hoặc bộ kiểm thử dài.

Yêu cầu unit test và giải thích

Khi yêu cầu mã, cũng yêu cầu unit test và giải thích ngắn về thuật toán. Điều này giúp bạn phát hiện lỗi tinh vi và nhận được hiện vật có thể chạy ngay từ lần đầu.

Suy luận tác vụ dài và theo dõi trạng thái

Mô hình M2.5 có cơ chế theo dõi trạng thái xuất sắc, đảm bảo hiệu quả tính liên tục và định hướng suy nghĩ trong chuỗi dài bằng cách tập trung vào một số mục tiêu giới hạn mỗi lần thay vì xử lý mọi thứ song song. M2.5 được trang bị tính năng nhận biết ngữ cảnh, cho phép thực thi tác vụ hiệu quả và tối ưu quản lý ngữ cảnh.

Mẹo sử dụng M2.5 trong môi trường sản xuất

MiniMax-M2.5 được tinh chỉnh cho công cụ đa bước và mã. Dưới đây là các mẹo thực tiễn để đạt kết quả tốt nhất trong sản xuất.

Kỹ thuật prompt & system message

- Dùng system message rõ ràng về vai trò và ràng buộc. Với tác vụ mã, nêu rõ runtime/khung kiểm thử (ví dụ, “Trả về một pytest tương thích Python 3.11”).

- Cung cấp ngữ cảnh: với công việc theo kiểu agent hoặc nhiều bước, bao gồm siêu dữ liệu bước và mô tả công cụ dạng JSON có cấu trúc hoặc danh sách gạch đầu dòng. M2.5 phản hồi tốt với đầu vào có cấu trúc vì nó được tối ưu cho việc dùng công cụ.

Gọi hàm/công cụ

- Nếu bạn dùng CometAPI như cổng gọi công cụ, đảm bảo các trường bổ sung của bạn (ví dụ,

function_calltheo kiểu OpenAI) khớp với kỳ vọng của CometAPI/mô hình. Xác nhận hỗ trợ mô hình trên trang mô hình của Comet vì ngữ nghĩa công cụ có thể khác giữa nhà cung cấp. - Để điều phối vững chắc, chia nhỏ tác vụ lớn thành các lượt gọi nhỏ và duy trì các điểm kiểm tra quyết định. M2.5 giỏi tuân theo hướng dẫn nhiều bước, nhưng bạn sẽ đạt độ tin cậy cao nhất khi xác thực sau mỗi bước.

Temperature, max_tokens và kiểm soát chi phí

- Với sinh mã hoặc refactor, đặt

temperaturethấp (0,0–0,2) và dùngmax_tokensphù hợp kích thước đầu ra kỳ vọng. - Với prompt mang tính khám phá, tăng

temperaturenhưng lưu ý mức sử dụng token tăng. Khi định tuyến qua CometAPI, so sánh giá của nhà cung cấp và quy tắc fallback — CometAPI liệt kê giá token theo từng phiên bản mô hình trong danh mục.

Cửa sổ ngữ cảnh & tài liệu dài

- Các biến thể M2.5 thường hỗ trợ ngữ cảnh dài (kiểm tra thông số mô hình để biết độ dài ngữ cảnh). Với tài liệu rất dài, hãy chia khối và tóm tắt — rồi đưa vào bản tóm tắt cùng với các khối liên quan thay vì gửi toàn bộ tệp trong một lần gọi.

An toàn, nội dung độc hại và giảm thiểu bịa đặt

- Dùng hàng rào bảo vệ: system message, bộ kiểm tra bên ngoài và bộ kiểm thử (ví dụ, unit test cho mã được sinh) giúp giảm rủi ro.

- Xác minh tham chiếu bên ngoài: nếu mô hình trích dẫn thông tin hoặc mã từ web, hãy xác minh bằng lập trình trước khi tin tưởng hoặc đưa vào sản phẩm.

Các cạm bẫy thường gặp và cách tránh

Cạm bẫy: Quá tin vào một đầu ra mô hình

Biện pháp: Chạy kiểm thử, kiểm tra tĩnh và, với logic quan trọng, yêu cầu nhiều hoàn tất độc lập và so sánh. CometAPI cho phép chuyển đổi giữa nhiều mô hình, và bạn có thể chuyển đổi bất cứ lúc nào bằng định dạng chat của OpenAI.

Cạm bẫy: Dùng temperature cao cho mã sản xuất

Biện pháp: Giữ temperature thấp; nếu cần phương án sáng tạo, yêu cầu nhiều biến thể ở nhiệt độ thấp hoặc yêu cầu mô hình giải thích khác biệt.

Cạm bẫy: Bỏ qua quản lý phiên bản mô hình

Biện pháp: Theo dõi tên mô hình và chuỗi nhà cung cấp trong manifest triển khai. Khi chuyển từ MiniMax-M2.5 sang MiniMax-M2.5-highspeed hoặc sang nhà cung cấp khác, hãy coi đó là thay đổi phiên bản và chạy kiểm thử hồi quy.

Khuyến nghị cuối cùng và kỳ vọng thực tế

MiniMax-M2.5 là một bước tiến đáng chú ý cho các LLM tập trung vào mã và agent — hứa hẹn sinh mã mạnh, suy luận nhiều lượt và hành vi an toàn với công cụ. Nếu ưu tiên của đội ngũ bạn là xây dựng công cụ cho lập trình viên, khung agent hoặc trợ lý mã, M2.5 xứng đáng có mặt trong ma trận so sánh của bạn. Dùng CometAPI như một cổng thống nhất có thể tăng tốc thử nghiệm và cho phép bạn chuyển nhà cung cấp hoặc A/B mô hình mà không cần làm lại toàn bộ tích hợp.

Một vài kết luận thực tế:

- Dựng thử nhanh bằng playground của CometAPI, sau đó khóa chặt định danh mô hình trong mã.

- Dùng temperature thấp, yêu cầu kiểm thử và giải thích, và luôn chạy kiểm chứng tự động.

- Hãy coi mô hình như một đồng lập trình viên mạnh mẽ — không phải kẻ bất khả sai: áp dụng review của con người, pipeline CI và telemetry.

Các nhà phát triển có thể truy cập MInimax-M2.5 qua CometAPI ngay bây giờ. Để bắt đầu, hãy khám phá khả năng của mô hình trong Playground và tham khảo API guide để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập CometAPI và lấy khóa API. CometAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng bắt đầu? → Đăng ký M2.5 ngay hôm nay!

Nếu bạn muốn biết thêm mẹo, hướng dẫn và tin tức về AI, hãy theo dõi chúng tôi trên VK, X và Discord!