API GPT-5.2 là gì

API GPT-5.2 giống với GPT-5.2 Thinking trong ChatGPT. GPT-5.2 Thinking là biến thể tầm trung trong dòng GPT-5.2 của OpenAI, được thiết kế cho các tác vụ chuyên sâu: suy luận nhiều bước, tóm tắt tài liệu dài, tạo mã chất lượng cao và các công việc tri thức chuyên nghiệp, nơi độ chính xác và cấu trúc hữu ích quan trọng hơn thông lượng thuần túy. Trong API, nó được cung cấp dưới dạng mô hình gpt-5.2 (Responses API / Chat Completions), và nằm giữa biến thể Instant có độ trễ thấp và biến thể Pro chất lượng cao hơn nhưng đắt hơn.

Các tính năng chính

- Ngữ cảnh rất dài & nén ngữ cảnh: cửa sổ hiệu quả 400K và các công cụ nén ngữ cảnh để quản lý mức độ liên quan trong các cuộc trò chuyện và tài liệu dài.

- Mức độ suy luận có thể cấu hình:

none | medium | high | xhigh(xhighcho phép mức tính toán nội bộ tối đa cho các bài toán suy luận khó).xhighđược cung cấp cho các biến thể Thinking/Pro. - Hỗ trợ công cụ và hàm mạnh hơn: gọi công cụ hạng nhất, ngữ pháp (CFG/Lark) để ràng buộc đầu ra có cấu trúc, và các hành vi tác tử được cải thiện giúp đơn giản hóa tự động hóa phức tạp nhiều bước.

- Hiểu đa phương thức: khả năng hiểu hình ảnh + văn bản phong phú hơn và tích hợp vào các tác vụ nhiều bước.

- Cải thiện an toàn / xử lý nội dung nhạy cảm: các can thiệp có mục tiêu nhằm giảm các phản hồi không mong muốn trong những lĩnh vực như tự gây hại và các bối cảnh nhạy cảm khác.

Khả năng kỹ thuật & thông số kỹ thuật (góc nhìn nhà phát triển)

- Các endpoint API & ID mô hình:

gpt-5.2cho Thinking (Responses API),gpt-5.2-chat-latestcho quy trình chat/instant, vàgpt-5.2-procho tầng Pro; khả dụng qua Responses API và Chat Completions khi được chỉ định. - Token suy luận & quản lý mức độ nỗ lực: API hỗ trợ các tham số tường minh để phân bổ mức tính toán (mức độ suy luận) cho mỗi yêu cầu; mức độ cao hơn làm tăng độ trễ và chi phí nhưng cải thiện chất lượng đầu ra cho các tác vụ phức tạp.

- Công cụ đầu ra có cấu trúc: hỗ trợ ngữ pháp (Lark / CFG) để ràng buộc đầu ra của mô hình vào một DSL hoặc cú pháp chính xác (hữu ích cho SQL, JSON, tạo DSL).

- Gọi công cụ song song & điều phối tác tử: khả năng song song hóa được cải thiện và điều phối công cụ gọn gàng hơn giúp giảm nhu cầu về các system prompt phức tạp và kiến trúc đa tác tử.

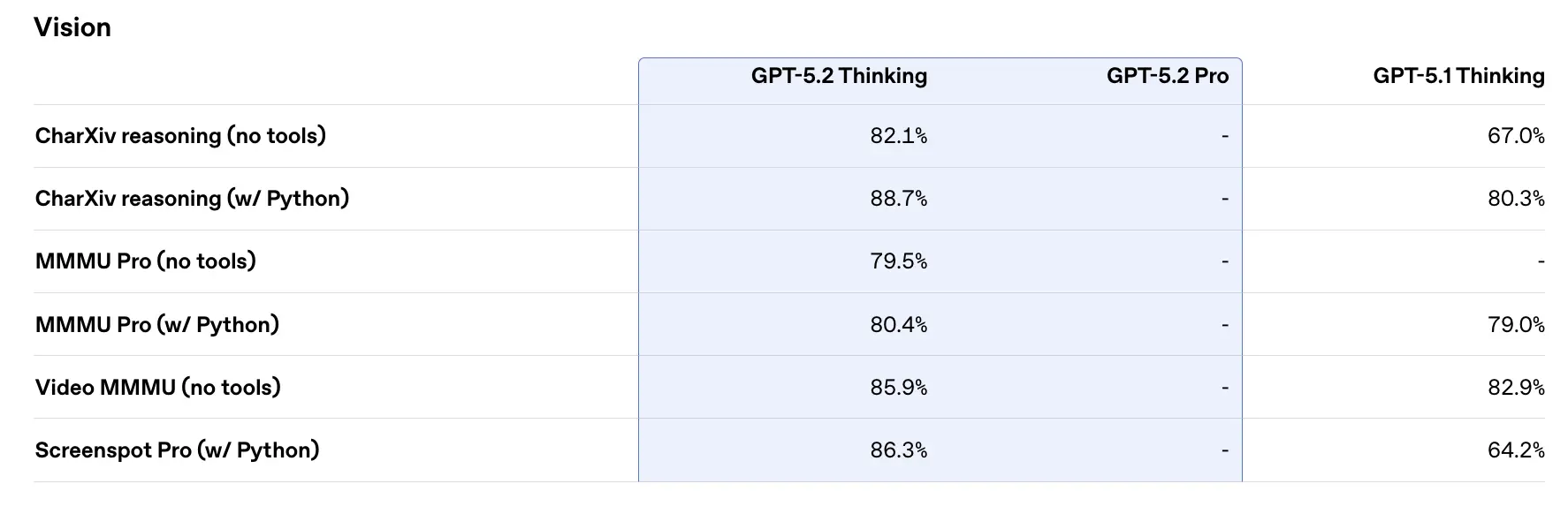

Hiệu năng benchmark & dữ liệu hỗ trợ

OpenAI đã công bố nhiều kết quả benchmark nội bộ và bên ngoài cho GPT-5.2. Một số điểm nổi bật được chọn (theo số liệu OpenAI công bố):

- GDPval (44 ngành nghề, công việc tri thức) — GPT-5.2 Thinking “vượt hoặc ngang bằng các chuyên gia hàng đầu trong ngành ở 70.9% số lần so sánh”; OpenAI báo cáo rằng đầu ra được tạo ra với tốc độ >11× và chi phí <1% so với các chuyên gia trên các tác vụ GDPval của họ (ước tính tốc độ và chi phí dựa trên dữ liệu lịch sử). Các tác vụ này bao gồm mô hình bảng tính, bài thuyết trình và video ngắn.

- SWE-Bench Pro (lập trình) — theo OpenAI, GPT-5.2 Thinking đạt ≈55.6% trên SWE-Bench Pro và ~80% trên SWE-Bench Verified (chỉ Python), thiết lập trạng thái tốt nhất mới cho đánh giá tạo mã / kỹ thuật trong các bài kiểm tra của họ. Theo các ví dụ của OpenAI, điều này chuyển hóa thành việc gỡ lỗi và sửa lỗi đầu-cuối đáng tin cậy hơn trong thực tế.

- GPQA Diamond (hỏi đáp khoa học trình độ sau đại học) — GPT-5.2 Pro: 93.2%, GPT-5.2 Thinking: 92.4% trên GPQA Diamond (không dùng công cụ, suy luận tối đa).

- Chuỗi ARC-AGI — Trên ARC-AGI-2 (một benchmark suy luận linh hoạt khó hơn), GPT-5.2 Thinking đạt 52.9% và GPT-5.2 Pro đạt 54.2% (OpenAI cho biết đây là các mức tốt nhất mới cho các mô hình kiểu chain-of-thought).

- Ngữ cảnh dài (OpenAI MRCRv2) — GPT-5.2 Thinking cho thấy độ chính xác gần 100% trên biến thể MRCR 4-needle tới 256k token và điểm số được cải thiện đáng kể so với GPT-5.1 trong các thiết lập ngữ cảnh dài. (OpenAI đã công bố biểu đồ và bảng MRCRv2.)

So sánh với các đối thủ cùng thời

- so với Google Gemini 3 (Gemini 3 Pro / Deep Think): Gemini 3 Pro được công bố với cửa sổ ngữ cảnh ~1,048,576 (≈1M) token và đầu vào đa phương thức rộng (văn bản, hình ảnh, âm thanh, video, PDF) cùng tích hợp tác tử mạnh qua Vertex AI / AI Studio. Trên lý thuyết, cửa sổ ngữ cảnh lớn hơn của Gemini 3 là một điểm khác biệt cho các khối lượng công việc cực lớn trong một phiên duy nhất; các đánh đổi bao gồm bề mặt công cụ và mức độ phù hợp hệ sinh thái.

- so với Anthropic Claude Opus 4.5: Opus 4.5 của Anthropic nhấn mạnh các quy trình lập trình/tác tử doanh nghiệp và báo cáo kết quả SWE-bench mạnh cùng độ ổn định cho các phiên tác tử dài; Anthropic định vị Opus cho tự động hóa và tạo mã với cửa sổ ngữ cảnh 200k cùng các tích hợp tác tử/Excel chuyên biệt. Opus 4.5 là một đối thủ mạnh trong tự động hóa doanh nghiệp và các tác vụ mã.

Kết luận thực tiễn: GPT-5.2 nhắm tới một tập hợp cải tiến cân bằng (ngữ cảnh 400k, đầu ra token cao, suy luận/lập trình được cải thiện). Gemini 3 nhắm tới các ngữ cảnh một phiên lớn nhất tuyệt đối (≈1M), trong khi Claude Opus tập trung vào kỹ thuật doanh nghiệp và độ bền vững của tác tử. Hãy lựa chọn bằng cách đối chiếu kích thước ngữ cảnh, nhu cầu đa phương thức, mức độ phù hợp về tính năng/công cụ, và các đánh đổi về chi phí/độ trễ.

Cách truy cập và sử dụng API GPT-5.2

Bước 1: Đăng ký API Key

Đăng nhập vào cometapi.com. Nếu bạn chưa là người dùng của chúng tôi, vui lòng đăng ký trước. Đăng nhập vào bảng điều khiển CometAPI của bạn. Lấy khóa API thông tin xác thực truy cập của giao diện. Nhấp vào “Add Token” tại mục API token trong trung tâm cá nhân, lấy khóa token: sk-xxxxx và gửi đi.

Bước 2: Gửi yêu cầu tới API GPT-5.2

Chọn endpoint “gpt-5.2” để gửi yêu cầu API và thiết lập phần thân yêu cầu. Phương thức yêu cầu và phần thân yêu cầu được lấy từ tài liệu API trên website của chúng tôi. Website của chúng tôi cũng cung cấp bài kiểm tra Apifox để thuận tiện cho bạn. Thay thế <YOUR_API_KEY> bằng khóa CometAPI thực tế từ tài khoản của bạn. Các nhà phát triển gọi chúng qua endpoint Responses API / Chat.

Chèn câu hỏi hoặc yêu cầu của bạn vào trường content — đây là nội dung mà mô hình sẽ phản hồi. Xử lý phản hồi API để lấy câu trả lời được tạo.

Bước 3: Truy xuất và xác minh kết quả

Xử lý phản hồi API để lấy câu trả lời được tạo. Sau khi xử lý, API phản hồi với trạng thái tác vụ và dữ liệu đầu ra.

Xem thêm Gemini 3 Pro Preview API