Vào ngày 19–20 tháng 11 năm 2025, OpenAI đã phát hành hai bản nâng cấp có liên quan nhưng khác biệt: GPT-5.1-Codex-Max, một mô hình mã hóa tác nhân mới cho Codex nhấn mạnh vào mã hóa đường chân trời dài, hiệu quả mã thông báo và "nén" để duy trì các phiên đa cửa sổ; và GPT-5.1 Pro, một mô hình ChatGPT Pro-tier được cập nhật để có câu trả lời rõ ràng hơn, có khả năng hơn trong công việc phức tạp và chuyên nghiệp.

GPT-5.1-Codex-Max là gì và nó đang cố gắng giải quyết vấn đề gì?

GPT-5.1-Codex-Max là một mô hình Codex chuyên biệt từ OpenAI được điều chỉnh cho các quy trình mã hóa yêu cầu lý luận và thực hiện bền vững, có tầm nhìn xa. Trong trường hợp các mô hình thông thường có thể bị vấp ngã bởi các ngữ cảnh cực kỳ dài — ví dụ, các trình sắp xếp lại nhiều tệp, vòng lặp tác nhân phức tạp hoặc các tác vụ CI/CD liên tục — Codex-Max được thiết kế để tự động nén và quản lý trạng thái phiên trên nhiều cửa sổ ngữ cảnh, cho phép nó tiếp tục hoạt động mạch lạc khi một dự án duy nhất bao gồm hàng nghìn (hoặc hơn) mã thông báo. OpenAI định vị Codex-Max là bước tiếp theo trong việc biến các tác nhân có khả năng viết mã thực sự hữu ích cho công việc kỹ thuật mở rộng.

GPT-5.1-Codex-Max là gì và nó đang cố gắng giải quyết vấn đề gì?

GPT-5.1-Codex-Max là một mô hình Codex chuyên biệt từ OpenAI được điều chỉnh cho các quy trình mã hóa yêu cầu lý luận và thực hiện bền vững, có tầm nhìn xa. Trong trường hợp các mô hình thông thường có thể bị vấp ngã bởi các ngữ cảnh cực kỳ dài — ví dụ, các trình sắp xếp lại nhiều tệp, vòng lặp tác nhân phức tạp hoặc các tác vụ CI/CD liên tục — Codex-Max được thiết kế để tự động nén và quản lý trạng thái phiên trên nhiều cửa sổ ngữ cảnh, cho phép nó tiếp tục hoạt động một cách mạch lạc vì một dự án duy nhất bao gồm hàng nghìn (hoặc nhiều hơn) mã thông báo.

OpenAI mô tả nó là "nhanh hơn, thông minh hơn và hiệu quả hơn về mã thông báo ở mọi giai đoạn của chu kỳ phát triển" và rõ ràng là nhằm mục đích thay thế GPT-5.1-Codex làm mô hình mặc định trong các bề mặt Codex.

Ảnh chụp nhanh tính năng

- Nén để đảm bảo tính liên tục của nhiều cửa sổ: cắt tỉa và bảo tồn bối cảnh quan trọng để hoạt động mạch lạc trên hàng triệu mã thông báo và giờ. 0

- Hiệu quả mã thông báo được cải thiện so với GPT-5.1-Codex: ít hơn tới ~30% mã thông báo suy nghĩ cho nỗ lực suy luận tương tự trên một số chuẩn mực mã.

- Độ bền tác nhân dài hạn: được quan sát nội bộ để duy trì các vòng lặp tác nhân kéo dài nhiều giờ/nhiều ngày (OpenAI đã ghi nhận các lần chạy nội bộ >24 giờ).

- Tích hợp nền tảng: hiện có sẵn trong Codex CLI, tiện ích mở rộng IDE, công cụ đám mây và đánh giá mã; quyền truy cập API sắp ra mắt.

- Hỗ trợ môi trường Windows: OpenAI đặc biệt lưu ý rằng Windows được hỗ trợ lần đầu tiên trong quy trình làm việc của Codex, mở rộng phạm vi tiếp cận của nhà phát triển trong thế giới thực.

Nó so sánh như thế nào với các sản phẩm cạnh tranh (ví dụ: GitHub Copilot, các AI mã hóa khác)?

GPT-5.1-Codex-Max được giới thiệu là một công cụ cộng tác tự động và dài hạn hơn so với các công cụ hoàn thành theo yêu cầu. Trong khi Copilot và các trợ lý tương tự vượt trội trong việc hoàn thành nhiệm vụ trong thời gian ngắn trong trình soạn thảo, điểm mạnh của Codex-Max nằm ở khả năng điều phối các tác vụ nhiều bước, duy trì trạng thái nhất quán giữa các phiên làm việc và xử lý các quy trình công việc đòi hỏi lập kế hoạch, kiểm thử và lặp lại. Tuy nhiên, phương pháp tiếp cận tốt nhất trong hầu hết các nhóm sẽ là kết hợp: sử dụng Codex-Max cho các tác vụ tự động hóa phức tạp và tác vụ tác nhân kéo dài, và sử dụng các trợ lý nhẹ hơn cho các tác vụ hoàn thành ở cấp độ dòng.

GPT-5.1-Codex-Max hoạt động như thế nào?

“Nén” là gì và nó cho phép thực hiện công việc dài hạn như thế nào?

Một tiến bộ kỹ thuật trung tâm là nén chặt—một cơ chế nội bộ cắt tỉa lịch sử phiên trong khi vẫn giữ nguyên các phần ngữ cảnh nổi bật để mô hình có thể tiếp tục công việc mạch lạc trên nhiều Cửa sổ ngữ cảnh. Trên thực tế, điều này có nghĩa là các phiên Codex đạt đến giới hạn ngữ cảnh sẽ được nén (các mã thông báo cũ hơn hoặc có giá trị thấp hơn sẽ được tóm tắt/bảo toàn) để tác nhân có một cửa sổ mới và có thể tiếp tục lặp lại cho đến khi tác vụ hoàn thành. OpenAI báo cáo các lần chạy nội bộ trong đó mô hình xử lý các tác vụ liên tục trong hơn 24 giờ.

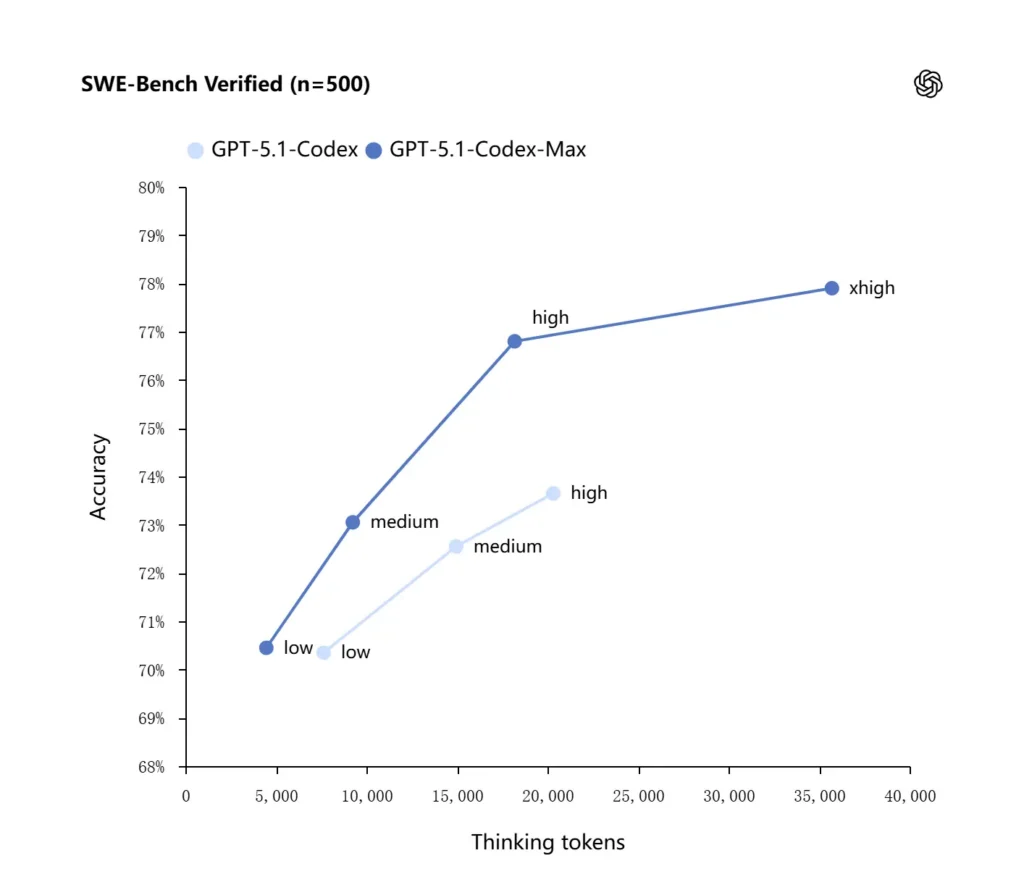

Lý luận thích ứng và hiệu quả của mã thông báo

GPT-5.1-Codex-Max áp dụng các chiến lược suy luận được cải tiến giúp nó hiệu quả hơn về mã thông báo: trong các điểm chuẩn nội bộ được OpenAI báo cáo, mô hình Max đạt được hiệu suất tương tự hoặc tốt hơn GPT-5.1-Codex trong khi sử dụng ít mã thông báo "suy nghĩ" hơn đáng kể—OpenAI trích dẫn đại khái Giảm 30% Mã thông báo suy nghĩ trên SWE-bench đã được xác minh khi chạy ở mức nỗ lực suy luận ngang bằng. Mô hình cũng giới thiệu chế độ nỗ lực suy luận "Cực Cao (xhigh)" cho các tác vụ không nhạy cảm với độ trễ, cho phép mô hình sử dụng nhiều suy luận nội bộ hơn để có được đầu ra chất lượng cao hơn.

Tích hợp hệ thống và công cụ đại lý

Codex-Max đang được phân phối trong các quy trình làm việc của Codex (CLI, tiện ích mở rộng IDE, đám mây và giao diện đánh giá mã) để có thể tương tác với các chuỗi công cụ phát triển thực tế. Các tích hợp ban đầu bao gồm các tác nhân Codex CLI và IDE (VS Code, JetBrains, v.v.), với quyền truy cập API dự kiến sẽ được triển khai sau đó. Mục tiêu thiết kế không chỉ là tổng hợp mã thông minh hơn mà còn là một AI có thể chạy các quy trình làm việc nhiều bước: mở tệp, chạy thử nghiệm, sửa lỗi, tái cấu trúc và chạy lại.

GPT-5.1-Codex-Max hoạt động như thế nào trong các bài kiểm tra chuẩn và công việc thực tế?

Suy luận bền vững và nhiệm vụ tầm nhìn xa

Đánh giá chỉ ra những cải thiện có thể đo lường được trong lý luận bền vững và các nhiệm vụ dài hạn:

- Đánh giá nội bộ của OpenAI: Codex-Max có thể xử lý các tác vụ trong "hơn 24 giờ" trong các thử nghiệm nội bộ và việc tích hợp Codex với các công cụ phát triển đã làm tăng các chỉ số năng suất kỹ thuật nội bộ (ví dụ: mức sử dụng và thông lượng yêu cầu kéo). Đây là những tuyên bố nội bộ của OpenAI và cho thấy những cải tiến về năng suất thực tế ở cấp độ tác vụ.

- Đánh giá độc lập (METR): Báo cáo độc lập của METR đã đo lường quan sát 50% đường chân trời thời gian (một thống kê biểu thị thời gian trung bình mà mô hình có thể duy trì một cách mạch lạc một nhiệm vụ dài) đối với GPT-5.1-Codex-Max vào khoảng giờ 2 40 phút (với khoảng tin cậy rộng), tăng so với 2 giờ 17 phút của GPT-5 trong các phép đo tương đương — một sự cải thiện đáng kể theo xu hướng về tính nhất quán bền vững. Phương pháp luận và CI của METR nhấn mạnh tính biến thiên, nhưng kết quả ủng hộ luận điểm cho rằng Codex-Max cải thiện hiệu suất thực tế trong dài hạn.

Điểm chuẩn mã

OpenAI báo cáo kết quả cải thiện trong các đánh giá mã hóa biên giới, đáng chú ý là SWE-bench Verified, trong đó GPT-5.1-Codex-Max vượt trội hơn GPT-5.1-Codex nhờ hiệu suất mã thông báo tốt hơn. Công ty nhấn mạnh rằng với cùng một nỗ lực suy luận "trung bình", mô hình Max cho kết quả tốt hơn trong khi sử dụng ít hơn khoảng 30% mã thông báo suy nghĩ; đối với người dùng cho phép suy luận nội bộ dài hơn, chế độ xhigh có thể nâng cao hơn nữa câu trả lời, nhưng phải trả giá bằng độ trễ.

| GPT‑5.1-Codex (cao) | GPT‑5.1-Codex-Max (cao gấp đôi) | |

| SWE-bench đã được xác minh (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| Terminal-Bench 2.0 | 52.8% | 58.1% |

GPT-5.1-Codex-Max so với GPT-5.1-Codex như thế nào?

Sự khác biệt về hiệu suất và mục đích

- Phạm vi: GPT-5.1-Codex là biến thể mã hóa hiệu suất cao của họ GPT-5.1; Codex-Max rõ ràng là một tác nhân kế thừa có tầm nhìn dài hạn, được coi là mặc định được khuyến nghị cho Codex và các môi trường giống Codex.

- Hiệu quả của mã thông báo: Codex-Max cho thấy mức tăng hiệu quả về mặt vật chất của mã thông báo (OpenAI tuyên bố giảm khoảng 30% mã thông báo suy nghĩ) trên SWE-bench và trong quá trình sử dụng nội bộ.

- Quản lý bối cảnh: Codex-Max giới thiệu tính năng nén và xử lý nhiều cửa sổ gốc để duy trì các tác vụ vượt quá một cửa sổ ngữ cảnh duy nhất; Codex không cung cấp khả năng này ở cùng quy mô.

- Sự sẵn sàng của dụng cụ: Codex-Max được sử dụng làm mô hình Codex mặc định trên CLI, IDE và các giao diện đánh giá mã, báo hiệu sự di chuyển cho quy trình làm việc của nhà phát triển sản xuất.

Khi nào nên sử dụng mô hình nào?

- Sử dụng GPT-5.1-Codex để hỗ trợ mã hóa tương tác, chỉnh sửa nhanh, cải tiến nhỏ và các trường hợp sử dụng độ trễ thấp, trong đó toàn bộ bối cảnh có liên quan dễ dàng nằm gọn trong một cửa sổ duy nhất.

- Sử dụng GPT-5.1-Codex-Max đối với các tác vụ tái cấu trúc nhiều tệp, các tác vụ tác nhân tự động yêu cầu nhiều chu kỳ lặp, quy trình làm việc giống CI/CD hoặc khi bạn cần mô hình giữ được góc nhìn cấp dự án trong nhiều tương tác.

Mẫu gợi ý thực tế và ví dụ để có kết quả tốt nhất?

Gợi ý các mẫu hoạt động tốt

- Hãy nêu rõ mục tiêu và hạn chế: “Tái cấu trúc X, bảo toàn API công khai, giữ nguyên tên hàm và đảm bảo các bài kiểm tra A, B, C vượt qua.”

- Cung cấp bối cảnh tối thiểu có thể tái tạo: Liên kết đến bài kiểm tra lỗi, bao gồm dấu vết ngăn xếp và các đoạn mã tệp liên quan thay vì đổ toàn bộ kho lưu trữ. Codex-Max sẽ nén lịch sử khi cần.

- Sử dụng hướng dẫn từng bước cho các nhiệm vụ phức tạp: chia các công việc lớn thành một chuỗi các nhiệm vụ phụ và để Codex-Max lặp lại chúng (ví dụ: “1) chạy thử nghiệm 2) sửa 3 thử nghiệm lỗi hàng đầu 3) chạy linter 4) tóm tắt các thay đổi”).

- Yêu cầu giải thích và so sánh: yêu cầu cả bản vá và lý do ngắn gọn để người đánh giá có thể nhanh chóng đánh giá tính an toàn và mục đích.

Mẫu lời nhắc ví dụ

Nhiệm vụ tái cấu trúc

“Tái cấu trúc

payment/mô-đun để trích xuất xử lý thanh toán vàopayment/processor.py. Giữ chữ ký hàm công khai ổn định cho các trình gọi hiện có. Tạo các bài kiểm tra đơn vị choprocess_payment()bao gồm thành công, lỗi mạng và thẻ không hợp lệ. Chạy bộ kiểm thử và trả về các bài kiểm thử không thành công cùng bản vá ở định dạng diff thống nhất.”

Sửa lỗi + kiểm tra

“Một bài kiểm tra

tests/test_user_auth.py::test_token_refreshKhông thành công với lệnh traceback . Điều tra nguyên nhân gốc rễ, đề xuất giải pháp khắc phục với những thay đổi tối thiểu và thêm một bài kiểm tra đơn vị để ngăn ngừa sự hồi quy. Áp dụng bản vá và chạy thử nghiệm.”

Tạo PR lặp đi lặp lại

“Triển khai tính năng X: thêm điểm cuối

POST /api/exportluồng xuất kết quả và được xác thực. Tạo điểm cuối, thêm tài liệu, tạo bài kiểm tra và mở PR với tóm tắt và danh sách kiểm tra các mục thủ công.”

Đối với hầu hết những điều này, hãy bắt đầu với trung bình nỗ lực; chuyển sang cao khi bạn cần mô hình thực hiện suy luận sâu trên nhiều tệp và nhiều lần lặp lại thử nghiệm.

Làm thế nào để bạn truy cập GPT-5.1-Codex-Max

Nơi nó có sẵn ngày hôm nay

OpenAI đã tích hợp GPT-5.1-Codex-Max vào Công cụ Codex Hiện nay: Codex CLI, tiện ích mở rộng IDE, đám mây và quy trình đánh giá mã mặc định sử dụng Codex-Max (bạn có thể chọn Codex-Mini). API cần được chuẩn bị sẵn sàng; GitHub Copilot có bản xem trước công khai bao gồm các mô hình GPT-5.1 và Codex series.

Các nhà phát triển có thể truy cập GPT-5.1-Codex-Max và API GPT-5.1-Codex thông qua CometAPI. Để bắt đầu, hãy khám phá khả năng mô hình củaSao chổiAPI trong Sân chơi và tham khảo hướng dẫn API để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập vào CometAPI và lấy được khóa API. VớietAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng chưa?→ Đăng ký CometAPI ngay hôm nay !

Nếu bạn muốn biết thêm mẹo, hướng dẫn và tin tức về AI, hãy theo dõi chúng tôi trên VK, X và Discord!

Bắt đầu nhanh (thực hành từng bước)

- Hãy đảm bảo bạn có quyền truy cập: xác nhận gói sản phẩm ChatGPT/Codex (Plus, Pro, Business, Edu, Enterprise) hoặc gói API dành cho nhà phát triển của bạn có hỗ trợ các mô hình họ GPT-5.1/Codex hay không.

- Cài đặt tiện ích mở rộng Codex CLI hoặc IDE: Nếu bạn muốn chạy các tác vụ mã cục bộ, hãy cài đặt Codex CLI hoặc tiện ích mở rộng Codex IDE cho VS Code / JetBrains / Xcode (nếu có). Công cụ sẽ mặc định là GPT-5.1-Codex-Max trong các thiết lập được hỗ trợ.

- Chọn nỗ lực lý luận: bắt đầu với trung bình nỗ lực cho hầu hết các tác vụ. Đối với việc gỡ lỗi sâu, các quá trình tái cấu trúc phức tạp hoặc khi bạn muốn mô hình suy nghĩ kỹ hơn và không quan tâm đến độ trễ phản hồi, hãy chuyển sang cao or cao chế độ. Để sửa chữa nhỏ nhanh chóng, thấp là hợp lý.

- Cung cấp bối cảnh kho lưu trữ: Cung cấp cho mô hình một điểm khởi đầu rõ ràng — một URL kho lưu trữ hoặc một tập hợp các tệp và một hướng dẫn ngắn gọn (ví dụ: "cải tiến mô-đun thanh toán để sử dụng I/O bất đồng bộ và thêm các bài kiểm tra đơn vị, giữ nguyên các hợp đồng cấp hàm"). Codex-Max sẽ nén lịch sử khi đạt đến giới hạn ngữ cảnh và tiếp tục công việc.

- Lặp lại với các bài kiểm tra: Sau khi mô hình tạo bản vá, hãy chạy bộ kiểm thử và phản hồi lỗi như một phần của phiên đang diễn ra. Tính năng nén và tính liên tục đa cửa sổ cho phép Codex-Max giữ lại bối cảnh kiểm thử lỗi quan trọng và lặp lại.

Kết luận:

GPT-5.1-Codex-Max là một bước tiến đáng kể hướng tới các trợ lý mã hóa agentic, có thể xử lý các tác vụ kỹ thuật phức tạp, chạy lâu dài với hiệu suất và khả năng lập luận được cải thiện. Những tiến bộ kỹ thuật (nén dữ liệu, chế độ nỗ lực lập luận, đào tạo môi trường Windows) khiến nó đặc biệt phù hợp với các tổ chức kỹ thuật hiện đại — miễn là các nhóm kết hợp mô hình với các biện pháp kiểm soát vận hành thận trọng, chính sách rõ ràng về con người trong vòng lặp và giám sát chặt chẽ. Đối với các nhóm áp dụng nó một cách cẩn thận, Codex-Max có tiềm năng thay đổi cách thiết kế, kiểm thử và bảo trì phần mềm — biến công việc kỹ thuật lặp đi lặp lại thành sự hợp tác có giá trị cao hơn giữa con người và mô hình.