Trong thế giới trí tuệ nhân tạo đang phát triển nhanh chóng, việc phát hành mỗi mô hình ngôn ngữ lớn (LLM) mới không chỉ đơn thuần là một sự gia tăng về số lượng mà còn là dấu hiệu của sự tiến bộ trong tư duy, khả năng lập trình và sự hợp tác giữa con người và máy móc. Vào cuối tháng 9 năm 2025, Zhipu AI (Z.ai) Tiết lộ GLM-4.6, thành viên mới nhất của gia đình Mô hình Ngôn ngữ Chung. Dựa trên kiến trúc mạnh mẽ và nền tảng lập luận vững chắc của GLM-4.5, bản cập nhật này tinh chỉnh khả năng của mô hình trong suy luận tác nhân, trí thông minh mã hóa và hiểu biết ngữ cảnh dài, trong khi vẫn mở và dễ tiếp cận đối với cả nhà phát triển và doanh nghiệp.

GLM-4.6 là gì?

GLM-4.6 là phiên bản chính trong loạt GLM (Mô hình Ngôn ngữ Chung) được thiết kế để cân bằng giữa khả năng lập luận dung lượng cao với quy trình làm việc thực tế của nhà phát triển. Ở cấp độ tổng quan, bản phát hành này nhắm đến ba trường hợp sử dụng có liên quan chặt chẽ: (1) tạo mã nâng cao và lập luận về mã, (2) các tác vụ ngữ cảnh mở rộng đòi hỏi sự hiểu biết về mô hình trên các đầu vào rất dài, và (3) quy trình làm việc tác nhân, trong đó mô hình phải lập kế hoạch, gọi công cụ và điều phối các quy trình nhiều bước. Mô hình được phân phối theo các biến thể dành cho API đám mây và trung tâm mô hình cộng đồng, cho phép cả mô hình triển khai lưu trữ và tự lưu trữ.

Trên thực tế, GLM-4.6 được định vị là phiên bản flagship "ưu tiên nhà phát triển": những cải tiến của nó không chỉ nằm ở các số liệu benchmark thô mà còn ở các khả năng thay đổi đáng kể cách các nhà phát triển xây dựng trợ lý, chương trình đồng điều khiển mã (code copilot) và các tác nhân dựa trên tài liệu hoặc kiến thức. Hãy kỳ vọng một phiên bản tập trung vào việc tinh chỉnh hướng dẫn sử dụng công cụ, cải tiến chi tiết về chất lượng mã và gỡ lỗi, cùng các lựa chọn cơ sở hạ tầng cho phép các ngữ cảnh rất dài mà không làm giảm hiệu suất tuyến tính.

GLM-4.6 hướng tới mục đích giải quyết vấn đề gì?

- Giảm thiểu sự khó khăn khi làm việc với các cơ sở mã dài và các tài liệu lớn bằng cách hỗ trợ các cửa sổ ngữ cảnh hiệu quả dài hơn.

- Cải thiện độ tin cậy của quá trình tạo mã và gỡ lỗi, tạo ra đầu ra dễ kiểm tra và chuẩn xác hơn.

- Tăng cường tính mạnh mẽ của các hành vi tác nhân — lập kế hoạch, sử dụng công cụ và thực hiện nhiệm vụ nhiều bước — thông qua hướng dẫn có mục tiêu và điều chỉnh theo kiểu củng cố.

Từ GLM-4.5 đến GLM-4.6, thực tế có gì thay đổi?

- Tỷ lệ ngữ cảnh: 128K nhảy tới 200 nghìn mã thông báo là thay đổi lớn nhất về UX/kiến trúc dành cho người dùng: các tài liệu dài, toàn bộ cơ sở mã, hoặc bản ghi tác nhân mở rộng giờ đây có thể được xử lý như một cửa sổ ngữ cảnh duy nhất. Điều này giúp giảm nhu cầu phân đoạn ngẫu nhiên hoặc các vòng lặp truy xuất tốn kém cho nhiều quy trình công việc.

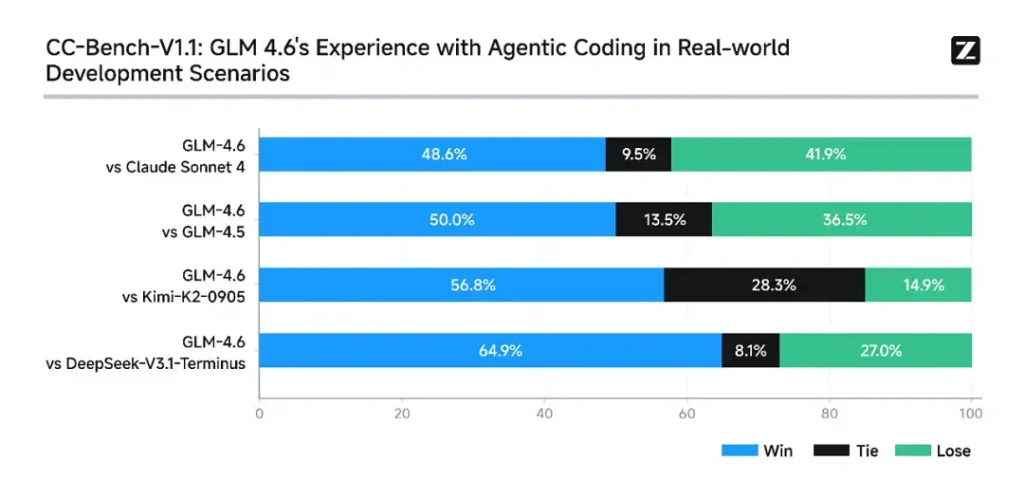

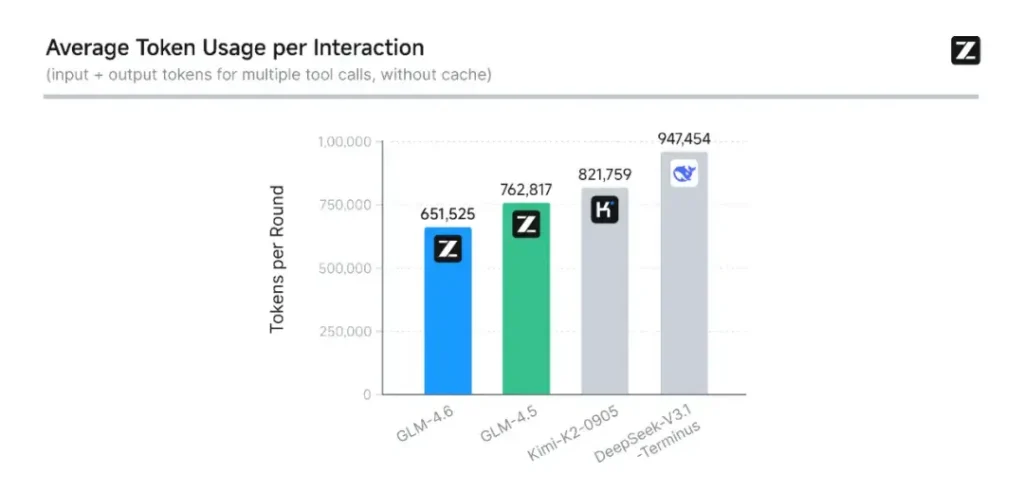

- Mã hóa và đánh giá thực tế: Z.ai đã mở rộng CC-Bench (chuẩn mực hoàn thành và mã hóa của họ) với các quỹ đạo nhiệm vụ thực tế khó hơn và báo cáo rằng GLM-4.6 hoàn thành các nhiệm vụ với ~15% ít mã thông báo hơn so với GLM-4.5, đồng thời cải thiện tỷ lệ thành công trong các tác vụ kỹ thuật phức tạp với nhiều vòng lặp. Điều này cho thấy hiệu quả mã thông báo tốt hơn cũng như khả năng cải thiện thô sơ trong các tình huống mã hóa ứng dụng. Z.ai

- Tích hợp tác nhân và công cụ: GLM-4.6 bao gồm các mẫu hỗ trợ tốt hơn cho việc gọi công cụ và tác nhân tìm kiếm—điều quan trọng đối với các sản phẩm dựa vào mô hình này để điều phối tìm kiếm trên web, thực thi mã hoặc các dịch vụ vi mô khác.

Những tính năng chính của GLM-4.6 là gì?

1. Mở rộng cửa sổ ngữ cảnh lên 200K mã thông báo

Một trong những tính năng đáng chú ý nhất của GLM-4.6 là cửa sổ ngữ cảnh mở rộng lớn. Mở rộng từ 128K ở thế hệ trước lên 200 nghìn mã thông báoGLM-4.6 có thể xử lý toàn bộ sách, bộ dữ liệu phức tạp gồm nhiều tài liệu, hoặc hàng giờ hội thoại chỉ trong một phiên làm việc. Sự mở rộng này không chỉ nâng cao khả năng hiểu mà còn cho phép lý luận nhất quán trên các đầu vào dài — một bước tiến lớn trong việc tóm tắt tài liệu, phân tích pháp lý và quy trình công việc kỹ thuật phần mềm.

2. Cải thiện trí thông minh mã hóa

Nội bộ của Zhipu AI CC-Bench chuẩn mực, một bộ các nhiệm vụ lập trình thực tế, cho thấy GLM-4.6 đạt được cải tiến đáng kể về độ chính xác và hiệu quả mã hóa. Mô hình có thể tạo ra mã cú pháp chính xác, hợp lý về mặt logic trong khi sử dụng khoảng 15% ít mã thông báo hơn so với GLM-4.5 cho các tác vụ tương đương. Hiệu quả vượt trội này đồng nghĩa với việc hoàn thành nhanh hơn, tiết kiệm hơn mà không ảnh hưởng đến chất lượng — một yếu tố quan trọng cho việc triển khai trong doanh nghiệp.

3. Lý luận nâng cao và tích hợp công cụ

Ngoài việc tạo văn bản thô, GLM-4.6 còn tỏa sáng trong lý luận được tăng cường bằng công cụNó đã được đào tạo và điều chỉnh để lập kế hoạch nhiều bước và điều phối các hệ thống bên ngoài — từ cơ sở dữ liệu đến công cụ tìm kiếm đến môi trường thực thi. Trên thực tế, điều này có nghĩa là GLM-4.6 có thể hoạt động như "bộ não" của một tác nhân AI tự động, quyết định thời điểm gọi API bên ngoài, cách diễn giải kết quả và cách duy trì tính liên tục của tác vụ trong các phiên.

4. Cải thiện căn chỉnh ngôn ngữ tự nhiên

Thông qua việc học tăng cường liên tục và tối ưu hóa sở thích, GLM-4.6 cung cấp luồng hội thoại mượt mà hơn, phong cách phù hợp hơn và sự liên kết an toàn mạnh mẽ hơn. Mô hình này điều chỉnh giọng điệu và cấu trúc để phù hợp với bối cảnh — cho dù đó là tài liệu chính thức, hướng dẫn giáo dục hay viết sáng tạo — nhằm cải thiện độ tin cậy và khả năng đọc của người dùng.

Kiến trúc nào hỗ trợ GLM-4.6?

GLM-4.6 có phải là mô hình hỗn hợp chuyên gia không?

Tính liên tục của phương pháp suy luận: Nhóm GLM cho biết GLM-4.5 và GLM-4.6 chia sẻ cùng một quy trình suy luận cơ bản, cho phép nâng cấp các thiết lập triển khai hiện có với ít ma sát nhất. Điều này giúp giảm thiểu rủi ro vận hành cho các nhóm đã sử dụng GLM-4.x—các tham số mở rộng và lựa chọn thiết kế mô hình nhấn mạnh vào chuyên môn hóa cho lập luận tác tử, mã hóa và suy luận hiệu quả. Báo cáo GLM-4.5 cung cấp mô tả công khai rõ ràng nhất về chiến lược MoE và chế độ đào tạo của họ (tiền đào tạo nhiều giai đoạn, lặp lại mô hình chuyên gia, học tăng cường để căn chỉnh); GLM-4.6 áp dụng các bài học đó đồng thời điều chỉnh độ dài ngữ cảnh và khả năng cụ thể của từng tác vụ.

Ghi chú kiến trúc thực tế cho kỹ sư

- Dấu chân tham số so với tính toán được kích hoạt: Tổng số tham số lớn (hàng trăm tỷ) không trực tiếp chuyển thành chi phí kích hoạt tương đương trên mọi yêu cầu—MoE nghĩa là chỉ một tập hợp con các chuyên gia kích hoạt trên mỗi chuỗi mã thông báo, mang lại sự đánh đổi về chi phí/thông lượng thuận lợi hơn cho nhiều khối lượng công việc.

- Độ chính xác và định dạng của mã thông báo: Trọng số công khai được phân phối theo định dạng BF16 và F32, và lượng tử hóa cộng đồng (GGUF, 4-/8-/bit) đang xuất hiện nhanh chóng; điều này cho phép các nhóm chạy GLM-4.6 trên nhiều cấu hình phần cứng khác nhau.

- Khả năng tương thích của ngăn xếp suy luận: Z.ai ghi lại vLLM và các thời gian chạy LLM hiện đại khác như các chương trình suy luận tương thích, giúp GLM-4.6 khả thi cho cả triển khai trên nền tảng đám mây và tại chỗ.

Hiệu suất chuẩn: GLM-4.6 hoạt động như thế nào?

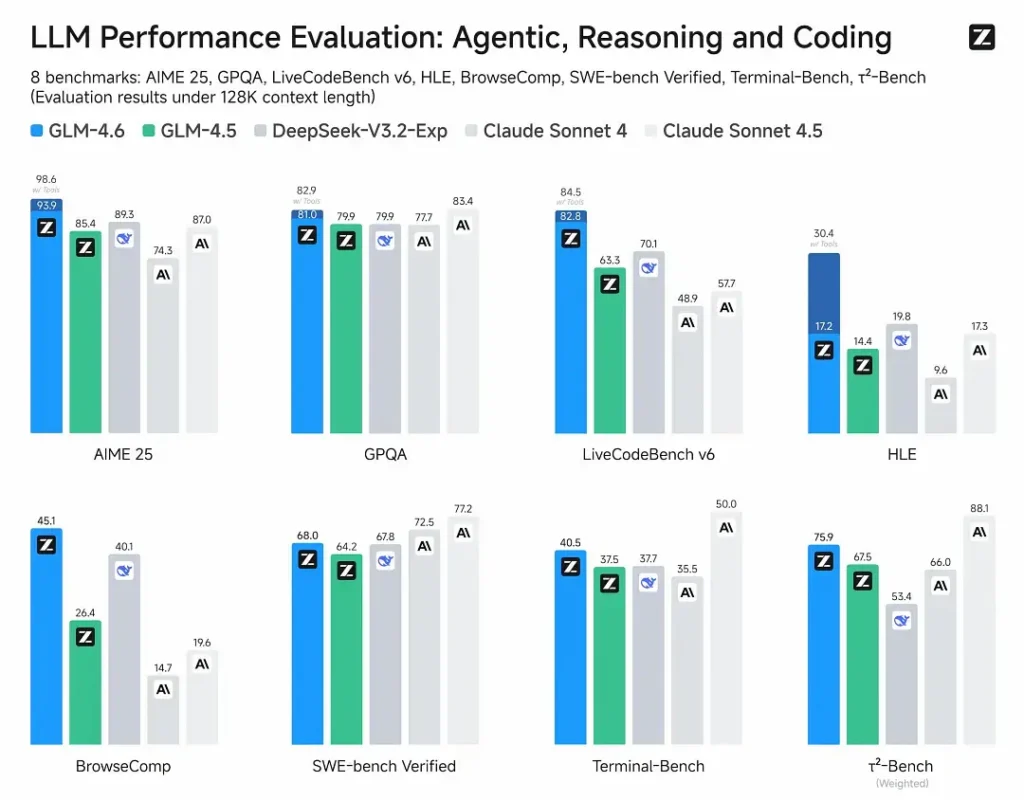

Những tiêu chuẩn nào đã được báo cáo?

Z.ai đã đánh giá GLM-4.6 trên một bộ tám chuẩn mực công khai trải dài trên các tác vụ tác nhân, lập luận và mã hóa. Họ cũng mở rộng CC-Bench (một chuẩn mực mã hóa tác vụ thực tế do con người đánh giá, chạy trong môi trường biệt lập Docker) để mô phỏng tốt hơn các tác vụ kỹ thuật sản xuất (phát triển front-end, thử nghiệm, giải quyết vấn đề thuật toán). Trên các tác vụ này, GLM-4.6 đã cho thấy những cải tiến nhất quán so với GLM-4.5.

Hiệu suất mã hóa

- Chiến thắng trong nhiệm vụ thực tế: Trong các đánh giá của con người trên CC-Bench, GLM-4.6 đã đạt gần ngang bằng với Claude Sonnet 4 của Anthropic trong các nhiệm vụ đối đầu, nhiều lượt—Z.ai báo cáo một 48.6% tỷ lệ chiến thắng trong các đánh giá do con người thực hiện, được cô lập trên Docker (giải thích: gần 50/50 với Claude Sonnet 4 trên bộ dữ liệu được họ tuyển chọn). Đồng thời, GLM-4.6 vượt trội hơn một số mô hình mở nội bộ (ví dụ: các biến thể DeepSeek) trong các tác vụ của chúng.

- Hiệu quả của mã thông báo: Z.ai báo cáo ~15% ít mã thông báo hơn được sử dụng để hoàn thành nhiệm vụ so với GLM-4.5 trong quỹ đạo CC-Bench—điều này quan trọng đối với cả độ trễ và chi phí.

Lý luận và toán học

GLM-4.6 được cho là cải thiện khả năng suy luận và hiệu suất sử dụng công cụ mạnh hơn so với GLM-4.5. Trong khi GLM-4.5 nhấn mạnh vào chế độ "suy nghĩ" kết hợp và chế độ trả lời trực tiếp, GLM-4.6 tăng cường độ mạnh mẽ cho suy luận nhiều bước—đặc biệt là khi tích hợp với các công cụ tìm kiếm hoặc thực thi.

Tin nhắn công khai của Z.ai định vị GLM-4.6 là cạnh tranh với các mô hình quốc tế và trong nước hàng đầu trên các chuẩn mực đã chọn của họ—cụ thể là cạnh tranh với Claude Sonnet 4 và vượt trội hơn một số lựa chọn thay thế trong nước như các biến thể DeepSeek trong các tác vụ mã/tác nhân. Tuy nhiên, trong một số chuẩn mực phụ dành riêng cho mã hóa**, GLM-4.6 vẫn kém hơn Claude Sonnet 4.5 (một phiên bản Anthropic mới hơn), tạo nên một môi trường cạnh tranh gay gắt hơn là sự thống trị tuyệt đối.

Cách truy cập GLM-4.6

- 1. Thông qua Nền tảng Z.ai: Các nhà phát triển có thể truy cập GLM-4.6 trực tiếp qua API của Z.ai or **giao diện trò chuyện (chat.z.ai)**Các dịch vụ lưu trữ này cho phép thử nghiệm và tích hợp nhanh chóng mà không cần triển khai cục bộ. API hỗ trợ cả chế độ hoàn thành văn bản tiêu chuẩn và chế độ gọi công cụ có cấu trúc — thiết yếu cho quy trình làm việc của agentic.

- 2. Mở trọng lượng trên khuôn mặt ôm và ModelScope: Đối với những người thích kiểm soát cục bộ, Zhipu AI đã phát hành các tệp mô hình GLM-4.6 trên Ôm mặt và Phạm vi mô hình, bao gồm các phiên bản safetensor trong BF16 và F32 độ chính xác. Các nhà phát triển cộng đồng đã tạo ra các phiên bản GGUF lượng tử, cho phép suy luận trên GPU cấp tiêu dùng.

- 3. Khung tích hợp: GLM-4.6 tích hợp trơn tru với các công cụ suy luận chính như vLLM, SGlangvà Triển khai LMD, giúp nó có thể thích ứng với các ngăn xếp phục vụ hiện đại. Tính linh hoạt này cho phép các doanh nghiệp lựa chọn giữa điện toán đám mây, cạnhvà triển khai tại chỗ tùy thuộc vào yêu cầu về tuân thủ hoặc độ trễ.

CometAPI là một nền tảng API hợp nhất tổng hợp hơn 500 mô hình AI từ các nhà cung cấp hàng đầu—chẳng hạn như dòng GPT của OpenAI, Gemini của Google, Claude của Anthropic, Midjourney, Suno, v.v.—thành một giao diện duy nhất thân thiện với nhà phát triển. Bằng cách cung cấp xác thực nhất quán, định dạng yêu cầu và xử lý phản hồi, CometAPI đơn giản hóa đáng kể việc tích hợp các khả năng AI vào ứng dụng của bạn. Cho dù bạn đang xây dựng chatbot, trình tạo hình ảnh, nhà soạn nhạc hay đường ống phân tích dựa trên dữ liệu, CometAPI cho phép bạn lặp lại nhanh hơn, kiểm soát chi phí và không phụ thuộc vào nhà cung cấp—tất cả trong khi khai thác những đột phá mới nhất trên toàn bộ hệ sinh thái AI.

Phiên bản tích hợp mới nhất GLM-4.6 sẽ sớm xuất hiện trên CometAPI, vì vậy hãy chú ý theo dõi! Trong khi chúng tôi hoàn thiện việc tải lên Mô hình GLM 4.6, hãy khám phá các mô hình khác của chúng tôi trên trang Mô hình hoặc dùng thử chúng trong AI Playground.

Các nhà phát triển có thể truy cập API GLM‑4.5 thông qua CometAPI, phiên bản mẫu mới nhất luôn được cập nhật trên trang web chính thức. Để bắt đầu, hãy khám phá các khả năng của mô hình trong Sân chơi và tham khảo ý kiến Hướng dẫn API để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập vào CometAPI và lấy được khóa API. Sao chổiAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng chưa?→ Đăng ký CometAPI ngay hôm nay !

Kết luận — Tại sao GLM-4.6 lại quan trọng vào lúc này

GLM-4.6 là một cột mốc quan trọng trong dòng GLM vì nó kết hợp những cải tiến thiết thực dành cho nhà phát triển — cửa sổ ngữ cảnh dài hơn, tối ưu hóa mã hóa và tác nhân được nhắm mục tiêu, cùng những cải tiến rõ rệt về điểm chuẩn — với tính mở và tính linh hoạt của hệ sinh thái mà nhiều tổ chức mong muốn. Đối với các nhóm xây dựng trợ lý mã, tác nhân tài liệu dài, hoặc tự động hóa dựa trên công cụ, GLM-4.6 đáng được đánh giá là một ứng cử viên hàng đầu.