GPT-5.2 là bản phát hành nhỏ tháng 12/2025 của OpenAI trong gia đình GPT-5: một dòng mô hình đa phương thức chủ lực (văn bản + thị giác + công cụ) được tinh chỉnh cho công việc kiến thức chuyên nghiệp, suy luận ngữ cảnh dài, sử dụng công cụ mang tính tác tử, và kỹ nghệ phần mềm. OpenAI định vị GPT-5.2 là mô hình mạnh nhất trong dòng GPT-5 cho đến nay và cho biết nó được phát triển với trọng tâm vào suy luận nhiều bước đáng tin cậy, xử lý tài liệu rất lớn và cải thiện an toàn/tuân thủ chính sách; bản phát hành bao gồm ba biến thể hướng tới người dùng — Instant, Thinking, và Pro — và đang được triển khai trước cho người dùng trả phí của ChatGPT và khách hàng API.

GPT-5.2 là gì và vì sao quan trọng?

GPT-5.2 là thành viên mới nhất của gia đình GPT-5 của OpenAI — một dòng mô hình “tiên phong” được thiết kế riêng để thu hẹp khoảng cách giữa trợ lý hội thoại một lượt và các hệ thống phải suy luận trên tài liệu dài, gọi công cụ, diễn giải hình ảnh, và thực thi quy trình nhiều bước một cách đáng tin cậy. OpenAI định vị 5.2 là bản phát hành mạnh nhất của họ cho công việc kiến thức chuyên nghiệp: nó thiết lập các kết quả dẫn đầu trên các thang đo nội bộ (đáng chú ý là thang đo GDPval mới cho công việc kiến thức), thể hiện hiệu năng mã hóa mạnh hơn trên các thang đo kỹ nghệ phần mềm, và mang lại cải thiện đáng kể về khả năng ngữ cảnh dài và thị giác.

Về thực tiễn, GPT-5.2 không chỉ là “một mô hình chat lớn hơn.” Đây là một họ gồm ba biến thể tinh chỉnh (Instant, Thinking, Pro) đánh đổi giữa độ trễ, độ sâu suy luận và chi phí — và cùng với API và định tuyến của ChatGPT, có thể dùng để chạy các tác vụ nghiên cứu dài, xây dựng tác tử gọi công cụ bên ngoài, diễn giải hình ảnh và biểu đồ phức tạp, và tạo mã sản xuất với độ trung thực cao hơn so với các bản phát hành trước. Mô hình hỗ trợ cửa sổ ngữ cảnh rất lớn (tài liệu của OpenAI liệt kê cửa sổ ngữ cảnh 400.000 token và giới hạn đầu ra tối đa 128.000 cho các mô hình chủ lực), các tính năng API mới cho mức độ nỗ lực suy luận rõ ràng, và hành vi gọi công cụ mang tính “tác tử”.

5 năng lực cốt lõi được nâng cấp trong GPT-5.2

1) GPT-5.2 có tốt hơn ở logic đa bước và toán học không?

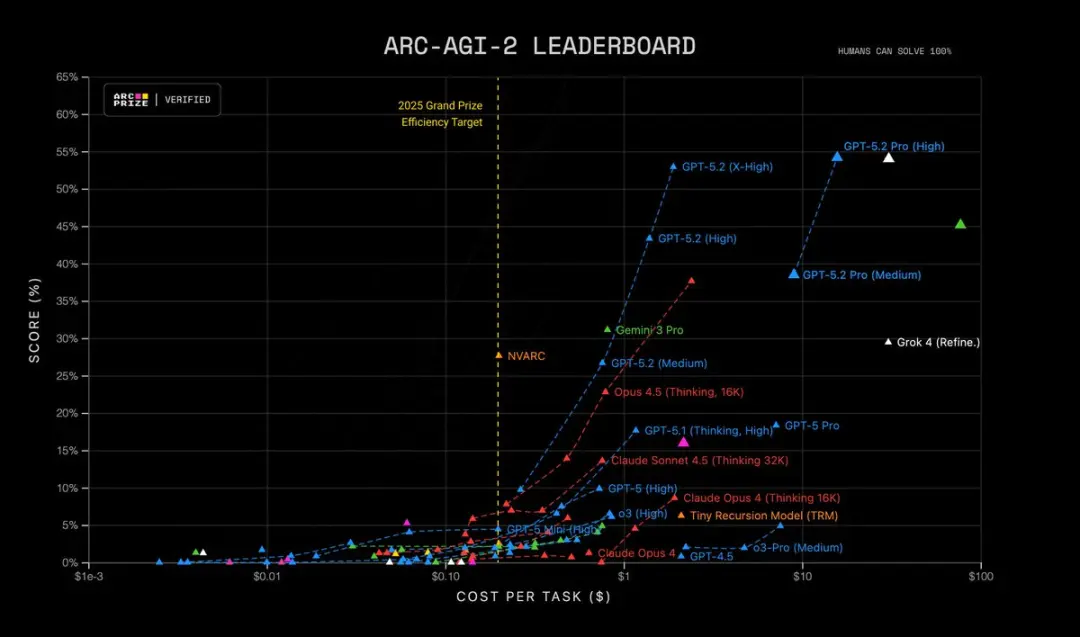

GPT-5.2 mang lại suy luận nhiều bước sắc bén hơn và hiệu năng cải thiện thấy rõ ở toán học và giải bài toán có cấu trúc. OpenAI cho biết họ đã bổ sung điều khiển chi tiết hơn đối với nỗ lực suy luận (các mức mới như xhigh), hỗ trợ “token suy luận”, và tinh chỉnh mô hình để duy trì chuỗi suy nghĩ trong các vết suy luận nội bộ dài hơn. Các thang đo như FrontierMath và các bài kiểm tra kiểu ARC-AGI cho thấy mức tăng đáng kể so với GPT-5.1; nó tạo khoảng cách lớn hơn trên các thang đo theo lĩnh vực dùng trong quy trình khoa học và tài chính. Tóm lại: GPT-5.2 “suy nghĩ lâu hơn” khi được yêu cầu, và có thể xử lý công việc ký hiệu/toán học phức tạp với độ nhất quán tốt hơn.

| RC-AGI-1 (Đã kiểm chứng) Lý luận trừu tượng | 86.2% | 72.8% |

|---|---|---|

| ARC-AGI-2 (Đã kiểm chứng) Lý luận trừu tượng | 52.9% | 17.6% |

GPT-5.2 Thinking lập kỷ lục ở nhiều bài kiểm tra suy luận khoa học và toán học nâng cao:

- GPQA Diamond Science Quiz: 92.4% (phiên bản Pro 93.2%)

- ARC-AGI-1 Abstract Reasoning: 86.2% (mô hình đầu tiên vượt ngưỡng 90%)

- ARC-AGI-2 Higher Order Reasoning: 52.9%, thiết lập kỷ lục mới cho mô hình Thinking Chain

- FrontierMath Advanced Mathematics Test: 40.3%, vượt xa tiền nhiệm;

- HMMT Math Competition Problems: 99.4%

- AIME Math Test: 100% Complete Solution

Hơn nữa, GPT-5.2 Pro (High) dẫn đầu trên ARC-AGI-2, đạt điểm 54.2% với chi phí $15.72 mỗi tác vụ! Vượt trội tất cả các mô hình khác.

Vì sao điều này quan trọng: nhiều tác vụ thực tế — mô hình tài chính, thiết kế thí nghiệm, tổng hợp chương trình đòi hỏi suy luận hình thức — bị nghẽn bởi khả năng của mô hình trong việc chuỗi hóa nhiều bước đúng. GPT-5.2 giảm các “bước ảo tưởng” và tạo ra các vết suy luận trung gian ổn định hơn khi bạn yêu cầu nó trình bày cách làm.

2) Khả năng hiểu văn bản dài và suy luận xuyên tài liệu đã cải thiện thế nào?

Hiểu ngữ cảnh dài là một cải tiến hàng đầu. Mô hình nền của GPT-5.2 hỗ trợ cửa sổ ngữ cảnh 400k token và — quan trọng — duy trì độ chính xác cao hơn khi nội dung liên quan nằm sâu trong ngữ cảnh đó. GDPval, một bộ tác vụ cho “công việc kiến thức được đặc tả tốt” trên 44 ngành nghề, nơi GPT-5.2 Thinking đạt mức tương đương hoặc tốt hơn các giám khảo chuyên gia con người trên phần lớn tác vụ. Báo cáo độc lập xác nhận mô hình giữ và tổng hợp thông tin xuyên nhiều tài liệu tốt hơn nhiều so với các mô hình trước. Đây là một bước tiến thực tế cho các tác vụ như thẩm định, tóm tắt pháp lý, tổng quan tài liệu, và hiểu mã nguồn.

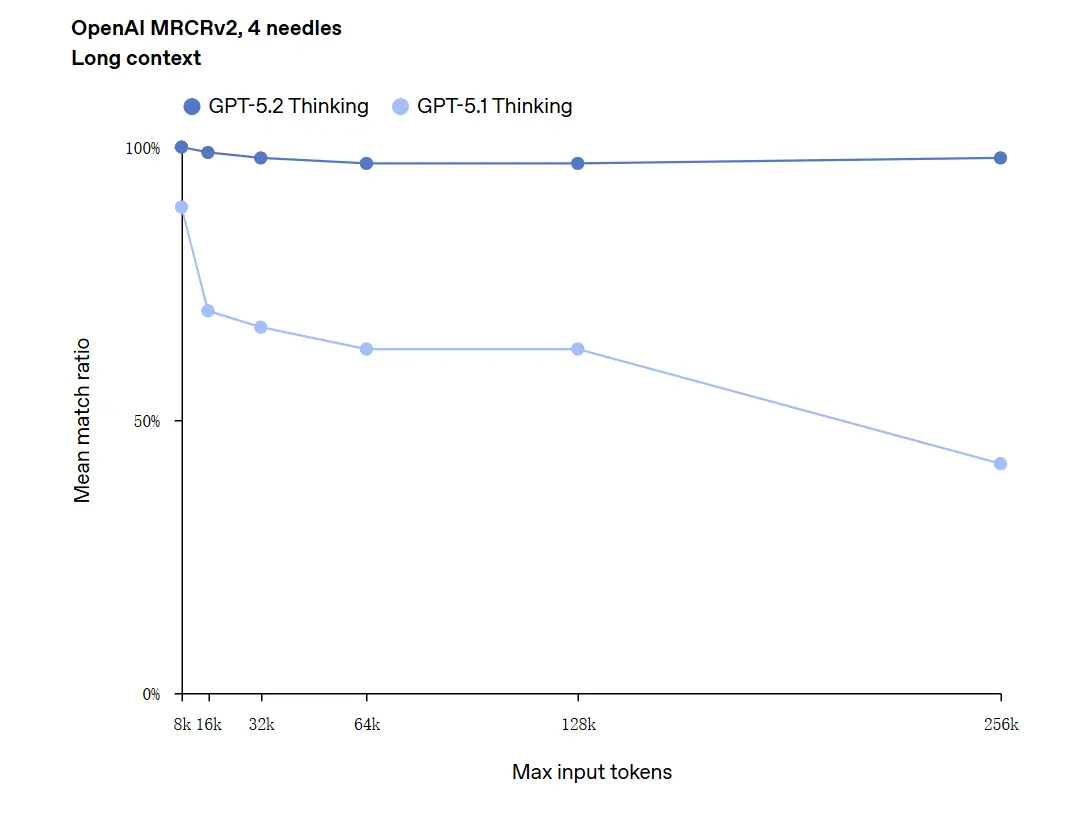

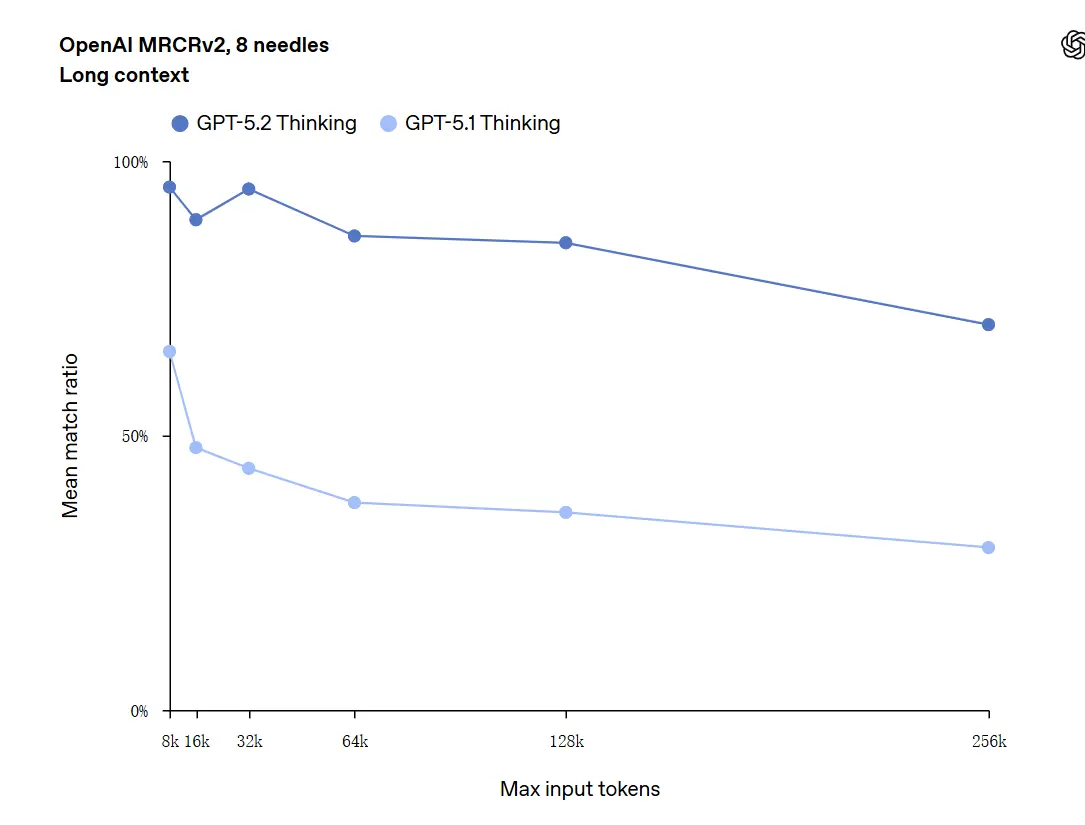

GPT-5.2 có thể xử lý ngữ cảnh lên đến 256.000 token (xấp xỉ hơn 200 trang tài liệu). Hơn nữa, trong bài kiểm tra hiểu văn bản dài "OpenAI MRCRv2", GPT-5.2 Thinking đạt độ chính xác gần 100%.

Lưu ý về “độ chính xác 100%”: Các mô tả nói rằng cải thiện “tiệm cận 100%” cho các vi-tác vụ hẹp; dữ liệu của OpenAI nên được diễn đạt là “dẫn đầu và trong nhiều trường hợp ở mức hoặc vượt chuyên gia con người trên các tác vụ đã đánh giá,” không phải hoàn hảo tuyệt đối cho mọi trường hợp sử dụng. Các thang đo cho thấy mức tăng lớn nhưng không hoàn hảo phổ quát.

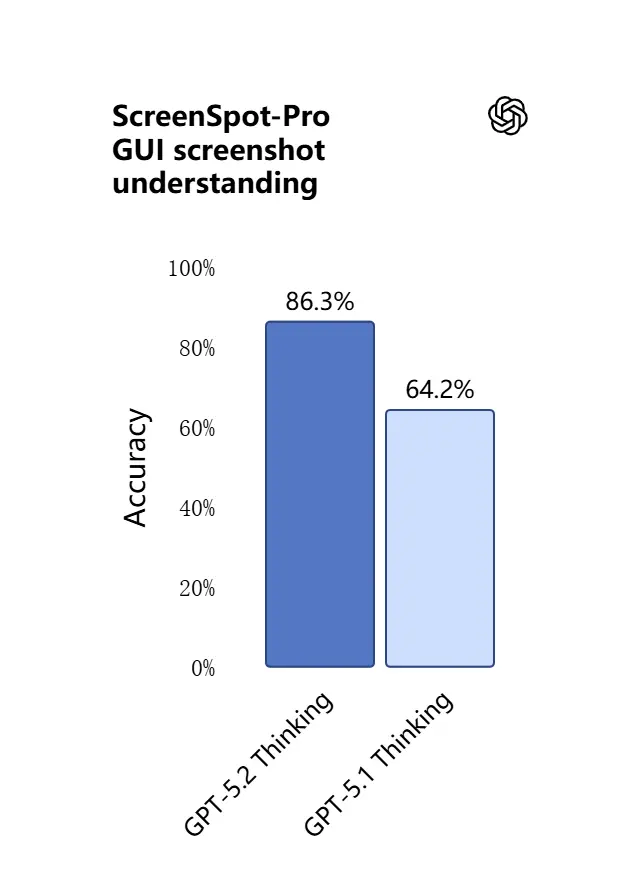

3) Có gì mới trong hiểu thị giác và suy luận đa phương thức?

Khả năng thị giác trong GPT-5.2 sắc bén và thực dụng hơn. Mô hình giỏi hơn trong việc diễn giải ảnh chụp màn hình, đọc biểu đồ và bảng, nhận diện thành phần giao diện người dùng, và kết hợp đầu vào thị giác với ngữ cảnh văn bản dài. Không chỉ là chú thích: GPT-5.2 có thể trích xuất dữ liệu có cấu trúc từ hình ảnh (ví dụ: bảng trong PDF), giải thích đồ thị, và suy luận về sơ đồ theo cách hỗ trợ hành động công cụ phía sau (ví dụ: tạo một bảng tính từ báo cáo được chụp ảnh).

.webp)

Hiệu quả thực tế: các nhóm có thể đưa toàn bộ slide deck, báo cáo nghiên cứu quét, hoặc tài liệu nhiều hình ảnh trực tiếp vào mô hình và yêu cầu tổng hợp xuyên tài liệu — giảm mạnh công việc trích xuất thủ công.

4) Gọi công cụ và thực thi tác vụ đã thay đổi ra sao?

GPT-5.2 tiến xa hơn vào hành vi mang tính tác tử: nó giỏi hơn trong lập kế hoạch tác vụ nhiều bước, quyết định khi nào gọi công cụ bên ngoài, và thực thi chuỗi gọi API/công cụ để hoàn thành công việc đầu-cuối một cách đáng tin cậy hơn so với các mô hình trước. Các cải thiện “agentic tool-calling” — mô hình sẽ đề xuất kế hoạch, gọi công cụ (cơ sở dữ liệu, tính toán, hệ thống tệp, trình duyệt, trình chạy mã), và tổng hợp kết quả thành sản phẩm cuối đáng tin cậy hơn. API giới thiệu định tuyến và kiểm soát an toàn (danh sách công cụ được phép, giàn khung công cụ) và giao diện ChatGPT có thể tự động định tuyến yêu cầu đến biến thể 5.2 phù hợp (Instant vs Thinking).

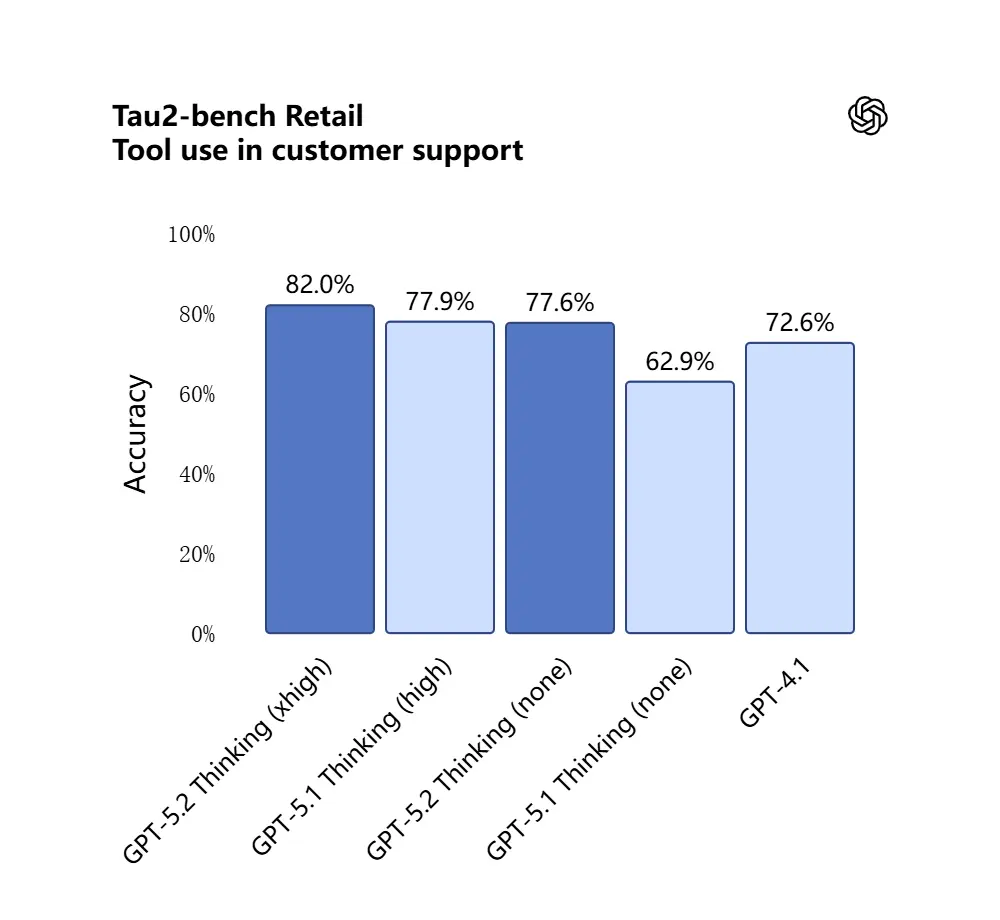

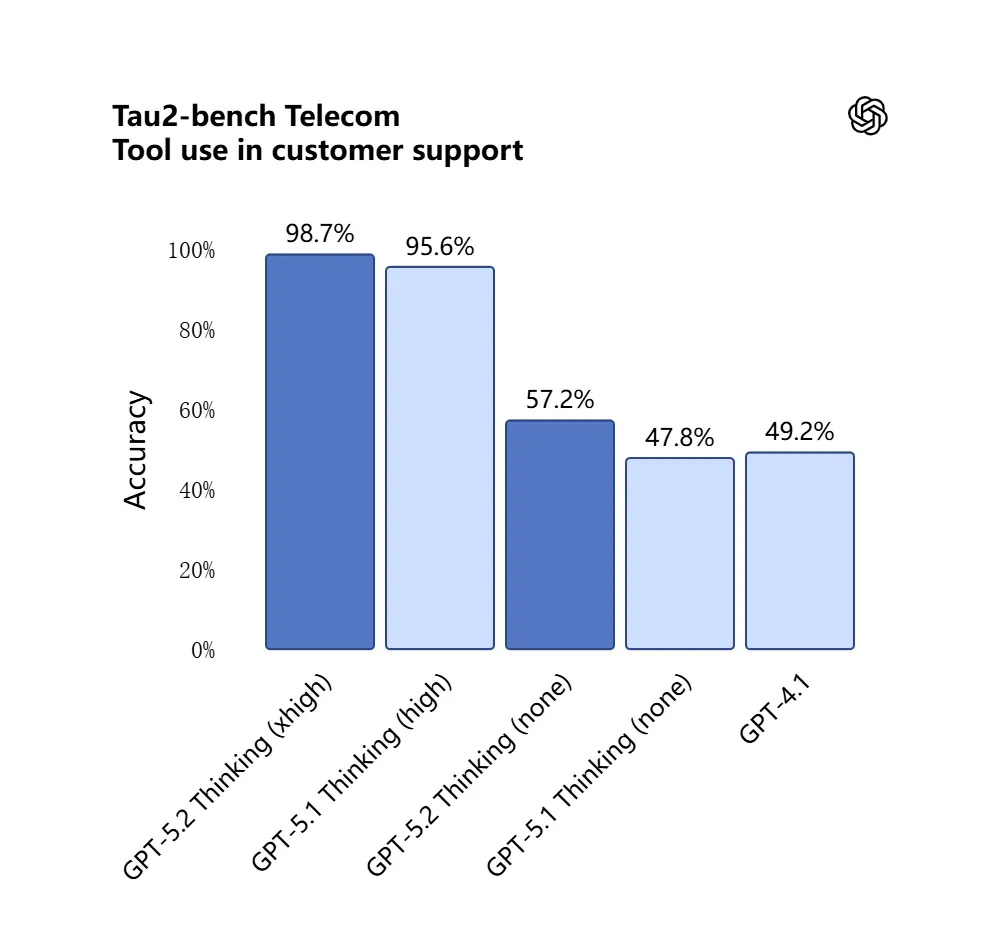

GPT-5.2 đạt 98.7% trong thang đo Tau2-Bench Telecom, cho thấy năng lực gọi công cụ trưởng thành trong các tác vụ đa lượt phức tạp.

Vì sao điều này quan trọng: điều này khiến GPT-5.2 hữu dụng hơn như một trợ lý tự động cho các quy trình như “nạp các hợp đồng này, trích xuất điều khoản, cập nhật bảng tính, và viết email tóm tắt” — các tác vụ trước đây cần dàn dựng cẩn thận.

5) Năng lực lập trình phát triển

GPT-5.2 tốt hơn rõ rệt ở các tác vụ kỹ nghệ phần mềm: nó viết mô-đun đầy đủ hơn, tạo và chạy kiểm thử đáng tin cậy hơn, hiểu đồ thị phụ thuộc dự án phức tạp, và ít mắc “mã hóa lười” (bỏ qua boilerplate hoặc không nối kết mô-đun) hơn. Trên các thang đo mã hóa cấp ngành (SWE-bench Pro, v.v.) GPT-5.2 thiết lập kỷ lục mới. Với các đội dùng LLM làm lập trình viên cặp, cải thiện này có thể giảm xác minh thủ công và làm lại sau khi sinh mã.

Trong bài kiểm tra SWE-Bench Pro (tác vụ kỹ nghệ phần mềm công nghiệp thực tế), điểm của GPT-5.2 Thinking cải thiện lên 55.6%, đồng thời đạt mức cao mới 80% trong bài kiểm tra SWE-Bench Verified.

_Software%20engineering.webp)

Trong ứng dụng thực tế, điều này có nghĩa là:

- Gỡ lỗi tự động mã trong môi trường sản xuất mang lại độ ổn định cao hơn;

- Hỗ trợ lập trình đa ngôn ngữ (không giới hạn ở Python);

- Khả năng tự hoàn thành các tác vụ sửa chữa từ đầu đến cuối.

Sự khác biệt giữa GPT-5.2 và GPT-5.1 là gì?

Câu trả lời ngắn: GPT-5.2 là cải tiến lặp nhưng có ý nghĩa. Nó giữ kiến trúc và nền tảng đa phương thức của gia đình GPT-5, nhưng nâng tiến bốn khía cạnh thực tiễn:

- Độ sâu và tính nhất quán của suy luận. 5.2 giới thiệu các mức nỗ lực suy luận cao hơn và chuỗi hóa tốt hơn cho bài toán nhiều bước; 5.1 đã cải thiện suy luận trước đó, nhưng 5.2 nâng trần cho toán học phức tạp và logic đa giai đoạn.

- Độ tin cậy ngữ cảnh dài. Cả hai phiên bản đều mở rộng ngữ cảnh, nhưng 5.2 được tinh chỉnh để duy trì độ chính xác sâu trong đầu vào rất dài (OpenAI tuyên bố giữ thông tin tốt đến hàng trăm nghìn token).

- Thị giác + độ trung thực đa phương thức. 5.2 cải thiện đối chiếu giữa hình ảnh và văn bản — ví dụ, đọc một biểu đồ và tích hợp dữ liệu đó vào bảng tính — thể hiện độ chính xác cao hơn ở cấp độ tác vụ.

- Hành vi công cụ mang tính tác tử và tính năng API. 5.2 công khai các tham số nỗ lực suy luận (

xhigh) và tính năng nén ngữ cảnh trong API, và OpenAI đã tinh chỉnh logic định tuyến trong ChatGPT để giao diện có thể chọn biến thể tốt nhất tự động. - Ít lỗi hơn, ổn định hơn: GPT-5.2 giảm “tỷ lệ ảo giác” (tỷ lệ phản hồi sai) xuống 38%. Nó trả lời các câu hỏi nghiên cứu, viết, và phân tích đáng tin cậy hơn, giảm trường hợp “bịa đặt thông tin”. Trong các tác vụ phức tạp, đầu ra có cấu trúc rõ ràng hơn và logic ổn định hơn. Đồng thời, độ an toàn của phản hồi được cải thiện đáng kể trong các nhiệm vụ liên quan đến sức khỏe tâm thần. Mô hình hoạt động mạnh mẽ hơn trong các tình huống nhạy cảm như tự gây hại, tự tử, và phụ thuộc cảm xúc.

Trong đánh giá hệ thống, GPT-5.2 Instant đạt 0.995 (trên 1.0) ở tác vụ "Mental Health Support", cao hơn đáng kể so với GPT-5.1 (0.883).

Về định lượng, các thang đo được OpenAI công bố cho thấy mức tăng đo được trên GDPval, các thang đo toán (FrontierMath), và đánh giá kỹ nghệ phần mềm. GPT-5.2 vượt GPT-5.1 trong các tác vụ bảng tính ở cấp ngân hàng đầu tư sơ cấp thêm vài điểm phần trăm.

GPT-5.2 có miễn phí không — giá bao nhiêu?

Tôi có thể sử dụng GPT-5.2 miễn phí không?

OpenAI triển khai GPT-5.2 bắt đầu với các gói ChatGPT trả phí và truy cập API. Lịch sử cho thấy OpenAI giữ các mô hình nhanh nhất/sâu nhất sau tường phí trong khi đưa biến thể nhẹ ra rộng rãi hơn sau; với 5.2, công ty nói việc triển khai sẽ bắt đầu trên các gói trả phí (Plus, Pro, Business, Enterprise) và API khả dụng cho nhà phát triển. Điều đó nghĩa là quyền truy cập miễn phí ngay lập tức bị hạn chế: gói miễn phí có thể nhận quyền truy cập suy giảm hoặc được định tuyến (ví dụ đến biến thể nhẹ hơn) sau này khi OpenAI mở rộng triển khai.

Tin vui là CometAPI hiện đã tích hợp với GPT-5.2, và hiện đang có khuyến mãi Giáng Sinh. Bạn có thể dùng GPT-5.2 qua CometAPI; Playground cho phép bạn tương tác tự do với GPT-5.2, và nhà phát triển có thể dùng API GPT-5.2 (CometAPI có giá bằng 20% của OpenAI) để xây dựng quy trình.

Chi phí qua API (nhà phát triển / vận hành sản xuất) là bao nhiêu?

Việc sử dụng API tính phí theo token. Mức giá nền tảng được OpenAI công bố khi ra mắt cho thấy (CometAPI có giá bằng 20% của OpenAI):

- GPT-5.2 (chat tiêu chuẩn) — $1.75 trên 1M token đầu vào và $14 trên 1M token đầu ra (áp dụng giảm giá cho đầu vào được lưu vào bộ nhớ đệm).

- GPT-5.2 Pro (chủ lực) — $21 trên 1M token đầu vào và $168 trên 1M token đầu ra (đắt hơn đáng kể vì hướng đến khối lượng tính toán lớn độ chính xác cao).

- So sánh, GPT-5.1 rẻ hơn (ví dụ, $1.25 vào / $10 ra trên 1M token).

Diễn giải: chi phí API tăng so với các thế hệ trước; mức giá phản ánh rằng hiệu năng suy luận cao cấp và ngữ cảnh dài của 5.2 được định giá như một tầng sản phẩm riêng. Với hệ thống sản xuất, chi phí gói phụ thuộc mạnh vào số token bạn đưa vào/đầu ra và tần suất bạn tái sử dụng đầu vào được lưu đệm (đầu vào lưu đệm được giảm giá mạnh).

Ý nghĩa thực tế

- Với sử dụng thông thường qua giao diện ChatGPT, các gói đăng ký hàng tháng (Plus, Pro, Business, Enterprise) là con đường chính. Giá các tầng đăng ký ChatGPT không thay đổi với bản phát hành 5.2 (OpenAI giữ giá gói ổn định dù mô hình cung cấp thay đổi).

- Với sản xuất & nhà phát triển, hãy dự trù chi phí theo token. Nếu ứng dụng của bạn stream nhiều phản hồi dài hoặc xử lý tài liệu dài, chi phí token đầu ra ($14 / 1M token cho Thinking) sẽ chiếm ưu thế trừ khi bạn lưu đệm đầu vào và tái sử dụng đầu ra một cách cẩn thận.

GPT-5.2 Instant vs GPT-5.2 Thinking vs GPT-5.2 Pro

OpenAI ra mắt GPT-5.2 với ba biến thể theo mục đích để phù hợp trường hợp sử dụng: Instant, Thinking, và Pro:

- GPT-5.2 Instant: Nhanh, hiệu quả chi phí, tinh chỉnh cho công việc hàng ngày — FAQ, hướng dẫn, dịch thuật, soạn thảo nhanh. Độ trễ thấp; bản thảo đầu tốt và quy trình đơn giản.

- GPT-5.2 Thinking: Phản hồi sâu, chất lượng cao cho công việc duy trì — tóm tắt tài liệu dài, lập kế hoạch nhiều bước, rà soát mã chi tiết. Cân bằng độ trễ và chất lượng; ‘cỗ máy’ mặc định cho tác vụ chuyên nghiệp.

- GPT-5.2 Pro: Chất lượng và độ tin cậy cao nhất. Chậm và tốn chi phí hơn; phù hợp nhất cho tác vụ khó, rủi ro cao (kỹ thuật phức tạp, tổng hợp pháp lý, quyết định giá trị cao) và nơi yêu cầu mức nỗ lực suy luận ‘xhigh’.

Bảng so sánh

| Tính năng / Thước đo | GPT-5.2 Instant | GPT-5.2 Thinking | GPT-5.2 Pro |

|---|---|---|---|

| Mục đích | Tác vụ hằng ngày, bản thảo nhanh | Phân tích sâu, tài liệu dài | Chất lượng cao nhất, vấn đề phức tạp |

| Độ trễ | Thấp nhất | Vừa | Cao nhất |

| Nỗ lực suy luận | Tiêu chuẩn | Cao | Có xHigh |

| Phù hợp nhất cho | FAQ, hướng dẫn, dịch thuật, prompt ngắn | Tóm tắt, lập kế hoạch, bảng tính, tác vụ mã hóa | Kỹ thuật phức tạp, tổng hợp pháp lý, nghiên cứu |

| Ví dụ tên API | gpt-5.2-chat-latest | gpt-5.2 | gpt-5.2-pro |

| Giá token đầu vào (API) | $1.75 / 1M | $1.75 / 1M | $21 / 1M |

| Giá token đầu ra (API) | $14 / 1M | $14 / 1M | $168 / 1M |

| Khả dụng (ChatGPT) | Triển khai dần; gói trả phí rồi rộng hơn | Triển khai cho gói trả phí | Người dùng Pro / Enterprise (trả phí) |

| Ví dụ trường hợp sử dụng | Soạn email, đoạn mã nhỏ | Xây mô hình tài chính nhiều sheet, hỏi đáp báo cáo dài | Audit codebase, tạo thiết kế hệ thống cấp sản xuất |

Ai phù hợp để sử dụng GPT-5.2?

GPT-5.2 được thiết kế với tập người dùng mục tiêu rộng. Dưới đây là khuyến nghị theo vai trò:

Doanh nghiệp & đội sản phẩm

Nếu bạn xây sản phẩm cho công việc tri thức (trợ lý nghiên cứu, rà soát hợp đồng, pipeline phân tích, hoặc công cụ cho nhà phát triển), khả năng ngữ cảnh dài và hành vi tác tử của GPT-5.2 có thể giảm đáng kể độ phức tạp tích hợp. Doanh nghiệp cần hiểu tài liệu mạnh mẽ, báo cáo tự động, hoặc copilots thông minh sẽ thấy Thinking/Pro hữu ích. Microsoft và đối tác nền tảng khác đang tích hợp 5.2 vào các bộ năng suất (ví dụ, Microsoft 365 Copilot).

Nhà phát triển và đội kỹ thuật

Các đội muốn dùng LLM như lập trình viên cặp hoặc tự động hóa sinh mã/kiểm thử sẽ hưởng lợi từ độ trung thực lập trình cải thiện trong 5.2. Truy cập API (với chế độ thinking hoặc pro) cho phép tổng hợp sâu hơn trên codebase lớn nhờ cửa sổ ngữ cảnh 400k token. Hãy kỳ vọng chi phí API cao hơn khi dùng Pro, nhưng giảm gỡ lỗi và rà soát thủ công có thể bù chi phí đó cho hệ thống phức tạp.

Nhà nghiên cứu và nhà phân tích dữ liệu chuyên sâu

Nếu bạn thường xuyên tổng hợp tài liệu, phân tích báo cáo kỹ thuật dài, hoặc muốn thiết kế thí nghiệm có trợ giúp mô hình, ngữ cảnh dài và cải thiện toán học của GPT-5.2 giúp tăng tốc quy trình. Với nghiên cứu tái lập, hãy kết hợp mô hình với prompt engineering cẩn thận và bước kiểm chứng.

Doanh nghiệp nhỏ và người dùng nâng cao

ChatGPT Plus (và Pro cho người dùng nâng cao) sẽ được định tuyến đến các biến thể 5.2; điều này khiến tự động hóa nâng cao và đầu ra chất lượng cao trở nên dễ tiếp cận cho đội nhỏ mà không cần tích hợp API. Với người dùng không kỹ thuật cần tóm tắt tài liệu hoặc dựng slide tốt hơn, GPT-5.2 mang lại giá trị thực tế thấy rõ.

Ghi chú thực tiễn cho nhà phát triển và vận hành

Tính năng API đáng chú ý

- Các mức

reasoning.effort(ví dụ,medium,high,xhigh) cho phép bạn yêu cầu mô hình tiêu tốn bao nhiêu tính toán cho suy luận nội bộ; dùng để đánh đổi độ trễ lấy độ chính xác theo từng yêu cầu. - Context compaction: API bao gồm công cụ nén và cô đọng lịch sử để nội dung thực sự liên quan được giữ lại cho chuỗi dài. Điều này rất quan trọng khi bạn phải giữ mức sử dụng token hiệu quả trong tầm kiểm soát.

- Tool scaffolding & allowed-tools controls: hệ thống sản xuất nên whitelist rõ ràng công cụ mô hình có thể gọi và ghi log lần gọi công cụ để audit.

Mẹo kiểm soát chi phí

- Lưu đệm embedding tài liệu dùng thường xuyên và dùng đầu vào đã lưu đệm (nhận giảm giá mạnh) cho các truy vấn lặp lại trên cùng corpus. Mức giá nền tảng của OpenAI bao gồm giảm đáng kể cho đầu vào lưu đệm.

- Định tuyến truy vấn khám phá/giá trị thấp đến Instant và dành Thinking/Pro cho job theo lô hoặc lượt cuối.

- Ước tính cẩn thận mức dùng token (đầu vào + đầu ra) khi dự phóng chi phí API vì đầu ra dài nhân chi phí.

Kết luận — có nên nâng cấp lên GPT-5.2?

Nếu công việc của bạn phụ thuộc vào suy luận tài liệu dài, tổng hợp xuyên tài liệu, diễn giải đa phương thức (hình ảnh + văn bản), hoặc xây dựng tác tử gọi công cụ, GPT-5.2 là bản nâng cấp rõ ràng: nó tăng độ chính xác thực tiễn và giảm công việc tích hợp thủ công. Nếu bạn chủ yếu chạy chatbot khối lượng lớn, độ trễ thấp hoặc ứng dụng bị hạn chế ngân sách nghiêm ngặt, Instant (hoặc các mô hình trước) có thể vẫn là lựa chọn hợp lý.

GPT-5.2 đại diện cho dịch chuyển có chủ đích từ “chat tốt hơn” sang “trợ lý chuyên nghiệp tốt hơn”: nhiều tính toán hơn, nhiều năng lực hơn, và tầng chi phí cao hơn — nhưng cũng mang lại hiệu quả năng suất thực sự cho các đội có thể tận dụng ngữ cảnh dài đáng tin cậy, toán học/suy luận được cải thiện, hiểu hình ảnh, và thực thi công cụ mang tính tác tử.

Để bắt đầu, hãy khám phá khả năng của các mô hình GPT-5.2(GPT-5.2;GPT-5.2 pro, GPT-5.2 chat ) trong Playground và tham khảo API guide để biết hướng dẫn chi tiết. Trước khi truy cập, vui lòng đảm bảo bạn đã đăng nhập CometAPI và lấy API key. CometAPI cung cấp mức giá thấp hơn nhiều so với giá chính thức để giúp bạn tích hợp.

Sẵn sàng bắt đầu?→ Dùng thử miễn phí các mô hình gpt-5.2 !