OpenAI 的 GPT-5 于 2025 年 8 月上旬发布,并迅速通过多种交付渠道提供使用。无需更换厂商 SDK、让团队快速试验 GPT-5 的方式之一是 CometAPI——一个将 GPT-5 与数百种其他模型并列提供的多模型网关。本文为实操文档,解释 CometAPI 提供了什么、如何 通过它调用 GPT-5、你需要权衡的利弊,以及在将关键工作流迁移到 GPT-5 之前应落实的治理与成本控制。

什么是 GPT-5,与早期模型有何不同?

GPT-5 是 OpenAI 于 2025 年 8 月上旬发布的下一代旗舰大语言模型家族。它被呈现为一个统一的多模态推理系统,结合了快速的非推理组件、更深层的“推理”变体(常被称为“GPT-5 thinking”),以及一个根据复杂度和所需工具决定使用哪个子模型的路由器。OpenAI 宣称的综合效果:更好的推理能力、更大的上下文窗口,以及对编码与智能体任务的改进支持。

架构与关键能力

- 多组件系统: GPT-5 被描述为一个系统,会根据需要将请求路由到不同的内部子模型(快速 vs 深度推理);开发者可通过 API 请求推理模型以获得最大性能。

- 大上下文: 该模型家族支持极大的上下文(数十万 token),可在一次处理内覆盖长文档、代码库或多文件对话。

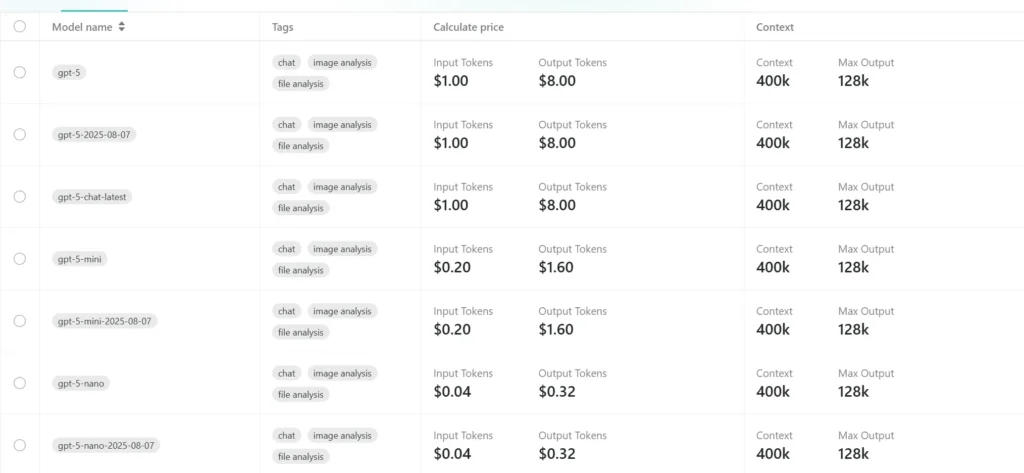

- 多规格家族: OpenAI 发布了多个尺寸的 GPT-5(常规

gpt-5、gpt-5-mini、gpt-5-nano),团队可以在延迟、成本与推理能力之间权衡。

什么是 CometAPI,它真的提供 GPT-5 吗?

简要定义

CometAPI 是一个 API 聚合平台,宣称通过统一的、与 OpenAI 兼容的 REST 接口访问数百个 AI 模型(OpenAI 的 GPT 系列、Anthropic Claude、xAI Grok、图像模型等)。这意味着开发者只需更改模型名称字符串即可切换模型提供商,而无需重写网络代码。在其产品页面上,CometAPI 明确列出可用的 GPT-5 及相关变体(如 gpt-5、gpt-5-chat-latest、gpt-5-mini)作为可调用的端点。

团队为何使用像 CometAPI 这样的网关

类似 CometAPI 的网关服务之所以吸引人,是因为它们可以:

- 快速切换模型,而无需更改大量集成代码。

- 比较价格并将某些请求路由到更便宜或更快的模型变体。

- 汇总计费与日志,覆盖多个模型与供应商。

CometAPI 的文档提供了简单的迁移路径与 OpenAI 风格的客户端(因此你现有的 OpenAI 或“兼容 OpenAI”的代码通常只需要少量更改)。

CometAPI 如何以编程方式暴露 GPT-5?

CometAPI 提供一个与 OpenAI 兼容的 REST API 表面:一个基础 URL、Authorization: Bearer <YOUR_KEY>,以及类似 OpenAI chat/completions 端点的请求体。对于 GPT-5,该平台文档列出了诸如 gpt-5、gpt-5-mini、gpt-5-nano 的模型名称,端点包括用于聊天式调用的 POST https://api.cometapi.com/v1/chat/completions,以及某些非聊天变体的 /v1/responses。示例配置细节(基础 URL、请求头格式与 model 参数)发布于 CometAPI 文档 与 快速上手指南。

典型端点与认证模式

- Base URL:

https://api.cometapi.com/v1(或文档中的/v1/chat/completions用于 chat,/v1/responses用于某些非 chat 变体)。 - Auth header:

Authorization: Bearer sk-xxxxxxxxxxxx(CometAPI 会在控制台签发sk-风格的令牌)。 - Content type:

application/json。 - Model 参数: 将

model设为gpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-mini或其他,请参考模型页面。

如何开始使用 CometAPI 并请求 GPT-5?(分步说明)

下面是一条简洁可靠的上手流程,你今天即可使用。

步骤 1:注册并获取 CometAPI 密钥

- 前往 cometapi.com 创建账户。

- 在控制台进入 API Tokens 或 Personal Center → Add Token。CometAPI 会签发

sk-...格式的令牌。请安全存储(不要将密钥嵌入公共仓库)。

步骤 2:选择模型字符串

- 选择符合你需求的模型名称(例如

gpt-5、gpt-5-nano-2025-08-07)。CometAPI 通常为每个模型提供多个别名,便于你在准确性与成本之间选择。

步骤 3:发起首个请求(curl)

一个遵循与 OpenAI 兼容模式的最小化 curl 示例:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"你是一个乐于助人的助手。"},

{"role":"user","content":"请总结使用模型聚合器的好处。"}],

"max_tokens": 500,

"temperature": 0.2

}'

这与 OpenAI 的聊天 API 结构相同,但指向 CometAPI 的基础 URL,并使用你的 Comet 令牌。

步骤 4:Python 示例(requests)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # 在环境中设置此值

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"你是一个乐于助人的助手。"},

{"role":"user","content":"列出三条在生产环境中减少模型幻觉的具体措施。"}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

将 model 替换为 gpt-5-nano 或 CometAPI 文档中更小、更便宜变体的确切别名。

CometAPI 中的价格

生产使用的实用最佳实践与缓解措施是什么?

以下是当你使用像 CometAPI 这样的中间层时,降低风险并提升可靠性的具体模式。

从小型试点开始并进行并行测试

将相同请求分别发往 OpenAI(若你有直连权限)与 CometAPI,比较输出、延迟与成本。这可以揭示任何隐式转换、内容过滤或模型别名不匹配。

为可观测性与质量保障做埋点

记录提示词、返回的 token(对 PII 做脱敏)、延迟与错误码。为提示词漂移与幻觉率实施自动化测试。跟踪模型别名的使用,以便迁移过程具备可审计性。

保护密钥并定期轮换

将 CometAPI 令牌视作任意 API 机密:存放于密钥管理器、定期轮换,并按环境(开发/预发/生产)进行作用域划分。

实施分层安全

综合使用:

- 提示工程 降低幻觉(明确约束、结构化输出)。

- 后处理检查(事实校验、黑名单、PII 的正则检测)。

- 人工校验 处理高风险输出。

这些是用于处理关键或法律内容的 GPT-5 部署的标准做法。

常见陷阱有哪些,以及如何排障访问问题?

陷阱:“model does not exist / no access”。一些开发者报告,在使用直连提供商 API 时,模型访问可能受供应商验证或组织验证的限制;当聚合器代理提供商模型时,也可能出现类似限制。如果你看到“模型不存在”或权限错误,请检查:(a) 你的 CometAPI 密钥是否有效且未过期,(b) 请求的模型名称是否与 CometAPI 支持列表完全匹配,(c) 底层提供商是否需要额外的验证或计费步骤。对于与验证相关的访问错误及超时/权限异常——请准备好详细信息以联系工作人员解决(email: support@cometapi.com)。

陷阱:意外的延迟或成本。 高推理模式与大上下文会导致延迟与 token 开销。使用 max_tokens、在适当场景降低 temperature,并在高吞吐工作负载中优先选择 mini 变体。通过日志与告警进行监控。

结语

CometAPI 为团队提供了一条快速路径,以在集中化模型访问的同时试验 GPT-5 变体,但投产使用需要你对任何强大模型采取同样的纪律:保护密钥、谨慎的提示工程、监控幻觉,以及对敏感工作负载进行政策/法律审查。从小型试点开始,使用 CometAPI 的仪表盘衡量 token 开销与延迟,并在验证了与你领域相关的准确性与安全性之后,再升级到更强推理的变体。

开发者可通过 CometAPI 访问 GPT-5、GPT-5 Nano 与 GPT-5 Mini(CometAPI 推荐使用 /v1/responses),最新模型版本以本文发布之日为准。要开始,请在 Playground 中探索模型能力,并查阅 API 指南获取详细说明。在访问之前,请确保你已登录 CometAPI 并获得 API 密钥。 CometAPI 提供远低于官方价格的方案以帮助你集成。

另见 How to Use GPT-5’s new parameters and tools

常见问题

1. 该如何选择 GPT-5 的模型变体,以及关于 tokens/定价?

CometAPI 列出了多个 GPT-5 变体(默认 gpt-5、如 gpt-5-chat-latest 的聊天快照,以及 gpt-5-mini/gpt-5-nano 等更小版本)。请根据你的需求选择:

gpt-5/gpt-5-chat-latest— 通用聊天的完整能力,适合质量与推理最佳化。gpt-5-mini/gpt-5-nano— 更低成本与延迟,适用于高容量或低关键性任务。

2. 针对大上下文与高质量推理,应如何设计调用架构?

长上下文:GPT-5 支持非常大的上下文窗口。发送长文档时,请有意识地分块输入、使用检索增强(向量数据库 + 上下文窗控制),并对输出的 max_tokens 进行有界控制以管理成本。

3. 应采取哪些安全、隐私与合规措施?

API 密钥规范。 将密钥保存在环境变量中,定期轮换,并尽可能限定作用域。不要将密钥提交到代码仓库。(这是开发者指南中一致的最佳实践。)

数据驻留与隐私。 在通过任何第三方聚合器发送敏感的个人、健康或受监管数据之前,阅读 CometAPI 的隐私政策与条款(以及 OpenAI 的政策)。一些企业可能要求直接的供应商合同或私有实例。

速率限制与配额保护。 在生产环境中实施断路器、指数退避与配额检查,避免成本失控与级联故障。CometAPI 的仪表盘提供使用量与配额——利用它们来实施程序化限制。