人工智能(AI)已经彻底改变了众多行业,其中最引人入胜的应用之一是图像生成。从创造逼真的人脸到产出超现实主义艺术作品,AI 图像生成的能力为艺术、设计与技术开辟了新的路径。本文将深入探讨 AI 生成图像的运行机制、为其提供动力的模型,以及这项技术的更广泛影响。

理解基础:AI 图像生成如何工作?

什么是生成式模型?

生成式模型是一类能够创建与训练数据相似的新数据实例的 AI 算法。在图像生成的语境中,这些模型从现有图像中学习模式,并利用所掌握的知识生成新的、相似的图像。

神经网络的作用

AI 图像生成的核心是神经网络,尤其是卷积神经网络(CNN)等深度学习模型。CNN 专为处理具有网格状拓扑结构的数据而设计,非常适合图像分析与生成。它们通过检测诸如边缘、纹理和形状等模式来工作,这些模式对于理解和重建图像至关重要。

AI 图像生成中的关键模型

生成对抗网络(GAN)

由 Ian Goodfellow 于 2014 年提出,GAN 由两个神经网络组成:生成器和判别器。生成器负责生成图像,而判别器则将其与真实图像进行比较评估。通过这种对抗过程,生成器不断改进输出,以产生愈发逼真的图像。

StyleGAN

由 NVIDIA 开发的 StyleGAN 是一种以生成人脸高质量著称的 GAN 变体。它引入了基于风格的生成器架构,能够控制图像中不同层级的细节。StyleGAN2 和 StyleGAN3 进一步提升了图像质量,并解决了纹理粘连等问题。

扩散模型

扩散模型通过从随机噪声开始,逐步将其细化为匹配目标的输出图像。由于能够生成高质量图像并在多种应用中具备灵活性,它们迅速流行起来。

Stable Diffusion

Stable Diffusion 是一个开源的扩散模型,支持文本到图像的生成。它还可以进行图像修补(inpainting)与扩展(outpainting),用于图像编辑与延展。其开源特性使其对开发者和艺术家广泛可用。

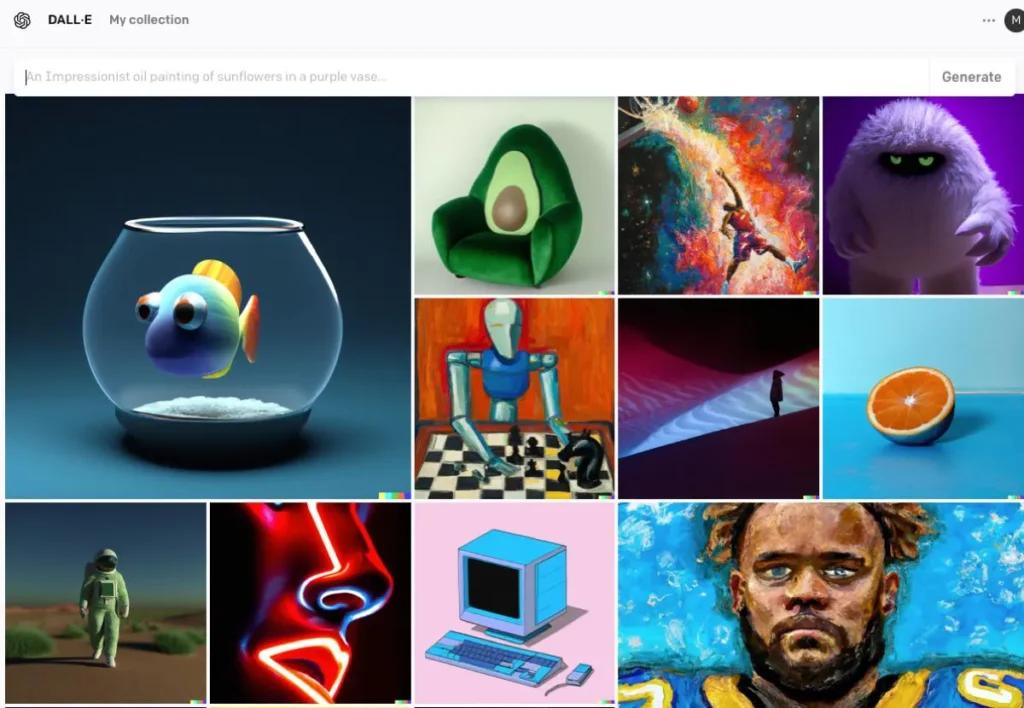

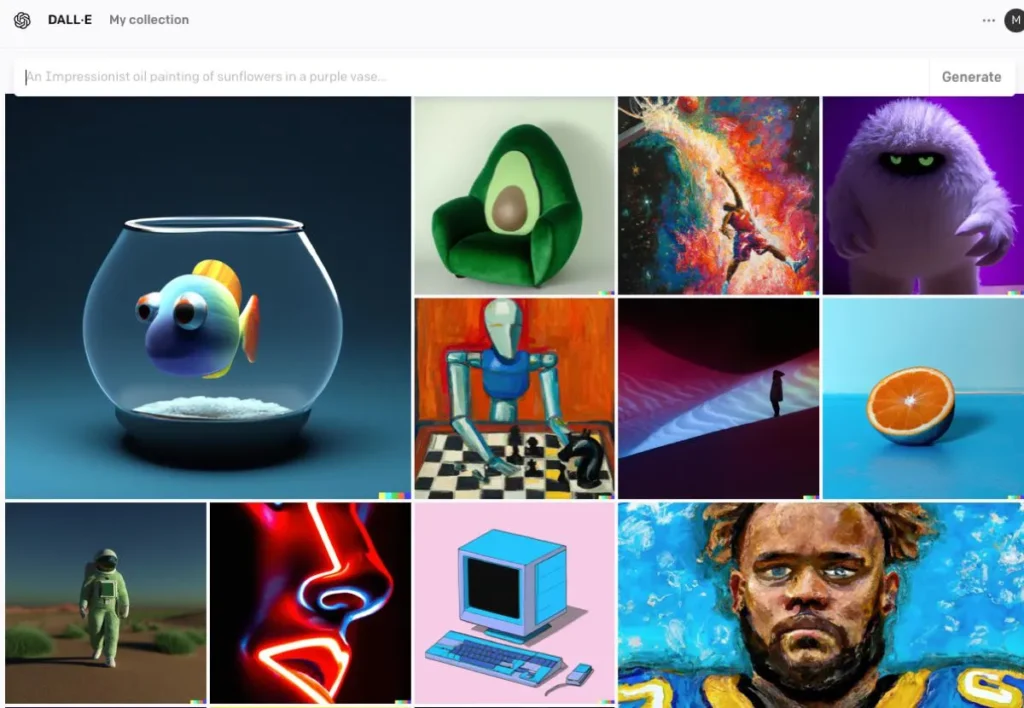

DALL·E

由 OpenAI 开发的 DALL·E 是一种基于 Transformer 的模型,能够根据文本描述生成图像。DALL·E 2 和 DALL·E 3 在原版基础上有所改进,提供更高分辨率和更准确的图文对齐。DALL·E 3 已集成进 ChatGPT,增强了用户交互体验。

AI 图像生成的流程

训练模型

AI 模型需要在大规模图像数据集上进行充分训练。在训练过程中,模型学习识别图像中的模式与特征,从而能够生成模拟训练数据的新图像。

生成新图像

训练完成后,模型可以通过以下方式生成新图像:

- 接收输入:可以是随机噪声(用于 GAN)、文本提示(用于 DALL·E),或现有图像(用于编辑)。此步骤捕捉文本的语义,使 AI 能够理解内容与上下文。

- 处理输入:模型通过其神经网络层处理输入,应用已学习的模式与特征。利用编码后的文本,AI 会采用生成对抗网络(GAN)或扩散模型等来创建图像。这些模型通过从随机噪声开始并逐步细化,使其与文本描述相匹配来生成图像。

- 优化与评估:随后使用注意力机制对生成的图像进行优化,以确保与文本的一致性与连贯性。判别器模型评估图像的真实感和与输入的符合度,并提供进一步优化的反馈。

- 输出图像:最终输出是一幅反映训练数据特征并符合特定输入的新图像。

AI 图像生成的代码示例

以下是使用三种主流 AI 模型(生成对抗网络、Stable Diffusion 和 DALL·E)生成图像的实用 Python 代码示例。

使用 PyTorch 的生成对抗网络(GAN)

生成对抗网络(GAN)由两个相互竞争的神经网络组成——生成器与判别器,用以生成新的、逼真的数据实例。下面是一个使用 PyTorch 生成图像的简化示例:

pythonimport torch

import torch.nn as nn

# Define the Generator network

class Generator(nn.Module):

def __init__(self):

super(Generator, self).__init__()

self.fc1 = nn.Linear(100, 128)

self.fc2 = nn.Linear(128, 784) # Assuming output image size is 28x28

def forward(self, x):

x = torch.relu(self.fc1(x))

x = torch.tanh(self.fc2(x))

return x

# Instantiate the generator

generator = Generator()

# Generate a random noise vector

noise = torch.randn(1, 100)

# Generate an image

generated_image = generator(noise)

此代码定义了一个简单的生成器网络,将一个 100 维的噪声向量作为输入,并生成 784 维的输出,可重塑为 28×28 的图像。tanh 激活函数确保输出值位于范围内,这在图像数据中很常见。

使用 Hugging Face diffusers 的 Stable Diffusion

Stable Diffusion 是一个强大的文本到图像模型,可根据文本描述生成图像。Hugging Face 的 diffusers 库提供了使用该模型的简便接口:

pythonfrom diffusers import StableDiffusionPipeline

import torch

# Load the pre-trained Stable Diffusion model

pipe = StableDiffusionPipeline.from_pretrained("CompVis/stable-diffusion-v1-4")

pipe = pipe.to("cuda") # Move the model to GPU for faster inference

# Generate an image from a text prompt

prompt = "A serene landscape with mountains and a river"

image = pipe(prompt).images

# Save the generated image

image.save("generated_image.png")

此脚本加载 Stable Diffusion 模型,并根据提供的提示词生成图像。请确保已安装必要的依赖,并使用兼容的 GPU 以获得最佳性能。

通过 OpenAI API 使用 DALL·E

DALL·E 是另一个由 OpenAI 开发的文本到图像模型。您可以通过 OpenAI 的 API 与其交互:

pythonimport openai

import requests

from PIL import Image

from io import BytesIO

# Set your OpenAI API key

openai.api_key = "your-api-key"

# Generate an image using DALL·E

response = openai.Image.create(

prompt="A futuristic cityscape at sunset",

n=1,

size="512x512"

)

# Get the URL of the generated image

image_url = response

# Download and display the image

image_response = requests.get(image_url)

image = Image.open(BytesIO(image_response.content))

image.save("dalle_generated_image.png")

将 "your-api-key" 替换为您的实际 OpenAI API 密钥。该脚本向 DALL·E 模型发送提示词并获取生成的图像,随后将图像保存在本地。

CometAPI 也集成了 DALL-E 3 API,您也可以使用 CometAPI 的密钥访问 DALL-E 3 API,比使用 OpenAI 更便捷、更快速。

有关 Comet API 中更多模型的信息,请查看 API 文档。

这些示例为使用不同 AI 模型生成图像提供了起点。每种模型都有其独特的能力与要求,请选择最适合您项目需求的模型。

结论

AI 图像生成处于技术与创造力的交汇点,在视觉内容创作方面提供了前所未有的可能性。理解 AI 如何生成图像、涉及的模型,以及这项技术的影响,对于我们在社会各领域中推进其整合至关重要。

在 CometAPI 中访问 AI 图像 API

CometAPI 提供对 500 多个 AI 模型的访问,包括用于聊天、图像、代码等的开源与专用多模态模型。其主要优势在于简化传统上复杂的 AI 集成流程。借助它,您可以通过单一统一订阅访问 Claude、OpenAI、Deepseek 和 Gemini 等领先 AI 工具。您可以使用 CometAPI 的 API 来创作音乐与艺术作品、生成视频,并构建自己的工作流。

CometAPI 提供远低于官方价格的方案,帮助您集成 GPT-4o API、Midjourney API、Stable Diffusion API(Stable Diffusion XL 1.0 API)以及 Flux API(FLUX.1 API 等),并且注册登录后账户将获得 $1!

CometAPI 集成了最新的 GPT-4o-image API 。