Alibaba 的 Qwen 团队发布了 Qwen3-Max-Preview (Instruct) — 该公司迄今为止规模最大的模型,具有 超过 1 万亿参数 — 并已通过 Qwen Chat、Alibaba Cloud Model Studio (API) 以及 CometAPI 等第三方市场立即开放使用。该预览版通过将极致规模与超大上下文窗口和上下文缓存相结合,面向推理、编程与长文档工作流,在长会话中保持低延迟。

关键技术亮点

- 超大参数规模(万亿级+): 转向万亿级以上参数模型旨在提升对复杂模式的学习能力(多步推理、代码合成、深度文档理解)。Qwen 发布的早期基准显示,相较 Qwen 以往的顶级模型,在推理、编程与多项基准测试上取得了更好结果。

- 超长上下文与缓存: 262k 令牌窗口使团队能够一次性输入完整的长报告、多文件代码库或长聊天记录。上下文缓存可减少重复上下文的计算,进而在长会话中降低延迟与成本。

- 多语种与编程能力: Qwen3 系列强调中英双语与广泛的多语支持,并强化了编程与结构化输出处理——适用于代码助手、自动化报告生成与大规模文本分析。

- 面向速度与质量的设计。 预览用户将其响应速度形容为“极快”,并称其相较以往 Qwen3 变体在指令遵循与推理方面有所提升。Alibaba 将该模型定位为面向生产级、智能体与开发者场景的高吞吐旗舰。

可用性与访问方式

Alibaba Cloud 对 Qwen3-Max-Preview 采用分级、基于令牌的计费(输入与输出分别计价)。按每百万令牌计费,并在用完任何免费额度后按实际消耗的令牌结算。

Alibaba 公布的预览期定价(美元)按请求输入令牌量分级(同一分级决定适用的单价):

- 0–32K 输入令牌: $0.861 / 每百万输入令牌,$3.441 / 每百万输出令牌。

- 32K–128K 输入令牌: $1.434 / 每百万输入令牌,$5.735 / 每百万输出令牌。

- 128K–252K 输入令牌: $2.151 / 每百万输入令牌,$8.602 / 每百万输出令牌。

CometAPI 提供官方 20% 折扣以便用户调用 API,详情参见 Qwen3-Max-Preview:

| 输入令牌 | $0.24 |

| 输出令牌 | $2.42 |

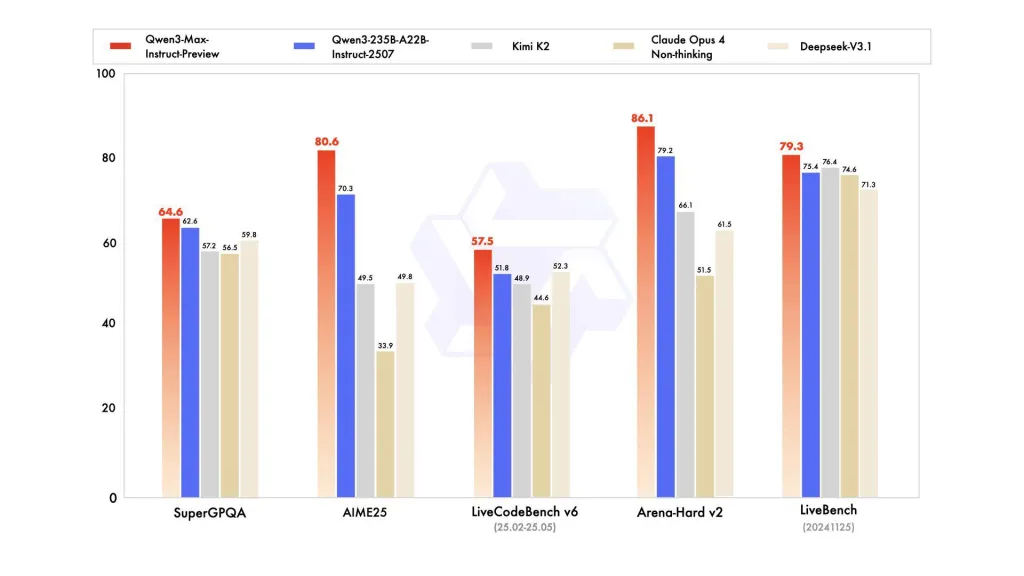

Qwen3-Max 扩展了 Qwen3 家族(此前版本采用了诸如 Mixture-of-Experts 变体与多级活跃参数层级等混合设计)。Alibaba 先前的 Qwen3 发布同时聚焦于“思考”(逐步推理)与“指令”两种模式;Qwen3-Max 被定位为该系列新的高端指令变体,显示其超越了公司此前表现最好的产品 Qwen3-235B-A22B-2507,表明这款 1T 参数模型在多项测试中处于领先。

在 SuperGPQA、AIME25、LiveCodeBench v6、Arena-Hard v2 和 LiveBench(20241125)上,Qwen3-Max-Preview 一直领先于 Claude Opus 4、Kimi K2 和 Deepseek-V3.1。

如何访问和使用 Qwen3-Max(实用指南)

1) 在浏览器中试用(Qwen Chat)

访问 Qwen Chat(官方 Qwen Web/聊天界面),在模型选择器中选择 Qwen3-Max-Preview(Instruct)模型(如有显示)。这是以可视方式评估对话与指令任务的最快途径。

2) 通过 Alibaba Cloud 访问(Model Studio / Cloud API)

- 登录 Alibaba Cloud → Model Studio / Model Serving。创建推理实例,或选择 qwen3-max-preview(或标注为预览版的)托管模型端点。

- 使用 Alibaba Cloud Access Key / RAM 角色进行鉴权,并通过包含提示与生成参数(temperature、max tokens 等)的 POST 请求调用推理端点。

3) 通过第三方托管方/聚合平台使用

据报道,该预览版可通过 CometAPI 及其他 API 聚合平台访问,这些平台允许开发者使用单一 API Key 调用多个托管模型。这有助于简化跨服务商测试,但请核实各托管方的延迟、区域可用性与数据处理政策。

入门

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500 多个 AI 模型——如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——聚合到单一且对开发者友好的接口中。通过提供一致的鉴权、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到应用中的流程。无论你在构建聊天机器人、图像生成器、音乐生成器,还是数据驱动的分析管道,CometAPI 都能帮助你更快迭代、控制成本并保持供应商无关性,同时利用 AI 生态中的最新突破。

结论

Qwen3-Max-Preview 使 Alibaba 坚实地跻身向客户交付万亿规模模型的组织之列。极长的上下文长度与兼容 OpenAI 的 API 相结合,降低了需要长文档推理、代码自动化或智能体编排的企业的集成门槛。成本与预览期的稳定性是采纳的主要考量:组织应通过缓存、流式与批量调用进行试点,以同时管理延迟与价格。