DeepSeek 已正式预览 V4 这一开源模型家族,且重点不只是“又一次模型更新”。公司将 V4 定位为面向真实工作负载的长上下文、对 Agent 友好的系统:文档密集型分析、编码助手、搜索 Agent,以及多步自动化。该版本已在 Web、App 和 API 上线,并在官方服务中引入成本高效的 1M-token 上下文窗口。

此次发布之所以特别值得关注,在于规模与效率的结合。DeepSeek 表示,V4-Pro 拥有 1.6T 总参数、49B 激活参数,而 V4-Flash 拥有 284B 总参数、13B 激活参数。技术报告称,V4 架构使用混合注意力、MoE 路由,以及面向提升 Agent 化行为的后训练,以在超长上下文下降低计算负担。

什么是 DeepSeek V4?

DeepSeek-V4 是公司最新的预览旗舰家族,此次发布包含两个公开变体:V4-Pro 与 V4-Flash。DeepSeek 将 V4-Pro 描述为在世界知识、数学、STEM、编码与 Agent 化编程方面更强的模型;而 V4-Flash 则是更灵敏、成本更优的选择,同时保留了相当多的推理质量与长上下文能力。V4-Pro 在 Agent 化编程与世界知识方面领先当前开源模型,而 V4-Flash 则面向速度与经济部署。

V4 采用混合注意力架构,结合了 Compressed Sparse Attention (CSA) 与 Heavily Compressed Attention (HCA),并配合 Manifold-Constrained Hyper-Connections 与 Muon 优化器。公司还表示,模型在超过 32T tokens 上进行了预训练;在 1M 上下文下,V4-Pro 相比 DeepSeek-V3.2 仅需 27% 的单 Token 推理 FLOPs 与 10% 的 KV 缓存。效率才是此次发布背后的真正看点。

DeepSeek-V4-Pro vs DeepSeek-V4-Flash

DeepSeek-V4-Pro

V4-Pro 是面向最重视质量用户的旗舰模型。DeepSeek-V4-Pro 提供更强的 Agent 化编码能力、更丰富的世界知识与世界级推理,并据发布页显示在世界知识上仅次于 Gemini-3.1-Pro。在技术报告中,V4-Pro 是该系列中更大的模型,且 DeepSeek-V4-Pro 与 V4-Flash 一样,均可通过兼容 OpenAI 与 Anthropic 的接口访问。

DeepSeek-V4-Flash

V4-Flash 是以效率优先的模型,其推理能力与 V4-Pro 接近,在简单 Agent 任务上可与 V4-Pro 比肩,同时以更小的参数占用与更快的响应时间运行;它支持思考与非思考两种模式,拥有与 Pro 相同的 1M 上下文长度与核心特性,但成本更低。

你该选择哪一个?

当任务高风险、知识密集或难以验真(如企业研究、复杂编码、多步决策支持,或你希望获得尽可能强答案时),请选择 V4-Pro。当吞吐、延迟或 Token 成本比极限性能更重要时,选择 V4-Flash。这一选择与官方定位以及两者之间的基准差距一致。

| Item | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| Total parameters | 284B | 1.6T |

| Active parameters | 13B | 49B |

| Context length | 1M | 1M |

| Reasoning modes | Non-think + think | Non-think + think |

| Best fit | Fast inference, high-throughput apps, cost-sensitive agents | Highest-capability reasoning, harder coding and knowledge tasks |

| Official API pricing | Cache hit $0.028 / cache miss $0.14 / output $0.28 per 1M tokens | Cache hit $0.145 / cache miss $1.74 / output $3.48 per 1M tokens |

| Max output | 384K | 384K |

CometAPI 提供对 Deepseek v4 Pro 与 V4 Flash 的访问 —— 比官方价便宜 20% —— 并可通过单一兼容 OpenAI 或 Anthropic Messages 的端点在 500+ 模型(GPT-5.4、Gemini 3.1 等)间无缝切换。

性能基准

DeepSeek-V3.2 vs V4-Flash vs V4-Pro

在基础模型对比表上,V4-Flash 与 V4-Pro 在核心基准上均优于 DeepSeek-V3.2,且通常由 V4-Pro 领先。例如,报告列出如下分数:AGIEval 82.6 / 83.1(V3.2 为 80.1);MMLU 88.7 / 90.1(V3.2 为 87.8);MMLU-Pro 68.3 / 73.5(V3.2 为 65.5);HumanEval 69.5 / 76.8(V3.2 为 62.8);LongBench-V2 44.7 / 51.5(V3.2 为 40.2),其中中间数为 V4-Flash,最后为 V4-Pro。

| Benchmark | DeepSeek-V3.2-Base | DeepSeek-V4-Flash-Base | DeepSeek-V4-Pro-Base |

|---|---|---|---|

| AGIEval (EM) | 80.1 | 82.6 | 83.1 |

| MMLU (EM) | 87.8 | 88.7 | 90.1 |

| MMLU-Pro (EM) | 65.5 | 68.3 | 73.5 |

| HumanEval (Pass@1) | 62.8 | 69.5 | 76.8 |

| LongBench-V2 (EM) | 40.2 | 44.7 | 51.5 |

来源:DeepSeek-V4 技术报告,表 1。

规律很直观:Flash 缩小与 Pro 的差距,但 Pro 仍是更强的一般模型。这使 V4-Flash 成为许多生产系统的务实默认选择,而当答案质量比成本或延迟更重要时,V4-Pro 是更合适的选项。

西方模型对比:V4 的定位

在一次针对中文白领任务的人评中,报告称 DeepSeek-V4-Pro-Max 的表现优于 Claude Opus 4.6-Max,不败率为 63%。在一项研发编码基准中,DeepSeek-V4-Pro “显著优于” Claude Sonnet 4.5,并接近 Claude Opus 4.5。

| Evaluation area | DeepSeek result | Western model comparison | What it suggests |

|---|---|---|---|

| Chinese white-collar tasks | V4-Pro-Max, 63% non-loss rate | vs Claude Opus 4.6-Max | 在实际商业类任务中表现强劲 |

| R&D coding benchmark | V4-Pro-Max pass rate 67 | vs Claude Sonnet 4.5 at 47; Opus 4.5 at 70; Opus 4.6 Thinking at 80 | 与领先前沿模型具备竞争力,尤其相对 Sonnet 等级系统 |

它并非“面面第一”,但已达到“必须认真评估”的水平。

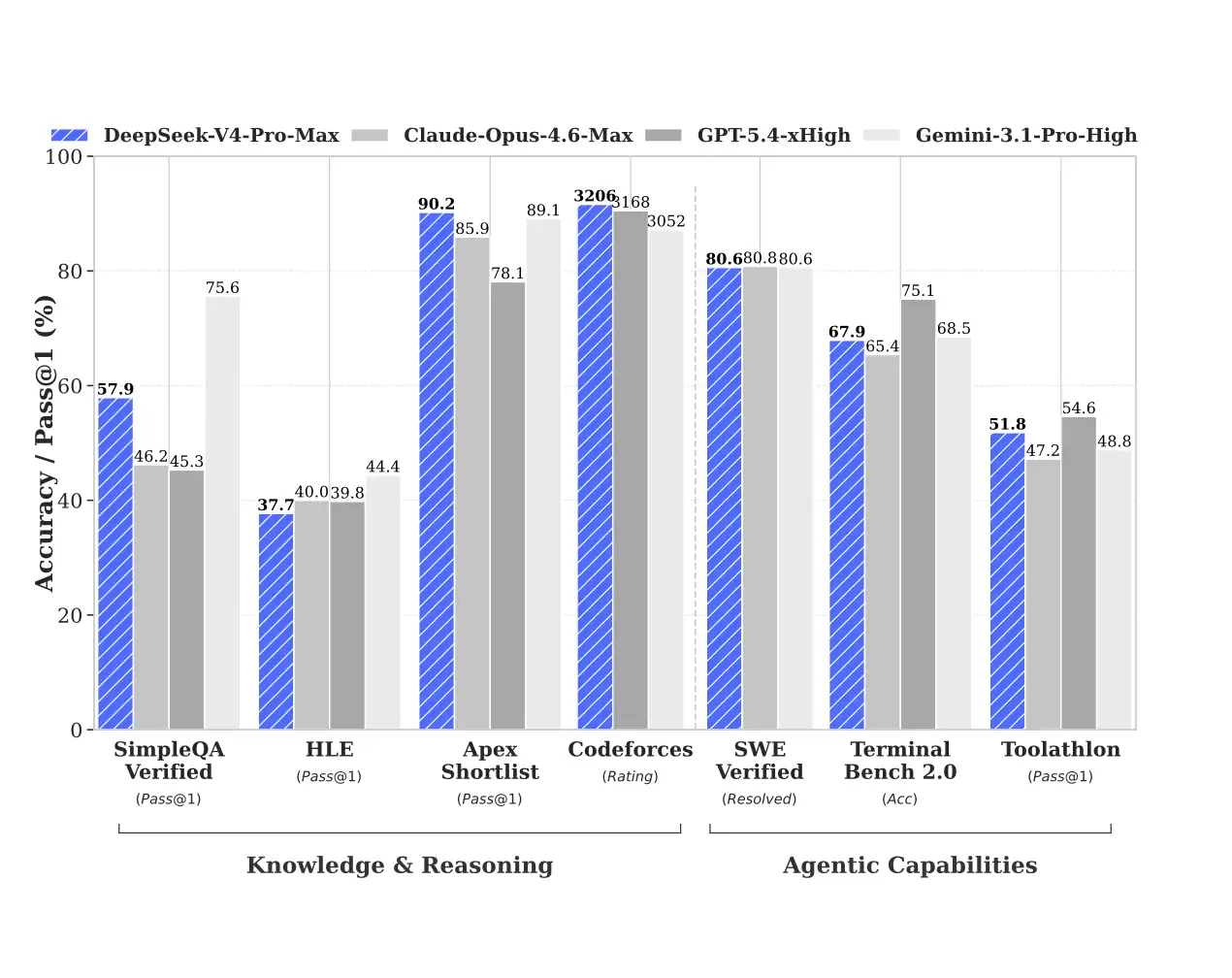

DeepSeek 的技术报告将 V4-Pro-Max 与 Claude Opus 4.6 Max、GPT-5.4 xHigh 与 Gemini 3.1 Pro High 放在同一张表中比较。结果并不简单:西方闭源模型在部分知识与推理方面仍然很强;然而,V4-Pro-Max 在代码、长上下文与部分 Agent 任务中存在非常强的竞争力。换言之,叙事已不再是“国产替代”的低维标签,而是进入了“更适合你的场景是哪一个”的阶段。

在知识与推理能力上,它与 Opus 4.6 Max、GPT-5.4 xHigh 与 Gemini 3.1 ProHigh 大致相当;但在 Agent 能力上略有落后,不过差距并不显著。

DeepSeek-V4-Pro-Max 在面向代码与长上下文的场景中极具竞争力,而西方模型在若干纯推理与知识基准上仍然非常强。这才是正确的解读方式:DeepSeek V4 已稳居前沿讨论之列,但基准领先依然取决于具体任务。

如何访问 DeepSeek V4

1) 使用官方网页和应用

DeepSeek 表示 V4 Preview 现在可在 Web、App 与 API 上使用。对普通用户而言,最简单的方式仍然是官方聊天界面,可通过 Expert Mode 或 Instant Mode 访问该模型。

2) 使用 API

我强烈推荐通过 CometAPI 访问 deepseek V4,因为它在价格与聚合方面具备最佳优势。

模型名称为:

deepseek-v4-flashdeepseek-v4-pro

DeepSeek 还表示,旧名称

deepseek-chat与deepseek-reasoner将被弃用,并在 2026-07-24 之前分别映射到 V4-Flash 的非思考与思考模式。这对已在生产中部署旧集成的迁移规划非常重要。

- 在 CometAPI 注册并获取 API Key。

- 使用标准的 OpenAI Python SDK(或任何兼容客户端),并设置自定义 base URL:

这里给出一个遵循官方 OpenAI 兼容格式的简洁示例:

import os

from openai import OpenAIclient = OpenAI(

api_key=os.environ["cometapi_API_KEY"],

base_url="https://api.cometapi.com"

)response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "你是一个乐于助人的助手。"},

{"role": "user", "content": "总结百万 Token 上下文的优势。"}

],

extra_body={"thinking": {"type": "enabled"}},

reasoning_effort="high"

)print(response.choices[0].message.content)

该请求模式遵循快速入门指引:设置 base URL,选择 deepseek-v4-pro 或 deepseek-v4-flash,在需要更深入推理时启用思考模式。

如何高效使用 DeepSeek V4

对于长文档工作流,最有效的做法是保持上下文干净且结构化。V4 的 1M-token 窗口是巨大优势,但当输入按章节、来源摘录、任务指令与明确输出约束进行组织时,模型表现最佳。这是最自然地发挥 DeepSeek 所宣传的长上下文能力的方式。

对于代码与 Agent 工作流,先以 V4-Flash 快速迭代,再在最终运行或最困难步骤中升级到 V4-Pro。这与官方定位一致:Flash 强调效率,Pro 强调能力,两者共享相同的 API 接口与上下文长度。

结语

DeepSeek-V4 的意义在于,它同时结合了市场一直在追求的四件事:长上下文、强推理、开放可用性与激进定价。真正的故事并不只是 DeepSeek 又发布了一个模型,而是公司正在尝试让前沿级 AI 在生产中“经济上可行”。对于评估下一步 AI 投入方向的团队,这是一个值得测试、而非忽视的信号。

对于跨多家提供商构建产品的团队而言,这正是应当在自有栈中进行基准测试的发布类型。CometAPI 可以成为务实的对比层,让你在无需让产品团队重做集成的前提下,将 DeepSeek-V4 与其他前沿模型并行评测。