在 2025 年 8 月下旬,Google(DeepMind)发布了Gemini 2.5 Flash Image——广泛被昵称为**“nano-banana”**——这是一款低延迟、高质量的图像生成与编辑模型,已集成进 Gemini 应用、Google AI Studio、Gemini API 和 CometAPI。它旨在生成逼真的照片级图像、在多次编辑中保持角色一致性、融合多张输入图像,并通过自然语言提示进行精细的局部编辑。该模型以预览/早期 GA 的形式提供,已登顶图像领域榜单(LMArena),同时配备安全机制(SynthID 水印与产品级过滤器)。

什么是 Gemini 2.5 Flash Image(又名“Nano Banana”)?

Gemini 2.5 Flash Image——带有俏皮昵称 Nano Banana——是 Google DeepMind 在 Gemini 系列中最新的图像生成与编辑模型。它在 2025 年 8 月下旬发布,目前定位为预览版,引入更高保真度的编辑、多图融合、更好的角色一致性(在多次编辑中保持同一人物/宠物/物体的可识别性),以及低延迟图像生成,融入 Gemini 的多模态工具集中。它可通过 Gemini API、Google AI Studio、Gemini 移动/网页应用,以及面向企业客户的 Vertex AI 获取。

起源与命名

“nano banana”这一昵称在早期测试者与 LMArena 榜单条目采用水果主题标签后,在社交媒体和社区榜单中病毒式传播;Google 随后在开发者与产品发布中确认并公开沿用这一俏皮称呼。官方产品名为Gemini 2.5 Flash Image,你通常会在代码与 API 调用中看到模型标识(在预览期间,例如为 gemini-2.5-flash-image-preview)。

Gemini 2.5 Flash Image 的核心特性是什么?

“角色一致性”到底意味着什么?

其中一个主打能力是角色一致性:你可以让模型在多次编辑或新场景中复用同一主体(人物、宠物、吉祥物或产品),同时保留其可识别的视觉特征(面部/形体、配色、显著标识)。这解决了早期图像模型中的常见弱点:后续编辑虽然看似合理,但人物/物体会出现明显差异。因此,开发者可构建用于产品目录、连载故事或品牌资产生成的流程,减少人工修正。

还包含哪些编辑控制?

Gemini 2.5 Flash Image 支持:

- 定点局部编辑:通过自然语言提示实施(移除物体、换装、皮肤润饰、移除背景元素)。

- 多图融合:将最多三张输入图融为一个协调的构图(例如将图像 A 的产品放入图像 B 的场景,同时保留光照效果)。

- 风格与格式控制:照片级写实指令、相机与镜头属性、纵横比、以及风格化输出(插画、贴纸等)。

- 原生世界知识:模型利用更广泛的 Gemini 家族知识进行语义感知编辑(例如理解“Renaissance lighting”或“Tokyo crosswalk”的含义)。

速度、成本与可用性如何?

Gemini 2.5 Flash Image 属于 Gemini 2.5 的 Flash 等级——在保证高质量的同时优化低延迟与成本。Google 已预览图像输出 token 的定价,并通过 API 与 AI Studio 提供可用性;企业客户可通过 Vertex AI 访问。公告发布时,Gemini 2.5 Flash Image 等级的定价为**$30 per 1M output tokens**,并给出示例单图成本为1290 output tokens ≈ $0.039 per image。

Gemini 2.5 Flash Image 的底层原理是什么?

架构与训练方法

Gemini 2.5 Flash Image 继承 Gemini 2.5 家族架构:稀疏 Mixture-of-Experts(MoE)风格主干,采用融合文本、图像、音频等数据的多模态训练。Google 在规模庞大且经过过滤的多模态语料上训练,并针对图像任务(生成、编辑、融合)与安全行为进行微调。训练运行在 Google 的 TPU fabric 上,并通过自动与人工评估指标进行验证。

会话驱动的编辑

从高层来看,模型采用上下文条件化:当你提供图像(或多张图像)加文本提示时,模型会将主体的视觉身份编码进其内部表示。在后续编辑或新场景中,它会基于该表示进行生成,从而保留期望的视觉属性(面部几何、关键服饰或产品标识、配色)。实际层面上,这在 Gemini API 暴露的多模态内容管线中实现:你将参考图与编辑指令一并发送,模型在一个响应中返回编辑后的图像输出(或多张候选图)。

水印与溯源

Google 在 Gemini 2.5 Flash Image 中集成安全与内容政策过滤器。此次发布强调评估与红队测试、自动化过滤步骤、监督微调与强化学习,以在遵循指令的同时尽量减少有害输出。输出包含不可见的 SynthID 水印,使模型生成或编辑的图像日后可被识别为 AI 生成。

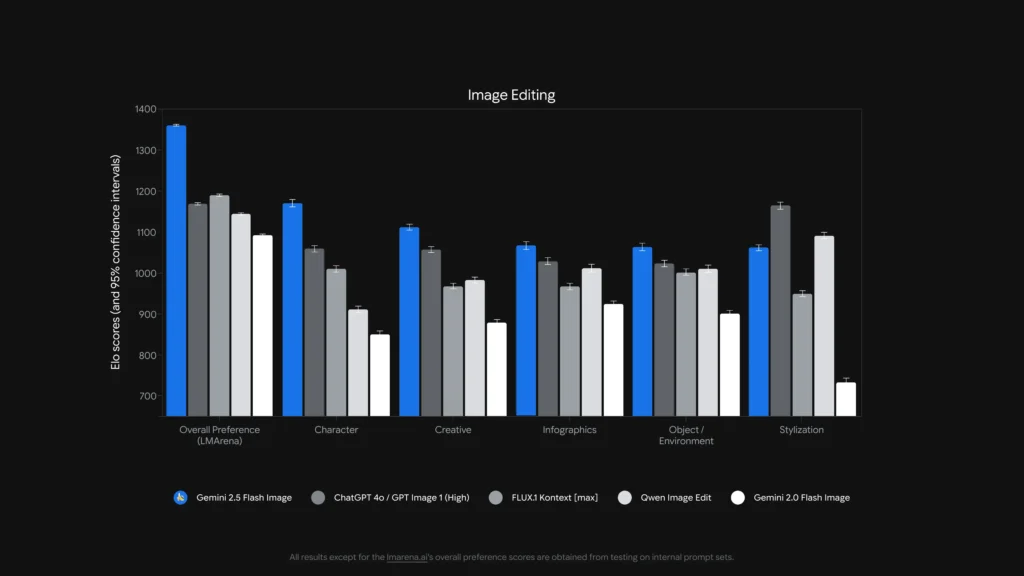

效能如何?(基准数据)

Gemini 2.5 Flash Image(在部分基准环境中以“nano-banana”营销)在 2025 年 8 月下旬登上LMArena 的图像编辑与文生图榜单第一,在报道的对比中相对于竞争者展现出较大的 Elo/偏好领先。我参考 LMArena 与 GenAI-Bench 的人工评估结果,显示其在文生图与图像编辑任务上均获得较高的偏好评分。

文生图对比

| 能力基准 | Gemini Flash 2.5 Image | Imagen 4 Ultra 06-06 | ChatGPT 4o / GPT Image 1 (High) | FLUX.1 Kontext | Gemini Flash 2.0 Image |

|---|---|---|---|---|---|

| 总体偏好(LMArena) | 1147 | 1135 | 1129 | 1075 | 988 |

| 视觉质量(GenAI-Bench) | 1103 | 1094 | 1013 | 864 | 926 |

| 文生图一致性(GenAI-Bench) | 1042 | 1053 | 1046 | 937 | 922 |

图像编辑

| 能力基准 | Gemini Flash 2.5 Image | ChatGPT 4o / GPT Image 1 (High) | FLUX.1 Kontext | Qwen Image Edit | Gemini Flash 2.0 Image |

|---|---|---|---|---|---|

| 总体偏好(LMArena) | 1362 | 1170 | 1191 | 1145 | 1093 |

| 角色 | 1170 | 1059 | 1010 | 911 | 850 |

| 创意 | 1112 | 1057 | 968 | 983 | 879 |

| 信息图 | 1067 | 1029 | 967 | 1012 | 925 |

| 物体/环境 | 1064 | 1023 | 1002 | 1010 | 901 |

| 产品再情境化 | 1128 | 1032 | 943 | 1009 | 888 |

| 风格化 | 1062 | 1165 | 949 | 1091 | 733 |

这些基准在实践中意味着什么?

基准告诉我们两件事:(1)该模型在照片级真实生成方面具备竞争力;(2)它在编辑任务中脱颖而出,尤其体现在角色一致性与提示遵循。人工偏好排序表明,用户在观测输出时,普遍认为 Gemini 的结果在真实感与指令对齐方面表现较好。然而,也需明确现有已知限制(细节事实上的幻觉风险、图像内长文本的渲染、风格迁移的边缘案例)——因此基准是参考,而非保证。

使用 Gemini 2.5 Flash Image 可以做什么(应用场景)?

Gemini 2.5 Flash Image 明确面向创意、生产力与应用影像场景。典型与新兴用例包括:

快速产品打样与电商

将产品照片拖入不同场景,在各类环境中生成一致的目录图,或在同一产品线内替换颜色/面料——同时保留产品身份。多图融合与角色/产品一致性使其在目录工作流中颇具吸引力。

照片润饰与定点编辑

通过自然语言提示移除物体、修饰瑕疵、更换服饰/配饰,或调整光照。局部编辑能力让非专业用户也能通过会话式命令实现专业级润饰。

分镜与视觉叙事

将同一角色置入不同场景并保持其外观一致(适用于漫画、分镜或提案演示)。迭代编辑让创作者在不重建素材的情况下,精炼情绪、取景与叙事连贯性。

教育、示意图与设计原型

由于它能结合文本提示与图像,并具备“世界知识”,模型可帮助生成标注示意图、教育可视化,或用于演示的快速原型。Google 还在 AI Studio 中强调了如房地产模型与产品设计等模板用例。

如何使用 Nano Banana API ?

以下是基于CometAPI API 文档和 Google API 文档的实用片段。它们展示常见流程:使用官方 GenAI SDK 或 REST 端点进行文生图与图+文生成(编辑)。

注:在 CometAPI 的文档中,预览模型名为

gemini-2.5-flash-image-preview。下面的示例与官方 SDK 示例(Python 与 JavaScript)及一个 REST curl 示例一致;请根据你的环境调整密钥与文件路径。

来自 CometAPI 的 REST curl 示例

使用 Gemini 官方的 generateContent 端点进行文生图。将文本提示放入 contents.parts[].text。示例(Windows shell,使用 ^ 作为续行符):

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ "contents": [{

"parts": [

{"text": "A photorealistic macro shot of a nano-banana on a silver fork, shallow depth of field"}

]

}]

}'}"

| grep -o '"data": "*"' \

| cut -d'"' -f4 \

| base64 --decode > gemini-generated.png

响应包含 Base64 图像字节;上述管线会提取 "data" 字符串并解码为 gemini-generated.png。

该端点支持“image-to-image”生成:上传输入图像(Base64),并接收修改后的新图像(同样为 Base64)。示例:

curl --location --request POST "https://api.cometapi.com/v1beta/models/gemini-2.5-flash-image-preview:generateContent" ^

--header "Authorization: sk-xxxx" ^

--header "User-Agent: Apifox/1.0.0 (https://apifox.com)" ^

--header "Content-Type: application/json" ^

--header "Accept: */*" ^

--header "Host: api.cometapi.com" ^

--header "Connection: keep-alive" ^

--data-raw "{ \"contents\": } ], \"generationConfig\": { \"responseModalities\": }}"

**说明:**首先将源图像文件转换为 Base64 字符串,并放入 inline_data.data。不要包含诸如 data:image/jpeg;base64, 的前缀。输出位于 candidates.content.parts,包含:一个可选的文本部分(描述或提示);以 inline_data 形式的图像部分(其中 data 是输出图像的 Base64)。对于多张图像,你可以直接追加,例如:

{

"inline_data": {

"mime_type": "image/jpeg",

"data": "iVBORw0KGgo...",

"data": "iVBORw0KGgo..."

}

}

以下是基于 Google 官方文档与博客改编的开发者示例。请用你自己的凭据与文件路径替换。

Python(官方 SDK 风格)

from google import genai

from PIL import Image

from io import BytesIO

client = genai.Client()

prompt = "Create a picture of a nano banana dish in a fancy restaurant with a Gemini theme"

# Text-to-Image

response = client.models.generate_content(

model="gemini-2.5-flash-image-preview",

contents=,

)

for part in response.candidates.content.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = Image.open(BytesIO(part.inline_data.data))

image.save("generated_image.png")

这是来自 Google 文档的规范 Python 片段(展示预览模型 ID)。同样的 SDK 调用模式也支持图+提示编辑(将图像作为 contents 之一传入)。更多细节参见gemini 文档。

结论

如果你的产品需要稳健、低延迟的图像生成,尤其是具备主体一致性的可靠编辑,Gemini 2.5 Flash Image 现已成为值得评估的生产级选项:它将最先进的图像质量与面向开发者集成的 API(AI Studio、Gemini API 与 Vertex AI)相结合。请谨慎权衡模型的当前限制(图像中的细文字、部分风格化边缘案例),并实施负责任使用的防护措施。

入门

CometAPI 是一个统一的 API 平台,聚合了来自领先提供商的 500+ AI 模型——例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——并提供一致的认证、请求格式与响应处理,大幅简化将 AI 能力集成到你的应用中。无论你在构建聊天机器人、图像生成器、音乐创作或数据驱动分析管线,CometAPI 都能帮助你更快迭代、控制成本并保持供应商无关性,同时充分利用 AI 生态的最新突破。

开发者可通过 CometAPI 访问Gemini 2.5 Flash Image(CometAPI 列表中的 Nano Banana 条目以 gemini-2.5-flash-image-preview/gemini-2.5-flash-image 形式出现,具体以文章发布时为准)。开始之前,请在Playground中探索模型能力,并查阅API 指南获取详细说明。访问前请确保已登录 CometAPI 并获得 API Key。CometAPI提供远低于官方价格的方案,帮助你完成集成。