Google DeepMind 于 2026 年 4 月 2 日正式发布 Gemma 4,标志着开源 AI 的一个重要里程碑。这一系列模型在“单位参数智能”上达到了前沿水平,构建于与 Gemini 3 同源的研究与技术之上。与早期采用自定义许可的 Gemma 版本不同,Gemma 4 采用完全宽松的 Apache 2.0 许可证,允许不受限制的商业使用、修改与再分发。

Gemma 4 以其多模态能力脱颖而出(所有尺寸均支持文本 + 图像输入,边缘型号还支持音频),原生支持高级推理与智能体式工作流,提供最长 256K 的上下文窗口,并针对从智能手机和 Raspberry Pi 到高端 GPU 的各种硬件进行优化。它支持 140 多种语言,强调高效,使强大的 AI 能力在消费者与边缘硬件上可离线使用,无需依赖云端。

CometAPI 提供优秀的开源与闭源模型 API。

什么是 Gemma 4?

Gemma 4 是 Google DeepMind 最新发布的开放多模态大语言模型(LLM)家族,专为高级推理、智能体式(Agentic)AI 工作流以及高效的端侧部署而设计。它在保持完全开源与开放权重的同时,借鉴了专有 Gemini 3 研究中的洞见,最大化“单位参数智能”。

相较此前的 Gemma 模型,关键改进包括:

- 原生多模态:文本 + 图像理解(全部型号),小型边缘变体支持音频。

- 可配置思考模式:通过结构化的 <|think|> 输出进行逐步推理。

- 原生函数调用与工具使用:非常适合自主智能体。

- 扩展上下文:更大模型可达 256K token。

- 混合注意力架构:结合局部滑动窗口与全局注意力,实现高效与长上下文性能。

- 小型号采用 每层嵌入(PLE) 与共享 KV 缓存以节省内存。

- 广泛多语言支持:在涵盖 140+ 种语言的数据上预训练,具备文化语境感知。

在 Apache 2.0 许可下发布的 Gemma 4 消除了此前限制企业采用的许可障碍。开发者现在可以毫无阻碍地微调、部署并商业化,成为与 Llama、Qwen 等完全开源生态直接竞争的产品。

Gemma 4 面向多样硬件:边缘设备(手机、IoT、Raspberry Pi、Jetson Nano)实现低延迟离线 AI,工作站/GPU 则用于高性能本地服务。这种“本地优先”的设计兼顾隐私、成本与零延迟推理。

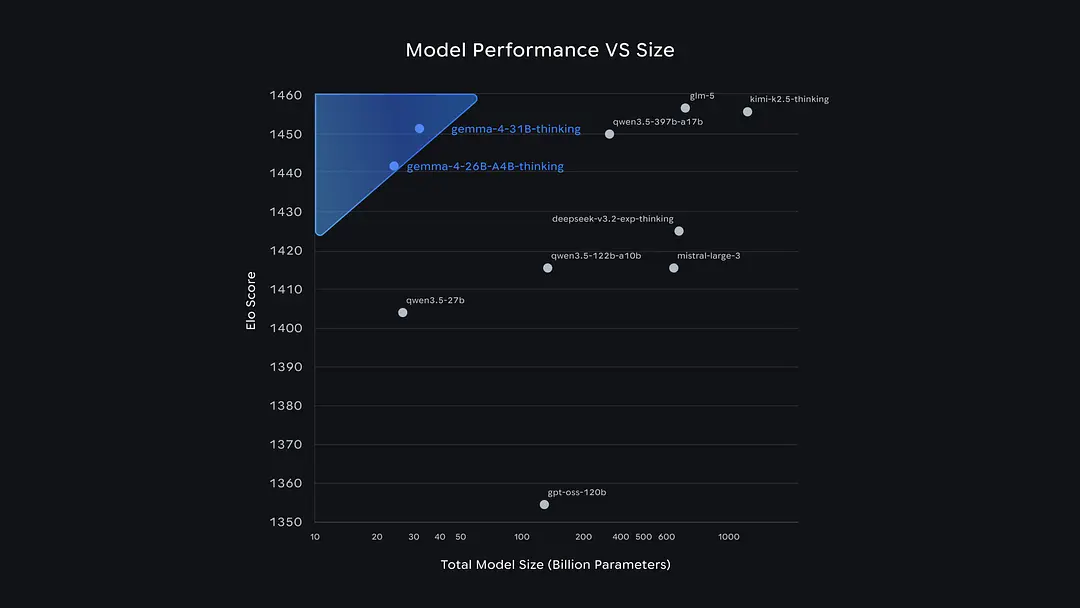

在 Arena 榜单上领先于它的开源模型主要来自中国团队。Gemma 4 与 Qwen 3.5 和 GLM-5 差异不大,但与 OpenAI 的 GPT-OSS-120B 存在显著差异。

开发者现在可以在 CometAPI 上找到 GLM-5、Qwen 3.5 等。

Gemma 4 的四个版本

Google 发布了四种精心优化的尺寸版本,分别在性能、效率与部署场景之间取得平衡。两种采用带有创新每层嵌入(PLE)的稠密架构,面向边缘效率;一种是以低激活参数成本实现高性能的专家混合(MoE);另一种是稠密旗舰。

| 模型 | 架构 | 总参数 | 激活参数(MoE) | 有效参数 | 上下文长度 | 模态 | 目标硬件 |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | 稠密 + PLE | ~5.1B(含 embeddings) | N/A | 2.3B | 128K | 文本、图像、音频 | 智能手机、Raspberry Pi、边缘 IoT |

| Gemma 4 E4B | 稠密 + PLE | ~8B(含 embeddings) | N/A | 4.5B | 128K | 文本、图像、音频 | 移动设备、轻量级 GPU、Jetson |

| Gemma 4 26B A4B | MoE(激活 8 / 总计 128 + 1 共享) | 25.2B | 3.8B–4B | N/A | 256K | 文本、图像 | 工作站、消费级 GPU、本地服务器 |

| Gemma 4 31B | 稠密 | 30.7B | N/A | N/A | 256K | 文本、图像 | 高端 GPU(FP16 下单张 H100/A100 可承载) |

Gemma 4 E2B 与 E4B(边缘优化):通过 PLE 以极小参数开销实现逐层特化。非常适合电池供电或内存受限的设备。音频编码器(USM 风格 Conformer,~300M 参数)支持语音转写与翻译。

Gemma 4 26B A4B(MoE):尽管总规模 25B+,推理时仅激活约 4B 参数。在显著降低计算成本的同时,提供接近 31B 的性能——非常适合高性价比扩展。

Gemma 4 31B(稠密):面向极致能力的旗舰。可在单张 80GB GPU 上以全精度运行,并在多个榜单中名列前茅。

所有模型都提供针对对话、推理与工具使用优化的指令微调(“-it”)变体,以及用于微调的预训练基础版。两种大模型采取了不同路径:31B 稠密模型追求终极质量,是微调的最佳基底;26B MoE 模型优先速度,推理仅激活 38 亿参数,词元生成速度更快,但整体质量略低。

两种小型号 E2B 与 E4B 专为手机与 IoT 打造:可完全离线运行,节省内存与功耗。此外,它们具备大模型所不具备的一项能力——原生音频输入,支持直接语音识别。

Gemma 4 的核心能力

Gemma 4 在真实世界应用中最重要的方面表现出色:

1. 高级推理与思考模式

可通过系统提示或 enable_thinking=True 配置逐步推理。输出结构化的 <|think|> 标签,随后给出最终答案。无需额外微调,即可显著提升复杂任务表现。

2. 多模态理解

- 视觉:目标检测(JSON 边界框)、OCR(多语言)、文档/PDF 解析、图表理解、UI 理解、手写识别、可变分辨率图像处理(令牌预算:70–1120 个)。

- 视频:最长 60 秒(1 fps 帧处理)。

- 音频(仅 E2B/E4B):自动语音识别(ASR)与语音到文本翻译(最长 30 秒)。

- 交错输入:可任意顺序混合文本、图像与音频。

3. 智能体式工作流与函数调用

原生工具使用支持,使自主智能体可进行多步规划、API 调用、应用导航与任务完成。在 τ2-bench(智能体式工具使用)上表现强劲。

4. 编程与开发者工具

在代码生成、补全、调试与仓库级理解方面表现出色。支持 JSON 结构化输出以便无缝集成。31B 在 LiveCodeBench v6 上得分 80.0%,定位为适合离线开发场景的本地优先编程助手。

5. 长上下文与多语言

可靠处理 128K–256K token(已在 MRCR 大海捞针测试中验证)。预训练数据截止至 2025 年 1 月,具备强大的跨语言能力。这不仅是多语言翻译,而是原生覆盖 140 多种语言的训练。

基准数据:Gemma 4 表现拆解

Gemma 4 为开源模型设定了新标准。31B 与 26B 变体达到了以往只属于更大规模专有系统的成绩,而边缘模型则超越了 Gemma 3 的更大前辈。

完整基准结果(指令微调模型)

| 基准 | 类别 | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B(无思考) |

|---|---|---|---|---|---|---|

| MMLU Pro | 推理与知识 | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026(无工具) | 数学 | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | 研究生级科学 | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2(平均) | 智能体式工具使用 | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | 编程 | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | 竞赛编程 | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | 多模态推理 | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | 数学 + 视觉 | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2(8-needle, 128K) | 长上下文 | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

关键洞察:

- 相较 Gemma 3 的巨大飞跃:31B 在 AIME 数学从 20.8% 提升至 89.2%,在 LiveCodeBench 上从 29.1% 提升至 80.0%。

- MoE 的高效性:26B A4B 在显著降低推理计算的同时,几乎匹配 31B。

- 边缘优势:E4B 与 E2B 在许多指标上超越 Gemma 3 27B,尽管参数规模小 6–10 倍。

- 榜单排名:31B 在 Arena AI(文本)上得分约 ~1452;26B A4B 约 ~1441。据称 26B 变体在用户偏好与编程方面优于更大规模的模型,如 Qwen 3.5 397B。

视觉与音频基准显示无需专项微调即可实现强劲的开箱即用多模态表现。

生态与工具支持

Gemma 4 享有广泛且即刻可用的生态集成:

- Hugging Face:首日支持

transformers、pipeline("any-to-any")、GGUF、ONNX 与多模态处理器。 - 本地运行时:Ollama、Llama.cpp(LM Studio、Jan)、MLX(Apple Silicon,TurboQuant)、Mistral.rs(Rust)、Transformers.js(基于 WebGPU 的浏览器推理)。

- 微调:TRL、Unsloth、PEFT、Vertex AI,以及完整的多模态数据集支持。

- 硬件优化:NVIDIA RTX/DGX Spark/Jetson(通过 TensorRT-LLM)、Google AI Edge 工具,以及 Android/iOS 端侧部署。

- 智能体框架:OpenClaw、Hermes、Pi,以及 CARLA 仿真测试。

- 云/Studio:Google AI Studio 快速测试;Kaggle Models 可下载。

这一生态使 Gemma 4 能在笔记本、服务器或边缘设备上在数分钟内完成部署。

限制与安全:

- 训练数据截止:2025 年 1 月(无工具时不具备实时知识)。

- 音频仅限语音(不含音乐);视频上限 60 秒。

- 仍存在幻觉风险——建议启用思考模式并做验证。

- 安全:遵循 Google AI Principles 的严格过滤与评估;开发者需增加应用级防护。

为什么 Gemma 4 在 2026 年很重要

Gemma 4 正在让前沿 AI 走向大众。多模态智能、智能体能力与 Apache 2.0 的自由相结合,再配合与硬件无关的高效设计,使开发者与企业能够以规模化的方式构建安全、私密、低成本的 AI 解决方案。“单位参数智能”的突破——尤其是在边缘型号超越昨日旗舰开源模型的表现上——预示着真正无处不在的 AI 即将到来。

无论是在手机上运行 2B 模型,还是在本地运行 31B 强力型号,Gemma 4 都表明开源 AI 在实际效用上已经赶上并在许多方面超越了闭源替代方案。