截至2025 年 12 月 15 日,公开信息显示,Google 的 Gemini 3 Pro(预览版)与OpenAI 的 GPT-5.2都在推理、多模态与长上下文能力上开辟了新前沿——但它们采取了不同的工程路线(Gemini → 稀疏 MoE + 超大上下文;GPT-5.2 → 稠密/“路由”设计、压缩与超高推理模式),因此在峰值基准成绩 vs. 工程可预测性、工具链与生态之间存在取舍。哪个更“好”取决于你的主要需求:若侧重极限上下文、多模态的代理型应用,倾向于 Gemini 3 Pro;若侧重稳定的企业开发工具链、可预测成本与即时 API 可用性,则 GPT-5.2 更合适。

什么是 GPT-5.2,它的主要特性是什么?

GPT-5.2 是 OpenAI 于 2025 年 12 月 11 日发布的 GPT-5 家族成员(变体:Instant、Thinking、Pro)。其定位为公司在“专业知识工作”方面最强大的模型——针对表格、演示文稿、长上下文推理、工具调用、代码生成与视觉任务进行了优化。OpenAI 已向付费 ChatGPT 用户与 OpenAI API(Responses API / Chat Completions)提供 GPT-5.2,模型名包括 gpt-5.2、gpt-5.2-chat-latest 和 gpt-5.2-pro。

模型变体与预期用途

- gpt-5.2 / GPT-5.2 (Thinking) — 最适合复杂的多步骤推理(Responses API 使用的默认 “Thinking” 系列变体)。

- gpt-5.2-chat-latest / Instant — 更低延迟,适合日常助理与聊天场景。

- gpt-5.2-pro / Pro — 面向最难问题的最高保真/高可靠性(额外计算,支持

reasoning_effort: "xhigh")。

关键技术特性(面向用户)

- 视觉与多模态改进 — 更强的图像空间推理与在配合代码工具(Python 工具)时更好的视频理解,并支持执行代码片段的 code-interpreter 风格工具。

- 可配置推理开销(

reasoning_effort: none|minimal|low|medium|high|xhigh),用于在延迟/成本与深度之间权衡。xhigh为 GPT-5.2 新增(并在 Pro 上支持)。 - 改进的长上下文处理与压缩能力,可在数十万 tokens 范围内进行跨文档推理(OpenAI 报告 MRCRv2 / 长上下文指标表现出色)。

- 高级工具调用与代理型工作流 — 更强的多轮协调能力,更好的工具编排,支持“单一巨型代理(mega-agent)”式架构(OpenAI 强调在 Tau2-bench 上的工具表现)。

什么是 Gemini 3 Pro Preview?

Gemini 3 Pro Preview 是 Google 在 2025 年 11 月作为 Gemini 3 家族的一部分发布的最先进生成式 AI 模型。该模型强调多模态理解——能够理解和综合文本、图像、视频与音频,并提供超大上下文窗口(约 100 万 tokens),以处理大规模文档或代码库。

Google 将 Gemini 3 Pro 定位为在推理深度与细腻度方面的业界先进模型,并将其作为多种开发者与企业工具的核心引擎,包括 Google AI Studio、Vertex AI 和类似 Google Antigravity 的代理型开发平台。

目前,Gemini 3 Pro 处于预览阶段——功能与访问仍在拓展,但该模型已在逻辑、多模态理解与代理型工作流上取得了很高的基准成绩。

关键技术与产品特性

- 上下文窗口:Gemini 3 Pro Preview 支持1,000,000 个输入 tokens的上下文窗口(输出最多 64k tokens),这对在单次请求中摄取超大文档、书籍或视频转录具有显著实用优势。

- API 特性:

thinking_level参数(low/high)用于在延迟与推理深度间权衡;media_resolution用于控制多模态保真度与 token 消耗;支持搜索基座、文件/URL 上下文、代码执行与函数调用。Thought signatures 与上下文缓存有助于在多次调用中保持状态。 - Deep Think 模式 / 更高推理:“Deep Think” 选项提供额外的推理通道,以在困难基准上进一步提升分数。Google 将 Deep Think 作为面向复杂问题的高性能路径单独发布。;

- **原生多模态支持:**文本、图像、音频与视频输入,并与搜索及产品集成实现更紧密的对齐(突出 Video-MMMU 与其他多模态基准成绩)。

快速预览 — GPT-5.2 vs Gemini 3 Pro

一张紧凑的对比表,涵盖最重要的事实(附来源)。

| 方面 | GPT-5.2 (OpenAI) | Gemini 3 Pro (Google / DeepMind) |

|---|---|---|

| 供应商 / 定位 | OpenAI — 聚焦专业知识工作、编码与代理型工作流的旗舰 GPT-5.x 升级。 | Google DeepMind / Google AI — 聚焦超长上下文多模态推理与工具集成的旗舰 Gemini 代。 |

| 主要模型风味 | Instant、Thinking、Pro(可自动在它们之间切换)。Pro 增加更高的推理开销。 | Gemini 3 家族包括 Gemini 3 Pro 与 Deep-Think 模式;侧重多模态/代理型。 |

| 上下文窗口(输入 / 输出) | 约 400,000 个总输入容量;最多 128,000 个输出/推理 tokens(面向超长文档与代码库)。 | 最多约 1,000,000 个输入 tokens(1M),输出最多 64K tokens |

| 关键优势 / 关注点 | 长上下文推理、代理型工具调用、编码、结构化办公任务(表格、演示);安全/系统卡更新强调可靠性。 | 大规模多模态理解,推理 + 图像合成,超大上下文 + “Deep Think” 推理模式,在 Google 生态中的强工具/代理集成。 |

| 多模态与图像能力 | 提升视觉与多模态对齐;针对工具使用与文档分析进行了调优。 | 高保真图像生成 + 推理增强的构图,多参考图像编辑,清晰文本渲染。 |

| 延迟 / 交互性 | 官方强调比前代 GPT-5.x 更快的推理与响应(较低延迟);提供多层级(Instant / Thinking / Pro)。 | Google 强调优化的“Flash”/服务能力,许多流程具有可比的交互速度;Deep Think 模式以延迟换取更深推理。 |

| 显著特性 / 差异点 | 推理开销级别(medium/high/xhigh),改进的工具调用,高质量代码生成,对企业工作流具有高 token 效率。 | 1M token 上下文,强原生多模态摄取(视频/音频),“Deep Think” 推理模式,与 Google 产品(Docs/Drive/NotebookLM)紧密集成。 |

| 典型最佳用途(简述) | 长文档分析、代理型工作流、复杂编码项目、企业自动化(表格/报告)。 | 超大型多模态项目、需要 1M-token 上下文的长周期代理型工作流、先进图像 + 推理流水线。 |

GPT-5.2 与 Gemini 3 Pro 在架构上如何比较?

核心架构

- **基准 / 真实工作评测:**GPT-5.2 Thinking 在 GDPval(44 职业知识工作评测)上达到 70.9% 胜出/持平,并在工程与数学基准上较前代 GPT-5 取得大幅提升。在编码(SWE-Bench Pro)与领域科学问答(GPQA Diamond)上有显著改进。

- **工具与代理:**提供对工具调用、Python 执行与代理型工作流(文档搜索、文件分析、数据科学代理)的强内置支持。对于部分 GDPval 任务可实现 11 倍速度 / <1% 成本(潜在经济价值衡量,70.9% vs. 先前约 38.8%),并在表格建模方面有具体提升(例如在初级投行任务上较 GPT-5.1 提升 +9.3%)。

- **Gemini 3 Pro:**采用稀疏专家混合 Transformer(Sparse Mixture-of-Experts,MoE)。模型对每个 token 激活少量专家,使总参数容量可大幅增大,同时每 token 的计算近似次线性。Google 在模型卡中指出,Sparse MoE 是性能提升的核心因素之一。这种架构使在不按线性代价增长的情况下,将模型容量推到更高成为可能。

- **GPT-5.2(OpenAI):**延续基于 Transformer 的架构,并在 GPT-5 系列中采用路由/压缩策略(通过“路由器”触发不同模式——Instant vs Thinking;同时在长上下文中采用压缩与 token 管理技术)。GPT-5.2 强调在训练与评估中“先思考再作答”,以及面向长周期任务的压缩,而非宣布采用大规模经典的稀疏 MoE。

架构的影响

- **延迟与成本权衡:**像 Gemini 3 Pro 这样的 MoE 模型,因仅运行部分专家,往往可在保持较低推理成本的同时提供更高的每 token 峰值能力。但在服务与调度上可能更复杂(专家冷启动均衡、IO)。GPT-5.2 的路径(稠密/路由 + 压缩)更有利于可预测的延迟与开发者体验,尤其是在与 Responses、Realtime、Assistants 与批处理 API 等既有 OpenAI 工具深度集成的情况下。

- **长上下文扩展:**Gemini 的 1M 输入 token 能力允许原生接入极长文档与多模态流。GPT-5.2 的约 400k 组合上下文(输入+输出)已相当可观,覆盖大多数企业需求,但较 Gemini 的 1M 规格仍小。对于超大语料或多小时视频转录,Gemini 的规格具有明显技术优势。

工具、代理与多模态管线

- **OpenAI:**深度集成工具调用、Python 执行、“Pro” 推理模式与付费代理生态(ChatGPT Agents / 企业工具集成)。强烈聚焦代码中心工作流与将表格/幻灯片作为一等输出。

- **Google / Gemini:**内置对 Google 搜索的对齐(可选计费功能)、代码执行、URL 与文件上下文,并提供明确的媒体分辨率控制,用于在视觉保真与 token 消耗间权衡。API 提供

thinking_level等调参旋钮,用于调节成本/延迟/质量。

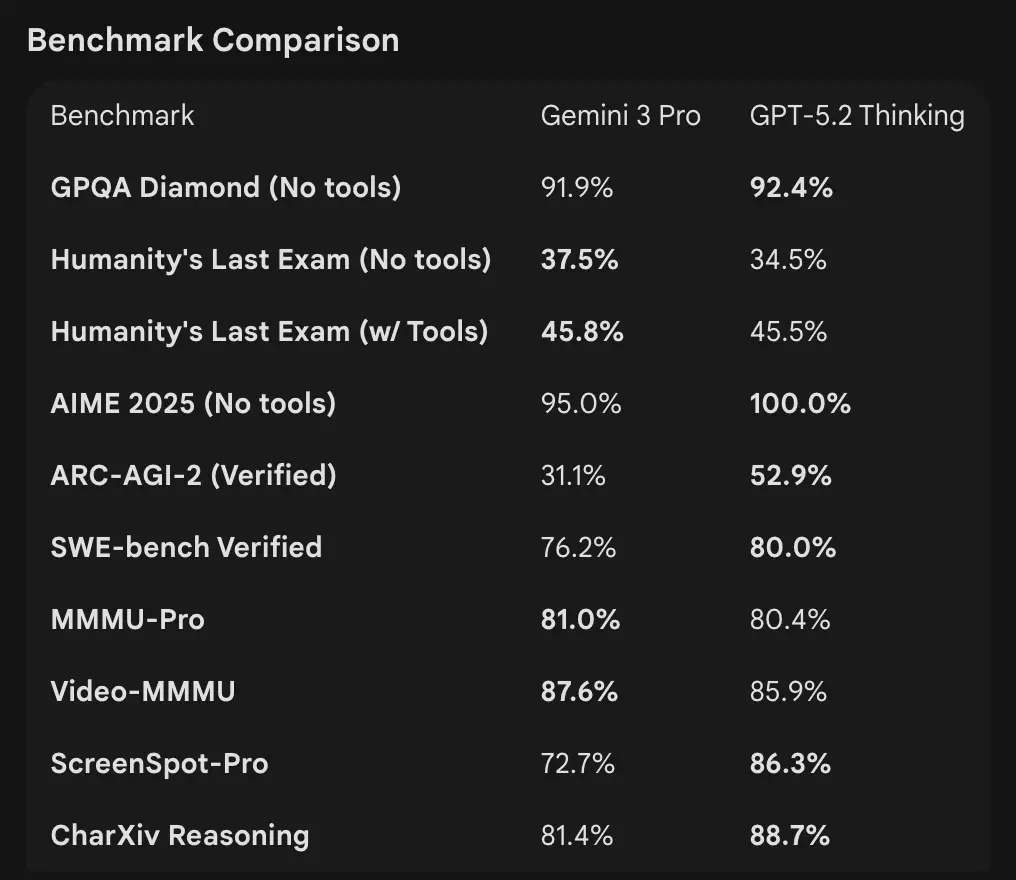

基准数字如何比较

上下文窗口与 token 处理

- Gemini 3 Pro Preview: 1,000,000 输入 tokens / 64k 输出 tokens(Pro 预览模型卡)。知识截止:2025 年 1 月(Google)。

- **GPT-5.2:**OpenAI 展示了强劲的长上下文表现(在 4k–256k 的 MRCRv2 “针”任务上,许多设置超过 85–95%),并采用压缩特性;OpenAI 的公开上下文示例表明在超大上下文下依然稳定,但会按变体列出窗口大小(更强调压缩而非给出统一的 1M 数字)。API 使用的模型名包括

gpt-5.2、gpt-5.2-chat-latest、gpt-5.2-pro。

推理与代理型基准

- **OpenAI(选摘):**Tau2-bench Telecom 98.7%(GPT-5.2 Thinking),在多步工具使用与代理型任务上有明显提升(OpenAI 强调将多代理系统折叠为“巨型代理”)。在 GPQA Diamond 与 ARC-AGI 上较 GPT-5.1 有台阶式跃升。

- **Google(选摘):**Gemini 3 Pro:LMArena 1501 Elo、MMMU-Pro 81%、Video-MMMU 87.6%,GPQA 与 Humanity’s Last Exam 得分很高;Google 还展示了强大的长周期规划能力的代理型案例。

工具与代理:

GPT-5.2:提供对工具调用、Python 执行与代理型工作流(文档搜索、文件分析、数据科学代理)的强内置支持。对于部分 GDPval 任务可实现 11 倍速度 / <1% 成本(潜在经济价值衡量,70.9% vs. 先前约 38.8%),并在表格建模方面有具体提升(例如在初级投行任务上较 GPT-5.1 提升 +9.3%)。

**解读:**两者的基准具有互补性——OpenAI 强调真实世界知识工作基准(GDPval),显示 GPT-5.2 在表格、幻灯片与长代理序列等生产任务中表现强劲。Google 强调原始推理排行榜与超大的单请求上下文窗口。孰轻孰重取决于你的工作负载:面向企业的代理型长文档管道更偏向 GPT-5.2 在 GDPval 上的验证表现;摄取海量原始上下文(例如整段视频语料/整本书一次性注入)则更青睐 Gemini 的 1M 输入窗口。

多模态能力如何比较?

输入与输出

- Gemini 3 Pro Preview:支持文本、图像、视频、音频、PDF输入与文本输出;Google 提供细粒度的

media_resolution控制与thinking_level参数,以便为多模态工作在成本与保真间调优。输出上限 64k;输入上限 1M tokens。 - **GPT-5.2:**支持丰富的视觉与多模态工作流;OpenAI 强调改进了空间推理(图像组件边界与标注估计)、视频理解(Video MMMU 分数)与工具增强的视觉能力(在愿景任务上配合 Python 工具可显著提升分数)。GPT-5.2 强调复杂的视觉 + 代码任务在启用工具支持(Python 代码执行)时受益显著。

实际差异

**粒度 vs. 广度:**Gemini 提供一套多模态旋钮(media_resolution、thinking_level)以便开发者按媒体类型调优权衡。GPT-5.2 强调集成的工具使用(在环执行 Python),将视觉、代码与数据变换任务结合起来。如果你的用例偏重超大规模视频 + 图像分析并需要极长上下文,Gemini 的 1M 上下文更具吸引力;若你的工作流需要在环执行代码(数据变换、表格生成),GPT-5.2 的代码工具与代理友好性可能更便捷。

API 访问、SDK 与定价如何?

OpenAI GPT-5.2(API 与定价)

- **API:**通过 Responses API / Chat Completions 使用

gpt-5.2、gpt-5.2-chat-latest、gpt-5.2-pro。成熟的 SDK(Python/JS)、cookbook 指南与生态。 - 定价(公开):****$1.75 / 100 万输入 tokens,$14 / 100 万输出 tokens;缓存折扣(缓存输入 90% 折扣)可降低重复数据的实际成本。OpenAI 强调 token 效率(单 token 价格较高,但达到相同质量阈值所需总量更少)。

Gemini 3 Pro Preview(API 与定价)

- **API:**通过 Google GenAI SDK 与 Vertex AI/GenerativeLanguage 接口使用

gemini-3-pro-preview。提供新参数(thinking_level、media_resolution)并可集成 Google grounding 与工具。 - 定价(公开预览):预览层级 200k tokens 以下大致为$2 / 100 万输入 tokens与**$12 / 100 万输出 tokens**;使用搜索 grounding、Maps 或其他 Google 服务可能产生额外费用(搜索 grounding 将于 2026 年 1 月 5 日开始计费)。

通过 CometAPI 使用 GPT-5.2 与 Gemini 3

CometAPI 是一个网关 / 聚合 API:以单一、OpenAI 风格的 REST API 端点,为你提供来自多家厂商的数百个模型(LLM、图像/视频模型、向量模型等)的统一访问。相比集成多个厂商 SDK,CometAPI 允许你调用熟悉的 OpenAI 格式端点(chat/completions/embeddings/images),并在底层切换模型或供应商。

开发者可以通过 CometAPI 同时无缝使用两家公司的旗舰模型,无需切换供应商,而且 API 价格更实惠,通常有 8 折优惠。

示例:快速 API 片段(复制粘贴即可试用)

以下是最小示例,可直接运行。它们参考了各厂商发布的快速上手(OpenAI Responses API + Google GenAI 客户端)。将 $OPENAI_API_KEY / $GEMINI_API_KEY 替换为你的密钥。

GPT-5.2 — Python(OpenAI Responses API,深难题将推理设为 xhigh)

# Python (requires openai SDK that supports responses API)from openai import OpenAIclient = OpenAI(api_key="YOUR_OPENAI_API_KEY")resp = client.responses.create( model="gpt-5.2-pro", # gpt-5.2 or gpt-5.2-pro input="Summarize this 50k token company report and output a 10-slide presentation outline with speaker notes.", reasoning={"effort": "xhigh"}, # deeper reasoning max_output_tokens=4000)print(resp.output_text) # or inspect resp to get structured outputs / tokens

Notes: reasoning.effort 可在成本与深度之间权衡。日常聊天可用 gpt-5.2-chat-latest。OpenAI 文档给出了 responses.create 的示例。

GPT-5.2 — curl(简单)

curl https://api.openai.com/v1/responses \ -H "Authorization: Bearer $OPENAI_API_KEY" \ -H "Content-Type: application/json" \ -d '{ "model": "gpt-5.2", "input": "Write a Python function that converts a PDF with tables into a normalized CSV with typed columns.", "reasoning": {"effort":"high"} }'

(在 JSON 中查看 output_text 或结构化输出。)

Gemini 3 Pro Preview — Python(Google GenAI 客户端)

# Python (google genai client) — example from Google docsfrom google import genaiclient = genai.Client(api_key="YOUR_GEMINI_API_KEY")response = client.models.generate_content( model="gemini-3-pro-preview", contents="Find the race condition in this multi-threaded C++ snippet: <paste code here>", config={ "thinkingConfig": {"thinking_level": "high"} })print(response.text)

Notes: thinking_level 控制模型的内部推理;图像/视频可设置 media_resolution。REST 与 JS 示例见 Google 的 Gemini 开发指南。;

Gemini 3 Pro — curl(REST)

curl "https://generativelanguage.googleapis.com/v1beta/models/gemini-3-pro-preview:generateContent" \ -H "x-goog-api-key: $GEMINI_API_KEY" \ -H "Content-Type: application/json" \ -X POST \ -d '{ "contents": [{ "parts": [{"text": "Explain the race condition in this C++ code: ..."}] }], "generationConfig": {"thinkingConfig": {"thinkingLevel": "high"}} }'

Google 的文档包含多模态示例(内联图像数据、media_resolution)。

哪个模型更“好”——实践指南

没有放之四海而皆准的“赢家”;应基于用例与约束进行选择。以下是简短的决策矩阵。

在以下情况下选择 GPT-5.2:

- 你需要与代码执行工具(OpenAI 的 interpreter/工具生态)紧密集成,用于程序化数据管道、表格生成或代理型代码工作流。OpenAI 强调了 Python 工具改进与巨型代理的使用。

- 你优先考虑token 效率(基于厂商声明),并希望获得 OpenAI 明确、可预测的按 token 定价,以及对缓存输入的大幅折扣(利于批处理/生产工作流)。

- 你希望使用 OpenAI 生态(ChatGPT 产品集成、Azure / Microsoft 合作,以及围绕 Responses API 与 Codex 的工具)。

在以下情况下选择 Gemini 3 Pro:

- 你需要极致多模态输入(视频 + 图像 + 音频 + PDFs),并希望单一模型原生接收所有这些输入,且具备1,000,000 token的输入窗口。Google 明确将其用于长视频、大文档 + 视频管线与交互式 Search/AI Mode 场景。&

- 你基于 Google Cloud / Vertex AI 构建,并希望与 Google 搜索 grounding、Vertex 资源配置与 GenAI 客户端 API 紧密集成。你将受益于 Google 产品集成(Search AI Mode、AI Studio、Antigravity 代理工具)。

结论:2026 年谁更好?

在GPT-5.2 vs. Gemini 3 Pro Preview的较量中,答案取决于语境:

- GPT-5.2在专业知识工作、分析深度与结构化工作流上领先。

- Gemini 3 Pro Preview在多模态理解、生态集成与大上下文任务上更胜一筹。

两者没有绝对意义上的“更好”——它们的优势面向不同的真实需求。聪明的采用者应将模型选择与具体用例、预算约束与生态契合度相匹配。

可以明确的是,在 2026 年,AI 前沿显著前移,GPT-5.2 与 Gemini 3 Pro 都在推动企业及更广领域的智能系统能力上限。

如果你想立即试用,请在 CometAPI 的 Playground中探索 GPT-5.2 与 Gemini 3 Pro 的能力,并查阅 API 指南获取详细说明。访问前,请确保已登录 CometAPI 并获得 API Key。CometAPI 提供远低于官方的价格,帮助你更低成本集成。

准备好开始了吗?→ 免费试用 GPT-5.2 与 Gemini 3 Pro !

If you want to