xAI 宣布推出其 Grok 系列的成本优化变体 Grok 4 Fast。据该公司称,该模型在基准测试中的表现接近旗舰水平,同时相比 Grok 4,将实现同等性能的价格削减了 98%。新模型面向高吞吐搜索与代理式工具使用,提供 200 万 token 的上下文窗口,并提供“reasoning”和“non-reasoning”两种变体,便于开发者按需调优算力。

核心特性与优势

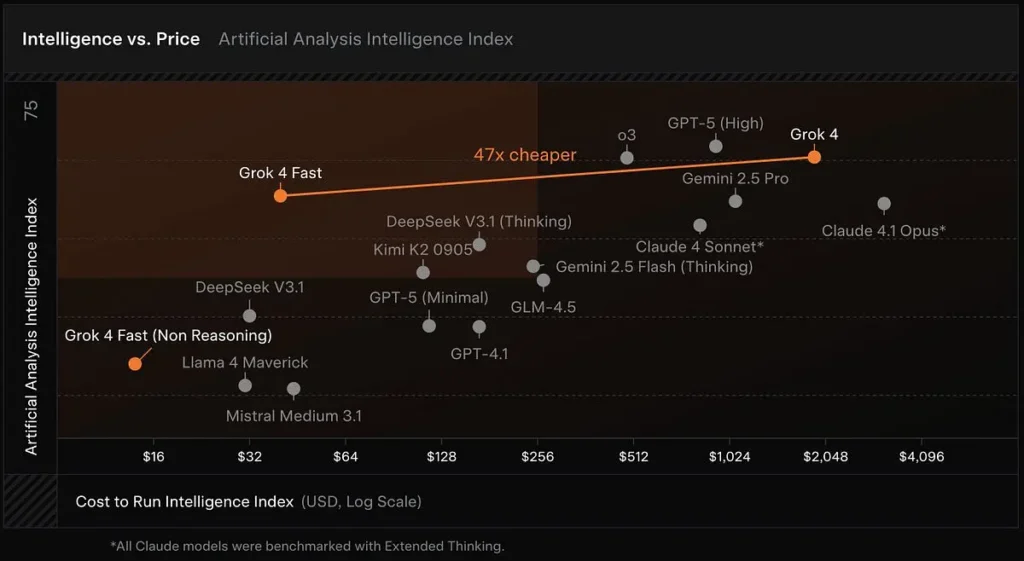

**高性价比推理模型:**Grok 4 Fast 源自 Grok 4 家族,重点优化 token 效率与实时工具使用。xAI 报告称,该模型平均需要约少 40% 的“thinking” token。Artificial Analysis(跟踪众多公开模型的时延、输出速度与性价比)将 Grok 4 Fast 置于智能与成本前沿的高位,并在早期测试中验证了其快速的输出速度与良好的成本比。

**大型上下文窗口:**Grok 4 Fast 专为高吞吐搜索与代理式工具使用而设计,提供 200 万 token 的上下文窗口,并提供“reasoning”和“non-reasoning”两种变体,便于开发者按需调优算力。

**原生工具使用能力:**Grok 4 Fast 提供“最前沿的 web 与 X 搜索能力”,可在代理式工作流中提升对网页内容的检索、导航与综合能力——使其成为需要实时信息获取与跨长文档推理的应用的实用搜索工具;在多个搜索基准上表现领先,包括:

- BrowseComp (zh): 51.2%(对比 Grok 4 的 45.0%)

- X Bench Deepsearch (zh): 74.0%(对比 Grok 4 的 66.0%)

**统一架构:**同一模型同时支持推理与非推理模式,无需在不同模型间切换。延迟与成本的降低使其适用于实时应用(如搜索、问答与研究助理)。

性能对比(主要基准)

在 xAI 分享的 LMArena 私测中,grok-4-fast-search(代号 menlo)位居 Search Arena 榜首,Elo 评分达 1,163;文本变体(tahoe)位列 Text Arena 前十——这些结果支持了 xAI 关于搜索性能的相关主张。

Grok 4 Fast 在多个前沿基准上与 Grok 4 持平或小幅落后(例如:GPQA Diamond、AIME 2025 与 HMMT 2025),同时在推理任务上优于此前的小型模型——这些是 xAI 用以支撑其“可比性能”主张的证据。

结果对比

与 Grok 4 相比:更便宜、计算开销更低,但性能相近。

与 Grok 3 Mini 相比:更强大,能够进行复杂推理和实时搜索。

与 GPT-5/Gemini/Claude 相比:凭借极高的 token 效率与工具能力,在性价比和部分搜索任务上占优。

定价与可用性

**上下文与 token:**两种模型变体:grok-4-fast-reasoning 与 grok-4-fast-non-reasoning,均为 2M 上下文。

发布帖中的标价(示例分级):

- 输入 token:$0.20 / 1M(<128k)— $0.40 / 1M(≥128k)

- 输出 token:$0.50 / 1M(<128k)— $1.00 / 1M(≥128k)

- 缓存的输入 token:$0.05 / 1M。

(确切计费规则及任何限时促销,请参见 xAI 公告。)

**供应商可用性:**xAI 表示可通过 OpenRouter 与 Vercel AI Gateway 提供短期免费使用,并通过 xAI 的 API 提供一般可用性。

对用户与团队意味着什么

- 用于生产的巨大成本节省——更低的单 token 定价与更少的“thinking” token 相结合,意味着团队可用远低于 Grok 4 的成本运行更多查询或更大上下文的工作流,大幅降低试验与规模化部署的门槛。(该主张由 xAI 的成本/性能披露与第三方成本分析支持。)

- 适用于超长文档与多步推理——2M token 使得在单次会话中摄取整本书、大型代码库或冗长的法律/技术档案成为现实,能够提升需要长程上下文的任务的准确性与一致性(如文档检索、摘要、长文本代码生成、研究助理)。

- 更快、更低延迟的交互式应用输出——作为“Fast”变体,其针对更高的 token 吞吐与更低延迟进行工程优化,这将利好聊天界面、编码助理以及对响应速度敏感的实时代理循环。(Artificial Analysis 与多家提供方的基准强调输出速度是其差异化优势。)

- 针对基准化推理任务的优良性价比——对于用前沿学术基准评估模型的团队,Grok 4 Fast 提供了强有力的折中方案:以显著更低的成本实现近前沿的准确度,适合经常运行昂贵基准套件的研究机构与公司。

结论:

Grok 4 Fast 使 xAI 能在性价比与面向搜索的代理应用上展开竞争。若其关于效率与验证的主张能在独立、特定领域的测试中站得住脚,Grok 4 Fast 或将重塑高能力、工具增强型 LLM 部署的成本预期——尤其是依赖实时网页检索与多步工具使用的应用。

入门

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500+ 个 AI 模型(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)聚合到一个对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到应用中的流程。无论你在构建聊天机器人、图像生成器、音乐创作工具,还是数据驱动的分析管线,CometAPI 都能帮助你更快迭代、控制成本并保持供应商无关性,同时紧跟整个 AI 生态的最新突破。

开发者可通过 CometAPI 访问 Grok-4-fast( model: grok-4-fast-reasoning” / “grok-4-fast-reasoning),最新模型版本 将与官网保持同步更新。开始之前,可在 Playground 中探索模型能力,并参阅 API guide 获取详细说明。访问前,请确保已登录 CometAPI 并获取 API key。CometAPI 提供远低于官方价格的方案,助你更快集成。

准备好开始了吗?→ 立即注册 CometAPI!