将 Coze——一个可视化 AI 代理与工作流平台——与 CometAPI——一个统一的、兼容 OpenAI 的 500+ 模型网关——集成起来,可以把 Coze 的低代码代理工具与插件系统,与 CometAPI 多模型目录在成本/控制方面的优势相结合。结果:代理可以调用你想要的精确模型(或图像/视频端点),在不重写代码的情况下切换服务商,并通过统一计费从原型扩展到生产。

什么是 Coze?

Coze 是一个 AI 应用与代理开发平台,专注于可视化工作流构建、插件/工具,以及将代理发布为 API 或聊天应用。它旨在让非工程师与工程师都能基于模型选择、提示词、逻辑模块和外部工具(插件)来组装聊天机器人/代理——然后发布这些代理或工作流,并以编程方式调用。

在集成外部 AI API 时你会用到的 Coze 关键功能:

- 插件 / 工具: Coze 可以将外部 API 作为插件导入/注册,并在工作流中将这些端点暴露为工具。这是第三方服务的官方扩展点。

- 工作流 / 代理节点: 工作流是由节点(逻辑、代码、插件/工具调用、API 调用)组成的可视化序列,代理会按顺序执行以完成任务。某些节点允许你发起 HTTP/API 调用或调用已注册的插件工具。

- 发布为 API: 完成的代理/工作流可以发布为 API 服务(供其他应用调用),并且它们在执行过程中也可以调用外部 API。

什么是 CometAPI,为什么选择它?

CometAPI 是一个统一的 API 网关,通过一个一致的接口(聊天补全、图像生成等)提供对数百个模型的访问。团队使用 CometAPI 以避免供应商锁定、进行模型 A/B 测试,并通过在不重写代码的情况下切换模型来优化成本。该服务提供标准端点,例如用于聊天式生成的 https://api.cometapi.com/v1/chat/completions。

为什么将 CometAPI 与 Coze 搭配使用?

- 模型选择与可移植性:将 Coze 代理指向 CometAPI,在中心化位置切换模型。

- 成本控制与速率管理:CometAPI 允许你为常规任务选择低成本模型,为高价值查询选择高端模型。

- 集中可观测性:在一个地方轮换密钥、监控用量并应用配额。

- 模型选择与供应商可移植性:借助 CometAPI,你无需为每家供应商分别集成就能选择多种提供商与模型。这让 Coze 代理可以进行模型 A/B 测试、回退到更便宜的选项,或选择专项模型(例如视觉模型、音乐模型)。

- 即插即用兼容性:CometAPI 的 OpenAI 兼容接口通常意味着对现有 OpenAI 风格客户端或期望标准格式的 Coze 节点只需最小改动。

- 快速上市:使用 Coze 的低代码工作流 + CometAPI 的模型目录,快速组装高级多工具代理(例如用一个模型做摘要,用另一模型做图像生成)。

如何通过在 Coze 中搜索 CometAPI 插件来集成?

简短回答:将 CometAPI 注册/导入为插件,完成授权,然后在工作流中调用其工具。

分步操作(插件市场 / 导入)

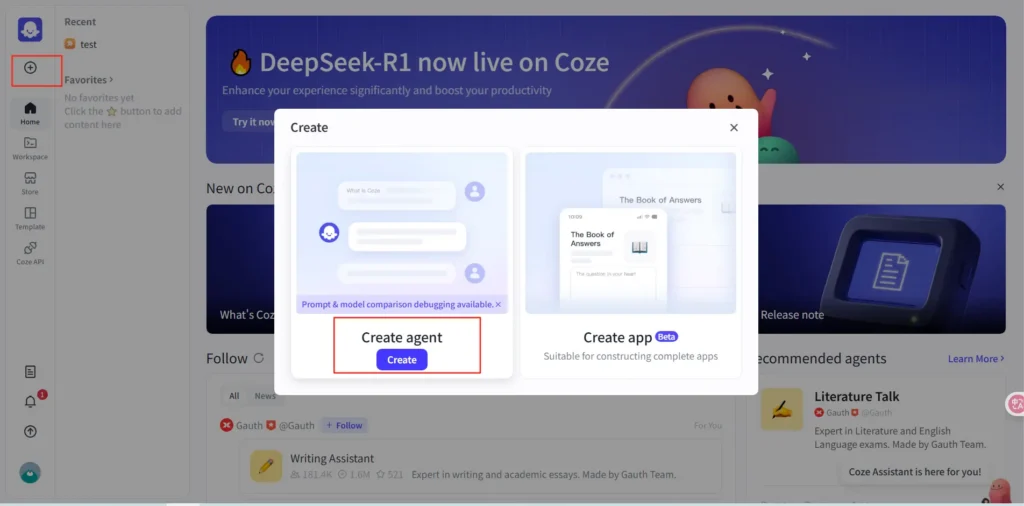

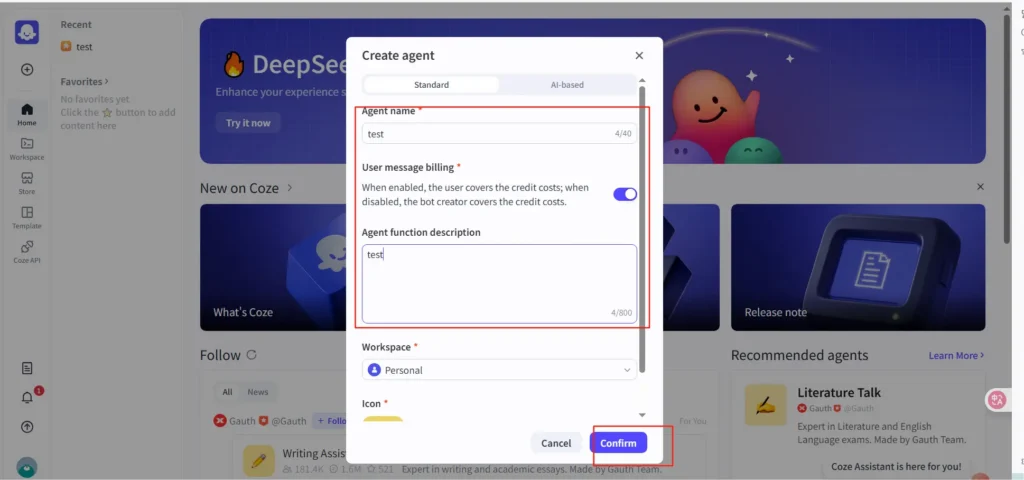

- 进入 Coze,点击 “Get Start”,创建一个用于测试的代理。

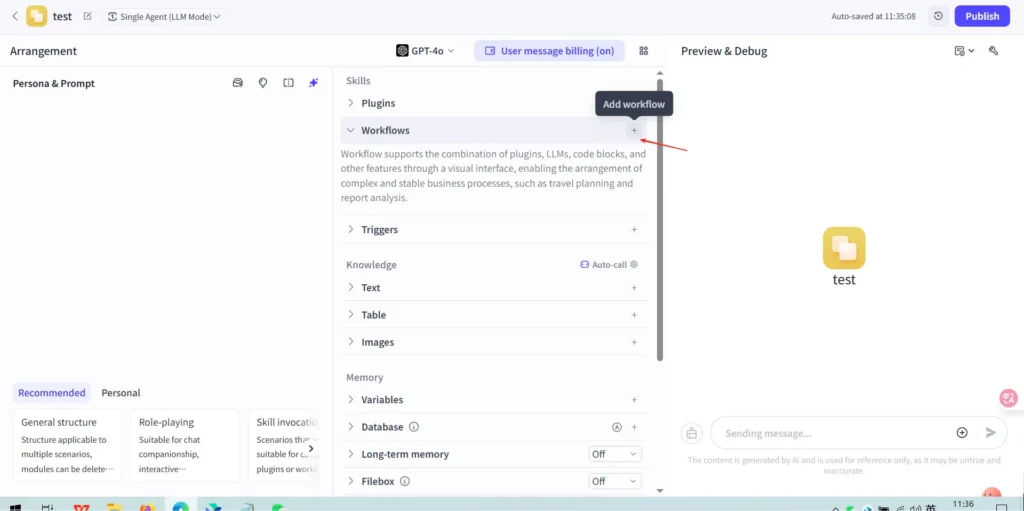

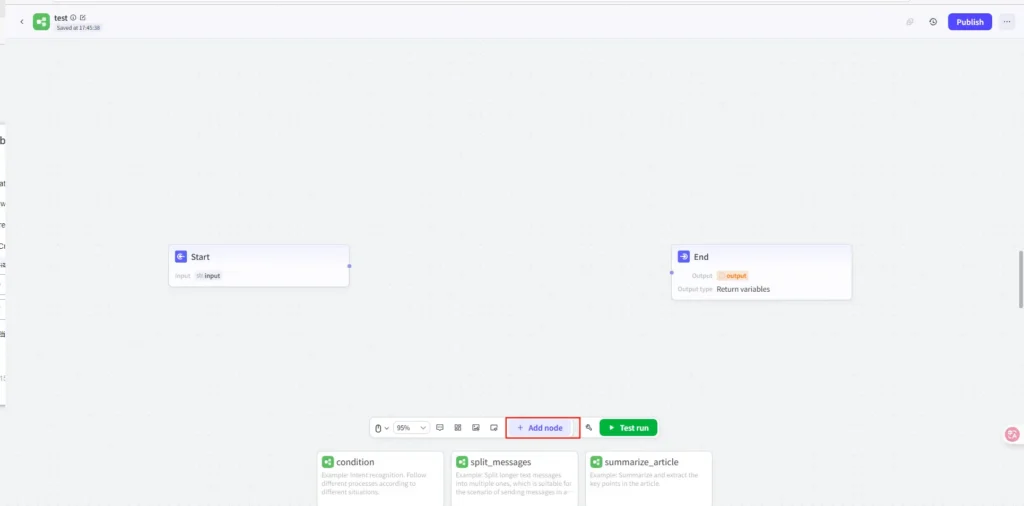

- 然后添加一个工作流,选择 “add node”

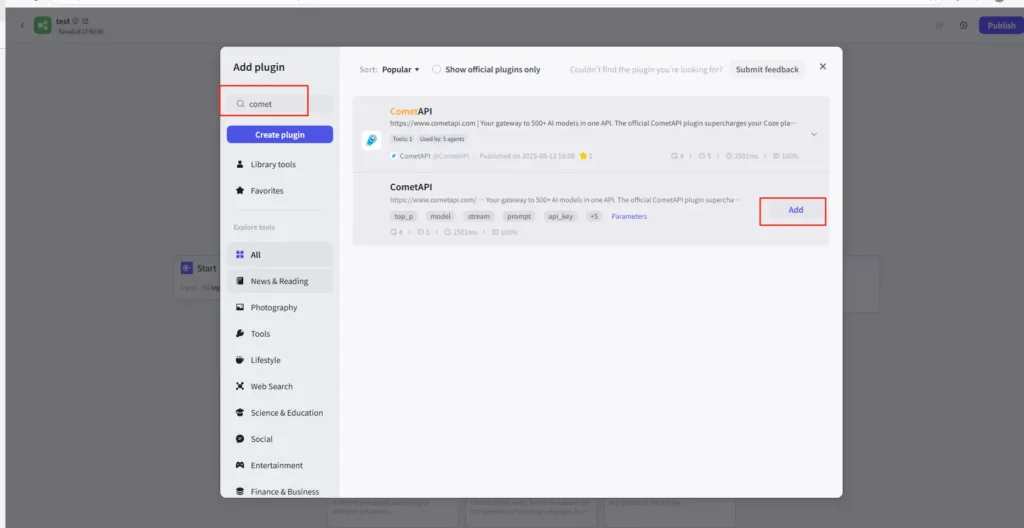

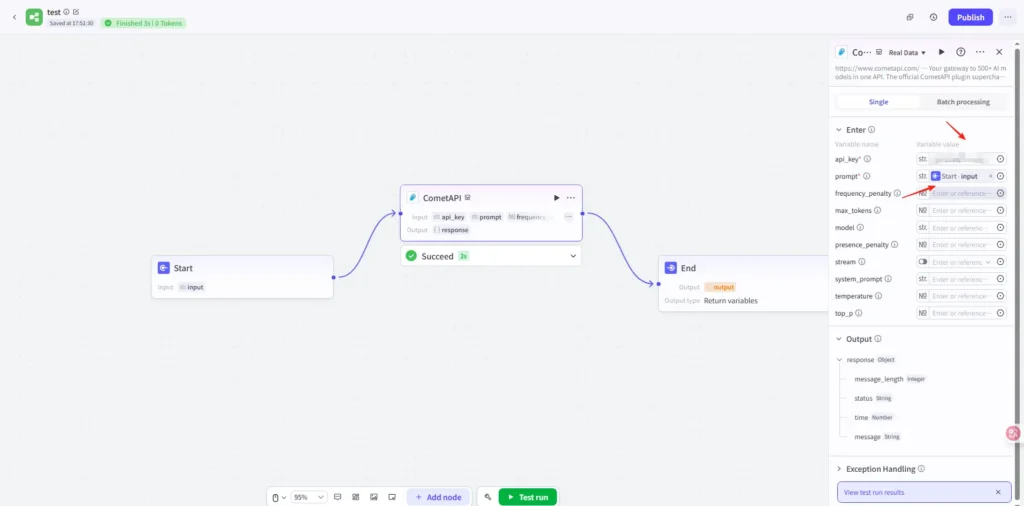

- 在市场中搜索 “CometAPI”: 在工作流中选择 “add node”,点击 plugins 并搜索 “cometapi”,添加该插件;在搜索框中输入 “CometAPI”——它将出现在结果中。点击插件卡片 → add。根据屏幕提示添加凭据

3.在 “api key” 输入框中粘贴从 CometAPI 获取的 “sk-xxxxx” 密钥;然后测试并发布。

何时使用这种方法

- 存在官方或社区版 CometAPI 插件。

- 你偏好零代码设置与集中式插件管理。

- 你的团队希望以最简单的路径上线生产。

如何通过创建代理并在工作流中使用 API 调用节点集成?(方法二)

这种方法在工作流运行时提供更细粒度的控制(路由、重试、条件逻辑)。

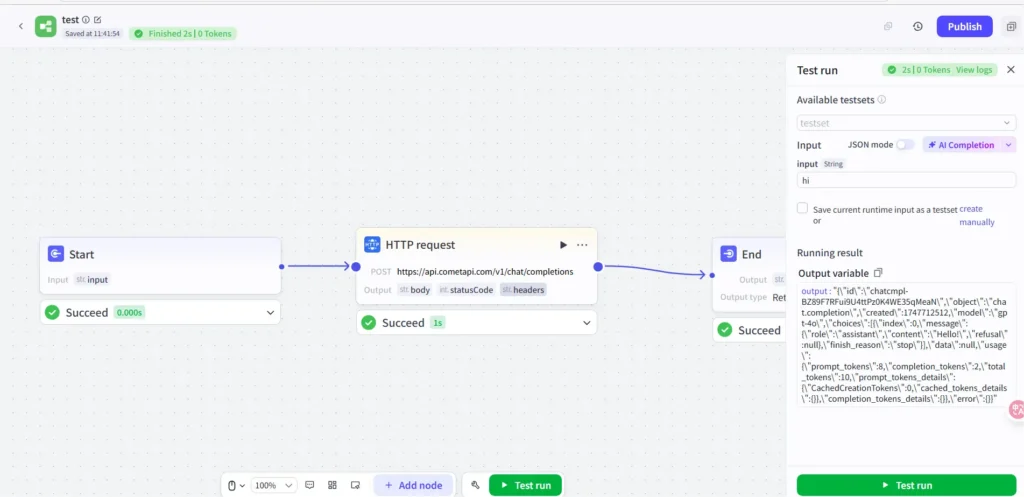

分步操作:创建代理 + 添加 API 调用(HTTP)节点

- 在 Coze 中创建一个代理(Bot/Agent → Create)。配置人格、基础提示词,如果计划稍后将其暴露为 API,请配置发布设置。

- 打开该代理的 Workflows,添加一个新工作流或编辑现有工作流。工作流是由消息节点、条件节点、HTTP/API 节点等构成的可视化序列。

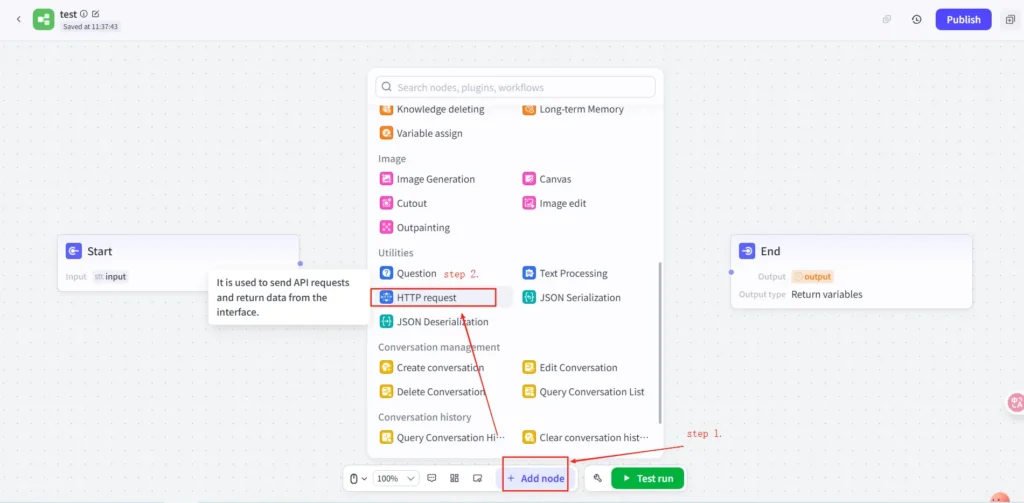

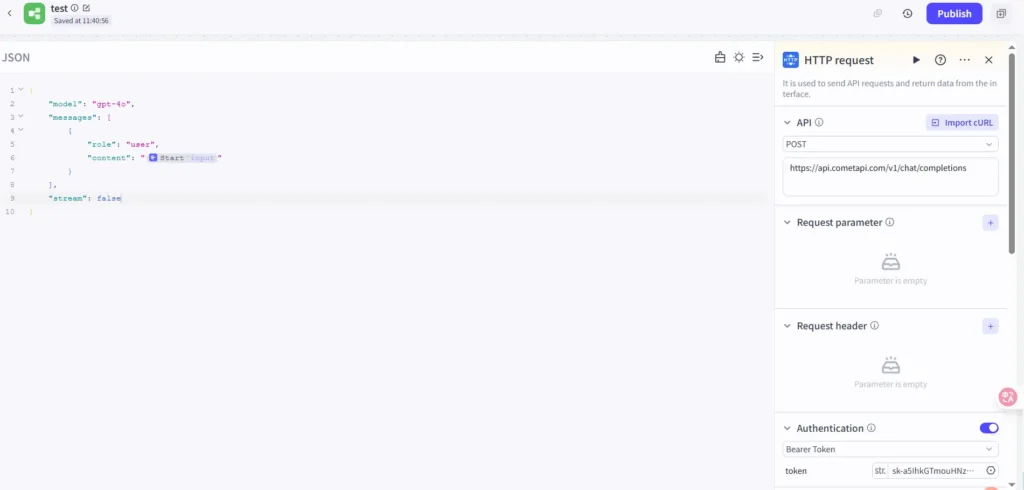

- 从节点面板中添加 HTTP request 节点。将其配置为调用 CometAPI:设置方法为

POST,URL 为https://api.cometapi.com/v1/chat/completions(或在 CometAPI 文档中列出的模型专用路径),并添加请求头与请求体。 - 在 Authentication token 输入框中粘贴从 CometAPI 获取的 “sk-xxxxx” 密钥,然后点击 “Confirm”。

HTTP 节点配置示例(非流式)

Headers:

Authorization: Bearer sk-<YOUR_COMETAPI_KEY>Content-Type: application/json

Body(JSON——CometAPI 支持 OpenAI 风格的格式):

{

"model": "gpt-4.1",

"messages": [

{"role":"system","content":"你是一名乐于助人的助手。"},

{"role":"user","content":"请用要点概述近期的 AI 新闻。"}

],

"stream": false

}

- 将输出回接到工作流中。把 HTTP 响应字段(例如

choices.message.content)映射到后续的消息节点或代理响应中。Coze 工作流允许你提取 JSON 字段并将其作为变量复用。 - 处理流式与长输出。如果你需要为打字体验提供流式增量 token,Coze 支持以流式响应模式执行工作流并暴露流式事件;如果你的节点/输出需要,可使用 streaming exec API。

- 对于结束节点的输出,选择 HTTP 请求的 body,然后测试并发布。

- 充分测试。使用 Coze 的 Play/Test 界面进行试运行,并检查节点级输入/输出以便调试。Coze 会提供试运行 UI,展示每个节点的入参/出参,这对将插件响应映射为代理文本非常有帮助。

面向生产集成的最佳实践

1) 保护密钥并使用工作区机密

将 CometAPI 密钥存储在 Coze 的密钥管理器(或环境变量)中,并在插件/认证配置中引用。切勿将密钥嵌入提示词或节点请求体。

2) 模型选择与路由策略

- 采用分层模型策略:基础问答使用低成本模型,政策/法律/关键流程使用高准确模型。

- 将选择逻辑放入 Coze 工作流,这样你可以在不重新部署代码的情况下进行 A/B 或更改规则。借助 CometAPI 的统一 API,切换

model参数非常简单。

3) 超时、重试与退避

在 Coze 工作流节点中为 CometAPI 调用添加超时与指数退避。设置回退链——如果首选模型超时,则回退到更便宜或缓存的结果。Coze 支持条件节点与错误处理,可增强稳健性。

4) 成本控制与可观测性

跟踪各模型的 token 使用并在你的可观测性系统中呈现。使用 CometAPI 的仪表板进行计费,同时用 Coze 日志进行请求级调试。将代理事件与 CometAPI 请求 ID 关联以便排障。

5) 提示工程与工具描述

在 Coze 中创建插件工具时,编写精准的工具名称与描述——Coze 可以将这些描述传给模型,从而提升工具选择与调用的准确性。保持工具 schema 精简且强类型。

6) 安全与内容审核

如果你的代理会处理用户内容,请在向下游传递敏感结果前执行安全/审核流程(使用 CometAPI 或你自己的过滤器)。始终限制模型输出,避免从微调/检索的内容中泄露机密或 PII。

7) 流式与批处理测试

流式可以带来更好的终端用户打字体验,但处理更复杂。仅在需要增量 token 时使用 Coze 的流式执行;对于许多后端任务,一个 API 调用 + 单次响应更简单、更经济。

Coze + CometAPI 最适合哪些真实用例?

用例:多模态客户支持助手

- 流程: 用户消息 → 代理决策(文本 LLM 做理解) → 获取知识库(插件) → 生成摘要与建议回复(CometAPI LLM) → 可选生成辅助图像(通过 CometAPI 调用 Midjourney / Suno) → 发送回复。

- 为何有效: CometAPI 让你将文本路由到高质量推理模型,同时将图像任务交给专业图像模型,并且都来自同一个集成点。

用例:在生产环境进行模型 A/B 评估

- 流程: Coze 代理针对两个不同的 CometAPI 模型(例如

o4-mini与gpt-4o)运行同一提示,并记录指标(时延、用户评分)以决出优胜。 - 为何有效: 集中式模型切换使 A/B 测试的实现成本更低。

用例:大规模文档自动化与摘要

- 流程: Coze 工作流接收文档 URL,调用 CometAPI(擅长长上下文摘要的模型),然后提取行动项并将结构化工单写入下游系统。

- 为何有效: CometAPI 支持文档/文件输入模式(示例见其文档),而 Coze 提供用于下游动作的工作流自动化。

用例:创意流水线(营销素材)

- 流程: 提示工程节点 → 生成标语(LLM) → 生成图像(通过 CometAPI 调用 Midjourney 或 Runway 模型) → 将结果组合为营销简报 → 发布。

- 为何有效: CometAPI 的多模型目录包含创意图像/视频生成器,你可以在单一工作流中以编程方式调用。

结语

将 Coze 的可视化、工作流优先的代理构建方式与 CometAPI 广泛且 OpenAI 兼容的模型接口相结合,为团队带来强大组合:低代码快速迭代的速度,加上为每个微任务选择最契合模型的灵活性。原型阶段优先使用插件方式以快速推进;当你需要对请求头、流式、重试进行更精细控制,或编排多模型管线时,再转向显式的 API 调用工作流。密切监控成本与质量,并让模型选择可配置,以便随着模型版图变化持续演进。

入门指南

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500 多个 AI 模型(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)聚合到一个对开发者友好的接口中。通过提供一致的身份验证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到应用中的流程。无论你是在构建聊天机器人、图像生成器、音乐作曲器,还是数据驱动的分析管线,CometAPI 都能让你更快迭代、控制成本并保持供应商无关,同时紧跟 AI 生态的最新进展。

开始之前,可在 Playground 中探索模型能力,并查阅 Coze Integration Guide 获取详细说明。访问前请确保已登录 CometAPI 并获取 API 密钥。CometAPI 提供远低于官方价格的方案,帮助你完成集成。

准备好开始了吗?→ 立即注册 CometAPI !