Qwen2.5-Max 在大规模语言模型领域代表了重大进步,展现出在自然语言理解与生成方面的卓越能力。由 Qwen 团队开发,该模型利用前沿技术,在各类基准测试中实现了卓越表现。

什么是 Qwen2.5-Max?

Qwen2.5-Max 是一款最先进的大规模语言模型,旨在推动自然语言理解与生成的边界。采用专家混合(MoE)架构,在高效扩展计算的同时,在各类 AI 基准测试中提供更优性能。该模型在超过 20 万亿个标记的海量数据集上进行预训练,确保对多种语言、主题与技术学科具备广泛而深入的理解。

Qwen2.5-Max 的关键特性

- 专家混合(MoE)架构:通过为每次查询选择特定专家来优化计算,提高效率。

- 广泛的预训练:在海量数据集上训练,具备更强的理解与知识表示能力。

- 强化的推理与理解:在数学问题求解、逻辑推理与编码任务上表现优于其他模型。

- 结合监督与强化学习微调:引入来自人类反馈的强化学习(RLHF),优化回复并提升可用性。

Qwen2.5-Max 如何工作?

1. 专家混合(MoE)架构

Qwen2.5-Max 采用专家混合系统,为每次查询动态选择一部分专家神经网络。该方法仅为特定任务激活相关专家,从而在保持准确性的同时降低计算开销,确保高效率与可扩展性。

2. 广泛的预训练

该模型在覆盖多领域的多样化数据集上训练,包括文学、编码、科学与对话语言。如此广泛的训练使 Qwen2.5-Max 能以极高的流畅度与上下文准确性理解并生成文本。

3. 监督与强化学习优化

在预训练之后,Qwen2.5-Max 使用人工标注数据与来自人类反馈的强化学习(RLHF)进行微调。这提升了其与人类期望的对齐程度,使其在多种应用中更可靠。

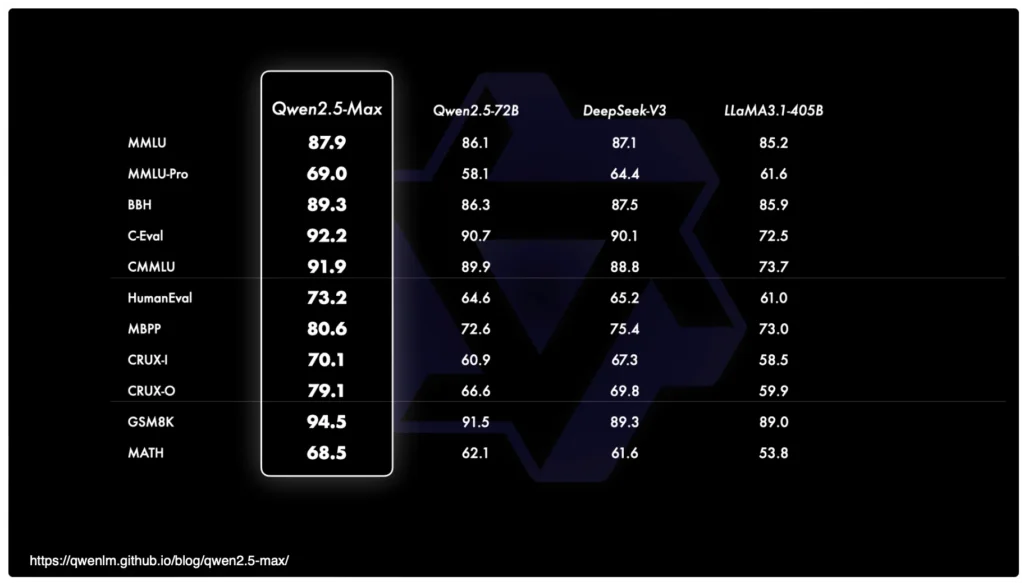

4. 基准表现

Qwen2.5-Max 在多个行业标准基准中表现优异:

- Arena-Hard、LiveBench、LiveCodeBench 和 GPQA-Diamond:在这些 AI 评估平台上持续名列前茅。

- 数学与编程:在计算性推理与编码挑战中位居第一。

- 复杂任务处理:在处理细微差别与多步骤问题上取得第二名。

如何使用 Qwen2.5-Max

1. 访问 Qwen2.5-Max

Qwen2.5-Max 可通过多种方式访问。以下为详细步骤:

通过官方网站访问

体验 Qwen2.5-Max 的最快方式是通过 Qwen Chat 平台。这是一个基于网页的界面,允许你直接在浏览器中与模型交互——就像你在浏览器中使用 ChatGPT 一样。

- 访问 Qwen2.5-Max 官方网站。

- 注册或使用你的凭据登录。

- 进入“入门”部分。

- 在免费访问(如可用)或订阅计划之间选择。

- 按照引导文档开始使用该模型。

使用 Qwen2.5-Max API

- 前往官方 Qwen API 文档页面。

- 注册账户以获取 API 密钥。

- 验证后登录并获取你的 API 凭据。

- 通过向指定端点发送带有正确认证的请求来使用 API。

- 使用 Python、JavaScript 或任何偏好的编程语言将 API 集成到你的应用中。

通过云平台访问

- 访问托管 Qwen 2.5-Max 的云服务商,如 Alibaba Cloud 或 Hugging Face。

- 若尚无账户,请先创建账户。

- 在 AI/ML 分区搜索“Qwen2.5-Max”。

- 选择模型并配置你的访问设置(算力、存储等)。

- 托管模型并通过交互式环境或 API 调用开始使用。

本地部署 Qwen2.5-Max

- 在 GitHub 或官方网站查找开源或可下载版本。

- 确保系统满足硬件要求(GPU、内存、存储)。

- 按照文档提供的安装说明操作。

- 安装必要依赖并配置环境。

- 在本地运行模型并测试其能力。

使用 CometAPI(第三方 AI 平台)

CometAPI 提供远低于官方价格的方案,帮助你集成 qwen 2.5 max API,注册并登录后你的账户将获得 $1!

CometAPI 提供对 500+ 款 AI 模型的访问,包括开源与专用的多模态模型,覆盖聊天、图像、代码等。其主要优势在于简化传统复杂的 AI 集成流程。欢迎注册并体验 CometAPI。

- 登录到 cometapi.com。如果你还不是我们的用户,请先注册

- 获取接口的访问凭证 API key。在个人中心的 API token 处点击“Add Token”,获得 token key:sk-xxxxx 并提交。

- 通过其网页界面、API 或聊天机器人服务访问 Qwen2.5-Max(模型名称:qwen-max)。

- 使用内置工具生成文本、代码或分析数据。

2. 实际应用

- 会话式 AI:用于聊天机器人与虚拟助手。

- 代码辅助:帮助开发者高效生成与调试代码。

- 教育支持:以高级推理能力增强辅导系统。

- 内容创作:高准确地产出文章、摘要与营销文案。

2. 实际应用

- 会话式 AI:用于聊天机器人与虚拟助手。

- 代码辅助:帮助开发者高效生成与调试代码。

- 教育支持:以高级推理能力增强辅导系统。

- 内容创作:高准确地产出文章、摘要与营销文案。

与其他 AI 模型的比较

Qwen2.5-Max 与 GPT-4

| 特性 | Qwen2.5-Max | GPT-4 |

|---|---|---|

| 架构 | 专家混合 | 稠密 Transformer |

| 预训练数据 | 超过20万亿个标记 | ~13万亿个标记 |

| 效率 | 高(仅激活所需专家) | 较低(处理整个模型) |

| 代码理解 | 强(编码基准排名靠前) | 强(表现良好但低于 Qwen2.5-Max) |

| 数学推理 | 高级 | 中等 |

Qwen2.5-Max 与 DeepSeek-V3

| 特性 | Qwen2.5-Max | DeepSeek-V3 |

|---|---|---|

| 知识覆盖 | 广泛(多领域) | 聚焦(以技术与科学为主) |

| 逻辑推理 | 高 | 中等 |

| API 可用性 | 是 | 受限 |

| 模型适配性 | 针对多种应用进行微调 | 在较少领域中更为专长 |

其他模型

未来展望

预计 Qwen2.5-Max 将进一步融合多模态能力,使其能够处理图像、视频与结构化数据。未来版本可能包括更好的实时学习与改进的交互处理,使其成为更强大的 AI 驱动解决方案工具。

结论

Qwen 2.5-Max 代表了人工智能领域的一次重大进步,在推理、理解与任务执行方面超越现有模型。凭借创新的专家混合架构、广泛训练与卓越的基准表现,它有望在软件开发、客户支持与教育等行业中推动应用革新。随着 AI 的持续发展,Qwen 2.5-Max 有望在提供尖端 AI 解决方案方面继续领跑。