Luma AI 已成为消费级与准专业内容创作领域讨论度最高的工具之一:一款可将智能手机照片与视频转换为逼真 3D NeRF 的应用与云服务,并且通过其 Dream Machine / Ray2 模型,能根据文本或图像提示生成图像和短视频。不过,速度是创作者首先会关心的实际问题之一:一次采集、渲染或视频生成究竟要花多长时间?

Luma AI 生成 Dream Machine(文本 → 视频)片段需要多久?

官方基线时长

Luma 的产品页面与学习中心为其图像与短视频生成流程给出了较快的基线时长:在正常负载下,针对付费用户与内部基准,图像批次以几十秒计,短视频任务以数秒到几分钟计。这些官方指标反映的是在 Luma 基础设施(Ray2 / Dream Machine 栈)上优化后的模型运行,属于面向短小片段的最佳情况数值。

你应预期的真实世界范围

边缘情况 / 免费等级或峰值负载:免费用户或在需求高峰期,等待可能长达数小时,或任务“排队卡住”直到资源释放;社区讨论中记录了在峰值或故障期间的多小时等待。如果低时延至关重要,请将这种波动纳入考量,并考虑付费/优先选项。

小型社交短片(5–15 秒):在正常负载下,针对付费用户,生成步骤本身通常可在一分钟以内到几分钟完成——但若计算排队、预处理以及流式传输/导出步骤,总耗时可能更长。

更高细节或更长片段(20–60 秒):这类任务可能耗时数分钟到几十分钟,尤其当你要求更高分辨率、复杂镜头运动或迭代微调时。第三方评测与用户反馈显示,更复杂的短视频通常处于5–30 分钟区间。

Luma AI 生成 3D 捕捉(NeRF / Genie / 手机捕捉)需要多久?

典型 3D 捕捉流程及其耗时概况

Luma 的 3D 捕捉工具(移动捕捉应用 + 类 Genie 功能)可将一组照片或录制的视频转换为类似 NeRF 的 3D 模型或贴图网格。不同于短版 Dream Machine 片段,3D 重建更为繁重:需要摄取大量帧、估计相机位姿、优化体素几何并合成纹理。公开教程与实操指南报告称,依据捕捉时长与质量,实际处理时间从几分钟到数小时不等。一个常被引用的教程示例显示,中等规模的捕捉耗时30 分钟到 1 小时;其他类型(长时间漫游、高分辨率帧)可能更久。

代表性范围

- 快速对象/产品扫描(20–80 张照片,短时捕捉):几分钟到约 30 分钟。

- 房间尺度或漫游式捕捉(数百到数千帧):30 分钟到数小时,取决于输入规模与最终导出的保真度。

- 面向游戏引擎的高保真导出(网格、高分辨率纹理):网格生成、重新拓扑与烘焙需要额外时间——这类任务可能延长至数小时。

3D 为何比短视频更耗时

3D 重建是迭代且偏优化密集型的:模型需要跨大量帧不断细化体积场与纹理预测,计算量很大。Luma 的后端会对其中大量工作进行并行化,但单个任务的计算规模仍显著大于一次短视频生成。

影响 Luma AI 处理时长的主要因素有哪些?

模型与流程选择(Ray2、Photon、Genie、Modify Video)

不同的 Luma 模型与功能针对不同的取舍进行设计:Ray2 与 Dream Machine 优先考虑逼真视频生成与低时延的交互反馈,而 Photon 与 Genie 则优化于图像增强或 3D 重建,设计上可能更重。选择更高保真设置的模型会增加计算时间。官方文档与 API 描述了多种模型端点与质量标志,这些都会影响运行时长。

输入规模与复杂度

- 帧数/照片数量:输入越多 = 优化步骤越多。

- 分辨率:更高的输出分辨率与更高分辨率的输入都会增加处理时间。

- 请求片段时长:更长的片段需要更多渲染与运动连贯性检查。

账户等级、排队与优先级

付费订阅与企业/API 客户通常会获得优先级或更高的速率限制。系统承压时,免费层用户往往会遇到更长的排队时间。社区反馈也证实:付费方案通常能减少等待并提升吞吐。

系统负载与时间段

真实用户讨论显示,在高峰时段或重大功能发布引发流量激增时,生成时间会显著上升。Luma 团队持续更新基础设施(见更新日志)以提升容量,但短暂延迟仍可能发生。

网络/上传时间与客户端设备

对于捕捉流程,上传速度与设备性能很重要:数 GB 级的大型捕捉上传会在处理开始前就显著增加总耗时。Luma 的文档注明了最大文件大小,并建议遵循最佳捕捉实践以尽量减少不必要的数据传输。

如何提前估算任务时长并减少等待?

快速估算清单

- 为你的任务分类:图像、短视频(<15 秒)、长视频(>15 秒)或 3D 捕捉。

- 统计输入:照片数量/视频长度(秒)/捕捉文件大小。

- 选择质量:低、标准或高保真——保真度越高 = 计算时间越长。

- 检查账户等级:免费 vs 付费 vs 企业;考虑可能的排队。

- 进行短测:创建一个 5–10 秒的测试任务以获取真实世界的基线。

提升吞吐的实用建议

- 采用推荐的捕捉方式(平滑的相机运动、稳定的光照)以加速重建收敛。Luma 的学习中心与移动应用页面提供了捕捉最佳实践。

- 在可接受范围内缩减输入:在上传前裁剪、降采样或剪辑素材,以减少处理时间与成本。

- 草稿阶段使用较低质量预设,待构图满意后再以高质量定稿。

- 如有可能,将重任务安排在非高峰时段;社区报告显示在非黄金时段排队会下降。

- 若需要规模化与可预测的 SLA,请考虑 API/企业选项;Luma 的 API 与更新日志显示其持续在性能与工作流(如 Modify Video 等新端点)上投入。

Luma 的时长数据与其他工具相比如何?

比较生成式图像/视频或 NeRF 服务并不简单,因为各家在质量、速度与成本上的取舍不同。对于图像与超短视频生成,Luma 的 Dream Machine——尤其搭配 Ray2 Flash——可实现分钟级以内的交互时延,与领先的面向消费者的生成服务相当。对于完整场景的 NeRF 捕捉与高保真 3D 模型创建,云计算需求与排队会使耗时高于快速图像生成器:应预期更大的波动并做好相应规划。合作方文档与第三方文章普遍指出,简单的短渲染以分钟计,而复杂的 3D 流水线则需要小时(或更不可预测的更长时间)。

最终结论——Luma 为我的任务需要多久?

没有一个通用数值适用于所有用户或所有任务。可用以下务实的锚点来估算:

- 图像生成(Dream Machine): 在正常负载下,小批次约 20–30 秒。

- 短视频生成(Dream Machine / Ray2): 短片为几十秒到几分钟;在受支持的流程上,Ray2 Flash 可显著更快。

- 3D 捕捉 → NeRF: 变动极大。**最佳情况:**小型对象与轻量计算为数分钟;**最差情况(有报告):**在需求高峰或超大规模捕捉下需要数小时到数天。若你需要明确时间线,请购买优先/企业计划或进行前期试点测试,并在进度中预留缓冲时间。

入门

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500+ 款 AI 模型(如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)聚合到一个对开发者友好的界面中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到你的应用中的过程。无论你在构建聊天机器人、图像生成器、音乐创作工具,还是数据驱动的分析平台,CometAPI 都能让你更快迭代、控制成本、保持供应商中立,同时利用整个 AI 生态的最新突破。

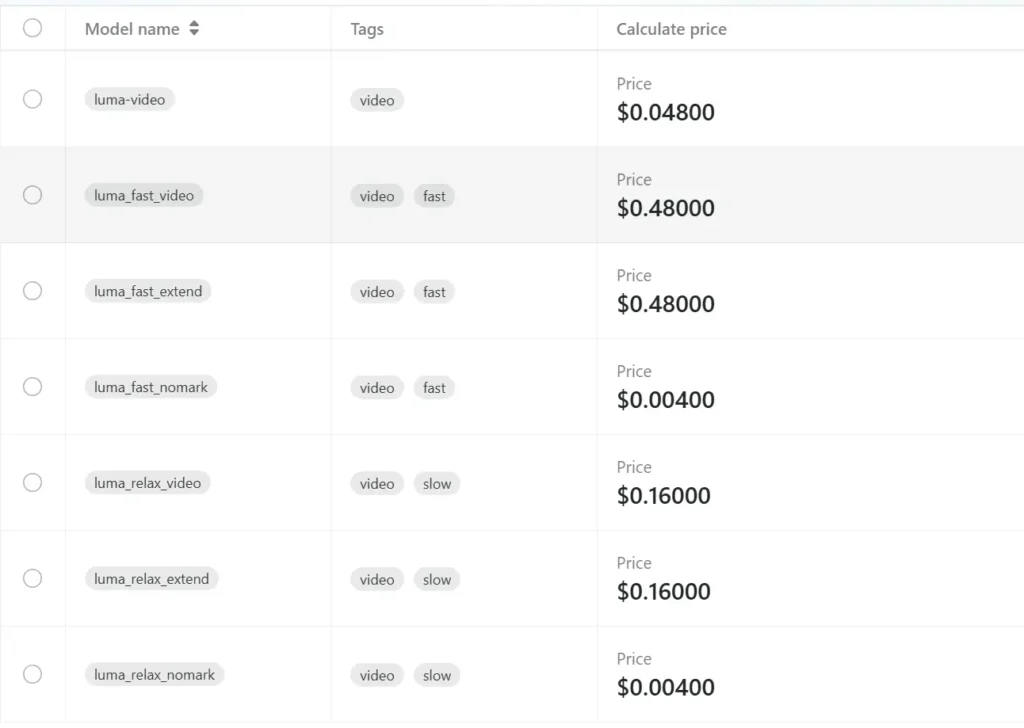

开发者可以通过 CometAPI 访问 Luma API,文中所列最新模型版本以发表日期为准。开始使用前,可在 Playground 中探索模型能力,并参考 API 指南 获取详细说明。访问前,请确保已登录 CometAPI 并获取 API Key。CometAPI 提供远低于官方价格的方案,帮助你完成集成: