中国的 Z.ai(原 Zhipu AI)再次凭借其开源 GLM 4.5 系列的发布登上头条。GLM‑4.5 被定位为现有大语言模型的高性价比高性能替代方案,承诺重塑代币经济,并为初创公司、企业与科研机构提供更普惠的访问。这篇全面的文章将探讨 GLM‑4.5 系列的起源、定价结构与真实价值——直面所有相关方心中的两个关键问题:它的成本是多少,以及它是否值得?

什么是 GLM 4.5 系列?

Z.ai 的 GLM 4.5 系列构建于一种“智能体化”AI 框架之上,这意味着模型能够自主将复杂任务分解为较小的、顺序的子任务——提高精度并减少冗余计算。这与将提示一次性处理的更“单体式”的 LLM 相对。根据 Z.ai 的介绍,GLM 4.5 在其核心架构中原生嵌入了推理与行动规划,使其无需外部编排即可执行诸如数据可视化生成或端到端文档处理等多步工作流。

由 Z.ai 开发的 GLM 4.5 系列,是最新一代开源的专家混合(MoE)大语言模型,旨在于单一架构内统一高级推理、代码生成与智能体能力。该系列提供两种主要版本:旗舰 GLM 4.5(总参数 355 B,激活参数 32 B)与更轻量的 GLM 4.5‑Air(总参数 106 B,激活参数 12 B)。两种变体均采用混合推理机制——复杂、工具增强的推理使用“思考模式”,而快速、直接的补全使用“非思考模式”——覆盖从全栈开发到自主智能体工作流的广泛用例。

核心技术规格:

- 参数量:GLM 4.5 具有 3550 亿参数,每次推理仅激活其中的 320 亿,以优化硬件使用与吞吐。

- 专家混合(MoE):该系列采用 MoE 架构,动态将 token 路由至专家子网络,提高效率。

- 上下文窗口:在部分平台(如 SiliconFlow)扩展至 128 K token,可容纳大型文档与代码库。

- 生成速度:高速版本超过 100 token/秒,适用于实时应用。

- 混合推理模式:用户可在“思考模式”(全面激活 MoE 进行深度推理)与“非思考模式”(最小激活以获得快速即时响应)之间切换,为开发者提供在性能与速度之间的精细化控制。

该系列包含哪些变体?

- GLM 4.5(标准版):总参数 355 B / 激活参数 32 B。主要面向在推理、编码与智能体任务上的均衡表现。

- GLM 4.5‑Air:轻量版,总参数 106 B / 激活参数 12 B,适用于硬件或时延约束严苛的场景——在同级中提供具有竞争力的准确性。

GLM 4.5 系列的价格是多少?

输入与输出 token 的价格是多少?

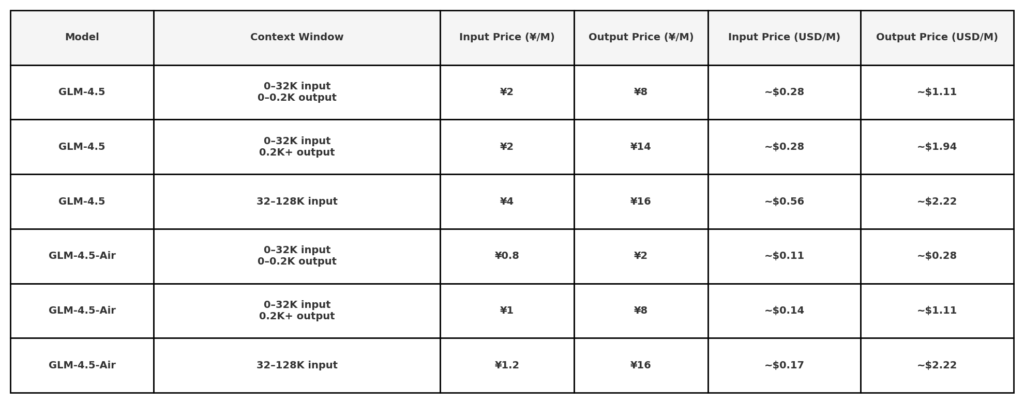

根据 Z.ai 的公开 API 定价披露,GLM 4.5 定价为:

注意:非常低的费率($0.11/$0.28)可能仅限于较小的 token 长度或特定促销。所有模型限时 5 折优惠,有效期至 2025年8月31日。其他模型请参见官方价格页面。

在 CometAPI 上,该系列采用略有不同的分级定价,详见 GLM‑4.5 API:

| Model | introduce | Price |

glm-4.5 | 我们最强大的推理模型,拥有 3550 亿参数 | Input Tokens $0.48 Output Tokens $1.92 |

glm-4.5-air | 高性价比 轻量 强劲性能 | Input Tokens $0.16 Output Tokens $1.07 |

glm-4.5-x | 高性能 强推理 超快响应 | Input Tokens $1.60 Output Tokens $6.40 |

glm-4.5-airx | 轻量 强劲性能 超快响应 | Input Tokens $0.02 Output Tokens $0.06 |

glm-4.5-flash | 强劲性能 擅长推理 编码与智能体 | Input Tokens $3.20 Output Tokens $12.80 |

GLM 4.5 的定价与 DeepSeek 及西方 LLM 相比如何?

在 2025 世界人工智能大会上,Z.ai 明确将 GLM 4.5 定位为 DeepSeek(中国此前的成本领跑者)的挑战者,承诺“代币成本仅为其一小部分”,且硬件占用为 DeepSeek R1 模型的一半。

- DeepSeek R1:每百万 token 输入约 USD 0.14,输出约 USD 0.60。

- GLM 4.5:声称在输入与输出两端均便宜 20–30%。

- 西方基准:OpenAI 的 GPT‑4 与 Google 的 Gemini 每百万 token 价格范围为 USD 3–15,GLM 4.5 的成本降幅达一个数量级。

这一定价策略反映了中国更广泛的 AI 经济模型:更精简的算力、更小的模型,以及通过激进的降价以获取市场份额。

GLM 4.5 系列值得吗?

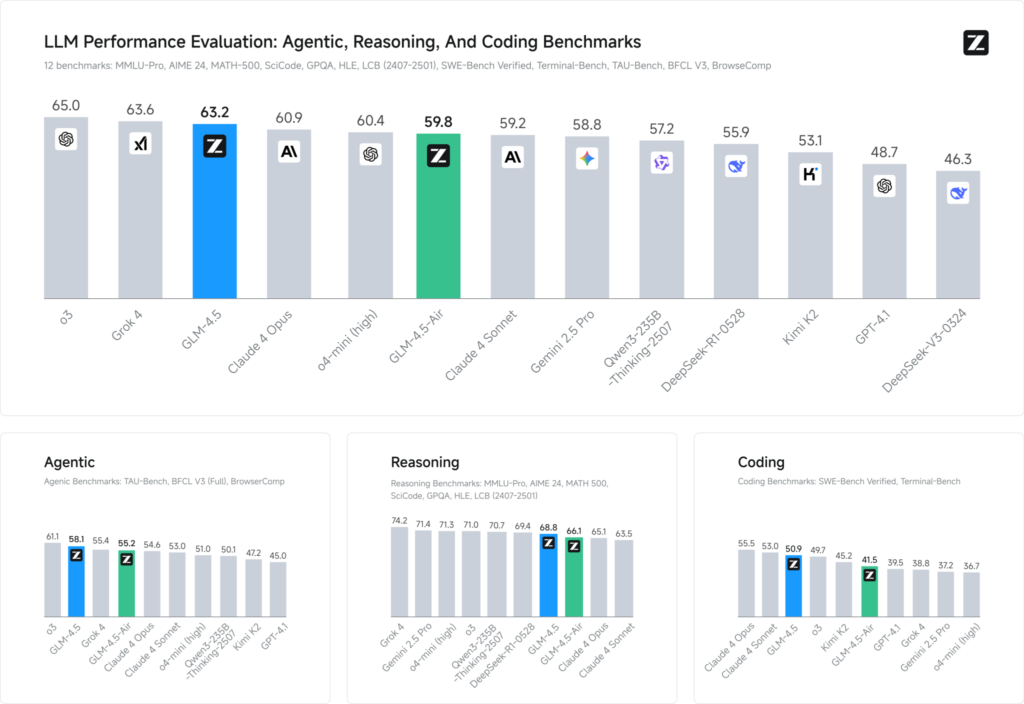

在覆盖 12 个代表性数据集(跨越 MMLU Pro、MATH 500、SciCode、Terminal‑Bench 与 TAU‑Bench)的基准评测中,GLM 4.5 获得全球第 3 的排名,仅次于 xAI 的 Grok 4 与 OpenAI 的 o3——同时在开源模型中位列第 1。

在编码任务(LiveCodeBench、SWE‑Bench)中,GLM 4.5 的专家混合设计带来顶级的代码生成质量;在推理任务(AIME 24、MMLU Pro)中,其多步规划实现的稳健准确性可与闭源模型比肩。轻量的 Air 变体在其参数规模(100 B 量级)内维持了有竞争力的分数,使其成为边缘部署与嵌入式系统的诱人选择。

性能基准

- 智力指数:GLM 4.5 在综合智力指数(MMLU Pro、MATH 500、AIME 24)上得分为 66,超越了许多开源与商业中端模型。

- 推理延迟:平均首 token 时间 0.89 秒,在复杂推理任务上具有竞争力,但在吞吐(≈45.7 tokens/秒)方面略慢于部分优化的闭源模型。

- 智能体工作流:在多步工具使用与动态代码生成方面表现稳健,在独立编码评测中对 Kimi K2 的胜率约 ~54%、对 Qwen3‑Coder 的胜率约 81%。

哪些实际用例能够体现投资回报(ROI)?

- 全栈开发:GLM‑4.5 可通过多轮提示搭建完整的 Web 应用——从前端的 HTML/CSS/JavaScript 布局到后端数据库模式——将原型周期从数天缩短至数小时。

- 复杂文档分析:扩展至 128 K 的上下文窗口使法律、金融与科研机构能够一次性解析多页合同或研究报告,减少分段处理开销。

- 自动化智能体工作流:混合推理允许创建自主脚本(如网页抓取机器人、交易智能体),在最少人工干预下推理完成多步流程。

量化案例显示,面向代码的任务可将开发者工时最多降低 60 %,而长内容分析的交付速度可提升 40 %。

潜在缺点与注意事项是什么?

任何技术都存在取舍。潜在采用者需留意监管、运营与生态相关因素。

限制

支持与 SLA:与商业产品不同,开源提供者可能无法提供企业级 SLA 或 24/7 支持。

吞吐约束:尽管上下文窗口很大,但每秒 token 速率落后于部分推理优化的闭源模型,可能影响实时应用。

运维开销:自建 MoE 模型需要谨慎进行专家路由与内存管理,以避免性能瓶颈与成本失控。

需要哪些基础设施投入?

- 算力占用:即便具备 MoE 效率,自托管标准版 GLM‑4.5 仍需内存 ≥80 GB 的 GPU,以及具备低时延的 NVLink 互联。

- 微调开销:将模型定制到特定领域任务可能需要大量 GPU 周期,在代币计费的节省显现前推高前期成本。

- 维护:本地部署将更新、安全补丁与扩容的责任从厂商转移到企业内部 DevOps 团队。

如何开始使用 GLM‑4.5?

启动 GLM‑4.5 的集成只需几个简单步骤——尤其是在开源实践与广泛的第三方支持之下。

哪些 API 与平台支持 GLM‑4.5?

- CometAPI API:完全兼容 OpenAI 的端点,提供 Python、JavaScript 与 Java 的 SDK。

- Z.ai 官方端点:提供官方支持与诸如多智能体编排等早期访问特性。

- 社区镜像:快速增长的开源运行时(如 Ollama、AutoGPT‑CLI)支持本地推理。

开发者可以在哪里找到工具与文档?

- Z.ai 官方文档:涵盖安装、提示工程与 MoE 优化的全面指南。

- GitHub 仓库:包含代码生成、检索增强生成(RAG)与兼容主流编排工具的智能体框架示例笔记本。

- 社区论坛:在 Hugging Face 等平台上有活跃讨论,实践者分享微调配方、提示库与性能基准。

结论

GLM‑4.5 系列在当今竞争激烈的 AI 版图中提出了大胆主张:为开发者、企业与科研机构提供无与伦比的性价比。其代币定价低至每百万输入 token $0.11 与每百万输出 $0.28——并在限时促销中再享 50 % 折扣——加之在基准上的表现可与更大的专有模型相匹敌或超越,GLM‑4.5 为面向代码的应用、长文本理解与智能体工作流带来可观的投资回报。

入门指南

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500+ AI 模型(如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)聚合到一个对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到你的应用中的过程。无论你在构建聊天机器人、图像生成器、音乐作曲器,还是数据驱动的分析管道,CometAPI 都能让你更快迭代、控制成本并保持供应商无关性,同时持续获取 AI 生态中的最新突破。

开发者可通过 CometAPI 访问 GLM-4.5 Air API 与 GLM‑4.5 API,本文发布时列出的 Claude 模型版本以当时为准。开始之前,可以在 Playground 中探索模型能力,并查阅 API guide 获取详细说明。访问前请确保已登录 CometAPI 并获取 API key。CometAPI 提供远低于官方价格的优惠,帮助你完成集成。