GPT-5.5 Instant 是 OpenAI 为支撑 ChatGPT 日常智能所做的最新升级。于 2026 年 5 月 5 日发布,取代 GPT-5.3 Instant 成为数亿用户的默认模型。在保持用户期望的低延迟“即时”体验的同时,它提供更智能、更准确的回答,并显著减少幻觉。

对于开发者、创业者、SaaS 构建者和企业团队,此次模型升级在不牺牲速度、不过度增加成本的前提下,为可靠的 AI 集成打开了新的可能性。本指南全面覆盖从快捷的 ChatGPT 访问到生产级 API 使用的各个方面,并附带实用示例与优化策略。

什么是 GPT-5.5 Instant,它为何重要

GPT-5.5 Instant 是针对日常交互、搜索增强回答、图像分析和个性化上下文召回优化的快速高效变体。它驱动默认的 ChatGPT 体验,同时相较前代带来可量化的改进。

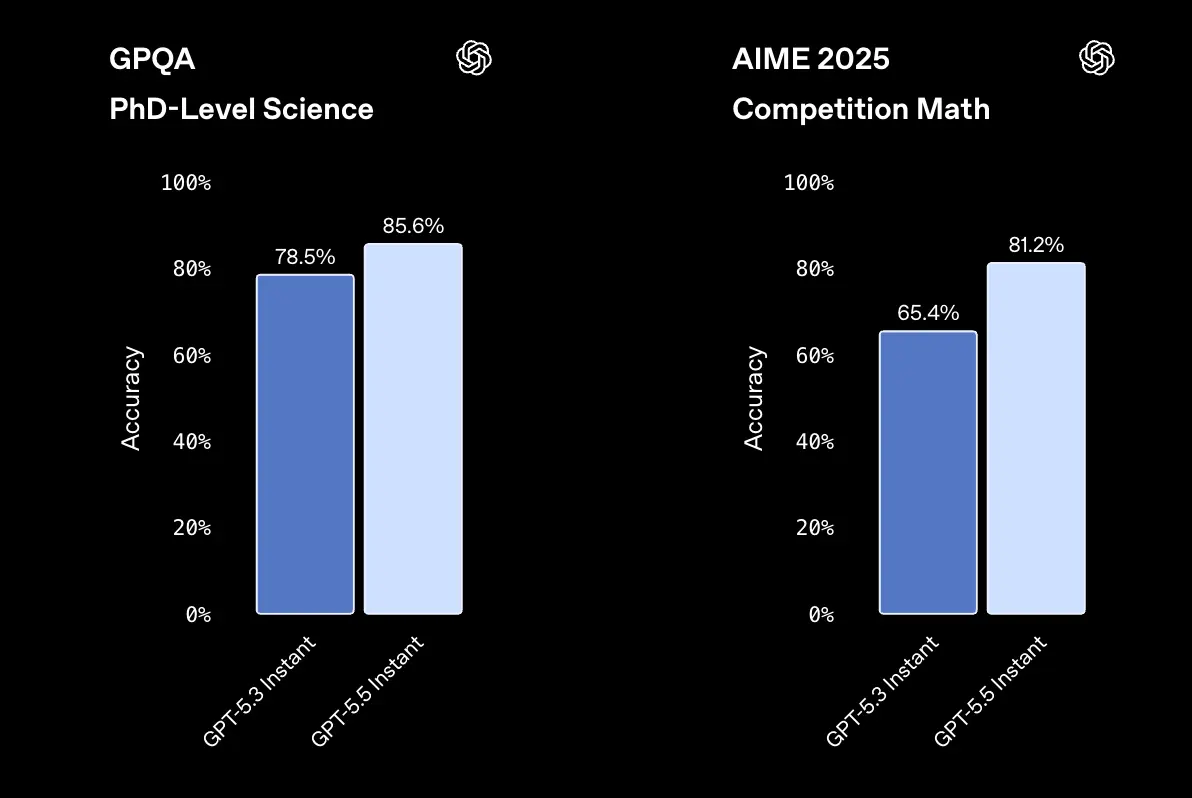

关键改进(基于 OpenAI 评估):

- 在高风险提示上,GPT-5.5 Instant 的幻觉性断言比 GPT-5.3 Instant 减少 52.5%。

- 在具有挑战性的对话中,不准确断言减少 37.3%。

- 在照片/图像分析、STEM 问题以及何时启用网页搜索方面表现更强。

- 在过往聊天、文件与已连接 Gmail 的上下文管理上更佳,回答更简洁、自然且更具个性化。

不同于面向深度推理与复杂代理任务的更重型 GPT-5.5(Thinking/Pro 变体),GPT-5.5 Instant 以速度与可靠性为先,服务通用使用,同时仍提供显著的能力提升。

GPT-5.5 Instant 与 GPT-5.5 及以往模型:对比表

| 功能/模型 | GPT-5.5 Instant(默认) | GPT-5.5(完整/Thinking) | GPT-5.3 Instant(前代) |

|---|---|---|---|

| 主要优势 | 速度 + 可靠性 | 深度推理与代理 | 通用用途 |

| 延迟 | 最低 | 更高 | 较低 |

| 幻觉减少 | 减少 52.5%(高风险场景) | 最高 | 基线 |

| 个性化 | 优秀(记忆搜索) | 强 | 良好 |

| 图像/STEM 表现 | 显著提升 | 更优 | 良好 |

| API 价格(约) | 通过供应商具竞争力 | $5/$30 每百万 token | 更低 |

| 最佳适用 | 聊天、快速任务、应用 | 复杂工作流 | 旧版 |

何时选择 Instant:日常应用、客服机器人、内容生成以及对延迟敏感的界面。

本质上,GPT-5.5 Instant 与 GPT-5.5 Thinking 共享同一底层架构。差异在于推理深度,而非知识水平。付费用户可使用 GPT-5.5 Thinking,免费用户可在 ChatGPT 上使用受限配额的 GPT-5.5 Instant。

欲了解更多信息,请参阅 GPT-5.5 概览 及其机制。

如何在 ChatGPT 中访问 GPT-5.5 Instant

如果你直接使用 ChatGPT,GPT-5.5 Instant 是所有已登录用户的默认选项。OpenAI 表示它将向所有 ChatGPT 用户推送,并以 GPT-5.5 Instant 替换 GPT-5.3 Instant 作为默认模型。这意味着许多用户无需手动切换即可受益于新的 Instant 体验。

对于付费用户,ChatGPT 提供模型选择器,可手动选择 GPT-5.5 Instant 或 GPT-5.5 Thinking(对于付费用户,GPT‑5.3 Instant 将在三个月内继续可用)。OpenAI 帮助中心称,Plus、Pro 和 Business 用户可使用选择器,而 GPT-5.5 Pro 仅面向 Pro、Business、Enterprise 和 Edu 方案。

免费用户仍可在 ChatGPT 中使用 GPT-5.5,但存在使用限制。OpenAI 表示,Free 等级账户每 5 小时可发送最多 10 条使用 GPT-5.5 的消息,而 Plus 和 Go 用户每 3 小时可发送最多 160 条。达到限制后,聊天将切换至 GPT-5.5 mini 版本,直至限制重置。Pro 和 Business 团队不会回退,可继续使用 GPT-5.5。

如果你使用 Pro 或 Enterprise 版本,且希望在真实任务中比较 Instant 与 Thinking 的表现,可并排打开两个标签页,将各自固定到对应模型,并输入相同提示。差异在涉及隐含多步推理的任务中尤为明显,因为 Thinking 会在回应前探索不同的推理分支。对于日常聊天,Instant 在初始响应上更快。

实用的 ChatGPT 访问流程

对于大多数用户而言,流程很简单:

- 登录 ChatGPT。

- 使用默认的 Instant 体验。

- 在付费方案上,如需手动选择 GPT-5.5 Instant,可打开模型选择器。

- 只有当任务确实需要更深推理时再切换至 GPT-5.5 Thinking。

以上是面向用户的路径。对于产品团队而言,真正的问题是如何在自家应用中实现同等质量。这正是 API 路径的重要性所在。

高级功能

- 记忆与个性化:模型可智能利用会话历史、已上传文件与 Gmail(已连接时)。它会判断何时个性化能带来价值。

- 图像分析:上传照片以获得更优的视觉推理。

- 网页搜索集成:必要时自动进行,以获取最新信息。

专业提示:为获得更干净的默认体验,请开启新对话。在设置中使用自定义说明,以在各会话中保持一致的语气与上下文。

通过 API 访问与使用 GPT-5.5 Instant

直接使用 OpenAI API 时,会采用诸如 chat-latest 的模型别名。chat-latest 指向当前在 ChatGPT 中使用的最新 Instant 模型。许多团队更青睐 CometAPI 等统一提供商,以获得更低成本、更高速率限制,以及在多模型间更简化的集成。

在 API 中,GPT-5.5 Instant 与 GPT-5.5 Thinking 合并为同一个模型标识:gpt-5.5。不存在单独的 gpt-5.5-instant 端点。相反,你可通过 reasoning_effort 参数来控制推理深度,其可取值为 minimal、low、medium 或 high。将 reasoning_effort: "minimal" 设为最小,是最接近 ChatGPT 中 Instant 体验的 API 等效方式。

GPT-5.5 提供两个端点:

- Responses API(

/v1/responses):新构建的推荐端点,具备对工具、结构化输出与流式的一级支持。 - Chat Completions API(

/v1/chat/completions):遗留端点,保留用于向后兼容。

使用 CometAPI 的 API 分步设置(推荐大多数团队)

1. 注册并获取 API 密钥

- 访问 CometAPI.com 并创建账户。

- 进入控制台/仪表板生成 API 密钥(以

sk-开头)。

2. 基础集成示例(Python)

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("COMETAPI_KEY"), # Your CometAPI key

base_url="https://api.cometapi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5", # or specific alias

messages=[

{"role": "system", "content": "You are a helpful, concise assistant."},

{"role": "user", "content": "Explain how GPT-5.5 Instant improves factuality."}

],

temperature=0.7,

max_tokens=500

)

print(response.choices[0].message.content)

3. 流式响应以提升用户体验

stream = client.chat.completions.create(

model="gpt-5.5",

messages=[...],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="")

JavaScript、cURL 及其他语言示例遵循类似的 OpenAI SDK 兼容模式。

GPT-5.5 Instant 的关键 API 参数

- temperature:0.0–1.0(事实性任务使用较低值)。

- reasoning_effort(若在变体中受支持):low/medium 以取得平衡。

- tools/function calling:对代理式工作流提供完整支持。

- Vision:传入图像 URL 或 base64 以进行多模态提示。

获得更佳结果的最佳实践

GPT-5.5 并非“写个含糊提示然后祈祷”的模型。我强烈建议采用以结果为先的提示方式:明确期望输出、成功标准、约束、附带影响与输出格式。文档也建议减少对逐步过程的指导,除非路径本身是产品需求的一部分。实践中,这意味着你应描述目的地,而非对每一步进行微观管理。

结构化输出是另一重要杠杆。OpenAI 建议在生产级系统中使用结构化输出,而非仅在提示中描述模式,尤其当你需要自动验证与更可靠的下游解析时。这对 SaaS 产品尤为重要,因为应用在清理模型输出上花费的时间越少,用户体验就越稳定。

GPT-5.5 Instant 提示清单

编写提示时应:

- 清晰陈述目标。

- 定义验收标准。

- 说明所需格式。

- 减少不必要的指令。

- 保留空间让模型自行选择最佳路径。

推理力度指导

OpenAI 表示,medium 是默认且推荐的平衡设置,low 适用于许多负载,none 用于对推理无需求的延迟关键作业,而 high 或 xhigh 仅应在评估显示质量可测提升时使用。此建议至关重要:更多推理并非自动更好,尤其当任务缺乏明确停止标准或工具使用过于开放时。

一个实用的生产模式

针对客户支持、内部知识助手与工作流自动化,一个强健的设置为:

- 使用 Responses API 管理会话状态

- 采用结构化输出以实现可预测的解析

- 依据用例调整推理力度

- 对重复前缀进行提示缓存

- 在适合的环节使用托管工具

上述组合让 GPT-5.5 不再只是聊天模型,而更像一台生产引擎。

成本优化策略

- 缓存常见提示/回答。

- 使用结构化输出(JSON 模式)以提升解析可靠性。

- 监控 token 使用并合理选择推理力度。

- 将简单查询路由至更轻模型,必要时升级到 Instant/GPT-5.5。

分步实现示例

1) ChatGPT 工作流

使用 GPT-5.5 Instant 的最简单方式是在 ChatGPT 内部。登录,让默认的 Instant 体验处理常规工作;在付费层级需要时通过模型选择器手动选择 GPT-5.5 Instant 或 GPT-5.5 Thinking。OpenAI 表示,默认的 Instant 体验已针对信息检索问题、演示指导、技术写作与翻译进行调优。

这对需要快速答案而无需编写代码的创始人、运营与产品经理而言是正确选项。这也是在集成前评估 GPT-5.5 的语气与事实性是否能改进你常见工作流的最佳场所。

2) 直接 API 工作流

用于产品开发时,请采用 API 路径。OpenAI 的文档建议将模型代号更新为 gpt-5.5,使用 Responses API 实现推理与工具调用,并有意设置 reasoning.effort。文档还提到提示缓存、结构化输出与多轮处理是良好集成的核心组成部分。

一个实用的实施顺序如下:

- 从全新的提示基线开始。

- 将模型设为

gpt-5.5。 - 使用 Responses API。

- 如应用需要机器可读的响应,加入结构化输出。

- 按延迟与质量目标调优

reasoning.effort。 - 在发布前基准测试端到端行为。

3) 使用 CometAPI 的统一网关工作流

CometAPI 将自身定位为统一的、OpenAI 风格的 API 聚合平台,通过单一接口、单一 API 密钥与按需计费访问 500+ AI 模型。其重点在于更低的集成摩擦、单一凭证,以及无需重新认证或大规模迁移即可切换模型。

对构建多模型产品的团队而言,这很重要。与其将技术栈锁定在单一供应商集成路径上,网关方式可标准化请求处理、简化供应商试验,并降低由模型专属 SDK 激增带来的维护负担。

CometAPI 优势:价格显著更低(例如相较官方约有 ~20% 折扣)、一个 API 密钥支持 500+ 模型、宽松的速率限制,以及用于测试的操场。这使其非常适合在不立即承担高额 OpenAI 账单的情况下扩展 AI 功能的初创企业。

如需了解 GPT-5.5 的价格变化,这里有一份详细分析:GPT-5.5 定价拆解。

常见问题

1. 如何在 ChatGPT 中访问 GPT-5.5 Instant?

GPT-5.5 Instant 是所有已登录用户的默认选项;付费层级可在模型选择器中手动选择 GPT-5.5 Instant 或 GPT-5.5 Thinking。

2. GPT-5.5 Instant 是否可在 API 中使用?

OpenAI 表示,GPT-5.5 Instant 正作为 chat-latest 在 API 中上线,同时开发者文档使用 gpt-5.5 作为面向开发者的代号。

3. GPT-5.5 Instant 与 GPT-5.5 Thinking 有何区别?

GPT-5.5 Instant 是面向日常使用的快速、低延迟默认选项。GPT-5.5(及 Pro)变体在复杂多步任务中提供更深推理,但延迟与成本更高。OpenAI 表示,Thinking 在记录先前步骤方面更好,并可能在推理开始前显示简短的前言。

4. 使用 GPT-5.5 应该选哪个 API?

OpenAI 推荐使用 Responses API 进行推理、工具调用与多轮用例。

5. 我应从哪种推理设置开始?

OpenAI 建议从 medium 开始,然后针对延迟敏感的工作负载测试 low;仅当评估显示质量有可测提升时再使用 high 与 xhigh。

6. GPT-5.5 能否处理工具密集型工作流?

可以。OpenAI 表示,GPT-5.5 在大型工具面、跨多步服务工作流与长时间运行的代理任务上尤其有用,在工具选择与参数使用方面具备更高精度。

7. 团队为何选择 CometAPI 而非直接接入?

CometAPI 将自身定位为 OpenAI 风格的统一网关,提供一个 API 密钥、访问 500+ 模型,以及在切换供应商时更低的集成摩擦。

结论与下一步

GPT-5.5 Instant 提升了可用且可靠的 AI 的标准。无论你是在强化 ChatGPT 工作流,还是在构建下一代 AI 驱动的产品,掌握其访问与使用至关重要。

准备开始集成?立即上手 CometAPI 以具有竞争力的价格即时访问 GPT-5.5 Instant 与完整的 GPT-5.5 家族。免费注册,探索操场,并通过熟悉的 OpenAI SDK 兼容性在数分钟内部署。