Agno 正在快速演进为面向生产的 AgentOS——用于多代理系统的运行时、框架与控制平面;与此同时,CometAPI(“一切模型一站式 API” 聚合器)宣布作为 Agno 的模型提供方获得官方支持。二者结合,让你无需重写代理代码即可在数百个模型端点之间切换,轻松运行多代理系统;采用像 CometAPI 这样的统一网关作为 Agno 等代理框架的即插即用模型提供方的需求也随之增长——因此,下文所述模式既实用也恰逢其时。

Agno 和 CometAPI 到底是什么?

什么是 Agno,我为什么要关注?

Agno 是一个高性能、Python 风格的多代理框架、运行时与 UI,用于以记忆、工具、知识与人类参与为支撑,组合代理、团队与代理式工作流。它提供开箱即用的 FastAPI 运行时(AgentOS)、本地开发工具,以及控制平面 UI,让你无需将数据离开自身环境即可测试和监控正在运行的代理。如果你希望快速构建面向生产的代理系统,并保持对数据与可观测性的完全掌控,Agno 正是为此而设计。

什么是 CometAPI,我为什么把它用作 LLM 提供方?

CometAPI 是一个 API 聚合器 / 模型网关,为数十到数百种 LLM 与多模态(文本、图像、视频等)提供单一且一致的 API。开发者无需绑定某一家模型厂商,只需调用 CometAPI 网关,并通过参数切换提供方或模型——这有助于成本管理、A/B 测试与故障切换。该平台支持模型切换、统一计费,并宣称提供兼容 OpenAI 的端点——也就是说,你通常可以将 OpenAI 风格的客户端指向 CometAPI 的 base URL 与认证令牌,像调用 OpenAI 端点一样调用模型。这使得 CometAPI 成为对已支持 OpenAI API 面的框架而言便利的“即插即用”提供方。

最新信号: CometAPI 已在 Agno 官方文档 与社区渠道中宣布为模型提供方,这意味着 Agno 提供了一个可传入你的 Agent 的 CometAPI 模型提供方类。集成该网关由此变得直接且受支持。

为什么要将 Agno 与 CometAPI 集成?

- 无提供方锁定:CometAPI 允许你在众多模型(OpenAI、Claude、LLama 变体、Gemini 等)间试验,而无需更换 SDK。这与 Agno 的模型无关设计相得益彰。

- 更快的开发循环:由于 CometAPI 支持 OpenAI 风格的端点,你通常无需编写自定义 Agno 提供方——只需将 Agno 的 OpenAI 模型适配器指向 CometAPI 即可开始。

- 可观测性与控制:在使用 CometAPI 拨打模型的同时,利用 Agno 的 AgentOS 运行时与控制平面在本地或你的云中运行代理,兼得模型灵活性与运行时可观测性。

如何逐步将 Agno 与 CometAPI 集成?

以下是一个可直接复制粘贴的工作流——从创建虚拟环境到运行一个通过 CometAPI 调用模型的本地 AgentOS 实例。

关键思路: 由于 CometAPI 暴露了兼容 OpenAI 的端点,最简单的做法是使用 Agno 的 OpenAI 模型适配器,并将

OPENAI_API_BASE(或openai.api_base)指向 CometAPI 的 base URL,同时提供你的 CometAPI 令牌作为 OpenAI API key。CometAPI 在其文档中明确说明了这种“更改 base_url + 使用 OpenAI 格式”的方案。

开始之前的环境与前提条件

推荐的操作系统、Python 版本与工具?

- 操作系统: macOS、Linux 或 Windows —— Agno 及其工具同时支持这三者。 ()

- Python: 使用现代 CPython(Agno 文档与仓库目标为现代 Python 版本;建议使用 Python 3.12)。在生产部署前请查看 Agno 仓库/文档以确认精确兼容性。

- 包管理器 / 虚拟环境:

uv(Astral 的uv项目)是一个管理虚拟环境与依赖的优秀且快速的选项。

需要准备哪些账号、密钥与网络前提?

- CometAPI 账号与 API 密钥。 从 CometAPI 获取你的密钥,并存储在环境变量(

COMETAPI_KEY)中。Agno 的 CometAPI 模型适配器会读取COMETAPI_KEY。 - 可选的 Agno 控制平面账号(AgentOS UI)。 如果你计划将本地 AgentOS 连接到控制平面以进行监控或团队功能,请准备好你的控制平面访问与组织/团队权限。

- 用于代理状态的数据库(可选)。 若需持久化,通常会依据规模配置 SQLite/Postgres;Agno 提供了以 Sqlite 进行本地开发的示例。

如何逐步将 Agno 与 CometAPI 集成?

以下是一个可直接复制粘贴的工作流——从创建虚拟环境到运行一个通过 CometAPI 调用模型的本地 AgentOS 实例。

关键思路: 由于 CometAPI 暴露了兼容 OpenAI 的端点,最简单的做法是使用 Agno 的 OpenAI 模型适配器,并将

OPENAI_API_BASE(或openai.api_base)指向 CometAPI 的 base URL,同时提供你的 CometAPI 令牌作为 OpenAI API key。CometAPI 在其文档中明确说明了这种“更改 base_url + 使用 OpenAI 格式”的方案。

1) 安装 uv 并创建虚拟环境

uv 安装器(单行):

# macOS / Linux

curl -LsSf https://astral.sh/uv/install.sh | sh

创建并激活可复现的 venv(Agno 快速开始使用 Python 3.12):

# create a venv managed by uv

uv venv --python 3.12

# activate (POSIX)

source .venv/bin/activate

(如果你更喜欢传统的 python -m venv .venv 也可行;uv 带来锁文件与可复现性等好处。)

2) 安装 Agno 与运行时依赖(通过 uv pip)

```bash

uv pip install -U agno openai mcp 'fastapi' sqlalchemy 'httpx'

# optionally, add extras you need

uv pip install -U agno # if using cloud infra plugins

(安装你需要的其他库:向量数据库客户端、监控库等。)

通常会安装 `agno` + 各提供方的 SDK。

### 3) 导出 CometAPI API 密钥

设置 Agno Comet 提供方将读取的环境变量:

bash

macOS / Linux

export COMETAPI_KEY="sk-xxxx-your-cometapi-key"

Windows (PowerShell)

setx COMETAPI_KEY "sk-xxxx-your-cometapi-key"

Agno 的 CometAPI 提供方默认读取 `COMETAPI_KEY`。

### 4) 创建一个使用 CometAPI 提供方的小型 Agno Agent

打开文件夹并创建一个新文件。将以下内容保存为 `comet_agno_agent.py`:

from agno.agent import Agent

from agno.db.sqlite import SqliteDb

from agno.models.cometapi import CometAPI

from agno.os import AgentOS

from agno.tools.mcp import MCPTools

1) Create an Agent which uses CometAPI as the model provider

id parameter selects a model id from the CometAPI catalog

agno_agent = Agent(

name="Agno Agent",

model=CometAPI(id="gpt-5-mini"),

# Add a database to the Agent

db=SqliteDb(db_file="agno.db"),

# Add the Agno MCP server to the Agent

tools=,

# Add the previous session history to the context

add_history_to_context=True,

markdown=True,

)

2) Attach Agent to AgentOS and get FastAPI app

agent_os = AgentOS(agents=)

Get the FastAPI app for the AgentOS

app = agent_os.get_app()

### 5) 本地运行 Agno 进行测试

启动 AgentOS(FastAPI)开发服务器:

In the activated .venv (uv-managed)

fastapi dev agno_comet_agent.py

defaults to http://localhost:8000

打开 `http://localhost:8000/docs` 查看自动生成的端点。

> 确保已设置环境变量(COMETAPI\_KEY\_API\_KEY)

### 6) 将本地 AgentOS 连接到 AgentOS 控制平面(可选)

如果你希望使用 Agno Web 控制平面监控你的本地 AgentOS:

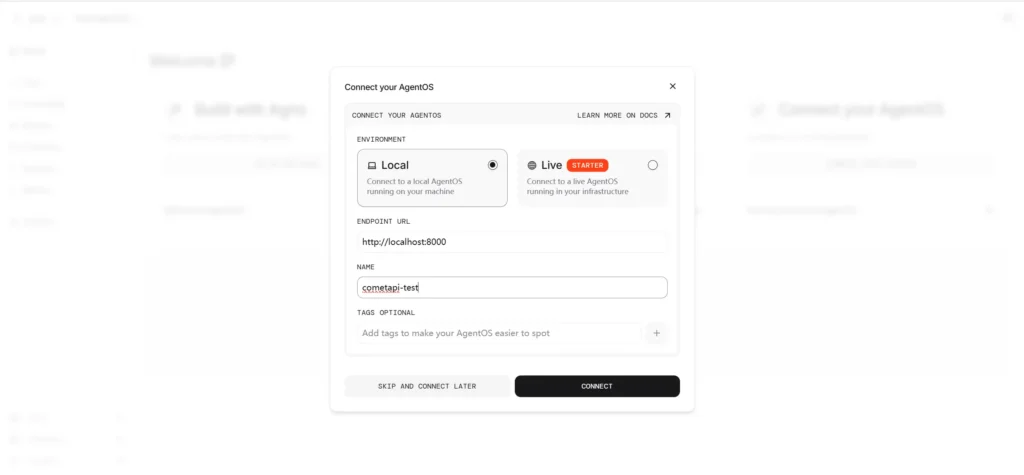

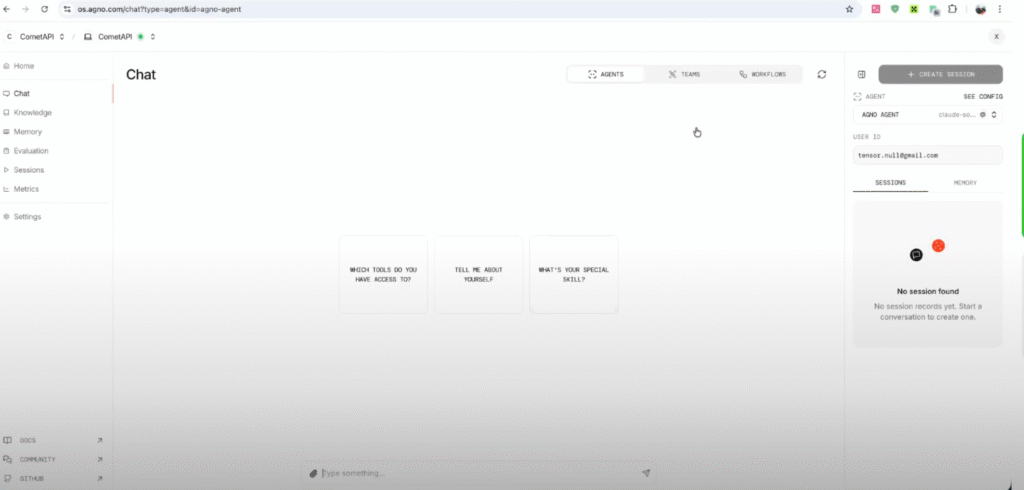

1. 访问 AgentOS 控制平面:`os.agno.com` 并登录。

2. 点击 **Add new OS → Local**,输入 `http://localhost:8000`,为其命名,然后 **Connect**。

连接后你将获得用于聊天、会话、指标与管理的 Web UI。

## 配置与安全的最佳实践是什么?

### 机密与 API 密钥

切勿提交 API 密钥。使用环境变量、秘密管理器或与本地 `.gitignore` 配合的 `.env`。最佳实践:定期轮换密钥,并在提供方支持的情况下按 IP 限制使用。(OpenAI 文档与其他厂商建议采用环境变量。)

### 模型选择与成本控制

使用 CometAPI 的模型目录选择具备合理成本/时延权衡的模型。设置合理的速率限制,并实现带指数退避的重试。CometAPI 在其文档中提供模型列表与定价信息。

### 可观测性

使用 Agno 的 AgentOS 控制平面查看代理日志、会话追踪与指标。结合提供方层面的指标(CometAPI 仪表板),将成本/时延与代理活动进行关联分析。

### 隐私与数据驻留

由于 AgentOS 在你的云中运行,你可保留对会话数据的控制。但仍应避免在未经政策明确许可的情况下向第三方模型发送敏感 PII;如有需要,使用本地或私有模型托管。

## 最佳实践与推荐用例是什么?

### 最佳实践

- **从小开始:** 先用开发代理与低档(更便宜)模型测试,再逐步扩展。

- **模型回退:** 实现回退链(例如:更便宜的小模型 → 失败时切换到更强模型)。CometAPI 让你通过名称轻松切换模型。

- **精细化工具:** 为代理提供受限且审计的工具(网页搜索、DB 访问),并为工具调用打上追踪。Agno 提供了工具集成与具备仪表化的调用模式。

- **限流与批处理:** 对相似请求进行批量处理,并在网关或客户端层面应用速率限制以避免突发流量。

### 典型用例

- **RAG(检索增强生成)聊天机器人**——使用 Agno 代理处理文档,结合 CometAPI 进行语言生成。

- **自动化工作流**——多代理工作流融合网页抓取工具、向量数据库与生成步骤。

- **从原型到生产**——通过 CometAPI 快速试用不同模型,随后固定所选提供方或转向企业合同。

## 如何开始使用 CometAPI

CometAPI 是一个统一的 API 平台,将来自领先提供方的 500+ AI 模型——如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——聚合到一个对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到应用中的过程。无论你在构建聊天机器人、图像生成器、音乐创作工具,还是数据驱动的分析管道,CometAPI 都能让你迭代更快、控制成本、保持厂商中立,同时把握 AI 生态的最新突破。

开始前,请在 [CometAPI](https://www.cometapi.com/?utm_source=agno uted) 的 [Playground](https://www.cometapi.com/console/playground) 中探索模型能力,并查阅 Continue [API 指南](https://apidoc.cometapi.com/continue-1624859m0) 获取详细说明。访问之前,请确保你已登录 CometAPI 并获得 API 密钥。[Com](https://www.cometapi.com/)[e](https://www.cometapi.com/?utm_source=agno uted)[tAPI](https://www.cometapi.com/) 提供远低于官方价格的方案,以帮助你完成集成。

Ready to Go?→ [立即注册 CometAPI](https://api.cometapi.com/login)!

如果你想了解更多 AI 技巧、指南与新闻,请在 [VK](https://vk.com/id1078176061)、[X](https://x.com/cometapi2025) 与 [Discord](https://discord.com/invite/HMpuV6FCrG) 关注我们!

## 结语

将 Agno 与 CometAPI 集成,为构建灵活、可观测且厂商中立的代理式系统提供了务实路径。Agno 提供运行时与控制平面;CometAPI 提供通向众多模型的单一网关。二者共同降低了运营摩擦:更少的逐代理模型接线、更便捷的试验,以及集中化的计费与控制。