在 2025–2026 年,AI 工具生态持续整合:网关 API(如 CometAPI)扩展为提供 OpenAI 风格接入的数百个模型,而终端用户 LLM 应用(如 AnythingLLM)不断改进其 “Generic OpenAI” 提供方,使桌面与本地优先应用能够调用任意 OpenAI 兼容端点。如今,将 AnythingLLM 的流量通过 CometAPI 路由变得十分直接,同时获得模型选择、成本路由与统一计费的优势——并且仍然使用 AnythingLLM 的本地 UI 与 RAG/agent 功能。

什么是 AnythingLLM,以及为什么要将它连接到 CometAPI?

什么是 AnythingLLM?

AnythingLLM 是一个开源、集成式的 AI 应用与本地/云端客户端,用于构建聊天助手、检索增强生成(RAG)工作流以及由 LLM 驱动的 agents。它提供流畅的 UI、开发者 API、工作区/agent 功能,并支持本地与云端 LLM——默认注重隐私,且可通过插件扩展。AnythingLLM 暴露了一个 Generic OpenAI 提供方,使其能够与 OpenAI 兼容的 LLM API 通信。

什么是 CometAPI?

CometAPI 是一款商业化 API 聚合平台,通过一个 OpenAI 风格的 REST 接口与统一计费,提供对 500+ AI 模型 的访问。在实践中,它让你通过相同的 https://api.cometapi.com/v1 端点与单一 API Key(格式为 sk-xxxxx)调用来自多个厂商的模型(OpenAI、Anthropic、Google/Gemini 变体、图像/音频模型等)。CometAPI 支持标准的 OpenAI 风格端点,如 /v1/chat/completions、/v1/embeddings 等,这使得已支持 OpenAI 兼容 API 的工具易于适配。

为什么要将 AnythingLLM 与 CometAPI 集成?

三个实际理由:

- 模型选择与厂商灵活性:AnythingLLM 可以通过其 Generic OpenAI 包装器使用“任何 OpenAI 兼容”的 LLM。将该包装器指向 CometAPI,即可在不改变 AnythingLLM 的 UI 或流程的情况下,立即获得数百个模型的访问能力。

- 成本/运维优化:使用 CometAPI 可以在中心化层面切换模型(或下调至更便宜的模型)以进行成本控制,并通过统一计费避免管理多个供应商的密钥。

- 更快的实验迭代:你可以在同一个 AnythingLLM UI 中对不同模型进行 A/B 测试(如

gpt-4o、gpt-4.5、Claude 变体或开源多模态模型)——适用于 agents、RAG 回复、摘要与多模态任务。

集成前需要准备的环境与条件

系统与软件要求(概要)

- 运行 AnythingLLM 的桌面或服务器(Windows、macOS、Linux)——桌面安装或自托管实例。确认你的版本包含 LLM Preferences / AI Providers 设置。

- CometAPI 账号与 API Key(

sk-xxxxx格式的密钥)。你将在 AnythingLLM 的 Generic OpenAI 提供方中使用该密钥。 - 从你的机器到

https://api.cometapi.com的网络连通性(确保防火墙不拦截出站 HTTPS)。 - 可选但推荐:用于测试的现代 Python 或 Node 环境(Python 3.10+ 或 Node 18+)、curl,以及一个 HTTP 客户端(Postman / HTTPie),在接入 AnythingLLM 前先对 CometAPI 进行联通性验证。

AnythingLLM 专项说明

Generic OpenAI LLM 提供方是针对模仿 OpenAI API 表面的端点的推荐路径。AnythingLLM 文档提示该提供方面向开发者,你需要理解你所提供的输入。如果你使用流式传输或你的端点不支持流式传输,AnythingLLM 在 Generic OpenAI 中提供关闭流式传输的设置。

安全与运维清单

- 像对待其他密钥一样对待 CometAPI Key——不要提交到代码仓库;尽可能存储在操作系统钥匙串或环境变量中。

- 如果你计划在 RAG 中使用敏感文档,请确保端点的隐私保证符合合规需求(查阅 CometAPI 的文档/条款)。

- 决定最大 tokens 与上下文窗口限制,避免产生失控账单。

如何将 AnythingLLM 配置为使用 CometAPI(分步说明)?

下面是一个具体的步骤序列——随后附上环境变量与代码片段示例,用于在将设置写入 AnythingLLM UI 前测试连通性。

第 1 步 — 获取你的 CometAPI Key

- 在 CometAPI 注册或登录。

- 前往 “API Keys” 生成密钥——你将得到一个类似

sk-xxxxx的字符串。请妥善保管。

第 2 步 — 通过快速请求验证 CometAPI 可用性

使用 curl 或 Python 调用一个简单的 chat completion 端点,确认连通性。

Curl 示例

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

如果返回 200 且 JSON 响应包含 choices 数组,则表明你的密钥与网络正常。(CometAPI 文档展示了 OpenAI 风格的接口与端点)

Python 示例(requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

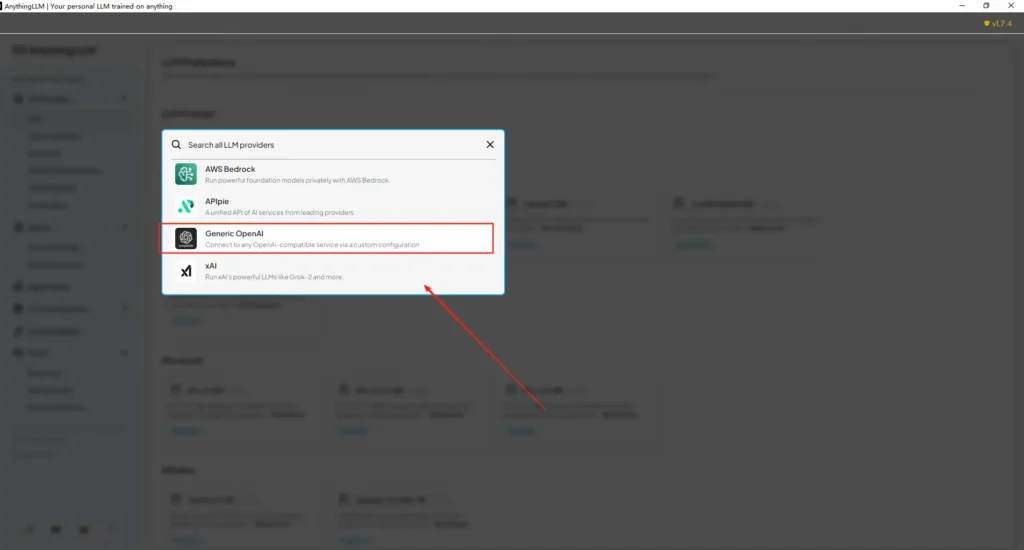

第 3 步 — 配置 AnythingLLM(UI)

打开 AnythingLLM → Settings → AI Providers → LLM Preferences(或你版本中的相似路径)。使用 Generic OpenAI 提供方,并按如下填写字段:

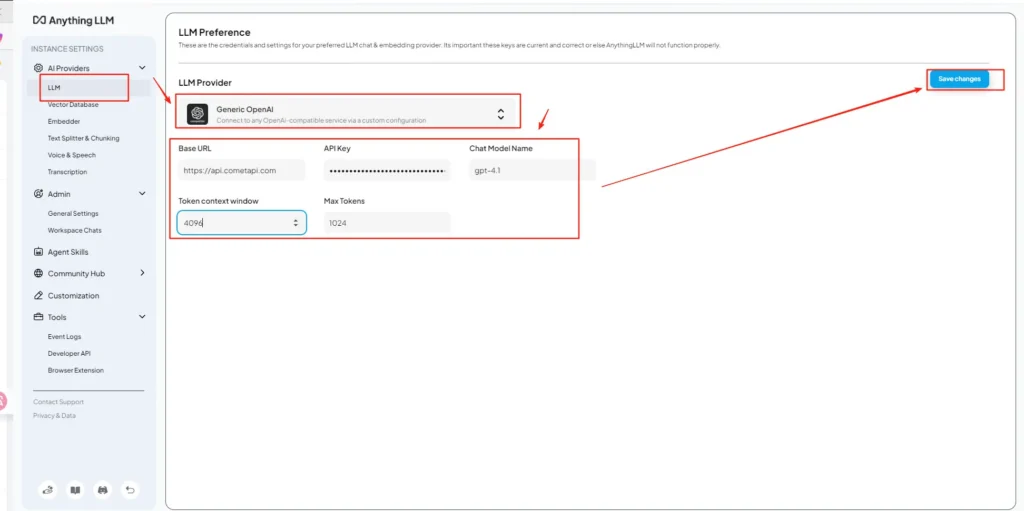

API Configuration(示例)

• 进入 AnythingLLM 设置菜单,在 AI Providers 下找到 LLM Preferences。

• 选择 Generic OpenAI 作为模型提供方,在 URL 字段输入https://api.cometapi.com/v1。

• 将来自 CometAPI 的sk-xxxxx粘贴到 API key 输入框。根据实际模型填写 Token context window 与 Max Tokens。你也可以在此页面自定义模型名称,例如添加gpt-4o模型。

这与 AnythingLLM 的 “Generic OpenAI”(开发者包装器)指引以及 CometAPI 的 OpenAI 兼容基础 URL 方式保持一致。

第 4 步 — 设置模型名称与 token 限制

在同一设置界面中,按 CometAPI 发布的模型名称精确添加或自定义(例如 gpt-4o、minimax-m2、kimi-k2-thinking),以便 AnythingLLM 的 UI 将这些模型呈现给用户。CometAPI 会为每个厂商发布模型字符串。

第 5 步 — 在 AnythingLLM 中测试

开始一个新聊天或使用现有工作区,若你配置了多个提供方,请选择 Generic OpenAI 提供方,选择你添加的某个 CometAPI 模型名称,并运行一个简单的提示。如果你得到连贯的回复,即说明集成成功。

AnythingLLM 内部如何使用这些设置

AnythingLLM 的 Generic OpenAI 包装器会构造 OpenAI 风格的请求(/v1/chat/completions、/v1/embeddings),因此一旦你指定基础 URL 并提供 CometAPI Key,AnythingLLM 将透明地通过 CometAPI 路由聊天、agent 调用与嵌入请求。如果你使用 AnythingLLM agents(@agent 流程),它们也会继承相同的提供方。

最佳实践与潜在陷阱有哪些?

最佳实践

- 使用匹配模型的上下文设置:将 AnythingLLM 的 Token context window 与 Max Tokens 与在 CometAPI 上选择的模型匹配。配置不匹配会导致意外截断或调用失败。

- 保护你的 API Key:将 CometAPI Key 存储在环境变量与/或 Kubernetes/密钥管理工具中;切勿提交到 git。若在 UI 中输入,AnythingLLM 会将密钥存储在本地设置中——将宿主存储视为敏感。

- 用更便宜/更小的模型开始实验流程:利用 CometAPI 在开发中尝试低成本模型,将高端模型用于生产。CometAPI 明确支持成本切换与统一计费。

- 监控用量并设置告警:CometAPI 提供用量看板——设置预算/告警以避免意外账单。

- 单独测试 agents 与工具:AnythingLLM agents 可触发动作;先在安全提示与预生产实例中进行测试。

常见陷阱

- UI 与

.env冲突:自托管时,UI 设置可能覆盖.env更改(反之亦然)。如果重启后设置回退,请检查生成的/app/server/.env。社区反馈曾报告LLM_PROVIDER重置。 - 模型名称不匹配:使用 CometAPI 未提供的模型名称会导致网关返回 400/404。务必在 CometAPI 模型列表中确认可用模型。

- token 限制与流式:若你需要流式响应,确认该 CometAPI 模型支持流式(以及 AnythingLLM 的 UI 版本支持)。不同提供商的流式语义可能存在差异。

这一集成可解锁哪些真实世界场景?

检索增强生成(RAG)

将 AnythingLLM 的文档加载器 + 向量数据库与 CometAPI 的 LLM 结合,生成具备上下文的答案。你可以在廉价的嵌入模型与更昂贵的聊天模型之间组合试验,或全部通过 CometAPI 以实现统一计费。RAG 流程是 AnythingLLM 的主要内置功能。

Agent 自动化

AnythingLLM 支持 @agent 工作流(浏览网页、调用工具、运行自动化)。通过 CometAPI 路由 agents 的 LLM 调用,可以为控制/解释步骤选择不同模型,而无需修改 agent 代码。

多模型 A/B 测试与成本优化

基于工作区或功能切换模型(例如生产回答用 gpt-4o,开发用 gpt-4o-mini)。CometAPI 让模型切换变得简单,并集中成本管理。

多模态流水线

CometAPI 提供图像、音频与专项模型。AnythingLLM 的多模态支持(通过提供方)加上 CometAPI 的模型,使图像标注、多模态摘要或音频转写等流程可以通过同一接口实现。

结论

CometAPI 持续定位为多模型网关(500+ 模型、OpenAI 风格 API)——这使其成为像 AnythingLLM 这类已支持 Generic OpenAI 提供方的应用的天然搭档。同样,AnythingLLM 的 Generic 提供方与近期的配置选项也使连接此类网关变得直截了当。这种收敛在 2025 年后期简化了实验与生产迁移。

How to get started with Comet API

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500 多个 AI 模型——如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——聚合到一个对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了将 AI 能力集成到你应用中的过程。无论你是在构建聊天机器人、图像生成器、音乐生成器,还是数据驱动的分析流水线,CometAPI 都能让你更快迭代、控制成本并保持供应商中立,同时把握 AI 生态的最新突破。

开始之前,前往CometAPI 的Playground 了解模型能力,并查阅 API 指南获取详细说明。访问前,请确保已登录 CometAPI 并获取 API Key。CometAPI 提供远低于官方价格的方案,帮助你完成集成。

Ready to Go?→ Sign up for CometAPI today !