Mistral 3 是 Mistral AI 于 2025 年末发布的重磅模型家族。它同时带来适合本地/边缘部署的紧凑、快速模型,以及一款非常大的稀疏旗舰模型,在规模与上下文长度上推动最先进水平。本文解释 Mistral 3 是什么、如何构建、为什么你可能想在本地运行它,以及在你的机器或私有服务器上运行它的三种实用方法——从 Ollama 的“点选即跑”便利性,到使用 vLLM/TGI 的生产级 GPU 服务,再到使用 GGUF + llama.cpp 在小型设备上进行 CPU 推理。

什么是 Mistral 3?

Mistral 3 是来自 Mistral AI 的最新一代开放权重模型。该家族同时包含一个巨大的 Mistral Large 3(稀疏的 Mixture-of-Experts——MoE——模型)以及若干边缘/“ministral”变体(3B、8B、14B),针对指令跟随和多模态(文本+视觉)任务进行了调优。Mistral 将该版本定位为广泛可用:既适用于高性能数据中心推理(提供专门优化的检查点),也适用于通过量化格式和更小变体进行边缘及笔记本使用。

关键的实用特性:

- 大型 3 版本采用 Mixture-of-Experts (MoE) 架构,总参数量非常大,但每个 token 只激活一部分专家——这在大规模下提升了效率。

- 一系列 Ministral 3 模型(3B / 8B / 14B),面向边缘和本地使用,提供指令调优与多模态变体。

- 官方检查点以及一组优化检查点(NVFP4/FP8),适配 vLLM 和 NVIDIA 平台等加速运行时。

- 多模态 + 多语言 + 长上下文——Ministral 和 Large 变体强调图像+文本理解与广泛语言覆盖。对于同时处理图像与长文档的应用,这点尤为重要。

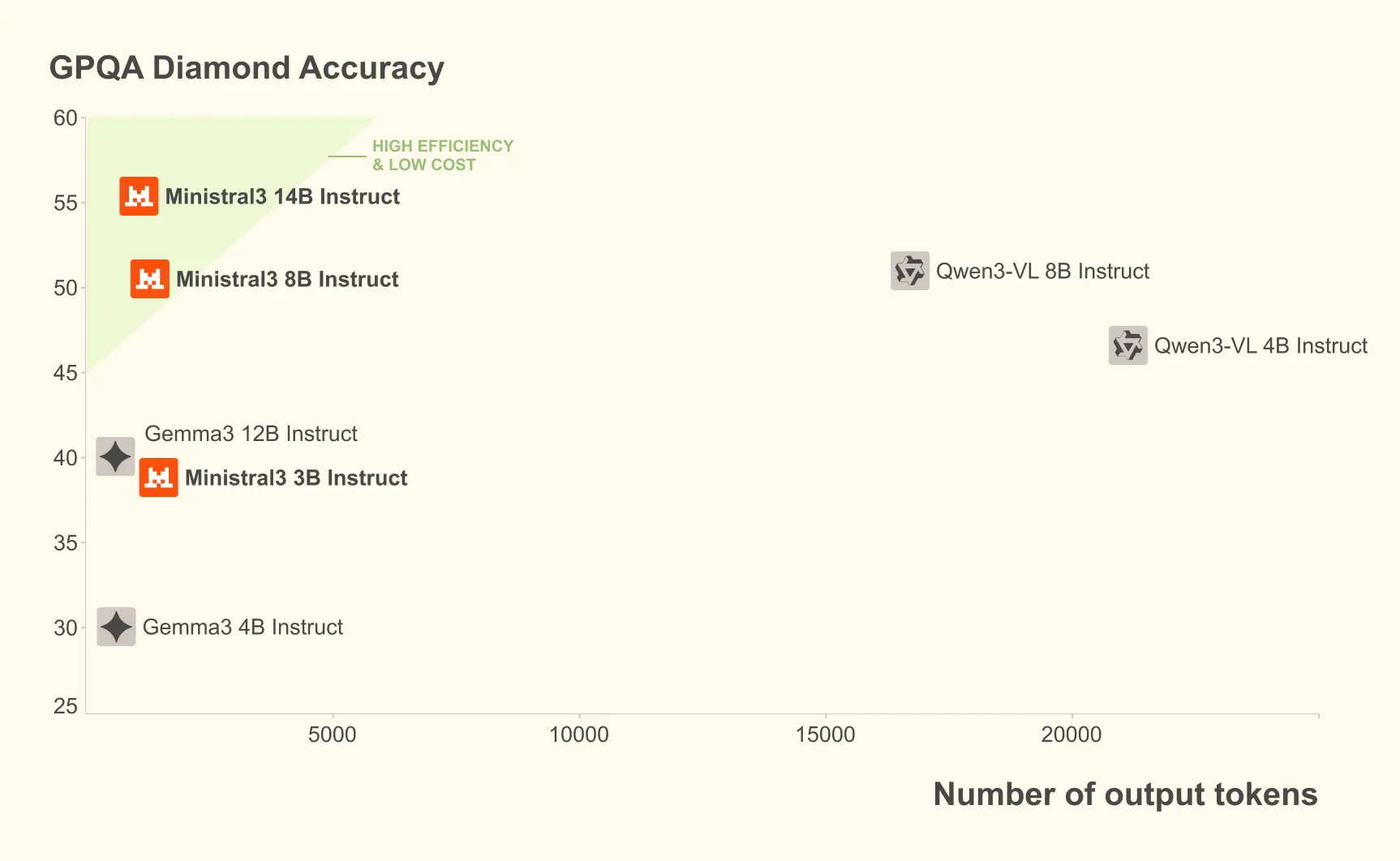

在 GPQA Diamond 数据集(严格的科学推理测试)上,Miniral 3 的各个变体即使在输出 token 数增加的情况下也能保持较高准确率。例如,Miniral 3B Instruct 模型在处理多达 20,000 个 token 时仍维持 35–40% 的准确率,可与更大的模型(如 Gemma 2 9B)相媲美,同时使用更少资源。

Mistral 3 的架构是什么?

Mistral 3 是一个家族而非单一架构,但你需要理解的两种架构模式是:

稠密小模型(Ministral 3)

- 标准 Transformer 堆栈,针对效率与边缘推理进行优化。

- 提供多种尺寸(3B/8B/14B)以及不同的微调变体:base、instruct 和 reasoning;许多变体包含原生多模态(视觉 + 文本)支持以及长上下文能力。Minstral 模型在某些发行版中以优化的 FP8 权重发布以提高紧凑性。

稀疏 Mixture-of-Experts(Mistral Large 3)

- MoE 架构:模型拥有大量专家(总参数量巨大),但每个 token 仅计算由路由选择的一部分专家——从而实现更好的计算-规模权衡。

- Mistral Large 3 标称总参数约 ~675B,推理时“激活”参数约 ~41B,体现了这种 MoE 设计。该模型在现代 NVIDIA 硬件上训练,并针对高效的低精度执行进行了优化(NVFP4/TensorRT/大核优化)。

在本地运行时重要的技术特性:

- 长上下文:某些 Mistral 3 变体支持非常长的上下文(vLLM 文档和 Mistral 文档提到某些变体拥有巨大的上下文窗口;例如,部分 Ministral 变体为 256k)。这会影响内存与服务模式。

- 权重格式与量化:Mistral 提供压缩/优化格式的权重(FP8、NVFP4),并与现代量化工具链(BitsAndBytes、GPTQ、厂商工具链)配合,便于在本地进行实用推理。

为什么要在本地运行 Mistral 3?

在本地运行 LLM 不再只是小众爱好——对于关注以下事项的团队与个人,这是一个实用选项:

- 数据隐私与合规。 本地托管让敏感输入留在你的基础设施内(对金融、医疗、法律领域很重要)。Reuters 报道称有大型客户选择自托管 Mistral 模型。

- 时延与成本控制。 对严格延迟 SLO 和可预测成本的场景,本地或私有集群推理可以避免云 API 的账单震惊。更小的 ministral 变体和量化格式让这一点变得可行。

- 定制与微调。 当你需要自定义行为、函数调用或新增模态时,本地控制可以实现定制微调与数据处理。与 Hugging Face 和 vLLM 的集成使这一过程更为“开箱即用”。

若这些原因与你的优先事项一致——隐私、控制、成本可预期或研究——值得考虑本地部署。

如何在本地运行 Mistral 3(三种实用方法)?

在本地运行 Mistral 3 的方法很多。本文涵盖三种常见用户场景的方式:

- Ollama(零配置桌面/本地服务器,对多数用户最容易)

- Hugging Face Transformers + PyTorch / vLLM(完全控制,GPU 集群)

- llama.cpp / ggml / GGUF 量化 CPU 推理(轻量级,可在笔记本/CPU 上运行)

针对每种方法,将说明适用场景、前提条件、分步命令与小型代码示例。

1) 如何使用 Ollama 运行 Mistral 3(最快路径)?

适用场景: 你需要无摩擦的本地体验(macOS/Linux/Windows)、易上手的 CLI 或 GUI,并在可用时自动下载/量化制品。Ollama 提供 Ministral 3 及 Mistral 家族其他成员的模型条目。

前提条件

- 已安装 Ollama(参见 ollama.com 的安装程序)。Ollama 库对部分 ministral 版本有最低版本要求。

- 足够的磁盘空间存储模型制品(模型大小不同——ministral 3B 的量化版本可能只有几 GB;更大的 BF16 版本则可能达数十 GB)。

步骤(示例)

- 安装 Ollama(macOS 示例——不同平台请替换):

# macOS (Homebrew) example — see ollama.com for platform-specific installersbrew install ollama

- 运行一个 ministral 模型:

# Pull and run the model interactivelyollama run ministral-3

- 在本地提供服务(API)并从代码调用:

# Run Ollama server (default port shown in docs)ollama serve# Then curl against it (example)curl -s -X POST "http://localhost:11434/api/v1/generate" \ -H "Content-Type: application/json" \ -d '{"model":"ministral-3","prompt":"Summarize Mistral 3 in one sentence."}'

注意与提示

- Ollama 负责模型下载,并在可用时提供本地量化变体——非常适合快速试用模型。

- 若计划在生产中处理大量并发请求,Ollama 非常适合原型阶段,但请针对稳定负载评估扩展与资源编排。

2) 如何使用 Hugging Face Transformers 运行 Mistral 3(GPU / vLLM 集成)?

适用场景: 你需要用于研究或生产的编程控制,希望进行微调,或希望在 GPU 集群上使用 vLLM 等加速推理栈。Hugging Face 提供 Transformers 支持,Mistral 提供针对 vLLM/NVIDIA 优化的检查点。

前提条件

- 具有足够显存的 GPU(因模型与精度而异)。Ministral 3 的小型(3B/8B)在量化后可在单块中端 GPU 上运行;更大的变体需要多块 H100/A100,或针对 vLLM 的 NVFP4 优化检查点。NVIDIA 与 Mistral 文档推荐了大型模型的具体节点规模。

- Python、PyTorch、transformers、accelerate(若使用 vLLM 则安装该服务)。

Python 示例——基础 Hugging Face pipeline(3B instruct 变体,GPU):

# Example: CPU/GPU inference with transformers pipeline# Assumes you have CUDA and a compatible PyTorch build.import torchfrom transformers import pipelinemodel_name = "mistralai/Ministral-3-3B-Instruct-2512-BF16" # example HF model idgenerator = pipeline( "text-generation", model=model_name, device_map="auto", torch_dtype=torch.bfloat16, # use bfloat16 if your hardware supports it)prompt = "Explain how attention helps transformers, in 3 sentences."out = generator(prompt, max_new_tokens=120, do_sample=False)print(out[0]["generated_text"])

使用 vLLM 进行生产级 GPU 推理

vLLM 致力于高效服务大型模型,支持 Mistral 3 家族,且 Mistral 发布了针对 vLLM/NVIDIA 硬件(NVFP4/FP8)的优化检查点,以降低内存占用并加速。启动 vLLM 服务器可获得低延迟、批量推理的端点。请参阅 vLLM 的配方与 Mistral 的指导,了解模型路径与推荐参数。

注意与提示

- 在生产中优先选择优化检查点(NVFP4/FP8),并在推荐 GPU(如 H100/A100)上运行,或使用支持张量/模型并行的编排层。Mistral 与 NVIDIA 提供了优化运行时的文档与博客文章。

- 始终在磁盘上固定具体模型检查点(或可复现的 HF 快照),以确保结果可复现并避免模型被静默更新。

3) 如何使用 llama.cpp / GGUF 量化模型在 CPU 上运行 Mistral 3?

适用场景: 你需要在 CPU 上进行本地、离线推理(如开发者笔记本、严格保密的隔离环境),并愿意为运行速度与内存效率牺牲部分精度。该方法使用 ggml/llama.cpp 与 GGUF 量化权重(q4/q5 等)。

前提条件

- 一个 Ministral 模型的 GGUF 量化构建(许多社区成员会在 Hugging Face 上发布量化 GGUF,或将 BF16 权重本地转换为 GGUF)。搜索

Ministral-3-3B-Instruct的 GGUF 变体。 - 已编译的 llama.cpp 可执行文件(参见项目 README)。

量化(若你拥有原始权重)——示例(概念性)

# Example: quantize from an FP16/BF16 model to a GGUF q4_K_M (syntax depends on llama.cpp version)./quantize /path/to/original/model.bin /path/to/out.gguf q4_k_m

使用 llama.cpp 运行 GGUF

# run interactive inference with a quantized GGUF model./main -m /path/to/ministral-3-3b-instruct.gguf -t 8 -c 2048 --interactive# -t sets threads, -c sets context (tokens) if supported

Python 客户端示例(本地 llama.cpp 服务器或子进程)

你可以以子进程方式启动 llama.cpp 并向其传入提示,或使用一个小型包装客户端。社区中有许多项目为 llama.cpp 提供简单的 HTTP 服务器包装,方便与本地应用集成。

注意与权衡

- 量化可降低显存/内存并启用 CPU 推理,但可能带来一定的质量下降(轻微到中等,取决于量化格式)。q4_K_M 或 q5 等格式是 CPU 使用中的常见折中。日文与技术文章详细解释了 Q4/Q5 类型与 GGUF 转换。

- 对于小到中等负载,GGUF + llama.cpp 常是运行本地 LLM 成本最低且最便携的方式。

需要关注哪些硬件与内存因素?

简短、实用的指导:

- 3B 模型: 通常可量化后在性能不错的笔记本 CPU 或单块 GPU 上运行(8–16 GB 显存,视精度/量化而定)。GGUF 的 q4 变体可在多数现代 CPU 上运行。

- 8B 和 14B ministral: 通常需要中高端 GPU(例如,24–80 GB,取决于精度与激活缓存)或跨多设备的量化。

- Mistral Large 3(总 675B,激活 41B): 面向数据中心部署,通常在多 GPU 节点(如 8×A100 或 H100)以及专用格式(NVFP4/FP8)下通过 vLLM 运行效果最佳。Mistral 明确发布了优化检查点以使此类部署更可行。

如果你的优先事项是本地笔记本使用,请选择 ministral 3B 的量化 GGUF + llama.cpp 路线。若优先事项是生产吞吐,请在 GPU 上使用 vLLM + NVFP4 检查点。若你追求便捷试验,Ollama 是最快的入门方式。

应该如何选择量化与精度?

量化是一种权衡:内存与速度 vs. 模型原始质量。常见选择:

- q4_0 / q4_1 / q4_K_M: 常用于 CPU 推理的热门 4 位选项;q4_K_M(k-means 变体)在质量/性能上常有更好平衡。

- q5 / q8 / imatrix 变体: 中间格式,可能以更大的体积保留更多保真度。

- FP16 / BF16 / FP8 / NVFP4: GPU 精度——BF16 和 FP16 是现代 GPU 上常见的训练/推理精度;FP8 / NVFP4 是新兴格式,在优化运行时与 Mistral 的检查点支持下可节省内存用于超大模型。

经验法则: 本地 CPU 运行选择 q4_K_M 或类似格式;高保真 GPU 推理选择 BF16/FP16,或在运行时支持的情况下选择厂商特定的 FP8/NVFP4。

结论——是否应在本地运行 Mistral 3?

如果你需要隐私、低延迟或定制化,答案是肯定的:Mistral 3 家族提供了广泛选项——用于边缘 CPU 的小型模型、可在单块 GPU 或小型集群上运行的中型模型,以及面向数据中心规模的稀疏 MoE 版本——且生态(Ollama、Hugging Face、vLLM、llama.cpp)已支持本地与私有部署的实用模式。Mistral 还与 NVIDIA 和 vLLM 联合提供优化检查点,以实现高吞吐与降低内存占用,使生产级自托管比以往更现实。

开始之前,请在 Gemini 3 Pro 的能力展示页 Playground 中进行探索,并查阅 API 指南 获取详细说明。访问前,请确保你已登录 CometAPI 并获取 API key。CometAPI 提供远低于官方价格的方案,帮助你集成。

准备好了吗?→ 立即注册 CometAPI!