AI 发展迅速:新的多模态模型和改进的实时 API 正让在自动化平台中嵌入强大的 AI 变得更容易;与此同时,关于安全与可观测性的讨论正在重塑团队运行生产系统的方式。对构建本地自动化的人而言,一个实用模式正在形成:使用统一的模型网关(如 CometAPI)访问多种模型,并将这些模型调用串接进自托管的自动化运行器(如 n8n),以便你掌控数据、延迟与成本。本指南将逐步展示如何开始使用 CometAPI + n8n(本地)、需要注意的事项,以及当出现问题时如何排障。

什么是 n8n,它为何对 AI 自动化重要?

n8n 是一个开源的工作流自动化工具,具备可视化编辑器和庞大的节点(连接器)生态。它旨在让你将触发器、转换与外部 API 调用串联为可复用的工作流(Webhook、定时任务、文件处理、聊天机器人等)。在本地自托管 n8n 能让你完全掌控数据驻留与执行,这在调用处理敏感输入的第三方 AI 模型时尤为重要。

n8n 在实践中如何工作?

- 可视化画布包含触发器(Webhook、Cron)和动作节点(HTTP Request、数据库节点、邮件)。

- 社区节点扩展能力——你可以安装社区包并将其当作原生节点使用。

自托管 n8n 可为你带来:

- 完整数据控制——工作流与运行数据保留在你管理的基础设施上。

- 可定制性——添加私有节点或本地集成,无需等待云端功能上线。

- 成本可预测——内部高频自动化不再有按任务计费的云端账单意外。

- 安全与合规——更容易满足内部政策与监管要求。

什么是 CometAPI,为什么将它作为你的模型网关?

CometAPI 是一个统一的 API 网关,通过单一、与 OpenAI 兼容的接口与计费模型,提供数百个第三方 AI 模型(文本、嵌入、图像生成等)。这意味着你无需为每个想尝试的 LLM 或图像引擎添加定制集成,只需调用一个 API,并在请求中选择所需模型即可。它简化了试验、成本控制与运营集成。

优点:

- 模型选择: 用同一条代码路径尝试众多厂商/模型。

- 令牌池/免费额度: 许多统一网关提供用于试验的积分/层级。

- 更简单的基础设施: 统一的认证系统与基础 URL 便于管理。

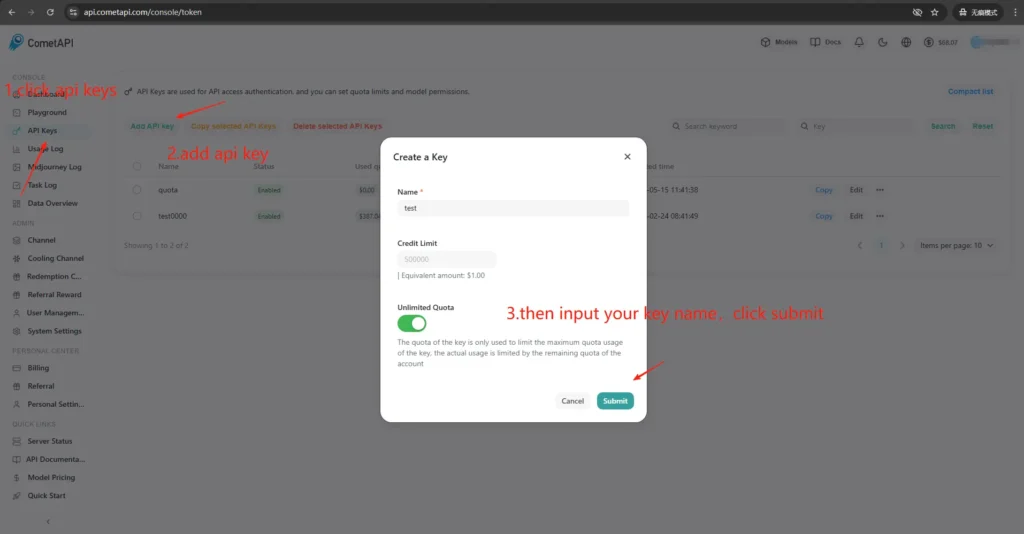

如何获取 CometAPI 访问权限与密钥?

- 注册 CometAPI 站点(或供应商控制台)。多数网关有可测试的免费层。

- 获取 API 密钥 于 CometAPI 控制台——一串较长的机密字符串。注意文档指示的放置位置(CometAPI 在

https://api.cometapi.com/v1使用 Bearer 授权)。 - 阅读 API 文档,了解你计划使用的端点(聊天补全、图像、嵌入)。CometAPI 文档包含如

/v1/chat/completions与/v1/images/generations的端点。

为什么 n8n 与 CometAPI 的绑定(集成)很重要?

这里的“绑定”指的是你的自动化运行器(n8n)与模型网关之间可靠、安全的集成路径。良好的绑定之所以重要,是因为:

- 它保留调用间的上下文(对话历史、嵌入)。

- 它将凭据与机密集中在一处,便于更安全的轮换。

- 它通过可预测的端点与标准请求格式降低延迟与错误面。

- 它实现可观测性与排障——明确是哪个模型、提示与响应产生了某个结果。

简言之:良好的绑定降低运营风险并加快迭代。

如何在本地部署 n8n(快速实用指南)?

你可以使用 npm 或 Docker 在本地运行 n8n;对于多数自托管场景,推荐使用 Docker Compose(可复现并隔离依赖)。下面是一个最小的 Docker Compose 示例与关键说明。

如何通过 Docker 自托管 n8n?

Docker(和 Docker Compose)是在生产环境中运行 n8n 最稳健、可复现的方式。它隔离应用、简化升级,并与反向代理和编排器(Docker Swarm、Kubernetes)配合良好。n8n 官方文档包含 Docker Compose 参考,本文在此基础上进行说明与调整。

在生产环境中,通常运行由以下组成的栈:

- n8n 服务(官方镜像:

docker.n8n.io/n8nio/n8n或根据标签使用n8nio/n8n)。 - PostgreSQL(或其他受支持的数据库)。

- Redis(如果计划使用队列模式)。

- 反向代理(Traefik、Caddy 或 Nginx)用于 TLS、主机路由与限流规则。

这一架构清晰地分离关注点(数据库持久化、排队、Web 代理),便于扩展与备份。官方 n8n 文档提供 Docker Compose 模式与环境变量参考。

以下是分步指南:

- 创建文件夹与包含规范 n8n 服务的

docker-compose.yml。下面是一个实用的 docker-compose 示例,涵盖常见生产需求:外部 Postgres、Redis(用于队列/执行模式)、持久化卷与由 Nginx 处理 TLS 的反向代理:

```yaml

version: "3.8"

services:

n8n:

image: n8nio/n8n:latest

restart: unless-stopped

environment:

- DB_TYPE=postgresdb

- DB_POSTGRESDB_HOST=postgres

- DB_POSTGRESDB_PORT=5432

- DB_POSTGRESDB_DATABASE=n8n

- DB_POSTGRESDB_USER=n8n

- DB_POSTGRESDB_PASSWORD=supersecretpassword

- N8N_BASIC_AUTH_ACTIVE=true

- N8N_BASIC_AUTH_USER=admin

- N8N_BASIC_AUTH_PASSWORD=anothersecret

- WEBHOOK_TUNNEL_URL=https://n8n.example.com

- EXECUTIONS_MODE=queue

- QUEUE_BULL_REDIS_HOST=redis

ports:

- "5678:5678"

volumes:

- n8n_data:/home/node/.n8n

depends_on:

- postgres

- redis

postgres:

image: postgres:15

environment:

POSTGRES_DB: n8n

POSTGRES_USER: n8n

POSTGRES_PASSWORD: supersecretpassword

volumes:

- pgdata:/var/lib/postgresql/data

redis:

image: redis:7

volumes:

- redisdata:/data

volumes:

n8n_data:

pgdata:

redisdata:

2. 启动:

docker compose up -d

3. 访问 `http://localhost:5678` 并创建你的管理员用户。用于生产时,你需要 Postgres、SSL 与适当的环境变量——参阅官方 Docker Compose 文档。

**注意与加固:**

- **不要**在 `docker-compose.yml` 中以明文存储机密;在生产中使用环境文件、Docker secrets 或外部机密管理器。

- 将 `WEBHOOK_URL` 替换为你的真实公共 URL,并配置反向代理将 `n8n.example.com` 路由到 n8n 容器。

- 使用 `EXECUTIONS_MODE=queue` 以获得更稳健的后台处理;它需要队列工作器与 Redis。

## 如何通过 npm / Node.js 自托管 n8n?

通过 npm(或 pnpm)安装将直接在主机上运行 n8n。这更轻量(无容器层),适合单用户、低复杂度安装或开发者机器。但它对管理员在依赖管理、隔离与服务监管方面提出了更高要求。官方 n8n 文档提供了 npm 安装指南与注意事项。

### 所需 OS 包与 Node 版本:

- 使用稳定的 LTS Node.js(Node 18 或 Node 20+,与 n8n 发行要求匹配)。

- 安装 `build-essential`、`git`,以及进程管理器(推荐 systemd)。

- 生产环境仍然使用 PostgreSQL 与 Redis 作为外部服务(理由与 Docker 相同)。

### 如何通过 npm 安装并运行 n8n(分步)?

1. 安装 Node.js(推荐:nvm)

Install nvm

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.39.7/install.sh | bash

Reload your shell (adjust to your shell startup file if needed)

source ~/.bashrc # or ~/.zshrc

Install and use the latest LTS (usually 18 or 20)

nvm install --lts

nvm use --lts

Verify

node -v

npm -v

如果你稍后看到 “n8n: command not found”,请重启终端或确保 nvm 管理的 npm 全局 bin 路径已加入 PATH。

---

2. 安装并启动 n8n(本地)

npm install -g n8n

n8n -v # verify version

3. 前台启动:

n8n start

默认 URL:<http://localhost:5678/> 如果端口已占用:

export N8N_PORT=5679

n8n start

可选:在后台保持运行(仍为本地):

npm install -g pm2

pm2 start "n8n" --name n8n

pm2 save

pm2 status

4. 首次访问并登录:

- 在浏览器中打开 http://localhost:5678/

- 首次运行时,按照向导创建所有者账户(邮箱 + 密码)并登录。

## 如何在 n8n 中安装或配置 CometAPI 社区节点?

n8n 支持经验证的社区节点(GUI 安装)以及在自托管时通过 npm 手动安装。将 CometAPI 集成到 n8n 有两种方式:

### 选项 A — 使用 CometAPI 社区节点(如果在节点面板中可见)

1. 在 n8n 中打开节点面板(按 `+` 或 `Tab`)。

2. CometAPI 是经过验证的社区节点,它出现在 “More from the community” 下。点击安装。

3. 安装后如提示请重启 n8n。在 设置 → Credentials 中创建新的**凭据**(若节点提供对应 CometAPI 凭据类型),并粘贴你的 CometAPI token。

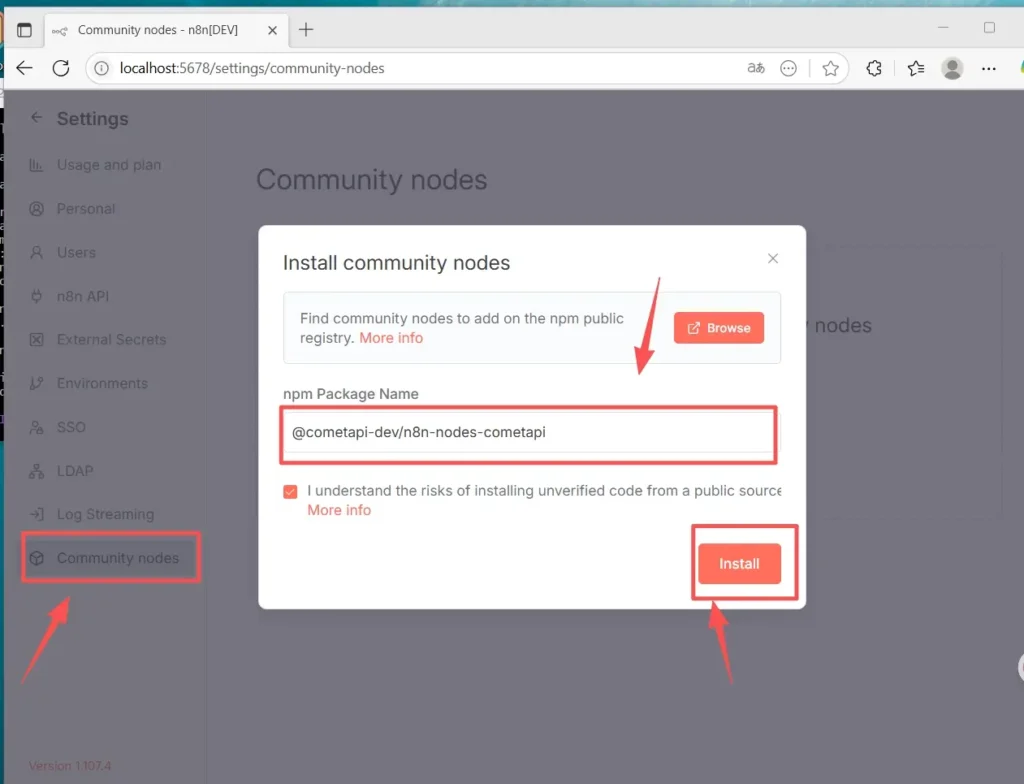

### 选项 B — 手动安装(当 GUI 安装不可用时)

1. SSH 登录到你的 n8n 主机/容器。

2. 在全局 n8n `node_modules` 或你的自定义目录中安装该包:

- 转到 Settings(左下角)> Community nodesClick “

- Install a community node”

- 在 “npm Package Name” 中输入:`@cometapi-dev/n8n-nodes-cometapi`Check the risk acknowledgment boxClick “

- Install”After installation, you can search for “CometAPI” in the node panel.

3. 重启 n8n。如果你的实例运行在队列模式中,必须按照文档走手动安装路径。

### 如何检查节点已安装

- 重启后,打开节点面板并搜索 “CometAPI” 或 “Comet”。该节点将标记为社区包。

- 如果看不到该节点:确认你使用的是实例所有者账户(只有实例所有者可安装),或检查容器/镜像日志中是否存在包安装与模块解析错误。

## 如何创建工作流并配置 API

### 1. 创建新工作流

- 登录你的 n8n 实例(自托管)。

- 点击 **“Add Workflow”** 开始一个全新的自动化画布。

### 2. 添加节点

- 添加一个触发器节点:搜索 “Manual Trigger” 或 “When clicking ‘Execute workflow’”。

- 点击画布右侧的 “+”,搜索 “CometAPI” 添加该节点。

- 也可以在左侧节点列表中搜索 “CometAPI” 并拖拽到画布上。

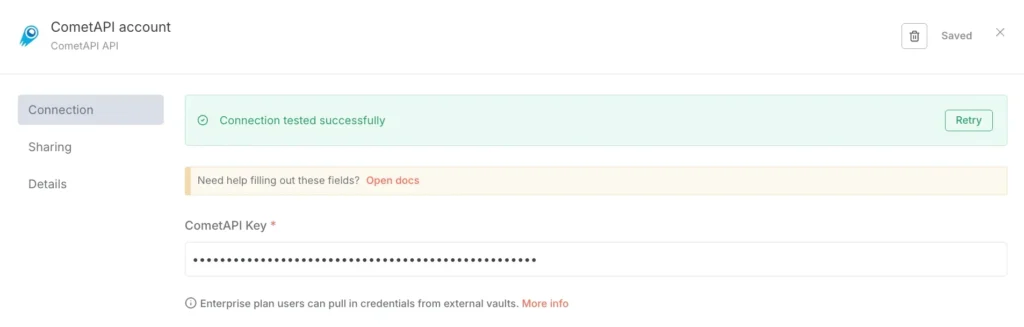

### 3. 配置凭据(仅首次)

- 在 CometAPI 节点中,位于 “Credential to connect with” 下选择 “Create new”。

- 将你在 CometAPI 控制台创建的令牌粘贴到 “CometAPI Key”。

- 保存。Base URL 默认是 https://www.cometapi.com/console/,通常无需修改。

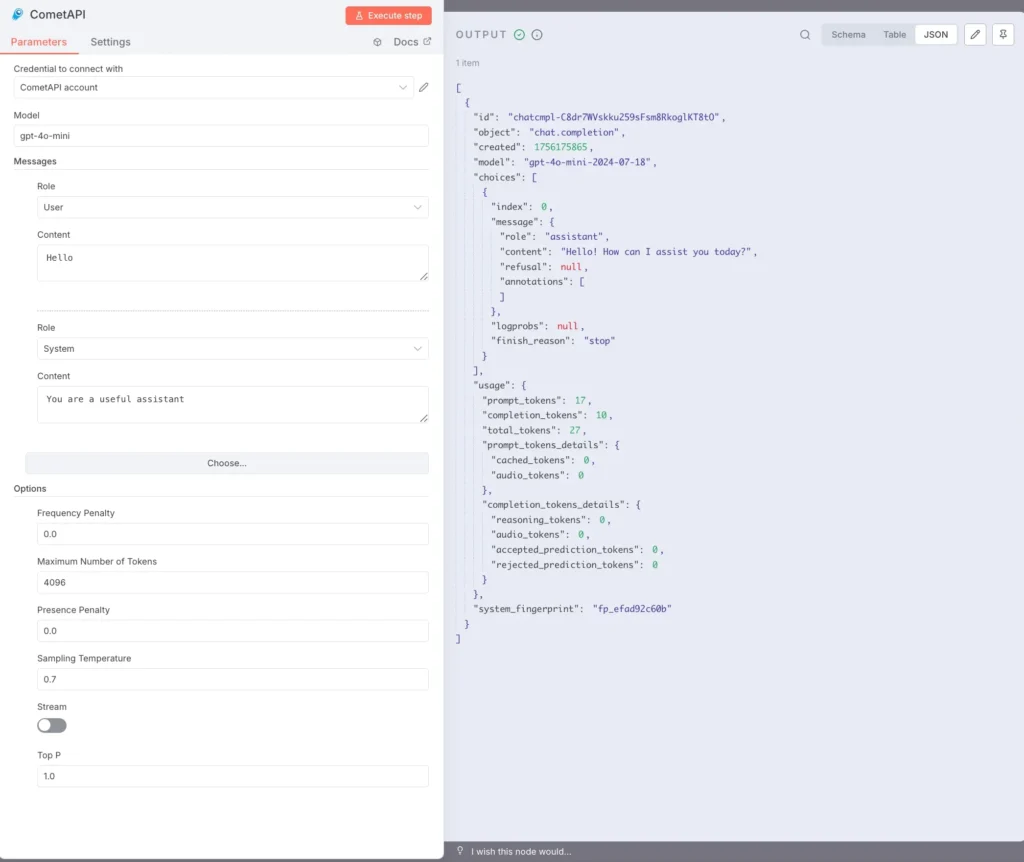

### 4. 配置模型与消息:

模型:输入一个受支持的模型,例如 `gpt-4o` 或 `gpt-4o-mini`。

消息:需要填写角色与上下文,Role 可选择 user 或 system。

可选参数(按需):Maximum Number of Tokens(例如 4096);Sampling Temperature(例如 0.7);PenaltyStream(启用/禁用流式输出)。具体参数文档与说明请参考 [CometAPI 文档](https://api.cometapi.com/doc)。

### 5. 文本执行:

选择 CometAPI 节点并点击 “Execute step”,或者点击底部的 “Execute workflow”。

右侧的 OUTPUT 面板应显示 JSON 响应(包含 choices、usage 等)。

现在你已在 Linux 上通过 npm 本地安装了 n8n(推荐),安装并配置了 CometAPI 社区节点,并可运行调用如 gpt-4o 等模型的工作流以获取响应。

## 常见问题与排障方法

### 1) “401 Unauthorized” 或 “Invalid API key”

- 在 CometAPI 控制台确认精确的令牌字符串(可能存在名称相似的令牌)。复制 → 粘贴到 n8n 凭据,并在必要时重启节点。

- 确保 Authorization 头的格式为 `Bearer sk-xxxxx`。

### 2) 社区节点无法安装 / “队列模式”

- 如果你的 n8n 运行在**队列模式**,GUI 安装可能被禁用;请按照手动安装文档通过 npm 安装社区节点,或构建包含该节点的自定义镜像。安装后重启 n8n。

### 3) 安装后在节点面板找不到节点

- 重启 n8n。

- 确保你在正确的上下文中安装了该包(在容器镜像内部或使用 `.n8n/custom` 路径的模式)。

- 检查容器日志是否存在模块解析错误。

### 4) 速率限制或配额问题

- 在 CometAPI 控制台检查使用量与配额。

- 实现指数退避,并在检测到限流警告或 HTTP 429 时回退到更便宜的模型。

## 若社区节点不可用或你需要更高灵活性,有哪些替代方案?

有的——你可以直接使用 **HTTP Request** 节点(完全控制),或使用带 base URL 重定向的 [OpenAI 节点](https://apidoc.cometapi.com/n8n-965890m0)(实用捷径)。使用原生 HTTP 也便于采用 CometAPI 新发布的端点(例如图像/视频端点)。请参考 [Guide](https://apidoc.cometapi.com/n8n-965890m0)。

**另请参阅** [How to Use n8n with CometAPI](https://www.cometapi.com/how-to-use-n8n-with-cometapi/?utm_source=chatgpt.com)

## 结论:

CometAPI 提供模型选择与运营简化;n8n 提供可视化编排与可扩展性。使用 OpenAI 凭据技巧快速接入聊天/补全,社区节点在可用且可信时使用。为每个工作流做好成本、延迟与安全的监控与度量;对重要决策优先采用人工兜底;保持模型选择的动态性,以适应 AI 供应商格局的快速变化。n8n 与 CometAPI 的组合很强大,但与所有强大工具一样,需要护栏——观察、测试并迭代。