Anthropic 于 2025 年 11 月下旬发布了 Claude Opus 4.5,这是一款更强大、更高效的 Opus 级模型,面向专业软件工程、代理式(agentic)工作流和长周期任务。它可通过 Anthropic 的开发者平台以及 CometAPI 获取,并引入了新的 API 控制项(尤其是 effort 参数)、改进的计算机使用工具(computer-use tooling)、扩展思考(extended thinking)以及在生产环境中至关重要的 token 效率提升。

以下是实用的专业指南:有哪些变化、如何获取访问权限、如何使用新的控制项(effort、扩展思考、工具使用、文件/计算机使用)、成本与优化建议、安全与治理考量,以及真实的集成模式。

Claude Opus 4.5 到底是什么,为什么重要?

Claude Opus 4.5 是 Anthropic 最新的 Opus 级模型系列成员(发布于 2025 年 11 月 24–25 日),聚焦在最大化推理与编码能力,同时提升 token 效率,并提供新的 API 控制项以平衡成本与严谨度。Anthropic 将 Opus 4.5 定位为其发布过的“最智能模型”,面向复杂软件工程任务、长时间运行的代理、电子表格/Excel 自动化,以及需要持续多步推理的任务。

Opus 4.5 的主要更新有哪些?

Anthropic 设计 Opus 4.5 以提升推理的深度和代理式行为,同时为开发者提供更好的成本/时延权衡控制。发布亮点包括:

- effort 参数(beta): 一个一等公民的 API 旋钮,用于控制 Claude 在单次请求上投入多少“思考预算”(常见取值为

low、medium、high)。它会影响推理、工具调用与内部“思考”token,从而让你可以按调用调节速度与严谨度,而无需切换模型。这是 Opus 4.5 的标志性能力。 - 更好的代理与工具编排: 在工具选择的准确性、结构化工具调用以及更健壮的工具结果工作流方面都有改进,有利于构建代理与多步流水线。Anthropic 提供“工具使用”流程的文档与 SDK 指南。

- Token/成本效率: 相比 Sonnet 4.5,一些工作流的 token 使用量可减少约 50%,同时工具调用错误更少,复杂工程任务的迭代次数更少。

- 增强的多模态能力: 在视觉、推理与数学性能方面的全面提升。

- 上下文窗口扩展至 200K tokens,支持更深入、更长的对话与复杂文档分析。

实际能力有哪些提升?

性能升级

- 更好的代理与工具编排:在工具选择的准确性、结构化工具调用以及更健壮的工具结果工作流方面改进,有利于构建代理与多步流水线。改进的上下文处理、用于长时代理运行的压缩辅助,以及用于注册与校验工具的一等工具 SDK,使得 Opus 4.5 更适合构建可多步无人值守运行的代理。

- 增强的多模态能力:在视觉、推理与数学性能方面的全面提升。

- 上下文窗口扩展至 200K tokens,支持更深入、更长的对话与复杂文档分析。

编码与长周期工作

Opus 4.5 在编码任务上继续以基准为导向;在长作业(代码迁移、重构、多步调试)中,它减少了迭代次数与工具调用错误。早期报告与 Anthropic 的系统卡指出,在工程基准上的持续性能得到改进,并在工具驱动的流水线中显著提升效率。

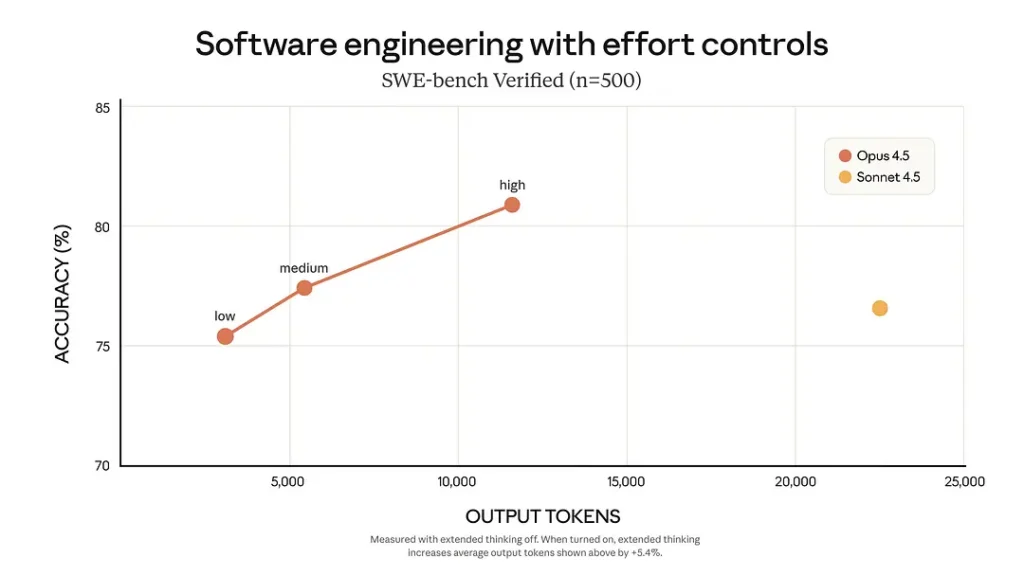

在 SWE-bench 中,Opus 4.5 在软件工程基准上取得领先分数(Anthropic 在发布材料中列出 SWE-bench Verified 为 80.9%),客户反馈在调试、多文件编辑与长周期代码任务上也有提升。

成本与效率

Anthropic 设计 Opus 4.5 以提升推理的深度和代理式行为,同时为开发者提供更好的成本/时延权衡控制:

- 相比 opus 4.1 的降价:每百万 tokens $5(输入)/$25(输出)。

- Token 使用改进:在保持性能的同时,平均消耗降低 50–75%。

- 一个一等公民的 API 旋钮,用于控制 Claude 在请求上投入多少“思考预算”(常见取值

low、medium、high)。它会影响推理、工具调用与内部“思考”tokens,从而让你可以按调用调节速度与严谨度,而无需切换模型。这是 Opus 4.5 的标志性能力(与 Sonnet 4.5 对比:Medium Effort → tokens 降低 76%,性能相当;High Effort → 性能提升约 4.3 个百分点,token 使用减少 48%)。

我如何访问与使用 Claude Opus 4.5 API?

如何获取访问权限与密钥?

- 创建 Anthropic/Claude 开发者账号。 在 Claude/Anthropic 开发者门户注册,并通过控制台创建 API key(团队可使用组织/管理员流程)。Messages API 是面向聊天/助手类交互的主要端点。

- 云合作伙伴: Opus 4.5 也可通过主要云市场获取,如 Google Vertex AI、CometAPI(一个 AI API 聚合平台,需要使用其认证)。在 CometAPI 中,你可以通过 Anthropic Messages 格式与 Chat 格式访问 Claude opus 4.5 API。

我应该如何进行请求认证?

使用标准 Bearer token:在每个 API 调用中包含 Authorization: Bearer $_API_KEY 头。请求以 JSON over HTTPS 进行;Messages API 接受结构化消息列表(system + user + assistant)。

快速开始 — Python(官方 SDK)

安装 SDK:

pip install anthropic

最小示例(同步):

import os

from anthropic import Anthropic

# expects ANTHROPIC_API_KEY in env

client = Anthropic(api_key=os.environ)

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

max_tokens=512,

)

print(resp.content.text) # SDK returns structured content blocks

此调用使用规范的 Opus 4.5 模型标识符。对于由供应商托管的端点(Vertex、CometAPI、Foundry),请按照供应商文档来构建客户端并提供供应商的 URL 与 key(例如 CometAPI 使用 https://api.cometapi.com/v1/messages)。

快速开始 — Python(CometAPI)

你需要登录 CometAPI 并获取密钥。

curl

--location

--request POST 'https://api.cometapi.com/v1/messages' \

--header 'Authorization: Bearer ' \

--header 'Content-Type: application/json' \

--data-raw '{ "model": "claude-opus-4-5-20251101", "max_tokens": 1000, "thinking": { "type": "enabled", "budget_tokens": 1000 }, "messages": }'

我如何使用新的 effort 参数与扩展思考?

什么是 effort 参数,如何设置?

effort 参数是随 Opus 4.5 引入的一等 API 控制项,用于调节模型为生成输出投入的内部计算与 token 预算。典型取值为 low、medium、high。用它在时延与 token 成本和严谨度之间做平衡:

low—— 适合高吞吐自动化与例行任务的快速、节省 token 的回答。medium—— 适合生产使用的质量/成本平衡。high—— 适合深度分析、多步推理或对准确性要求更高的场景。

Anthropic 在 Opus 4.5(beta)中引入了 effort。你需要包含一个 beta 头(例如 effort-2025-11-24),并指定 output_config: { "effort": "low|medium|high" }(示例如下)。默认行为为 high。降低 effort 能减少 token 使用与时延,但可能会略微降低严谨度。适用于高吞吐或对时延敏感的任务。

示例:

# Example using the beta messages API shown in Anthropic docs

from anthropic import Anthropic

import os

client = Anthropic(api_key=os.getenv("ANTHROPIC_API_KEY"))

response = client.beta.messages.create(

model="claude-opus-4-5-20251101",

betas=, # required beta header

messages=,

max_tokens=1500,

output_config={"effort": "medium"} # low | medium | high

)

print(response)

何时用哪种: low 适用于自动化流水线(如邮件分类),medium 适用于标准助手,high 适用于代码生成、深度研究或高风险/高准确性任务。Anthropic 将此参数作为 Opus 4.5 的关键控制项加以强调。

在 SWE-bench 测试中:

- Medium Effort 模式:性能可与 Sonnet 4.5 相当,但输出 tokens 降低 76%;

- High Effort 模式:性能较 Sonnet 4.5 提升约 4.3 个百分点,同时 token 使用减少 48%。

什么是 Extended Thinking,我该如何调用?

Extended Thinking(也称为“extended thinking”或“thinking blocks”)允许模型在需要时执行中间的思维链或分步推理,并可选择性地保留或总结这些内部思考块。Messages API 支持此行为,Anthropic 还新增了控制项以保留先前的思考块,使多轮代理能够复用早前的推理而无需重复昂贵的再计算。当任务需要多步规划、长周期问题求解或工具编排时,使用 Extended Thinking。

我如何集成工具并用 Opus 4.5 构建代理?

Opus 4.5 的一大强项是改进的工具使用:在客户端定义工具,让 Claude 决定何时调用,执行该工具并返回 tool_result——Claude 会在最终回复中使用这些结果。Anthropic 提供 Agent SDK,可注册带类型的工具函数(例如 run_shell、call_api、search_docs),以便 Claude 在扩展思考期间发现并调用。平台会将工具定义转换为可调用函数,模型可以调用并接收结果。通过这种方式,你可以安全地构建代理式工作流(对输入/输出进行可控管理)。

下面是一个实用模式与端到端 Python 示例。

工具使用模式(概念)

- 客户端提供

tools元数据,包含名称、描述与 JSON 模式(input_schema)。 - 模型返回

tool_use块(模型发出的结构化指令,说明以何种输入调用哪个工具)。API 响应的stop_reason可能为tool_use。 - 客户端执行工具(你的代码调用外部 API 或本地函数)。

- 客户端发送后续消息,使用

role:"user",并带上tool_result内容块,包含工具的输出。 - 模型消费工具结果,并返回最终答案或进一步的工具调用。

该流程允许在客户端安全地控制模型要执行的内容(模型只“提议”工具调用;你掌握执行权限)。

端到端示例 — Python(简易天气工具)

# 1) Define tools metadata and send initial request

from anthropic import Anthropic

import os, json

client = Anthropic(api_key=os.environ)

tools = [

{

"name": "get_weather",

"description": "Return the current weather for a given city.",

"input_schema": {"type":"object","properties":{"city":{"type":"string"}},"required":}

}

]

resp = client.messages.create(

model="claude-opus-4-5-20251101",

messages=,

tools=tools,

max_tokens=800,

)

# 2) Check if Claude wants a tool call

stop_reason = resp.stop_reason # SDK field

if stop_reason == "tool_use":

# Extract the tool call (format varies by SDK; this is schematic)

tool_call = resp.tool_calls # e.g., {"name":"get_weather", "input":{"city":"Tokyo"}}

tool_name = tool_call

tool_input = tool_call

# 3) Execute the tool client-side (here: stub)

def get_weather(city):

# Replace this stub with a real weather API call

return {"temp_c": 12, "condition": "Partly cloudy"}

tool_result = get_weather(tool_input)

# 4) Send tool_result back to Claude

follow_up = client.messages.create(

model="claude-opus-4-5-20251101",

messages=[

{"role":"user", "content":[{"type":"tool_result",

"tool_use_id": resp.tool_use_id,

"content": json.dumps(tool_result)}]}

],

max_tokens=512,

)

print(follow_up.content.text)

else:

print(resp.content.text)

如何为可靠性构建代理?

- 清理工具输入(避免通过提示注入)。

- 在回传给模型前校验工具输出(进行模式检查)。

- 限制工具权限范围(最小权限原则)。

- 使用 compaction helpers(来自 Anthropic SDK),在长时间运行中保持可控上下文。

我该如何为 Opus 4.5 设计提示与组织消息?

哪些消息角色与预填策略最有效?

采用三段式模式:

- System(role: system):全局指令——语气、边界、角色。

- Assistant(可选):示例或预设内容。

- User(role: user):当前请求。

在 system 消息中预填约束(格式、长度、安全策略、若需结构化输出则提供 JSON 模式)。对于代理,包含工具规格与使用示例,以便 Opus 4.5 正确调用这些工具。

如何通过上下文压缩与提示缓存来节省 tokens?

- 上下文压缩(context compaction): 将较早的对话内容压缩为简洁摘要,模型仍可使用。Opus 4.5 支持自动化压缩上下文,同时尽量保留关键推理块。

- 提示缓存(prompt caching): 对重复提示缓存模型响应(Anthropic 提供提示缓存模式以降低时延/成本)。

这两项功能可降低长对话的 token 占用,推荐用于长时间运行的代理工作流与生产级助手。

错误处理与最佳实践

以下是将 Opus 4.5 集成到生产时的可靠性与安全性建议。

可靠性与重试

- 处理限流(HTTP 429),使用指数退避与抖动(起始 500–1000ms)。

- 幂等性: 对不产生副作用的 LLM 调用可安全重试;但在模型可能触发外部副作用(工具调用)的工作流中需谨慎——通过跟踪

tool_use_id或你自有的请求 ID 去重。 - 流式稳定性: 处理部分流与优雅重连;若中断发生,优先重试整个请求,或利用应用层状态恢复,以避免不一致的工具交互。

安全与合规

- 提示注入与工具安全: 切勿允许模型直接执行未校验的任意 shell 命令或代码。始终验证工具输入并清理输出。模型提出工具调用;你的代码决定是否执行。Anthropic 的系统卡与文档描述了对齐约束与安全级别——在高风险领域中务必遵守。

- 数据处理与合规: 将包含 PII 或受监管数据的提示与工具输入/输出依据你的法律/合规政策处理。若有严格的数据驻留或审计要求,可使用供应商的 VPC/企业级控制(Bedrock/Vertex/Foundry 提供企业选项)。

可观测性与成本控制

- 记录请求/响应元数据(除非允许,否则不要记录敏感原始内容)——包括 token 计数、

effort级别、时延、模型 ID 与提供方。这些指标对成本归因与调试至关重要。 - 用 effort 控制单次调用成本: 例行摘要或高 QPS 端点优先使用

low;深度调试或调查使用high。监控质量与 token 消耗,以为不同端点选择默认值。

结论——何时(以及如何)选择 Opus 4.5?

当你的产品需要:

- 深度多步推理(长逻辑链、研究或调试),

- 强健的代理/工具编排(调用外部 API 的复杂工作流),或

- 面向大型代码库的生产级代码辅助,

Claude Opus 4.5 是自然之选。操作层面,使用 effort 为每次调用调节预算;依赖工具使用模式保持执行安全,并根据合规需求选择云合作伙伴(或直接使用 Anthropic API)。用你的业务语料进行基准评估:厂商基准(如 SWE-bench)是有用信号,但真实任务与数据决定 ROI。出于安全考虑,请遵循 Opus 4.5 的系统卡,并对工具执行与 PII 处理设置防护措施。

开发者可以通过 CometAPI 访问 Claude Opus 4.5 API。开始之前,可在 Playground 探索 CometAPI 的模型能力,并查阅 API 指南获取详细说明。访问前,请确保你已登录 CometAPI 并获取 API key。CometAPI 提供远低于官方的价格,帮助你集成。

准备好了吗?→ 立即注册 CometAPI!