LobeChat 和 CometAPI 是开放 AI 生态中的两个发展迅速的项目。在 2025 年 9 月,LobeChat 合并了对 CometAPI 提供商的完整集成,使得在 LobeChat 中直接调用 CometAPI 的统一、与 OpenAI 兼容的端点变得十分简单。本文解释 LobeChat 和 CometAPI 是什么、为什么要将它们集成、分步的集成与配置(包括一份可直接使用的 TypeScript 提供商基础配置)、运行时示例、具体用例,以及有关成本、可靠性与可观测性的生产实践建议。

什么是 LobeChat,它提供了哪些特性?

LobeChat 是一个开源的现代聊天框架,旨在承载多提供商 LLM 聊天应用,具备精致的 UI 与部署工具链。它支持多模态输入(文本、图像、音频)、知识库 / RAG 工作流、分支对话和“思维链”可视化,并提供可扩展的提供商/插件系统,让你无需重构应用即可替换不同的模型后端。LobeChat 的文档与仓库将其定位为适用于自托管与云部署的生产就绪框架,支持基于环境的配置,并设有第三方 MCP(模型控制平面)集成的市场。

LobeChat 重点能力速览

- 多提供商支持(OpenAI、Anthropic、Google Gemini、Ollama 等)。

- 文件上传 + 知识库用于 RAG 工作流(文档、PDF、音频)。

- 通过环境变量和 settings-URL 导入进行对开发者友好的配置。

- 可扩展运行时:通过小型适配器运行时配置提供商,使新后端可插拔。

什么是 CometAPI?

CometAPI 是统一的 AI 访问层,通过单一、与 OpenAI 兼容的 API 接口面,暴露来自众多底层提供商的 500+ 模型。它旨在让开发者可基于性能、成本或能力选择模型端点而不被锁定,同时集中计费、路由与访问管理。CometAPI 提供统一的聊天/补全端点,以及用于发现可用模型 ID 的模型列表 API。

为什么 CometAPI 对团队有吸引力

- 模型选择与可移植性:在众多前沿模型之间切换,而无需显著更改集成代码。

- 与 OpenAI 兼容的端点:许多期望 OpenAI 风格 HTTP 端点的客户端库和框架,可以通过更改基础 URL + 认证来使用 CometAPI。(实践示例展示

https://api.cometapi.com/v1/作为与 OpenAI 兼容的接口面。) - 开发者文档与集成:CometAPI 发布集成 LlamaIndex 等工具以及其他低代码平台的文档与分步指南。

为什么要在 LobeChat 中集成 CometAPI?

简短回答:灵活性、成本控制以及对新模型的快速获取。LobeChat 天生与提供商无关;接入 CometAPI 可让你的 LobeChat 部署通过同一代码路径调用许多不同的模型——可根据吞吐、时延、成本或能力随时切换模型,而无需更改 UI 或提示流程。此外,社区与维护者已积极为 LobeChat 增加 CometAPI 提供商支持,使集成更顺畅。

业务与技术收益

- 模型多样性而无需代码频繁改动。需要评估 Gemini、Claude 或小众图像模型?CometAPI 可以通过单一 API 暴露这些模型 ID,从而减少在 LobeChat 中按提供商做管线对接的工作量。

- 成本优化。CometAPI 允许你路由到更便宜的模型或动态选择低成本提供商,这可显著降低高并发部署的每次对话成本。

- 更简单的密钥管理。在 LobeChat 的设置或 Docker 环境中只需管理一个 API Key,而不是多个提供商密钥。LobeChat 平台已支持通过

ENABLED_<PROVIDER>及提供商密钥环境变量模式启用提供商,因此集成在运维上保持一致。 - 保持 LobeChat 代码库精简:提供商逻辑被封装,并通过环境变量进行配置。

如何在 LobeChat 中设置并集成 CometAPI?

本节提供可执行的分步方案:获取密钥、设置环境变量、将提供商添加到 LobeChat(示例提供商配置),并展示运行时用法(聊天调用)。示例遵循 LobeChat 的提供商模式与 CometAPI 与 OpenAI 兼容的端点。

1) 获取 CometAPI 账号与 API Key

在 CometAPI 注册并打开 API 控制台。注册 CometAPI 账号需要使用邮箱地址或直接使用 Google 一键登录。

完成注册后,进入 playground,点击“add new secret key”创建新的 API Key:

获取 API Key。

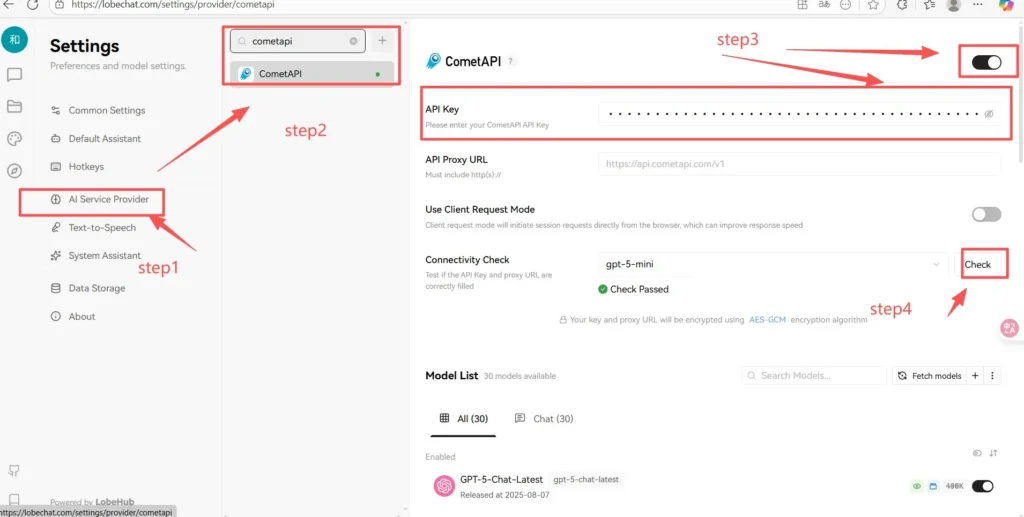

2) 在 LobeChat 中配置 CometAPI

- 进入 Lobe-Chat 设置菜单,点击头像,点击应用设置选项。

- 选择 cometapi 作为模型提供商。

- 将来自 cometapi 的 sk-xxxxx 粘贴到 API Key 输入框并打开开关按钮,选择一个模型进行检查。

3) 测试调用

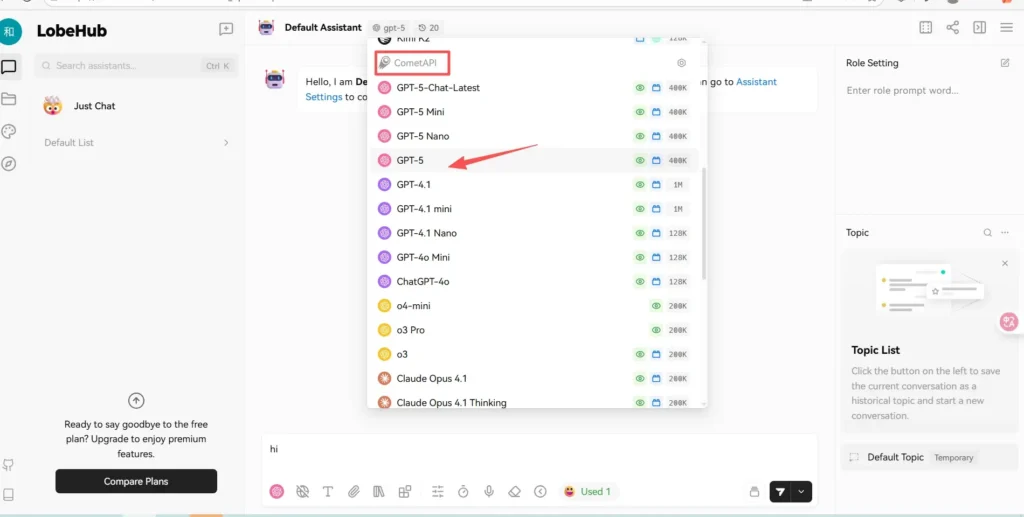

选择 CometAPI 的某个模型进行检查,在 Lobe-Chat 中输入一个简单测试命令。若调用成功,你将收到对应的回答;若失败,请检查配置是否正确或联系 cometapi 在线客服。

目前,cometapi 在 lobechat 上提供来自主要开发者的 30 多个最新模型(openAI、grok、claude、gemini)。

如何扩展集成(高级增强)?

想要超越基础用法?以下是将你的集成从可用提升到生产级的扎实下一步。

增强 1:动态模型编排(多模型代理)

在 LobeChat 中创建代理逻辑,动态将子任务分派给不同的 Comet 模型(例如:小型嵌入模型用于检索、中等模型用于起草、高能力模型用于总结)。使用 LobeChat 的函数调用/插件系统来协调工作流并汇总最终响应。

增强 2:缓存嵌入与响应

在使用嵌入(用于 RAG)时,计算一次并缓存以减少开销。如果你调用 CometAPI 进行嵌入,请将向量表示存储在向量数据库中,仅在内容变化时重新计算。这可以减少 token 使用与成本。

增强 3:按租户的配置与配额

如果你运行多租户的 LobeChat 实例,可通过编写中间件将租户 ID → 允许的模型列表(使用 CometAPI 模型 ID)进行映射,从而控制每个租户的限制(请求/小时、模型档位)。这有助于提供访问更高阶模型的高级付费档。

增强 4:使用模型元数据与健康检查

实现提供商健康检查,调用轻量级的 CometAPI “model ping”或最小化的聊天调用以确保时延符合 SLA;否则优雅地回退到候选模型。保持心跳监控,并在 LobeChat 管理 UI 中展示提供商状态。

应避免哪些陷阱?

- API Key 泄露:切勿在客户端代码中存储 CometAPI 密钥。始终将其保留在服务端(LobeChat 的服务层)。

- 模型名称漂移:CometAPI 可能新增或废弃模型 ID。维护服务端映射,并在需要暴露新模型时更新 COMETAPI_MODEL_LIST。

- 响应格式差异:尽管 CometAPI 致力于与 OpenAI 兼容,某些模型或元字段可能存在差异;在呈现给用户前务必进行映射与清洗。

入门

CometAPI 是一个统一的 API 平台,将来自领先提供商的 500+ AI 模型——例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——聚合到单一、对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 显著简化了将 AI 能力集成到你的应用中的过程。无论你是在构建聊天机器人、图像生成器、音乐创作工具,还是数据驱动的分析管线,CometAPI 都能让你更快迭代、控制成本并保持供应商无关性,同时利用 AI 生态中的最新突破。

首先,在Playground中探索模型能力,并查阅API 指南获取详细说明。在访问前,请确保你已登录 CometAPI 并获得 API Key。CometAPI提供远低于官方价格的方案,以帮助你完成集成。

Ready to Go?→ 立即注册 CometAPI!

结论

在 LobeChat 中集成 CometAPI,是在保留 LobeChat 提供的精致用户体验与 RAG 功能的同时,获得模型多样性、成本灵活性与快速试验能力的务实方式。LobeChat 社区已大幅推进 CometAPI 支持(提供商卡片、模型列表、运行时适配器、测试与文档),你可以直接利用这些成果,或将其作为灵感来实现满足特殊需求的自定义适配器。有关最准确的集成步骤与最新示例,请查阅 CometAPI 文档以及 LobeChat model-provider 文档 与仓库——下方引用的链接将帮助你继续。