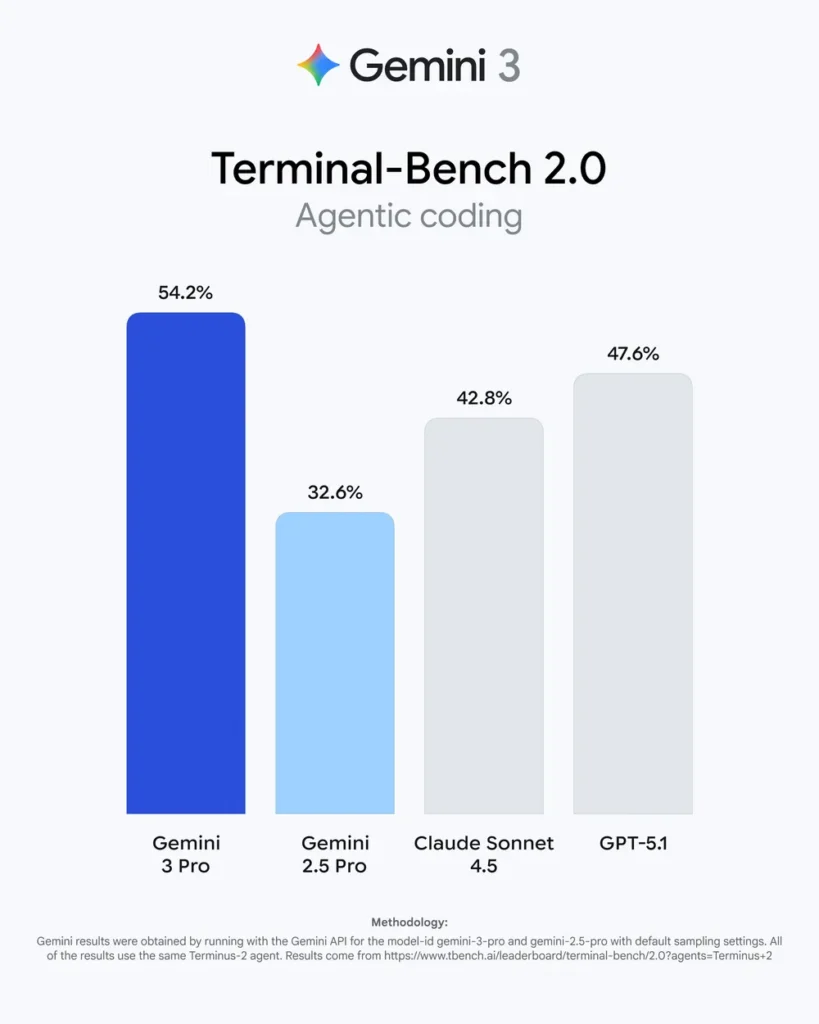

Google 刚刚通过发布预览版的 Gemini 3 Pro 拉开了 Gemini 3 时代的序幕,最初信号非常明确:在多模态推理、编码智能体以及长上下文理解上迈出了重大一步。该模型被定位为迄今为止 Google 最强的推理与多模态模型,针对智能体工作流、编码、长上下文任务和多模态理解进行了优化。它提供全新的“Deep Think”推理模式,在智能体/代码基准上有显著提升(Terminal-Bench 2.0 报告为 54.2%),并可立即通过 Google AI Studio、API(Vertex AI 集成)以及 Google Antigravity 等开发者工具使用。

什么是 Gemini 3 Pro 预览版?

Google 将 Gemini 3 描述为 Gemini 系列的下一代、最智能成员——专注于更深入的推理、更丰富的多模态理解(文本、图像、视频、音频、代码),以及更强的智能体行为(能用工具进行规划与行动的模型)。

重点功能

- 原生多模态理解 —— 能同时接收并推理文本、图像、音频与视频(包括长/视频输入)。非常适合混合文档、截图、转录与视频的场景。

- 超大上下文窗口(高达约 1,000,000 tokens)—— 可在单次会话中摄取/保持极长的文档、大型代码库,或数小时转录。这是用于深度研究、代码审查与多文档综合的核心卖点。

- 智能体/工具使用能力 —— 专为驱动可调用工具、操作终端、管理任务计划并协调多步工作流的自主智能体而设计(用于 Google Antigravity 等 IDE 集成)。这使其在编码、编排与多步自动化方面尤为强大。

- 更强的推理与编码 —— Google 将 Gemini 3 Pro 定位为其在复杂推理、数学与代码任务上的顶级“思考”模型(基准与终端/工具表现提升)。

相比 Gemini 2.5 Pro 等版本,Gemini 3 Pro 有哪些新变化?

哪些能力提升最大?

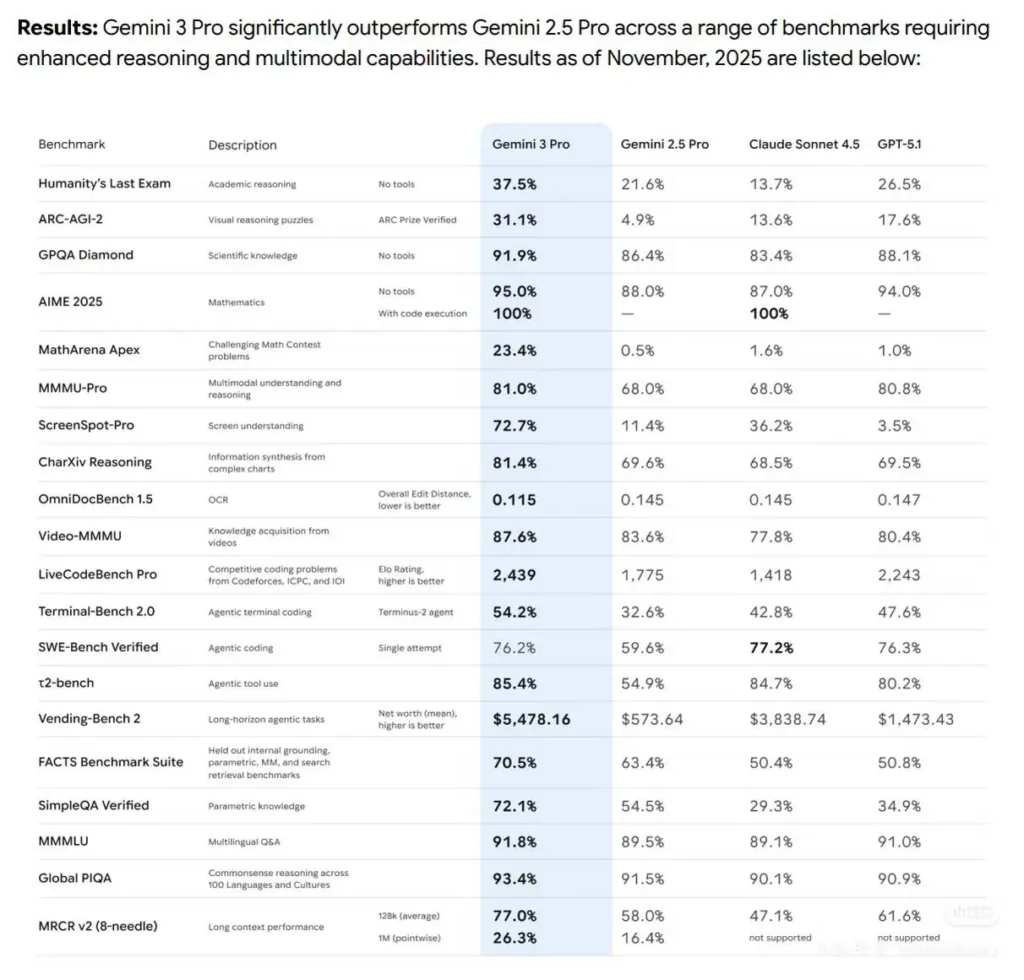

Gemini 3 Pro 被宣传为在推理(数学与科学推理)、多模态空间/视觉推理与工具使用上实现了重大飞跃。Google 强调其在基准套件与真实世界的智能体任务(如编码与终端自动化)中对比 Gemini 2.5 Pro 有明显优势。团队给出的部分核心指标包括:

| Benchmark / task | Gemini 3 Pro (reported) | Gemini 2.5 Pro (reported) | Absolute gap (pp) |

|---|---|---|---|

| Humanity’s Last Exam (academic reasoning, no tools) | 37.5% | 21.6% | +15.9. |

| GPQA Diamond (scientific / factual QA) | 91.9% | 86.4% | +5.5. |

| AIME 2025 (mathematics, no tools) | 95.0% | 88.0% | +7.0. |

| AIME with code execution | 100.0% | (2.5 Pro: — ) | — (3 Pro 在启用执行时拿到满分)。 |

| ARC-AGI-2 (visual reasoning puzzles) | 31.1% | 4.9% | +26.2 — 多模态大幅提升。 |

| SimpleQA Verified (parametric knowledge) | 72.1% | 54.5% | +17.6. |

这些数据表明,Gemini 3 Pro 针对多步推理、复杂工具使用以及高度集成的多模态任务(例如结合视频帧、图表推理与代码生成)进行了优化。

面向智能体优先的开发者工具:Antigravity

为展示智能体工作流,Google 发布了 Antigravity —— 一个以“智能体优先”为理念的 IDE,使用 Gemini 3 Pro 作为多智能体编码工作流的基础。Antigravity 让智能体可以直接与编辑器、终端和浏览器交互,并生成 “Artifacts”(任务列表、截图、浏览记录)来记录智能体动作,以解决智能体开发中的可追溯性与可复现性。这使得 Gemini 3 Pro 在真实开发者工作流中更为实用,而不仅仅是专注文本生成的模型。

更好的工具使用与编码

Google 报告在以终端为中心的基准(Terminal-Bench 2.0)上有显著提升,该基准衡量模型通过终端操作计算机的能力:Gemini 3 Pro 在该测试中获得 54.2%——相较于之前的 Gemini 版本有大幅跃升,显示出在自主工具使用与代码生成方面的真实进步。

尤其是在被要求运行脚本、编排工具或管理多步开发者任务时表现更稳健。在实践中,这意味着模型执行命令时的幻觉更少、错误处理更好,并且从失败步骤中恢复的能力更强。

Gemini 3 Pro 在各类基准上的表现如何

Google 在 Gemini 3 的博文中发布了涵盖经典 NLP 推理、多模态理解、代码生成与智能体工具使用的广泛基准对比。Google 直接报告的关键数据包括:

- LMArena:Gemini 3 Pro 获得 1501 Elo,在竞争激烈的榜单上名列前茅(以成对对抗评测一般推理/答案质量)。

- MMMU-Pro(多模态基准):81% —— 相较先前模型有可观提升。

- Video-MMMU:在面向视频的多模态任务上取得 87.6%。

- SimpleQA Verified:72.1%,在复杂输入的事实问答方面有改进。

- WebDev Arena:1487 Elo(网页开发/代码推理)。

- Terminal-Bench 2.0 与 SWE-bench Verified:在智能体工具使用与编码智能体性能方面大幅提升。

- Deep Think:在最高难度测试上的成绩进一步提升(例如部分指标中,Humanity’s Last Exam 在 Deep Think 下从 37.5% 提升到 41.0%,据报道)。

所有迹象都表明,该模型倾向于深度能力,而不仅仅是表层文本生成。

所以:是的,Gemini 3 Pro 当前在许多测试中持续处于上游水平——但“全面碾压”取决于具体任务。对于纯代码生成,一些竞争对手依旧不相上下;而在长上下文、数学与多模态综合方面,Gemini 3 Pro 在 2025 年 11 月上旬的测试中经常被报道为同类最佳。

如何获取 Gemini 3 Pro 预览版?

官方入口

Google 已在多个界面提供了 Gemini 3 Pro 的预览版:

- Gemini 应用(消费者/Pro 用户):该模型作为“Gemini 3”时代的一部分陆续在 Gemini 应用中上线。

- Google AI Studio / Gemini Developer API:开发者可通过 AI Studio 与 Gemini Developer API 进行试验。API 提供 REST 与 SDK 接口,并支持函数调用与流式等高级特性。

- Vertex AI(Google Cloud):企业与团队可通过 Vertex AI 在生产与 MLOps 工作流中使用 Gemini 3 Pro。Vertex 提供 Python、Node、Java、Go 与 curl 示例。

- 第三方集成 (CometAPI):CometAPI 提供对 Gemini 3 Pro API 的访问,调用名为 gemini-3-pro-preview。CometAPI 提供远低于官方价格的方案,帮助你完成集成。

快速入门:Python 示例(官方 SDK 模式)

下面是一个基于 Google Gemini 快速入门改编的最小可用 Python 示例,展示如何通过 Google 的 GenAI 客户端调用 Gemini API。将从 Google AI Studio 或你的 GCP 项目获取的 API Key 替换为 GEMINI_API_KEY。

# 示例:使用 Google GenAI Python SDK 调用 Gemini 3 Pro 预览版

# 需要:pip install google-generativeai

import os

from google import genai

# 在环境中设置 API key:

# export GEMINI_API_KEY="YOUR_API_KEY"

client = genai.Client() # 客户端会从环境变量中获取 GEMINI_API_KEY

# 使用预览版模型标识。确切的模型 ID 可能变化;请以 API 文档为准。

model_id = "gemini-3-pro-preview" # 或 "gemini-3-pro",取决于可用性

prompt = """

你是一名助手,需要编写一个简短的 Python 函数:从 URL 获取 JSON,处理 HTTP 错误,并在失败时返回 None,否则返回解析后的 JSON。

"""

resp = client.models.generate_content(model=model_id, contents=prompt)

print("模型响应:\n", resp.text)

如果你选择 CometAPI,请将 url 替换为 https://api.cometapi.com/v1/chat/completions,并将 key 替换为你从 CometAPI 获取的密钥。

如何获得更佳效果——提示模式与技巧

在困难问题上使用“思考”模式

如果你在解决递进式推理或复杂的数学/代码任务,请启用预览版的“思考”(thinking)变体(如可用)——它会分配更多内部推理步骤,通常能在多阶段任务上提供更可靠的解法。请在控制台中查看模型名是否带有 -thinking 后缀。

函数调用与工具编排

使用声明式函数(Vertex AI/GenAI 函数调用)来获得可靠、结构化的输出,并降低幻觉。让模型提出函数调用,并在你的环境中以确定性方式执行。函数调用文档包含返回类型化 JSON 参数并可安全运行的示例。

需要最新事实时进行检索支撑(grounding)

如果你的应用依赖最新的网页事实,可使用网页检索支撑,但需注意检索型提示的成本与速率限制。Grounding 很强大——它允许 Gemini 查询 Search 或 Maps——但每次检索都可能改变计费与时延特性。

Gemini 3 Pro 在真实任务中的表现(用例)

代码生成与开发者效率

Gemini 3 Pro 改进了多文件推理、长仓库上下文处理,以及在生成代码的同时综合测试/文档。与函数调用和终端智能体配合时,它能比旧模型更快地搭建并验证中等规模项目。社区测试显示 LiveCodeBench/Elo 等编码评分有所提升。

研究与 STEM 工作流

“Deep Think” 能力与更大的推理预算使其非常适合需要多步数学推导、数据集综合或多文件论文综述的研究任务。早期基准结果显示它在许多 STEM 数据集上位列前茅或接近顶尖。

内容设计与多模态创作工作流

Gemini 3 Pro 的多模态输出与对 Veo/Whisk/Flow 的集成,使其在混合文本、图像与视频的工作流中表现出色——从营销脚本到自动化视频草案。Google 在 AI Ultra 中为创作者捆绑了某些创作工具,以提供更高限额。

结论:Gemini 3 Pro 是否碾压其他模型?

Gemini 3 Pro 预览版是一次重大飞跃。在广泛的基准与早期真实测试中,它在以下方面经常处于领先或并列领先:

- 复杂推理(数学/STEM)

- 多模态理解与综合

- 智能体工作流与函数调用

不过,优势幅度因任务而异。对于某些范围狭窄的任务(特定创作风格或高度专业化领域知识),其他竞争模型仍可能具备竞争力,且需综合成本/时延与生态适配来选择。各类基准与部分泄露分数显示 Gemini 3 Pro 常居第一梯队,但“碾压”取决于任务本身——对于许多企业与开发者用例,Gemini 3 Pro 现已成为首选评估对象。

如何开始使用 CometAPI

CometAPI 是一个统一的 API 平台,将来自主流提供商的 500+ AI 模型(如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)聚合到一个对开发者友好的接口中。通过提供一致的认证、请求格式与响应处理,CometAPI 大幅简化了在应用中集成 AI 能力的流程。无论你在构建聊天机器人、图像生成器、音乐合成器,还是数据驱动的分析流水线,CometAPI 都能帮助你更快迭代、控制成本并保持供应商中立,同时获取 AI 生态中的最新突破。

开发者可通过 CometAPI 访问 Gemini 3 Pro Preview API。开始之前,请在 Playground 中探索 ofCometAPI 的模型能力,并查阅 API 指南以获取详细说明。访问前,请确保你已登录 CometAPI 并获得 API Key。CometAPI 提供远低于官方价格的方案,帮助你完成集成。

准备好开始了吗?→ 立即注册 CometAPI