Llama 4 API 是一个功能强大的接口,允许开发者集成 Meta 最新的多模态大型语言模型,在各类应用中实现先进的文本、图像和视频处理能力。

Llama 4 系列概览

Meta 的 Llama 4 系列引入了前沿的 AI 模型,能够处理与转换多种数据格式,包括文本、视频、图像和音频,从而提升在各类应用中的通用性。该系列包括:

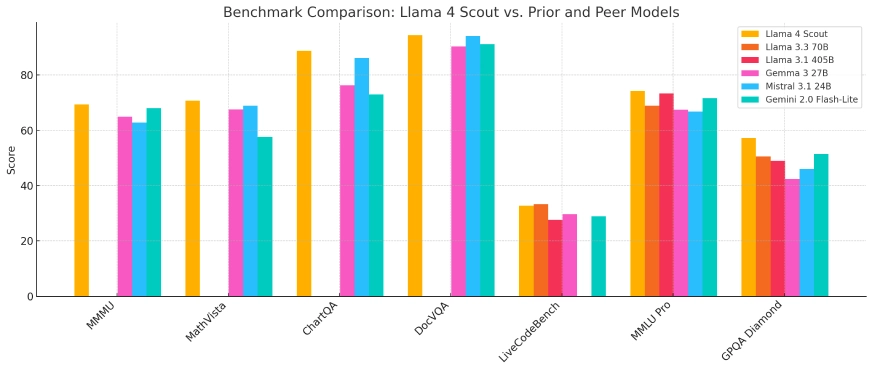

- Llama 4 Scout:一款可在单台 Nvidia H100 GPU 上部署的紧凑模型,具备 10-million-token 上下文窗口。在多项基准测试中优于 Google 的 Gemma 3 和 Mistral 3.1 等竞争对手。

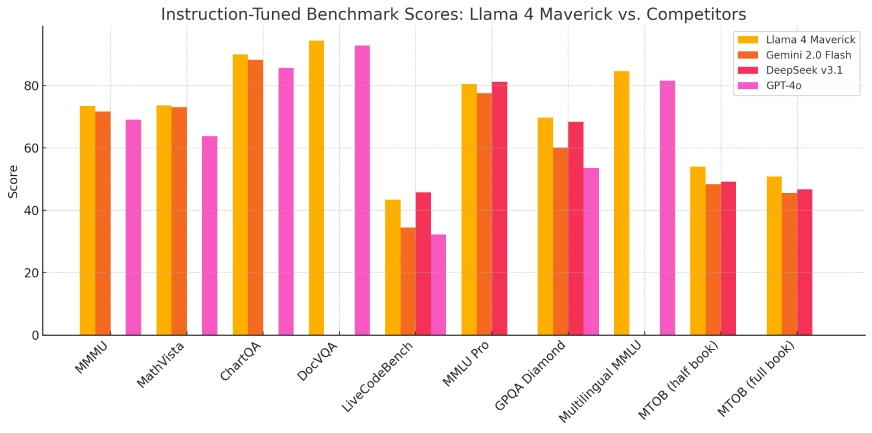

- Llama 4 Maverick:较大的模型,在编码与推理任务上的表现可与 OpenAI 的 GPT-4o 和 DeepSeek-V3 相当,同时使用更少的活动参数。

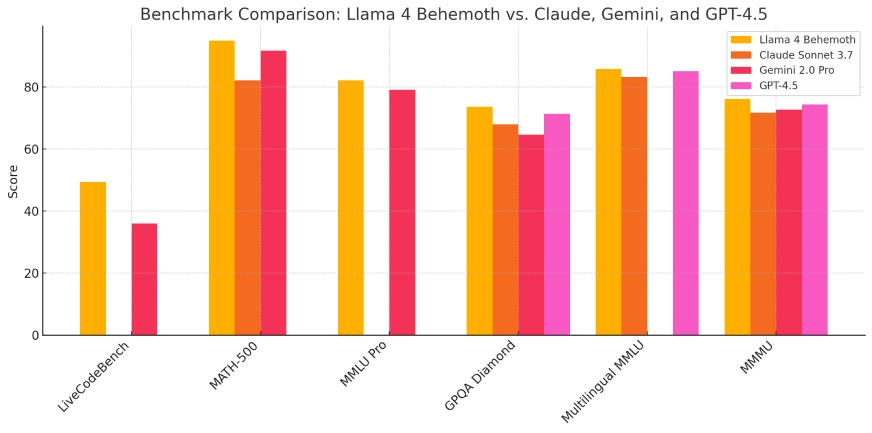

- Llama 4 Behemoth:目前仍在开发中,拥有 288 billion 个活动参数,总计 2 trillion,旨在在 STEM 基准上超越 GPT-4.5 和 Claude Sonnet 3.7 等模型。

这些模型已集成到 Meta 的 AI 助手中,覆盖 WhatsApp、Messenger、Instagram 以及 Web 等平台,以先进的 AI 能力增强用户交互体验。

| Model | Total Parameters | Active Parameters | Experts | Context Length | Runs On | Public Access | Ideal For |

|---|---|---|---|---|---|---|---|

| Scout | 109B | 17B | 16 | 10M tokens | Single Nvidia H100 | ✅ 是 | 轻量级 AI 任务、长上下文应用 |

| Maverick | 400B | 17B | 128 | 未指定 | 单卡或多卡 GPU | ✅ 是 | 科研、企业应用、编程 |

| Behemoth | ~2T | 288B | 16 | 未指定 | Meta 内部基础设施 | ❌ 否 | 内部模型训练与基准测试 |

技术架构与创新

Llama 4 系列采用“混合专家(MoE)”架构,这是一种创新方法,通过在特定任务中仅激活与之相关的模型参数子集来优化资源利用率。该设计提升了计算效率与性能,使模型能够更有效地处理复杂任务。

训练这些模型需要大量计算资源。Meta 使用了由 over 100,000 块 Nvidia H100 组成的 GPU 集群,这是迄今为止规模最大的 AI 训练基础设施之一。如此庞大的计算能力促进了具备更强能力与性能指标的模型的研发。

模型演进

基于早期版本的基础,Llama 4 系列代表了 Meta 在 AI 模型研发方面的重要进化。多模态处理能力的集成与 MoE 架构的采用,解决了先前模型在推理与数学任务等方面的局限。上述进步使 Llama 4 成为 AI 领域中强有力的竞争者。

基准表现与技术指标

在基准评测中,Llama 4 Scout 尤其在需要大规模上下文处理的任务上,展现出优于 Google 的 Gemma 3 和 Mistral 3.1 的表现。Llama 4 Maverick 的能力与 OpenAI 的 GPT-4o 等领先模型相当,特别是在编码与推理任务上,同时保持更高的参数利用效率。这些结果凸显了 MoE 架构以及大规模训练流程的有效性。

Llama 4 Scout

Llama 4 Maverick

Llama 4 Behemoth:

应用场景

Llama 4 系列的多样性使其能够应用于多个领域:

- 社交媒体集成:在 WhatsApp、Messenger 和 Instagram 等平台上,以先进的 AI 驱动功能提升用户互动体验,包括更优的内容推荐与对话式智能体。

- 内容创作:协助创作者生成高质量的多模态内容,通过处理与综合文本、图像和视频来简化创作流程。

- 教育工具:助力开发能够理解并响应多种数据格式的智能辅导系统,提供更沉浸的学习体验。

- 商业分析:帮助企业分析与解读复杂数据集,包括文本与视觉信息,从而提炼可行洞察,支持决策制定。

将 Llama 4 模型集成到 Meta 的平台,充分体现了其在多样化应用中提升用户体验的实用性与潜力。

伦理考量与开源策略

尽管 Meta 将 Llama 4 系列宣传为开源,但其许可条款对拥有超过 700 million 用户的商业实体设有限制。此举引发了 Open Source Initiative 的批评,这也凸显了在 AI 发展中如何平衡开放获取与商业利益的持续争论。

据报道,Meta 在 AI 基础设施上的投入高达 $65 billion,体现了其在提升 AI 能力、在快速演进的 AI 竞争中保持领先的坚定承诺。

结论

Meta 推出的 Llama 4 系列标志着人工智能的一次关键进步,展现了在多模态处理、效率与性能方面的显著提升。通过创新的架构设计与巨大的算力投入,这些模型为 AI 能力树立了新的标杆。随着 Meta 持续将这些模型集成至其平台并探索进一步发展,Llama 4 系列有望在塑造未来 AI 应用与服务的演进路径上发挥重要作用。

如何通过 CometAPI 调用 Llama 4 API

1.登录 cometapi.com。如果您还不是我们的用户,请先注册。

2.获取接口的访问凭证 API key。在个人中心的 API token 处点击“Add Token”,获取 token key:sk-xxxxx 并提交。

-

获取本站点的 url:https://api.cometapi.com/

-

选择 Llama 4(模型名:llama-4-maverick;llama-4-scout)的 endpoint 发送 API 请求并设置请求体。请求方法与请求体可从我们的官网 API 文档获取。我们的网站也提供 Apifox 测试,方便您调试。

- 关于 Comet API 中模型上线信息,请参见 https://api.cometapi.com/new-model。

- 关于 Comet API 的模型价格信息,请参见 https://api.cometapi.com/pricing

| 类别 | llama-4-maverick | llama-4-scout |

| API 定价 | 输入 tokens: $0.48 / M tokens | 输入 tokens: $0.216 / M tokens |

| 输出 tokens: $1.44/ M tokens | 输出 tokens: $1.152/ M tokens |

- 处理 API 响应以获取生成的答案。发送 API 请求后,您将收到一个包含生成结果的 JSON 对象。