什么是 GPT-5.2 API

GPT-5.2 API 与 ChatGPT 中的 GPT-5.2 Thinking 相同。GPT-5.2 Thinking 是 OpenAI GPT-5.2 系列中的中档版本,专为更深度的工作而设计:多步推理、长文档摘要、高质量代码生成,以及对准确性和可用结构要求高于原始吞吐量的专业知识工作。在 API 中,它以模型 gpt-5.2(Responses API / Chat Completions)的形式提供,定位介于低延迟的 Instant 版本与质量更高但价格更贵的 Pro 版本之间。

主要特性

- 超长上下文与压缩: 400K 有效窗口,以及用于在长对话和长文档中管理相关性的压缩工具。

- 可配置的推理强度:

none | medium | high | xhigh(xhigh为高难度推理启用最大内部算力)。xhigh对 Thinking/Pro 版本开放。 - 更强的工具与函数支持: 一流的工具调用、用于约束结构化输出的语法(CFG/Lark),以及更完善的代理式行为,简化复杂的多步自动化。

- 多模态理解: 更丰富的图像 + 文本理解能力,并可集成到多步任务中。

- 改进的安全性 / 敏感内容处理: 通过有针对性的干预,减少在自伤等敏感场景中的不良响应。

技术能力与规格(开发者视角)

- API 端点与模型 ID:

gpt-5.2用于 Thinking(Responses API),gpt-5.2-chat-latest用于聊天/即时工作流,gpt-5.2-pro用于 Pro 层级;可按说明通过 Responses API 和 Chat Completions 使用。 - 推理 token 与强度管理: API 支持显式参数,可按请求分配算力(推理强度);更高的强度会增加延迟和成本,但能提升复杂任务的输出质量。

- 结构化输出工具: 支持语法(Lark / CFG)以将模型输出约束为 DSL 或精确语法(适用于 SQL、JSON、DSL 生成)。

- 并行工具调用与代理式协同: 更好的并行能力和更清晰的工具编排,减少了对复杂系统提示词和多智能体脚手架的需求。

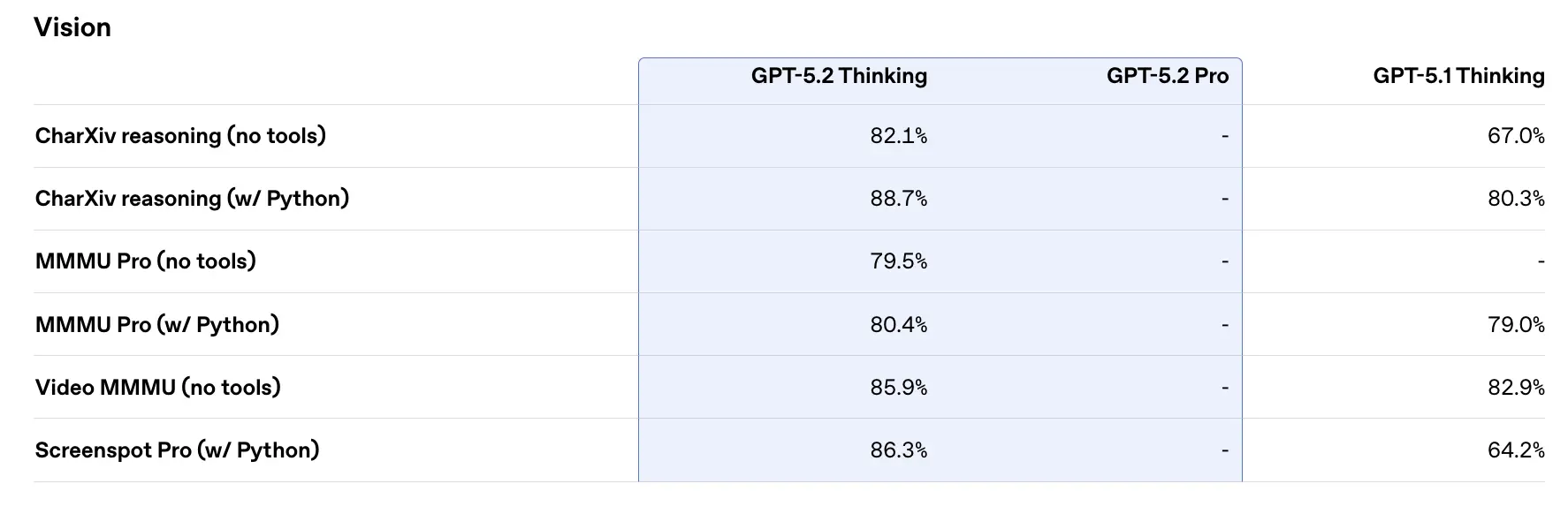

基准性能与支撑数据

OpenAI 发布了 GPT-5.2 的多项内部与外部基准测试结果。以下为部分亮点(OpenAI 报告的数据):

- GDPval(44 个职业,知识工作) —— GPT-5.2 Thinking 在 70.9% 的对比中“优于或不逊于行业顶尖专业人士”;OpenAI 表示,在其 GDPval 任务中,输出生成速度达到专家的 >11×,成本仅为专家的 <1%(速度和成本估算基于历史数据)。这些任务包括电子表格模型、演示文稿和短视频。

- SWE-Bench Pro(编程) —— 据 OpenAI 称,GPT-5.2 Thinking 在 SWE-Bench Pro 上达到 ≈55.6%,在 SWE-Bench Verified(仅 Python)上达到 ~80%,在其测试中创下代码生成 / 工程评估的新 SOTA。这意味着在实际应用中可带来更可靠的调试和端到端修复,依据 OpenAI 的示例。

- GPQA Diamond(研究生级科学问答) —— GPT-5.2 Pro:93.2%,GPT-5.2 Thinking:92.4%(无工具、最大推理)。

- ARC-AGI 系列 —— 在 ARC-AGI-2(更难的流体推理基准)上,GPT-5.2 Thinking 得分 52.9%,GPT-5.2 Pro 得分 54.2%(OpenAI 称这些是链式思维风格模型的新 SOTA 成绩)。

- 长上下文(OpenAI MRCRv2) —— GPT-5.2 Thinking 在 4-needle MRCR 变体上,在 256k token 范围内表现出接近 100% 的准确率,并且在长上下文设置下相较 GPT-5.1 有显著提升。(OpenAI 发布了 MRCRv2 图表和表格。)

与同期模型的比较

- 与 Google Gemini 3(Gemini 3 Pro / Deep Think) 相比:Gemini 3 Pro 已公开宣传具备 ~1,048,576(约 1M)token 的上下文窗口,以及广泛的多模态输入能力(文本、图像、音频、视频、PDF),并通过 Vertex AI / AI Studio 提供强大的代理式集成。纸面上,Gemini 3 更大的上下文窗口是处理超大单会话工作负载时的差异化优势;取舍点则包括工具生态和系统适配性。

- 与 Anthropic Claude Opus 4.5 相比:Anthropic 的 Opus 4.5 强调企业级编程/代理工作流,并报告了强劲的 SWE-bench 成绩以及长时代理会话的稳健性;Anthropic 将 Opus 定位于自动化和代码生成,具备 200k 上下文窗口以及专门的 agent/Excel 集成。Opus 4.5 是企业自动化与代码任务中的强劲竞争者。

实际结论: GPT-5.2 旨在提供较为均衡的改进组合(400k 上下文、高 token 输出、改进的推理/编码)。Gemini 3 面向绝对最大的单会话上下文(约 1M),而 Claude Opus 则侧重企业工程与代理式稳健性。应根据上下文规模、多模态需求、功能/工具适配度以及成本/延迟权衡来选择。

如何访问并使用 GPT-5.2 API

第 1 步:注册获取 API Key

登录 cometapi.com。如果您还不是我们的用户,请先注册。登录您的 CometAPI 控制台。获取接口访问凭证 API key。在个人中心的 API token 处点击 “Add Token”,获取 token key:sk-xxxxx 并提交。

第 2 步:向 GPT-5.2 API 发送请求

选择 “gpt-5.2” 端点发送 API 请求,并设置请求体。请求方法和请求体可从我们网站的 API 文档中获取。我们的网站还提供 Apifox 测试,方便您使用。将 <YOUR_API_KEY> 替换为您账户中的实际 CometAPI key。开发者可通过 Responses API / Chat 端点进行调用。

将您的问题或请求插入到 content 字段中——这就是模型将响应的内容。处理 API 响应以获取生成的答案。

第 3 步:获取并验证结果

处理 API 响应以获取生成的答案。处理完成后,API 会返回任务状态和输出数据。