GPT-5.4 Mini 的技术规格

| 项目 | GPT-5.4 Mini(基于官方信息与交叉验证的估计) |

|---|---|

| 模型系列 | GPT-5.4 系列(高性价比的“mini”变体) |

| 提供方 | OpenAI |

| 输入类型 | 文本、图像 |

| 输出类型 | 文本 |

| 上下文窗口 | 400,000 tokens |

| 最大输出 Token 数 | 128,000 tokens |

| 知识截止 | ~2024 年 5 月 31 日(沿袭 mini 系列) |

| 推理支持 | 是(相较完整 GPT-5.4 更轻量) |

| 工具支持 | 函数调用、网页搜索、文件搜索、智能体(基于 GPT-5 家族推断) |

| 定位 | 高速、高性价比的近前沿模型 |

什么是 GPT-5.4 Mini?

GPT-5.4 Mini 是 GPT-5.4 的一种高性价比、高速度变体,专为对时延敏感、业务量巨大的工作负载而设计。它将 GPT-5.4 在推理、编码与多模态方面的主要能力大幅引入更小、更快的模型中,并针对生产级系统进行了优化。

与早期“mini”模型相比,GPT-5.4 Mini 被定位为“近前沿”的小型模型,即在大幅降低成本与响应时间的同时,性能接近旗舰水平。

GPT-5.4 Mini 的关键特性

- 高速推理:针对聊天机器人、Copilot 与实时系统等低时延应用进行优化

- 超大上下文窗口(400K):支持长文档、多步工作流与智能体记忆

- 强大的编码与智能体支持:面向工具使用、多步推理与委派的子智能体任务而设计

- 多模态输入:同时接收文本与图像输入,支持更丰富的工作流

- 高性价比扩展:在保持强大推理能力的同时,成本显著低于 GPT-5.4

- 智能体流水线优化:适用于大模型负责规划、小模型负责执行的多模型架构

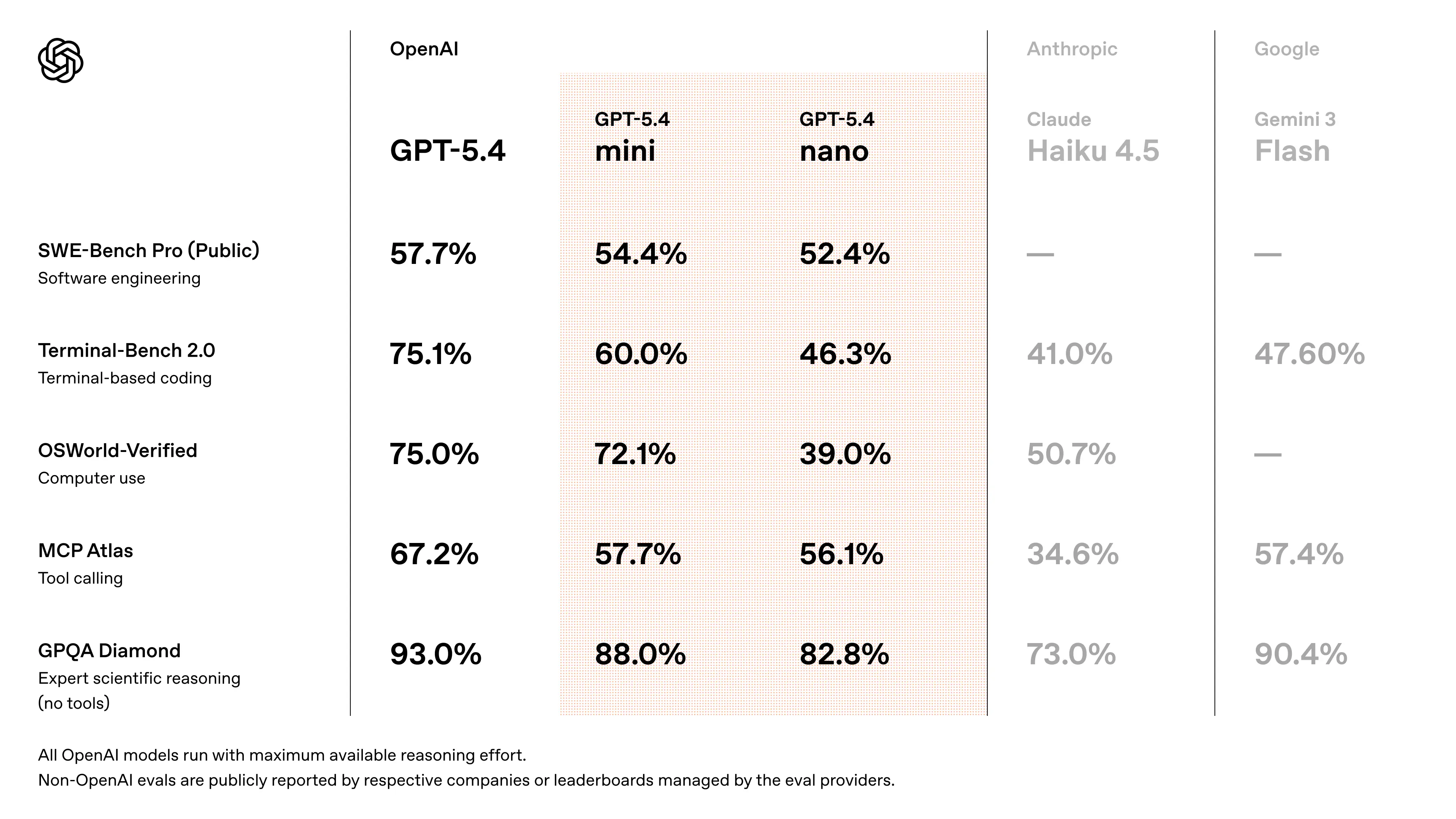

GPT-5.4 Mini 的基准表现

- 在 SWE-Bench 风格的编码任务上接近 GPT-5.4 的表现(约为旗舰性能的 ~94–95%)(来自发布讨论的交叉验证估计)

- 相较 GPT-5 Mini 在以下方面有显著提升:

- 推理准确性

- 工具使用可靠性

- 多模态理解

- 面向智能体工作流与编码基准,旨在超越以往“mini”代际的表现

- 速度测量:早期 API 测试者报告 GPT-5.4 Mini 约为 ~180–190 tokens/sec(相比之下,旧版 GPT-5 mini 变体在不同优先模式下为 ~55–120 t/s)。

👉 关键结论:GPT-5.4 Mini 以极低的成本与时延实现接近前沿的性能,非常适合可扩展系统。

代表性用例

- 编码助手与编辑器(IDE 插件、Copilot):快速上下文解析、代码库探索与快速补全,使 GPT-5.4 Mini 非常适合对首个 token 时间敏感的编辑器内建议。GitHub Copilot 是早期集成者。

- 子智能体/受委派工作者:主智能体将简短、快速的任务(格式化、小规模推理步骤、类 grep 搜索)委派给廉价、快速的工作者。OpenAI 将 mini/nano 定位于这些角色。

- 大规模 API 自动化:批量代码生成、自动工单分拣、日志汇总等场景,尤其在每次调用成本与时延为主要约束时。社区吞吐数据表明 mini 在运营上具有显著优势。

- 工具封装与工具链:模型编排对外部工具(search、grep、run tests)的快速调用,并返回简洁、可执行的输出。GPT-5.4 家族包含改进的“computer use”能力。

如何访问 GPT-5.4 Mini API

步骤 1:注册获取 API Key

登录 cometapi.com。如果您还不是我们的用户,请先注册。登录您的 CometAPI 控制台。获取接口的访问凭证 API key。在个人中心的 API token 处点击“Add Token”,获取 token key:sk-xxxxx 并提交。

步骤 2:向 GPT-5.4 Mini API 发送请求

选择 “gpt-5.4-mini” 端点发送 API 请求并设置请求体。请求方法与请求体可在我们网站的 API 文档获取。我们的网站也提供 Apifox 测试以便您使用。将 <YOUR_API_KEY> 替换为您账户中的实际 CometAPI key。基础 URL 为 Chat Completions 和 Responses。

将您的问题或请求插入 content 字段——模型将对其作出响应。处理 API 响应以获取生成的答案。

步骤 3:检索并验证结果

处理 API 响应以获取生成的答案。处理完成后,API 将返回任务状态与输出数据。