将 CometAPI 与 n8n 集成,只需三步即可让你的自动化工作流接入全球最先进的 AI 模型。通过使用一套与 OpenAI 兼容的统一凭据,你可即时访问 500+ 模型,包括 GPT 5.5、Claude Opus 4.7 和 DeepSeek V4 Pro。该配置在 n8n 云端与自托管环境中完全一致,为你的 n8n AI 工作流自动化提供稳定且高可用的基础。

什么是 n8n,为什么它很重要

n8n 是一款开源的工作流自动化工具。它让你在几乎不写代码的情况下,将不同的应用、服务与 API 连接起来以自动化任务。

它能做什么

把 n8n 想象成用可视化方式构建自动化的工具:

- 你可以使用拖拽式编辑器创建工作流

- 每个步骤(称为 节点)执行一个动作

- 数据会自动从一个步骤流向下一个步骤

关键特性

- 开源(支持自托管)

- 支持数百种集成(API、应用、数据库)

- 允许在工作流中编写自定义 JavaScript 逻辑

- 可在自有服务器上运行,或使用 n8n 官方网站 的云服务

为什么要将 n8n 连接到 CometAPI

在 n8n 中将 CometAPI 作为你的中央网关可以带来显著的运营优势。用一套统一凭据替代 OpenAI、Anthropic 和 Google 的多套密钥后,你的团队无需再管理多个供应商账号与复杂的计费周期。这种架构确保了零供应商锁定;你只需在节点设置中更新模型名称,即可在不同提供商的最新模型之间切换,让你的工作流在 AI 版图演进中保持敏捷。

CometAPI 是一个统一的 REST API,聚合了 500+ 用于聊天、图像、视频、音频(TTS/STT)与向量嵌入的模型。主要优势包括:

- 与 OpenAI 兼容的端点(

https://api.cometapi.com/v1):可直接兼容 OpenAI 节点或 HTTP Request。 - 比直连厂商更低 20–40% 的价格,按量计费,基础无月费,统一账单。

- 无供应商锁定:只需修改一个参数即可切换模型。

- 企业特性:故障切换路由、分析、隐私控制(据部分讨论称不收集提示),以及可靠的访问。

最新进展(截至 2026 年 5 月):CometAPI 在 n8n.io 上保持已验证/合作的集成状态,面向本地/自托管实例提供专用社区节点(n8n-nodes-cometapi,可通过 npm 获取)。用户反馈其与 OpenAI 节点兼容顺畅,且多模型工作流采用率持续增长。n8n 最近的更新增强了工具调用与 HTTP 节点,使集成更稳健。

入门:先决条件与账号设置

注册 CometAPI

访问 cometapi.com,创建免费账号,并在控制台生成 API 密钥。新用户通常会获得试用额度。浏览模型列表与定价页面。

设置 n8n

- 云端:n8n.cloud(托管,易扩展)。

- 自托管:Docker、npm 或 Kubernetes。推荐用于数据隐私与无限执行。近期指南涵盖在本地运行 CometAPI 节点。

更新至最新版本(例如截至 2026 年 5 月的 2.20+),以获取 AI 与稳定性改进。

安装 CometAPI 节点(可选,但推荐用于自托管)

使用社区节点:

npm install n8n-nodes-cometapi

重启 n8n。它会出现在节点面板中,提供近似原生的使用体验。

分步设置指南

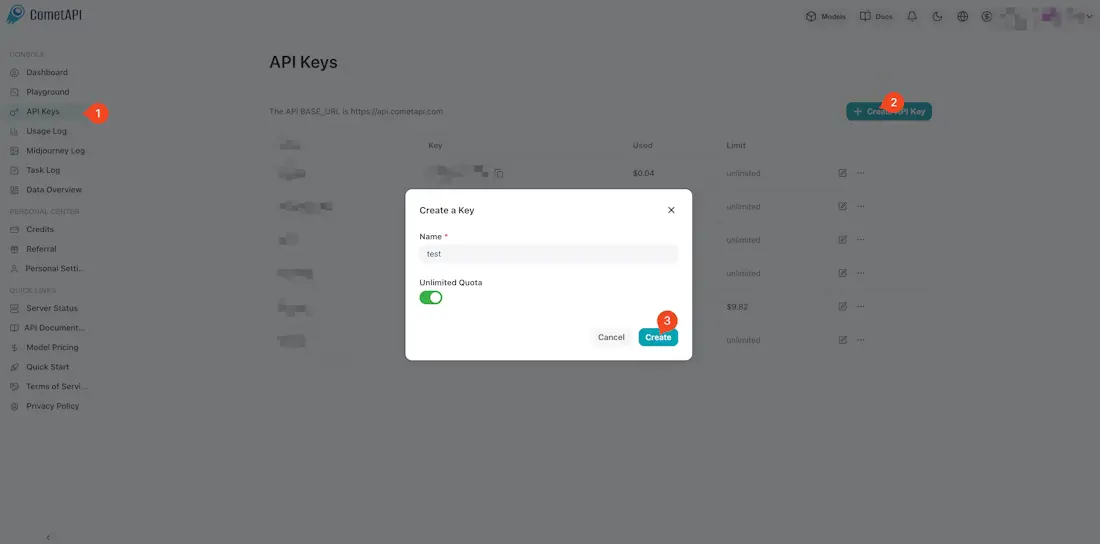

第 1 步:获取你的 CometAPI API Key

登录 CometAPI 控制台,进入 API Token 区域。点击 Add API Key 以生成你的唯一凭据。

复制你的密钥(通常格式为 sk-xxxx),并准备好基础 URL:https://api.cometapi.com/v1.

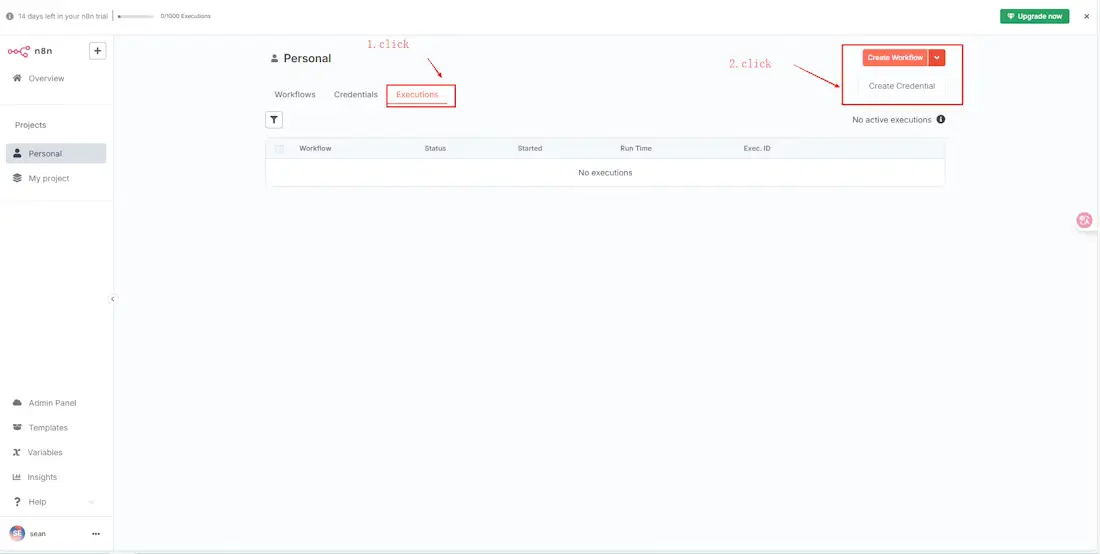

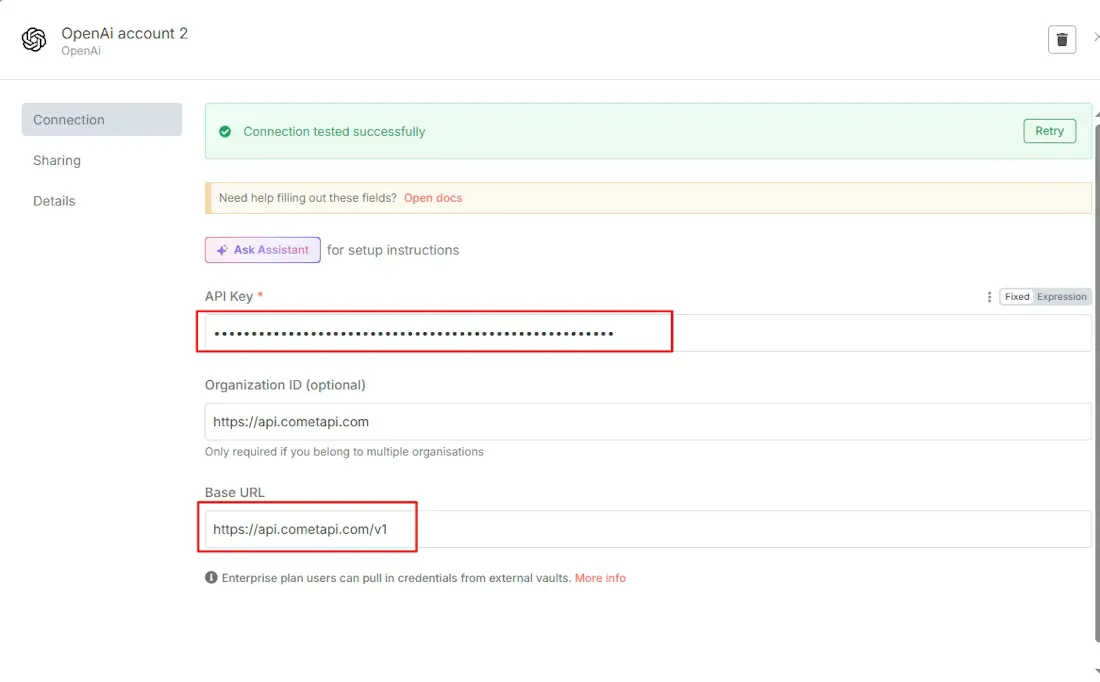

第 2 步:在 n8n 中创建 OpenAI Credential

打开你的 n8n 实例,进入 Credentials → Create Credential。搜索并选择 OpenAI API 凭据类型。

- API Key:在此粘贴你的 CometAPI 令牌。

- Base URL:输入

https://api.cometapi.com/v1.

点击 Save 完成设置。

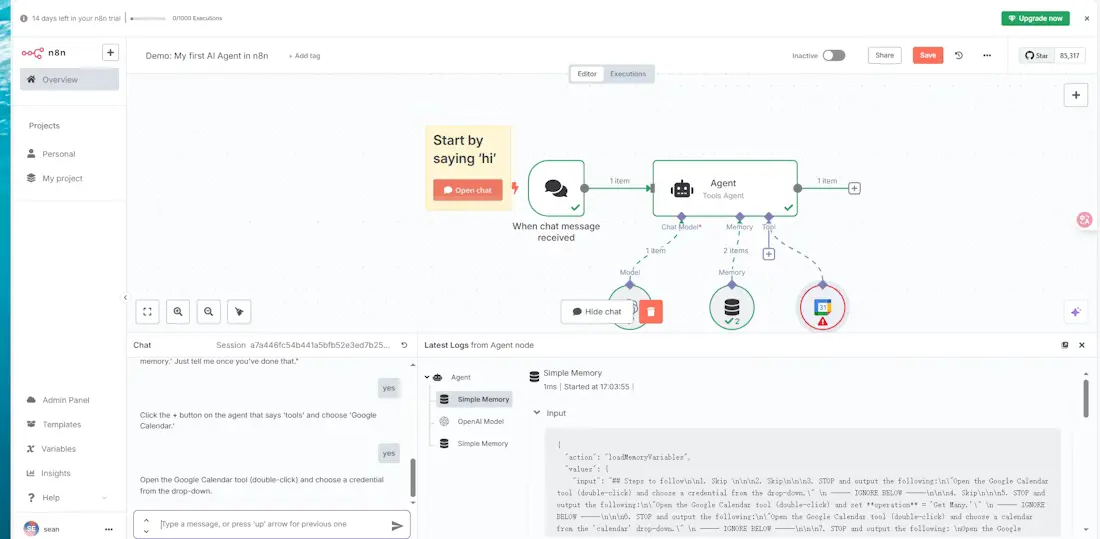

第 3 步:测试你的连接

创建一个新工作流并添加一个 OpenAI 节点(例如 Chat Model 或 AI Agent 节点)。选择你刚创建的 CometAPI 凭据。在模型字段中,你现在可以输入任何受支持的模型 ID,例如 gpt-5.5 或 claude-opus-4-7。执行该节点;成功的响应将验证你的 n8n OpenAI 兼容 API 桥接已正确配置。

常见问题排查

如果你的集成没有立即生效,请检查以下三个常见方面:

API 返回 401 Unauthorized 错误

此错误通常意味着 n8n 无法通过网关进行身份验证。首先,确认你的 API 密钥复制正确,且没有前导或尾随空格。其次,确保你的 Base URL 包含 /v1 后缀。缺少版本路径可能导致端点拒绝请求。

模型名称无法识别

CometAPI 托管 500+ 模型,每个都有特定标识符。如果 n8n 返回 “Model not found” 错误,请确认你使用的是 CometAPI 文档中的精确模型 ID。例如,如果当前目录中的标识符是 gpt-5.5-pro,请不要只写 gpt-5-pro。

响应速度较慢

对于实时应用,延迟可能是关键。一些偏重推理的模型处理时间更长。如果你的工作流需要近实时响应,尝试切换到高吞吐模型,如 Gemini 3.1 Flash-Lite 或 DeepSeek V4 Flash,这些模型针对速度进行了优化。

通过 CometAPI 在 n8n 中可用的模型

| 模型类别 | 示例 | 最佳用途 |

|---|---|---|

| 文本/对话 | GPT 5.5, Claude Opus 4.7, Gemini 3.1 Pro | 专业级推理与复杂逻辑 |

| 代码 | DeepSeek V4 Pro, GPT 5.3 Codex | 代理式编码与仓库规模重构 |

| 图像 | GPT Image 2, Flux 2 Max | 高保真视觉内容与设计 |

| 视频 | Sora 2, Doubao-Seedance 2.0 | 电影级自动化与视频社媒短片 |

开箱即用的 n8n 工作流模板

将 CometAPI 接入 n8n 可实现复杂的多模型逻辑。以下是你今天就能构建的三个模板。

模板 1:客户支持自动化

- 触发器:Webhook 节点接收来自你网站的客户支持工单。

- 处理:使用 CometAPI(OpenAI)节点调用 Claude Opus 4.7 分析工单文本。

- 逻辑:Switch 节点评估 AI 输出的“严重性”或“复杂度”。

- 分支:简单咨询(例如 “Where is my order?”)路由到自动回复节点。复杂技术问题路由至 Slack 节点或 Zendesk 节点由人工介入。

- 节点配置:将 Claude 节点设置为

thinking: {type: "adaptive"},确保在困难的情感分析上投入更多思考时间。

模板 2:自动化内容流水线

- 触发器:RSS Feed 节点检测到你所在行业的新文章。

- 处理 1:使用 GPT 5.5 阅读文章并为你的内部简报生成一段 200 字的管理摘要。

- 处理 2:将该摘要交给 DeepSeek V3 生成 5 个 SEO 优化标签与关键词。

- 输出:将摘要与标签发布到 Notion 数据库或 WordPress 节点。

- 为什么这样编排?:用 GPT 5.5 产出高质量摘要,再用更便宜的 DeepSeek V3 做简单标签,既保证质量又显著降低总 token 成本。

模板 3:图像生成工作流

- 触发器:Google Sheets 节点检测到包含产品名称与描述的新行。

- 处理:将描述发送到使用 Flux 2 Max 模型、调用

/v1/images/generations端点的 CometAPI(OpenAI)节点。 - 存储:将生成的图像 URL 传递到 Google Drive 节点上传并保存文件。

- 节点配置:将

n参数设为 1,并选择如1024x1024的分辨率以获得高质量产品模型图。

n8n + CometAPI 成本优化技巧

要最大化 20–40% 的折扣,请遵循以下架构策略。

用便宜模型做分类与路由

不要为简单的 “是/否” 或 “类别 A/B” 判断使用 GPT 5.5 Pro。改用 DeepSeek V4 Flash 或 GPT 5.4 nano。这些模型成本只是旗舰模型的一小部分,而且通常更快,意味着你的 n8n 工作流执行更高效。

在 n8n 中设置条件化模型选择

使用 Switch 节点或 If 节点,依据输入长度或优先级选择模型。例如,如果文档少于 1,000 字,路由到标准模型;如果是 500,000 token 的大型代码库,则路由到 Grok 4.20 或 Claude Opus 4.7 等长上下文模型。

批处理 vs. 实时处理

如果你的 n8n 工作流不需要即时响应(例如日终报告),使用 Wait 节点或 Schedule 节点聚合输入并批量处理。CometAPI 支持高并发,但减少高频的小请求可以帮助你维持在较低档位的速率限制内,并简化用量日志。

对比表:n8n + CometAPI 与替代方案

| 特性 | n8n + CometAPI | Zapier + Multiple AIs | Make.com + Direct APIs | 自定义代码(Python/Node) |

|---|---|---|---|---|

| 成本 | 低(节省 20–40% + n8n 免费/自托管) | 高(按任务 + 按 API 收费) | 中等 | 视开发投入而定 |

| 易用性 | 可视化、低代码 | 非常易用 | 可视化 | 需要大量编码 |

| 灵活性 | 几乎无限(HTTP + 400+ 节点) | 模板受限 | 良好 | 最高 |

| 模型接入 | 500+ 统一接入 | 碎片化 | 取决于 | 手工对接 |

| 自托管/数据隐私 | 极佳 | 有限 | 更偏云端 | 完全可控 |

| 可扩展性 | 高(队列模式、工作进程) | 受用量计费上限约束 | 良好 | 取决于基础设施 |

| 维护成本 | 低(单一集成) | 高(多重连接) | 中等 | 高 |

| AI 代理支持 | 原生 + 工具 | 基础 | 增长中 | 自定义 |

结论:对于需要能力、可控性与成本效率的团队,n8n + CometAPI 更胜一筹。

未来展望与优化建议

随着 2026 年模型的激增,像 CometAPI 这样的统一平台与 n8n 这类灵活的编排器将成为关键。可期待更深入的原生节点、更好的 MCP/服务器集成与更高级的代理能力。

在 Cometapi.com 上的优化:

- 跨工作流跟踪 token 使用,以便做 ROI 分析。

- 结合 CometAPI 分析与 n8n 执行数据。

- 试验更新的模型(例如 DeepSeek-V4),以更低成本处理专门化任务。

- 与其他 CometAPI 工具组合,构建端到端 AI 解决方案。

快速指南: 今天搭一个简易摘要工作流,明天扩展到完整 AI 运营。

准备开始了吗? 前往 CometAPI 获取免费的 API Key 与额度。无论自托管还是云端 n8n,按上述步骤连接,改变你的自动化。若需定制工作流或企业咨询,请在 Cometapi.com 探索相关选项。

这不仅是一次技术集成——更是 AI 时代提升生产力与创新力的战略倍增器。

常见问题

问:我需要为每个 AI 模型单独创建一套凭据吗?

答:不需要。一套 CometAPI 凭据即可在 n8n 中访问 500+ 模型,从 GPT、Claude 到 DeepSeek 和 Kimi。

问:在 n8n 中使用 CometAPI 是否比直接用 OpenAI 更便宜?

答:是的。CometAPI 对相同模型的定价通常比官方零售价低 20% 至 40%。

问:这是否适用于自托管的 n8n?

答:是。n8n Cloud 与自托管 Docker 的设置流程完全一致。

问:哪些 n8n 节点可与 CometAPI 一起工作?

答:任何接受 OpenAI 凭据的节点都适用,包括 AI Agent、Chat Model 与标准 completion 节点。

问:我能否不重新配置 n8n 就切换模型?

答:可以。只需在节点设置中更新模型名称字符串(例如将 gpt-5.5 改为 claude-opus-4-7);底层凭据对所有提供商均有效。