DeepSeek 已发布DeepSeek V3.2 作为其 V3.x 系列的继任版本,并推出配套的DeepSeek-V3.2-Speciale 变体,该公司将其定位为面向代理/工具使用的高性能、以推理为先的版本。V3.2 建立在实验性工作(V3.2-Exp)之上,引入更高的推理能力、面向“金牌级”数学/竞赛编程表现优化的 Speciale 版本,以及 DeepSeek 所称首创的双模式“思考 + 工具”系统,将内部逐步推理与外部工具调用和代理工作流紧密集成。

什么是 DeepSeek V3.2——以及 V3.2-Speciale 有何不同?

DeepSeek-V3.2 是 DeepSeek 实验性分支 V3.2-Exp 的正式继任者。DeepSeek 将其描述为**“以推理为先”的面向代理的模型家族**,即不仅针对自然对话质量进行调优,更专门面向多步推理、工具调用,以及在包含外部工具(APIs、代码执行、数据连接器)的环境中进行可靠的链式思考式推理。

什么是 DeepSeek-V3.2(基础版)

- 定位为实验性 V3.2-Exp 分支的主流生产继任者;旨在通过 DeepSeek 的 app/web/API 广泛提供。

- 在计算效率与面向代理任务的稳健推理之间保持平衡。

什么是 DeepSeek-V3.2-Speciale

DeepSeek-V3.2-Speciale 是一个变体,DeepSeek 将其作为面向竞赛级推理、高等数学与代理性能的“特别版”进行推广。定位为更高能力的版本,旨在“突破推理能力边界”。目前 DeepSeek 通过 API-only 的方式提供 Speciale,并采用临时访问路由;早期基准表明,它意在在推理与编码基准上与高端闭源模型竞争。

哪些传承与工程选择促成了 V3.2?

V3.2 延续了 DeepSeek 在 2025 年公开的一系列迭代工程:V3 → V3.1(Terminus)→ V3.2-Exp(实验性步骤)→ V3.2 → V3.2-Speciale。实验性 V3.2-Exp 引入了 DeepSeek Sparse Attention (DSA) ——一种细粒度稀疏注意力机制,旨在在保持输出质量的同时,降低超长上下文长度的内存与计算成本。该 DSA 研究与成本优化工作为正式的 V3.2 系列提供了技术踏板。

官方 DeepSeek 3.2 有哪些新变化?

1) 增强的推理能力——推理是如何提升的?

DeepSeek 将 V3.2 定位为**“推理优先”**。这意味着其架构与微调聚焦于可靠的多步推理、维护内部思考链,并支持代理在正确使用外部工具时所需的结构化审慎推理。

具体改进包括:

- 训练与 RLHF(或类似的对齐流程)鼓励显式的逐步问题求解与稳定的中间状态(有助于数学推理、多步代码生成与逻辑任务)。

- 架构与损失函数选择可保持更长的上下文窗口,并允许模型更忠实地引用较早的推理步骤。

- 实用模式(见下文“dual-mode”)使同一模型既可运行在更快的“聊天”风格模式,也可运行在审慎的“思考”模式,在行动前有意完成中间步骤。

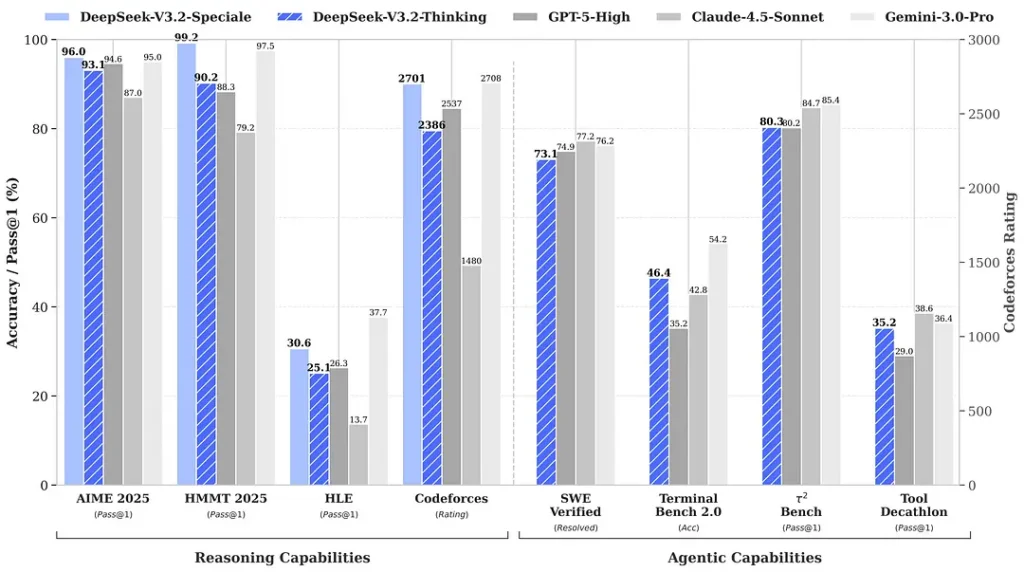

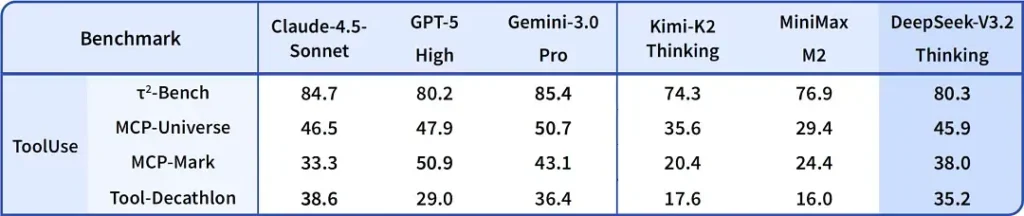

围绕发布所引用的基准声称在数学与推理套件上有显著提升;社区早期的独立基准也报告了在竞争性评估集上的出色成绩:

2) 特别版的突破性表现——到底好多少?

DeepSeek-V3.2-Speciale 被称为在推理准确性与代理编排方面较标准版 V3.2 有进一步提升。提供方将 Speciale 定位为面向高强度推理工作负载与挑战性代理任务的性能层级;目前仅通过 API 提供,并作为临时的高能力端点上线(DeepSeek 表示 Speciale 的可用性初期会受限)。Speciale 版本集成了此前的数学模型 DeepSeek-Math-V2;它可以自行证明数学定理并验证逻辑推理;在多项世界级竞赛中取得了优异成绩:

- 🥇 IMO (International Mathematical Olympiad) Gold Medal

- 🥇 CMO (Chinese Mathematical Olympiad) Gold Medal

- 🥈 ICPC (International Computer Programming Contest) Second Place (Human Contest)

- 🥉 IOI (International Olympiad in Informatics) Tenth Place (Human Contest)

| 基准 | GPT-5 High | Gemini-3.0 Pro | Kimi-K2 Thinking | DeepSeek-V3.2 Thinking | DeepSeek-V3.2 Speciale |

|---|---|---|---|---|---|

| AIME 2025 | 94.6 (13k) | 95.0 (15k) | 94.5 (24k) | 93.1 (16k) | 96.0 (23k) |

| HMMT Feb 2025 | 88.3 (16k) | 97.5 (16k) | 89.4 (31k) | 92.5 (19k) | 99.2 (27k) |

| HMMT Nov 2025 | 89.2 (20k) | 93.3 (15k) | 89.2 (29k) | 90.2 (18k) | 94.4 (25k) |

| IMOAnswerBench | 76.0 (31k) | 83.3 (18k) | 78.6 (37k) | 78.3 (27k) | 84.5 (45k) |

| LiveCodeBench | 84.5 (13k) | 90.7 (13k) | 82.6 (29k) | 83.3 (16k) | 88.7 (27k) |

| CodeForces | 2537 (29k) | 2708 (22k) | — | 2386 (42k) | 2701 (77k) |

| GPQA Diamond | 85.7 (8k) | 91.9 (8k) | 84.5 (12k) | 82.4 (7k) | 85.7 (16k) |

| HLE | 26.3 (15k) | 37.7 (15k) | 23.9 (24k) | 25.1 (21k) | 30.6 (35k) |

3) 首个实现双模式“思考 + 工具”系统

V3.2 中一个极具实用意义的主张是双模式工作流,它将快速对话操作与较慢、更审慎的“思考”模式区分开来(并允许二者之间切换),且与工具使用紧密集成。

- “聊天 / 快速”模式: 面向低延迟的用户对话,回答简洁,较少内部推理痕迹——适合日常帮助、简短 Q&A 与对速度敏感的应用。

- “思考 / 推理器”模式: 优化用于严格的链式思考、逐步规划与编排外部工具(APIs、数据库查询、代码执行)。在思考模式下,模型会产出更明确的中间步骤,便于检查或用于在代理系统中驱动安全、正确的工具调用。

这一模式(双模式设计)曾在早期实验分支中出现,DeepSeek 在 V3.2 与 Speciale 中更深地集成了它——目前 Speciale 仅支持思考模式(因此采用 API 限制接入)。在构建需要与真实世界系统交互的代理时,能够在速度与审慎之间切换非常有价值,因为它让开发者可按需选择延迟与可靠性的权衡。

为何值得注意: 许多现代系统要么提供一个强链式思考模型(用于解释推理),要么提供独立的代理/工具编排层。DeepSeek 的表述暗示了更紧密的耦合——模型可以“先思考”,随后以确定方式调用工具,并用工具返回结果指导后续思考——这对构建自治代理的开发者而言更为顺滑。

在哪里获取DeepSeek v3.2

简短回答——你可以按需通过多种方式获取 DeepSeek v3.2:

- 官方网页/应用(在线使用)——在 DeepSeek 网页端或移动应用中交互式使用 V3.2。

- API 访问——DeepSeek 通过其 API 提供 V3.2(文档包含模型名称 / base_url 与定价)。注册 API 密钥并调用 v3.2 端点。

- 可下载/开放权重(Hugging Face)——模型(V3.2 / V3.2-Exp 变体)已在 Hugging Face 发布,可下载(开放权重)。使用

huggingface-hub或transformers拉取文件。 - CometAPI——一个 AI API 聚合平台,提供 V3.2-Exp 的托管端点。价格低于官方价格。

一些实用提醒:

- 若你需要在本地运行的权重,前往 Hugging Face 模型页面(根据提示接受相应许可/访问条件),并使用

huggingface-cli或transformers下载;GitHub 仓库通常提供了确切命令。 - 若你需要通过 API 用于生产,请参考你所选平台(如 CometAPI)的 API 文档,查找端点名称以及对应 V3.2 变体的正确

base_url。

DeepSeek-V3.2-Speciale:* 仅开放研究用途,支持“Thinking Mode”对话,但不支持工具调用。

- 最大输出可达 128K tokens(超长 Thinking Chain)。

- 目前免费试用至 2025 年 12 月 15 日。

最后想法

DeepSeek-V3.2 标志着以推理为中心的模型在走向成熟方面的重要一步。其结合了改进的多步推理、专门的高性能版本(Speciale),以及生产级的“思考 + 工具”集成,对任何需要将审慎推理与外部动作交错在一起构建高级代理、编码助手或研究工作流的人而言都颇具意义。

开发者可通过 CometAPI 访问 DeepSeek V3.2。开始之前,可在 Playground 中体验 CometAPI 的模型能力,并查阅 API guide 获取详细说明。访问前请确保已登录 CometAPI 并获取 API Key。CometAPI 提供远低于官方的价格,助你快速集成。

Ready to Go?→ Sign up for CometAPI today !