Mistral Large 3 是 Mistral AI 于 2025 年 12 月上旬发布的最新“前沿”模型家族。它是一款开放权重、面向生产的多模态基础模型,围绕细粒度稀疏专家混合(Mixture-of-Experts, MoE)设计构建,旨在在保持推理可行性的同时,通过稀疏化与现代量化实现“前沿”推理、长上下文理解以及视觉 + 文本能力。Mistral Large 3 的官方描述为总参数 6750 亿,推理时活跃参数约 410 亿,默认配置具有256k token的上下文窗口——这一组合旨在在不让每次推理触达全部参数的前提下,同时推动能力与规模。

What is Mistral Large 3? How it work?

What is Mistral Large 3?

Mistral Large 3 是 Mistral AI 的 Mistral 3 家族旗舰前沿模型——一款在 Apache-2.0 许可下发布的大型、开放权重、多模态专家混合(MoE)模型。其目标是在保持推理计算稀疏(每个 token 仅激活部分专家)的同时,提供“前沿”能力(推理、编程、长上下文理解、多模态任务)。

Mistral Large 3 采用专家混合(MoE)方法:模型不会为每个 token 激活所有参数,而是将 token 的处理路由到部分专家子网络。公开的参数规模为约 410 亿活跃参数(通常参与处理某个 token 的参数)与跨全部专家累计6750 亿总参数——一种稀疏而庞大的设计,旨在在计算效率与模型容量之间取得平衡。该模型还支持极长的上下文窗口(官方与合作方文档标注为256k tokens)以及多模态输入(文本 + 图像)。

简言之:它是一种 MoE 模型,拥有巨大的总容量(可容纳多样的专长),但在推理时仅在更小的活跃子集上进行计算——力图比相同总规模的稠密模型更高效地提供前沿性能。

Core architecture: Granular Mixture-of-Experts (MoE)

总体而言,Mistral Large 3 将 Transformer 的部分(或大量)前馈子层替换为MoE 层。每个 MoE 层包含:

- 大量专家——彼此独立的子网络(通常是 FFN 模块)。它们的总和构成模型非常庞大的总参数量(例如数百亿到数千亿)。

- 路由器 / 门控网络——一个小型网络,用于查看 token 表征并决定应由哪几个专家处理该 token。现代 MoE 路由器通常仅选择 top-k 专家(稀疏门控),k 通常为 k=1 或 k=2,以保持较低计算量。

- 稀疏激活——对于任一给定 token,只有被选中的专家会运行;其余专家被跳过。效率正来源于此:总存储参数 >> 每个 token 实际计算的活跃参数。

Mistral 将其设计称为细粒度 MoE,以强调模型拥有众多小而专门化的专家,以及针对多 GPU 与长上下文优化的路由方案。其结果是:获得非常大的表征容量,同时将每 token 的计算量保持在更小的稠密模型附近。Total Parameters:

- Total Parameters: 675 billion;跨所有专家及 Transformer 其余部分存储的参数总和。该数字表示模型的总体容量(能容纳多少知识与专长)。

- Active Parameters: 41 billion。即典型前向计算中实际使用/计算的参数子集,因为路由器每个 token 仅激活少数专家。该指标更接近每次请求的推理计算与内存使用。Mistral 的公开材料列示约 ~41B 活跃参数;某些模型页面针对具体变体(如 39B)显示略有不同的计数——可能反映变体/指令版本或四舍五入差异。

Training Configuration:

- 使用 3000 张 NVIDIA H200 GPU 从零训练;

- 数据覆盖多语言、多任务与多模态;

- 支持图像输入与跨语言推理。

Feature table of Mistral Large 3

| 类别 | 技术能力说明 |

|---|---|

| Multimodal Understanding | 支持图像输入与分析,使模型在对话中能够理解视觉内容。 |

| Multilingual Support | 原生支持 10+ 种主要语言(English、French、Spanish、German、Italian、Portuguese、Dutch、Chinese、Japanese、Korean、Arabic 等)。 |

| System Prompt Support | 与系统指令与上下文提示高度一致,适用于复杂工作流。 |

| Agent Capabilities | 支持原生函数调用与结构化 JSON 输出,可直接调用工具或集成外部系统。 |

| Context Window | 支持超长 256K token 上下文窗口,是开源模型中最长的之一。 |

| Performance Positioning | 面向生产的性能,具备强大的长上下文理解与稳定输出。 |

| Open-source License | Apache 2.0 License,可自由用于商业修改。 |

Overview:

- 性能可与主流闭源模型相当;

- 在多语言任务中表现突出(尤其在非英语与非中文场景);

- 具备图像理解与指令跟随能力;

- 提供基础版(Base)与指令优化版(Instruct),推理优化版(Reasoning)即将推出。

How does Mistral Large 3 perform on benchmarks?

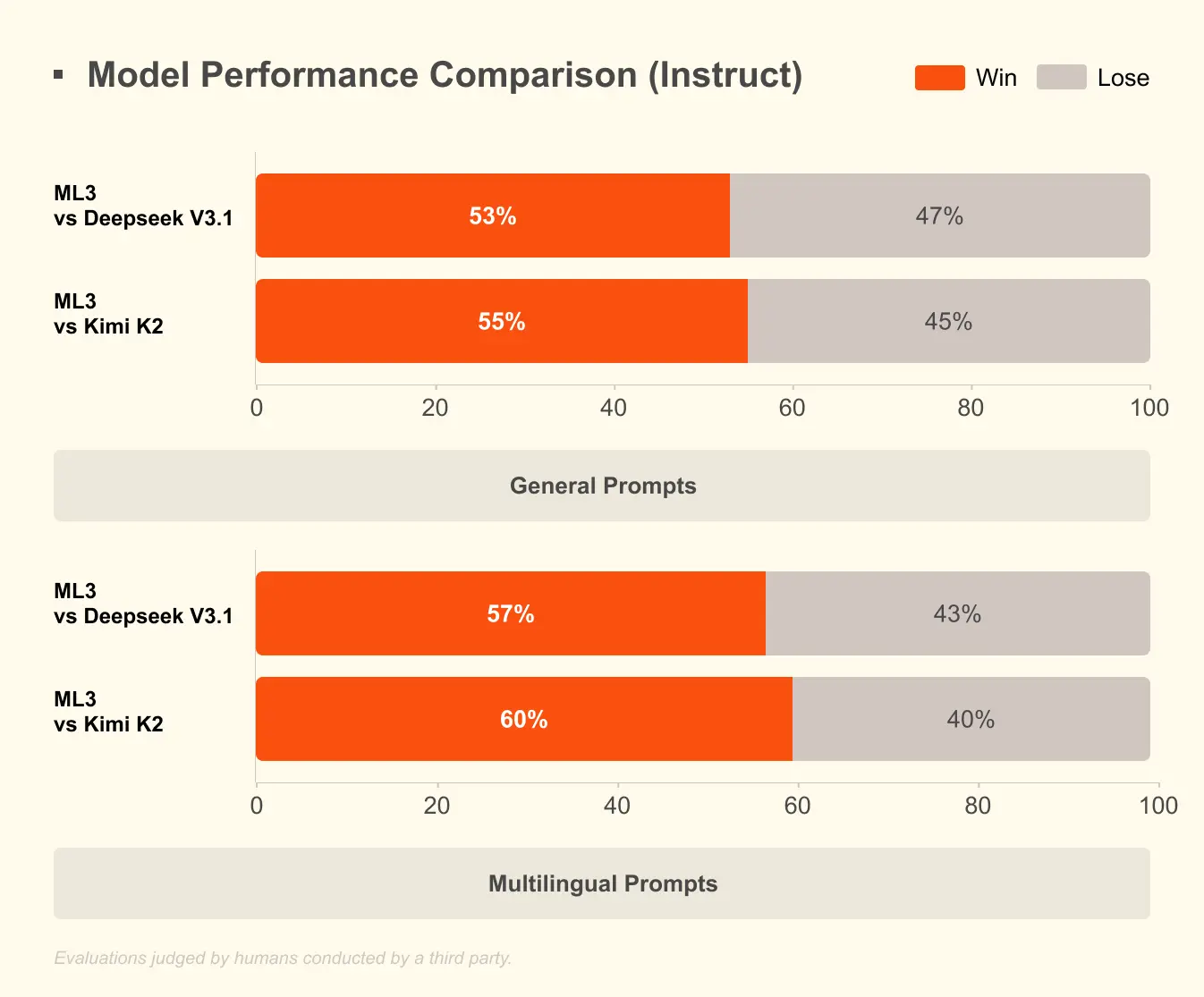

早期公开基准与榜单显示,Mistral Large 3 在开源模型中名列前茅:在 LMArena 的开源非推理模型中排名第 #2,并在多种标准任务(如 GPQA、MMLU 及其他推理/常识套件)上占据顶级榜单位置。

![Mistral Large 3 是 Mistral AI 于 2025 年 12 月上旬发布的最新“前沿”模型家族。它是一款开放权重、面向生产的多模态基础模型,围绕细粒度稀疏专家混合(Mixture-of-Experts, MoE)设计构建,旨在在保持推理可行性的同时,通过稀疏化与现代量化实现“前沿”推理、长上下文理解以及视觉 + 文本能力。Mistral Large 3 的官方描述为总参数 6750 亿,推理时活跃参数约 410 亿,默认配置具有256k token的上下文窗口——这一组合旨在在不让每次推理触达全部参数的前提下,同时推动能力与规模。

What is Mistral Large 3? How it work?

What is Mistral Large 3?

Mistral Large 3 是 Mistral AI 的 Mistral 3 家族旗舰前沿模型——一款在 Apache-2.0 许可下发布的大型、开放权重、多模态专家混合(MoE)模型。其目标是在保持推理计算稀疏(每个 token 仅激活部分专家)的同时,提供“前沿”能力(推理、编程、长上下文理解、多模态任务)。

Mistral Large 3 采用专家混合(MoE)方法:模型不会为每个 token 激活所有参数,而是将 token 的处理路由到部分专家子网络。公开的参数规模为约 410 亿活跃参数(通常参与处理某个 token 的参数)与跨全部专家累计6750 亿总参数——一种稀疏而庞大的设计,旨在在计算效率与模型容量之间取得平衡。该模型还支持极长的上下文窗口(官方与合作方文档标注为256k tokens)以及多模态输入(文本 + 图像)。

简言之:它是一种 MoE 模型,拥有巨大的总容量(可容纳多样的专长),但在推理时仅在更小的活跃子集上进行计算——力图比相同总规模的稠密模型更高效地提供前沿性能。

Core architecture: Granular Mixture-of-Experts (MoE)

总体而言,Mistral Large 3 将 Transformer 的部分(或大量)前馈子层替换为MoE 层。每个 MoE 层包含:

- 大量专家——彼此独立的子网络(通常是 FFN 模块)。它们的总和构成模型非常庞大的总参数量(例如数百亿到数千亿)。

- 路由器 / 门控网络——一个小型网络,用于查看 token 表征并决定应由哪几个专家处理该 token。现代 MoE 路由器通常仅选择 top-k 专家(稀疏门控),k 通常为 k=1 或 k=2,以保持较低计算量。

- 稀疏激活——对于任一给定 token,只有被选中的专家会运行;其余专家被跳过。效率正来源于此:总存储参数 >> 每个 token 实际计算的活跃参数。

Mistral 将其设计称为细粒度 MoE,以强调模型拥有众多小而专门化的专家,以及针对多 GPU 与长上下文优化的路由方案。其结果是:获得非常大的表征容量,同时将每 token 的计算量保持在更小的稠密模型附近。Total Parameters:

- Total Parameters: 675 billion;跨所有专家及 Transformer 其余部分存储的参数总和。该数字表示模型的总体容量(能容纳多少知识与专长)。

- Active Parameters: 41 billion。即典型前向计算中实际使用/计算的参数子集,因为路由器每个 token 仅激活少数专家。该指标更接近每次请求的推理计算与内存使用。Mistral 的公开材料列示约 ~41B 活跃参数;某些模型页面针对具体变体(如 39B)显示略有不同的计数——可能反映变体/指令版本或四舍五入差异。

Training Configuration:

- 使用 3000 张 NVIDIA H200 GPU 从零训练;

- 数据覆盖多语言、多任务与多模态;

- 支持图像输入与跨语言推理。

Feature table of Mistral Large 3

| 类别 | 技术能力说明 |

|---|---|

| Multimodal Understanding | 支持图像输入与分析,使模型在对话中能够理解视觉内容。 |

| Multilingual Support | 原生支持 10+ 种主要语言(English、French、Spanish、German、Italian、Portuguese、Dutch、Chinese、Japanese、Korean、Arabic 等)。 |

| System Prompt Support | 与系统指令与上下文提示高度一致,适用于复杂工作流。 |

| Agent Capabilities | 支持原生函数调用与结构化 JSON 输出,可直接调用工具或集成外部系统。 |

| Context Window | 支持超长 256K token 上下文窗口,是开源模型中最长的之一。 |

| Performance Positioning | 面向生产的性能,具备强大的长上下文理解与稳定输出。 |

| Open-source License | Apache 2.0 License,可自由用于商业修改。 |

Overview:

- 性能可与主流闭源模型相当;

- 在多语言任务中表现突出(尤其在非英语与非中文场景);

- 具备图像理解与指令跟随能力;

- 提供基础版(Base)与指令优化版(Instruct),推理优化版(Reasoning)即将推出。

How does Mistral Large 3 perform on benchmarks?

早期公开基准与榜单显示,Mistral Large 3 在开源模型中名列前茅:在 LMArena 的开源非推理模型中排名第 #2,并在多种标准任务(如 GPQA、MMLU 及其他推理/常识套件)上占据顶级榜单位置。]()

Strengths demonstrated so far

- 长文档理解与检索增强任务: 长上下文与稀疏容量的组合,使 Mistral Large 3 在长上下文任务(文档问答、跨大型文档的总结)上具备优势。

- 常识与指令跟随: 在指令微调变体中,Mistral Large 3 在多种“通用助理”任务与系统提示遵循方面表现出色。

- 能效与吞吐(在优化硬件上): NVIDIA 的分析显示,当在 GB200 NVL72 上结合 MoE 特定优化运行时,Mistral Large 3 的能效与吞吐大幅提升——这些指标直接转化为企业场景下的每 token 成本与可扩展性。

How can you access and use Mistral Large 3?

Hosted cloud access (quick path)

Mistral Large 3 可通过多家云与平台合作伙伴获取:

- Hugging Face 托管模型卡与推理工件(包括指令变体与优化的 NVFP4 工件)。你可以通过 Hugging Face Inference API 调用模型或下载兼容工件。

- Azure / Microsoft Foundry 宣布为企业工作负载提供 Mistral Large 3。

- NVIDIA 发布了针对 GB200/H200 系列的加速运行时与优化说明,Red Hat 等合作方发布了 vLLM 指南。

这些托管路径可让你快速上手,而无需处理 MoE 运行时工程细节。

Running locally or on your infra (advanced)

在本地或私有基础设施上运行 Mistral Large 3 可行但并不简单:

Options:

- Hugging Face 工件 + accelerate/transformers——适用于较小变体,或当你拥有 GPU 集群与相应分片工具时。模型卡列出平台约束与推荐格式(如 NVFP4)。

- vLLM——面向大型 LLM 与长上下文的高性能推理服务器;Red Hat 等合作方发布了在 vLLM 上运行 Mistral Large 3 的指南,以获得高效吞吐与低延迟。

- 专业栈(NVIDIA Triton / NVL72 / 自定义内核)——在规模化场景下实现最佳延迟/效率所需;NVIDIA 发布了关于在 GB200/H200 与 NVL72 运行时加速 Mistral 3 的博客。

- Ollama / 本地虚拟机管理器——社区指南展示了本地(Ollama、Docker)实验性部署;需预期较大的 RAM/GPU 占用,以及使用模型变体或量化检查点的需求。

Example: Hugging Face inference (python)

这是使用 Hugging Face Inference API 的简单示例(适用于指令变体)。将 HF_API_KEY 与 MODEL 替换为模型卡中的值:

# Example: call Mistral Large 3 via Hugging Face Inference APIimport requests, json, osHF_API_KEY = os.environ.get("HF_API_KEY")MODEL = "mistralai/Mistral-Large-3-675B-Instruct-2512"headers = {"Authorization": f"Bearer {HF_API_KEY}", "Content-Type": "application/json"}payload = { "inputs": "Summarize the following document in 3 bullet points: <paste your long text here>", "parameters": {"max_new_tokens": 256, "temperature": 0.0}}r = requests.post(f"https://api-inference.huggingface.co/models/{MODEL}", headers=headers, data=json.dumps(payload))print(r.json())

Note: 对于超长上下文(数万 token),请查看服务提供方的流式/分块建议以及模型变体支持的上下文长度。

Example: starting a vLLM server (conceptual)

vLLM 是企业常用的高性能推理服务器。以下为概念性启动示例(参数、模型路径与 MoE 支持请参考 vLLM 文档):

# conceptual example — adjust to your environment and model pathvllm --model-path /models/mistral-large-3-instruct \ --num-gpus 4 \ --max-batch-size 8 \ --max-seq-len 65536 \ --log-level info

随后使用 vLLM 的 Python 客户端或 HTTP API 发送请求。针对 MoE 模型,你需要确保 vLLM 的构建与运行时支持稀疏专家内核,并与模型检查点格式(NVFP4/FP8/BF16)兼容。

Practical best practices for deploying Mistral Large 3

Choose the right variant and precision

- 在助理工作流中优先使用指令微调检查点(该模型家族提供 Instruct 变体)。仅当你计划进行再微调或自行指令调优时再使用基础模型。

- 使用针对硬件优化的低精度变体(NVFP4、FP8、BF16),若厂商提供则优先采用;只要检查点由模型厂商产出并验证,通常可在质量影响极小的前提下带来巨大效率提升。

Memory, sharding, and hardware

- 不要期待在单块普通 GPU 上运行总参数为 675B 的检查点——尽管每个 token 仅约 41B 活跃参数,但完整检查点体量巨大,需要分片策略与高内存加速器(GB200/H200 级别),或协调 CPU+GPU 迁移。

- 使用模型并行 + 专家布局:MoE 模型受益于将专家分布到多设备以平衡路由流量。遵循厂商关于专家分配的指导。

Long-context engineering

- 分块与检索:在许多长文档任务中,将检索组件与 256k 上下文结合,以控制延迟与成本——即先检索相关片段,再向模型提供聚焦的上下文。

- 流式与窗口化:在持续流场景下,维护滑动窗口并将较旧上下文总结为精炼笔记,以保持模型的注意力预算有效。

Prompt engineering for MoE models

- 偏好明确指令:指令微调检查点更易于响应清晰的任务与示例。对复杂结构化输出,在提示中使用小样例。

- Chain-of-thought 与系统消息:在推理任务中,构造鼓励逐步推理并验证中间结果的提示。但需注意:提示链式思考会增加 token 消耗与延迟。

Conclusion

Mistral Large 3 是开放权重模型领域的重要里程碑:一款总参数 675B / 活跃约 41B 的 MoE模型,具备256k 上下文、多模态能力,并与主要基础设施合作伙伴共同优化了部署方案。对于能够采用 MoE 运行时与硬件栈的企业,它在性能与成本方面提供了有吸引力的组合,但在特定推理任务与运营就绪度方面仍需谨慎评估。

首先,前往 Gemini 3 Pro 的能力页面,在 Playground 中探索更多 AI 模型,并查阅 API guide 获取详细说明。访问前,请确保已登录 CometAPI 并获取 API Key。CometAPI 提供远低于官方价格的方案,帮助你集成。

Ready to Go?→ Sign up for CometAPI today !