OpenAI 的 GPT-5 於 2025 年 5 月初發布,並迅速透過多種交付管道推出。對於團隊來說,無需切換供應商 SDK 即可體驗 GPT-5 的最快方法之一是 CometAPI——一個多模型網關,可以公開 GPT-XNUMX 以及數百個其他模型。本文提供了實用文檔,以解釋 什麼 CometAPI 提供, 如何 透過它來呼叫 GPT-5,您應該評估的權衡,以及在將關鍵工作流程轉移到 GPT-5 之前要實施的實際治理和成本控制。

GPT-5 是什麼?它與早期模型有何不同?

GPT-5 是 OpenAI 的下一個旗艦大型語言模型系列,將於 2025 年 5 月初發布。它呈現為一個統一的多模態推理系統,融合了快速的非推理組件、更深層的「推理」變體(通常被稱為「GPT-XNUMX 思維」),以及一個根據複雜性和所需工具決定使用哪個子模型的路由器。 OpenAI 聲稱其最終效果是:推理能力更強、上下文視窗更大,以及對編碼和代理任務的支援得到增強。

架構和關鍵功能

- 多組分系統: GPT-5 被描述為一個根據需要將請求路由到不同內部子模型(快速推理與深度推理)的系統;開發人員可以透過 API 請求推理模型以獲得最佳效能。

- 大背景: 此模型系列支援極大的上下文(數十萬個標記),從而能夠單次處理長文件、程式碼庫或多文件對話。

- 多尺寸家庭: OpenAI 發布了多種尺寸的 GPT-5(常規

gpt-5,gpt-5-mini,gpt-5-nano),這樣團隊就可以權衡延遲、成本和推理能力。

什麼是 CometAPI?它真的提供 GPT-5 嗎?

快速定義

彗星API CometAPI 是一個 API 聚合平台,它宣稱可以透過一個與 OpenAI 相容的 REST 介面統一存取數百個 AI 模型(OpenAI 的 GPT 系列、Anthropic Claude、xAI Grok、映像模型等)。這意味著開發者可以透過更改模型名稱字串來切換模型提供者,而無需重寫網路程式碼。 CometAPI 在其產品頁面上明確列出了 GPT-5 及相關變體(例如, gpt-5, gpt-5-chat-latest, gpt-5-mini) 作為可用端點。

為什麼團隊要使用 CometAPI 之類的網關

CometAPI 之類的網關服務很有吸引力,因為它們可以讓你:

- 交換模型 無需更改大量集成代碼。

- 比較價格 並將某些請求路由到更便宜或更快的模型變體。

- 匯總總計費和日誌記錄 跨多種型號和供應商。

CometAPI 的文檔提供了一個簡單的遷移路徑和一個 OpenAI 風格的用戶端(因此您現有的 OpenAI 或「openai 相容」程式碼通常只需要進行微小的變更)。

CometAPI 如何以程式設計方式公開 GPT-5?

CometAPI 提供了一個 與 OpenAI 相容的 REST API 表面:基本 URL, Authorization: Bearer <YOUR_KEY>,並請求類似 OpenAI 的聊天/完成端點的主體。對於 GPT-5 平台文件模型名稱,例如 gpt-5, gpt-5-mini和 gpt-5-nano 提到的端點包括 POST https://api.cometapi.com/v1/chat/completions 用於聊天式通話和 /v1/responses 適用於某些非聊天變體。範例配置詳細資訊(基本 URL、標頭格式和模型參數)發佈於 CometAPI 文檔 快速入門指南.

典型的端點和身份驗證模式

- 基本網址:

https://api.cometapi.com/v1(或記錄在案/v1/chat/completions用於聊天和/v1/responses對於一些非聊天變體。 ) - 授權標頭:

Authorization: Bearer sk-xxxxxxxxxxxx(CometAPI 問題sk-儀表板中的樣式標記)。 - 內容類型:

application/json. - 型號參數: Wi-Fi:

model至gpt-5, gpt-5-2025-08-07,gpt-5-chat-latest,gpt-5-mini或其他,請參閱 模型頁.

如何開始使用 CometAPI 並請求 GPT-5? (逐步說明)

以下是您今天可以遵循的簡潔、可靠的入職流程。

步驟 1:註冊並取得 CometAPI 金鑰

- 造訪 cometapi.com 並創建一個帳戶。

- 從您的儀表板轉到 API 令牌 or 個人中心 → 新增Token. CometAPI 在

sk-...格式。請安全儲存(不要將金鑰嵌入公共儲存庫)。

第 2 步:選擇型號字串

- 選擇符合您需求的型號名稱(例如,

gpt-5,gpt-5-nano-2025-08-07)。 CometAPI 通常會為每個模型發布多個別名,以便您可以選擇準確性與成本之間的權衡。

步驟 3:發出第一個請求(curl)

最小 curl 遵循 OpenAI 相容模式的範例:

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-YOUR_COMETAPI_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-5",

"messages": [{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"Summarize the benefits of using a model aggregator."}],

"max_tokens": 500,

"temperature": 0.2

}'

這反映了 OpenAI 的聊天 API 結構,但指向 CometAPI 的基本 URL 並使用您的 Comet 令牌。

步驟 4:Python 範例(請求)

import requests, os

COMET_KEY = os.getenv("COMETAPI_KEY") # set this in your environment

url = "https://api.cometapi.com/v1/chat/completions"

headers = {

"Authorization": f"Bearer {COMET_KEY}",

"Content-Type": "application/json",

}

payload = {

"model": "gpt-5",

"messages": [

{"role":"system","content":"You are a helpful assistant."},

{"role":"user","content":"List three concrete steps to reduce model hallucination in production."}

],

"max_tokens": 400,

"temperature": 0.1

}

resp = requests.post(url, json=payload, headers=headers, timeout=60)

resp.raise_for_status()

print(resp.json())

更換 model - gpt-5-nano 或精確的別名 CometAPI 文檔,以獲得更小、更便宜的變體。

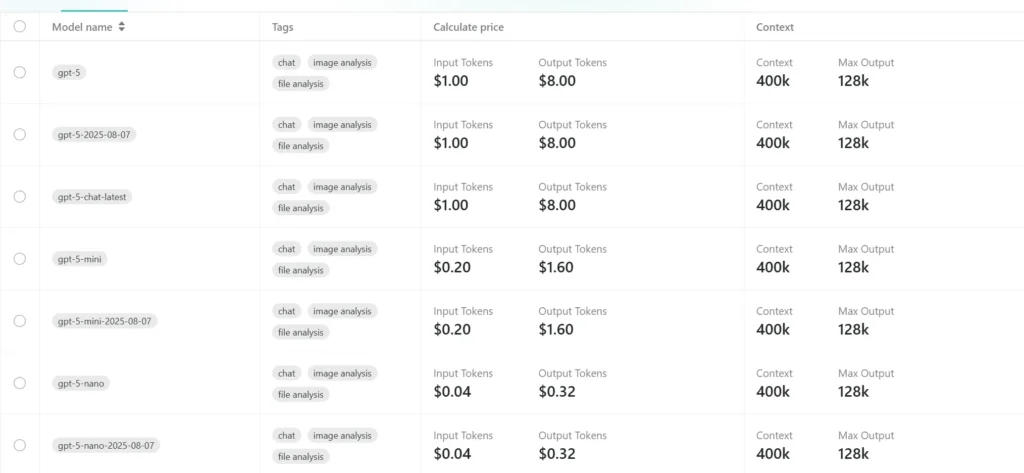

CometAPI 中的價格

生產用途的實用最佳實踐和緩解措施是什麼?

以下是使用 CometAPI 等中介時降低風險和提高可靠性的具體模式。

從小規模試點開始並進行平行測試

向 OpenAI(如果您有直接存取權)和 CometAPI 執行相同的請求,以比較輸出、延遲和成本。這將揭示任何隱式轉換、內容過濾器或模型別名不匹配的情況。

可觀察性和品質保證工具

記錄提示、傳回的令牌(已針對 PII 進行混淆處理)、延遲和錯誤代碼。實施提示漂移率和幻讀率的自動化測試。追蹤模型別名的使用情況,以便遷移過程可審計。

保護金鑰並定期輪換

將 CometAPI 令牌視為任何 API 機密:儲存在機密管理器中,定期輪換,並將令牌範圍限定到環境(dev/stage/prod)。

實施分層安全

結合使用:

- 即時工程 減少幻覺(明確的約束,結構化的輸出)。

- 後處理檢查 (事實驗證、封鎖清單、PII 的正規表示式檢查)。

- 人在循環 對於高風險輸出。

這些是處理關鍵或合法內容的 GPT-5 部署的標準。

常見的陷阱有哪些?如何解決存取問題?

陷阱:「模型不存在/無法存取」。一些開發者報告稱,使用直接提供者 API 時,模型存取可能會受到提供程序驗證或組織驗證步驟的限制;當聚合器代理提供者模型時,也會出現類似的限制。如果您看到「模型不存在」或權限錯誤,請檢查:(a) 您的 CometAPI 金鑰是否有效且未過期;(b) 要求的模型名稱是否與 CometAPI 的支援清單完全相符;以及 (c) 底層提供者是否要求額外的驗證或計費步驟。對於與驗證相關的存取錯誤以及逾時/權限異常,請準備好提供詳細資訊以聯絡工作人員進行解決(郵箱:support@cometapi.com)。

陷阱:意外的延遲或成本。 高推理模式和大型上下文會導致延遲和令牌消耗。使用 max_tokens, 降低 temperature 在適當的情況下,並且傾向於 mini 適用於高吞吐量工作負載的變體。透過日誌記錄和警報進行監控。

結束語

CometAPI 為團隊提供了一種快速實驗 GPT-5 變體的途徑,同時集中了模型訪問,但生產使用需要遵循與任何強大模型相同的原則:安全密鑰、謹慎的快速工程、幻覺監控以及對敏感工作負載的政策/法律審查。請從小規模試點開始,使用 CometAPI 的儀表板測量代幣消耗和延遲,並在驗證了您所在領域的準確性和安全性後,再升級到更高推理能力的變體。

開發人員可以訪問 GPT-5 、GPT-5 Nano 和 GPT-5 Mini 透過 CometAPI(CometAPI 建議 /v1/responses),列出的最新模型版本截至本文發布之日。首先,探索該模型的功能 游乐场 並查閱 API 指南以取得詳細說明。造訪前,請確保您已登入 CometAPI 並取得 API 金鑰。 彗星API 提供遠低於官方價格的價格,幫助您整合。

常見問題

1. 您應該選擇哪一種 GPT-5 模型變體?代幣/定價如何?

CometAPI 列出了多個 GPT-5 變體(預設 gpt-5,聊天快照 gpt-5-chat-latest以及較小的版本,例如 gpt-5-mini/gpt-5-nano). 根據您的需求選擇:

gpt-5/gpt-5-chat-latest— 具有通用聊天的全部功能,品質和推理最佳。gpt-5-mini/gpt-5-nano— 降低大容量或低關鍵性任務的成本和延遲。

2. 您應該如何設計對大背景和高品質推理的調用?

長上下文:GPT-5 支援非常大的上下文視窗。發送大型文件時,應謹慎地對輸入進行分塊,使用檢索增強(向量資料庫 + 上下文視窗),並限制輸出的 max_tokens 數量以控製成本。

3. 您應該採取哪些安全、隱私和合規措施?

API 密鑰衛生。 將密鑰保存在環境變數中,定期輪換密鑰,並盡可能限定密鑰的作用域。不要將金鑰提交到程式碼庫。 (最佳實踐已在開發者指南中提及。)

資料駐留和隱私。 在透過任何第三方聚合器發送敏感的個人、健康或受監管資料之前,請先閱讀 CometAPI 的隱私權政策和條款(以及 OpenAI 的政策)。某些企業可能需要直接的供應商合約或私有實例。

速率限制和配額保護。 在生產環境中實施熔斷機制、指數退避和配額檢查,以防止成本失控和級聯故障。 CometAPI 儀表板會顯示使用情況和配額,您可以使用它們來強制執行程式限制。