Google DeepMind 於 2026 年 4 月 2 日正式發佈 Gemma 4,標誌著開源 AI 的一個重要里程碑。這個模型家族在「每參數智慧」方面達到前沿水準,建立在驅動 Gemini 3 的相同研究與技術之上。與早期使用自訂授權的 Gemma 版本不同,Gemma 4 採用完全寬鬆的 Apache 2.0 license,允許不受限制的商業使用、修改與再散佈。

Gemma 4 以其多模態能力而脫穎而出(所有尺寸均支援文字 + 圖像輸入,邊緣模型另支援音訊)、原生進階推理與代理式工作流程、最長 256K token 的長上下文以及從智慧型手機與 Raspberry Pi 到高階 GPU 的全方位最佳化。它支援超過 140 種語言並強調效率,使強大的 AI 能在消費級與邊緣硬體上離線運作,無需依賴雲端。

CometAPI 提供優秀的開源與閉源模型 API。

什麼是 Gemma 4?

Gemma 4 是 Google DeepMind 最新的開放多模態大型語言模型(LLM)家族,專為進階推理、代理式(agentic)AI 工作流程與高效裝置端部署而打造。它借鑑專有 Gemini 3 研究的洞見,同時保持開放權重與開源,將「intelligence-per-parameter」最大化。

相較先前的 Gemma 模型,關鍵進步包括:

- 原生多模態:所有模型支援文字 + 圖像理解,小型邊緣變體另有音訊支援。

- 可配置思考模式:逐步推理,輸出結構化的 <|think|>。

- 原生函式呼叫與工具使用:非常適合自主代理。

- 延伸上下文:大型模型最高支援 256K token。

- 混合注意力架構:結合區域滑動視窗與全域注意力,兼顧效率與長上下文表現。

- 小型模型採用 Per-Layer Embeddings (PLE) 與共享 KV 快取以節省記憶體。

- 廣泛多語支援:預訓練數據涵蓋 140+ 語言,具文化脈絡感知。

採用 Apache 2.0 授權的 Gemma 4 移除了先前限制企業採用的條款。開發者現在能無摩擦地進行微調、部署與商用——使其成為可與 Llama、Qwen 等完全開放生態直接競爭的選項。

Gemma 4 面向多樣硬體:邊緣裝置(手機、IoT、Raspberry Pi、Jetson Nano)提供低延遲離線 AI,工作站/GPU 則可作為高效能本地伺服器。這種「本地優先」設計優先考量隱私、成本節省與零延遲推理。

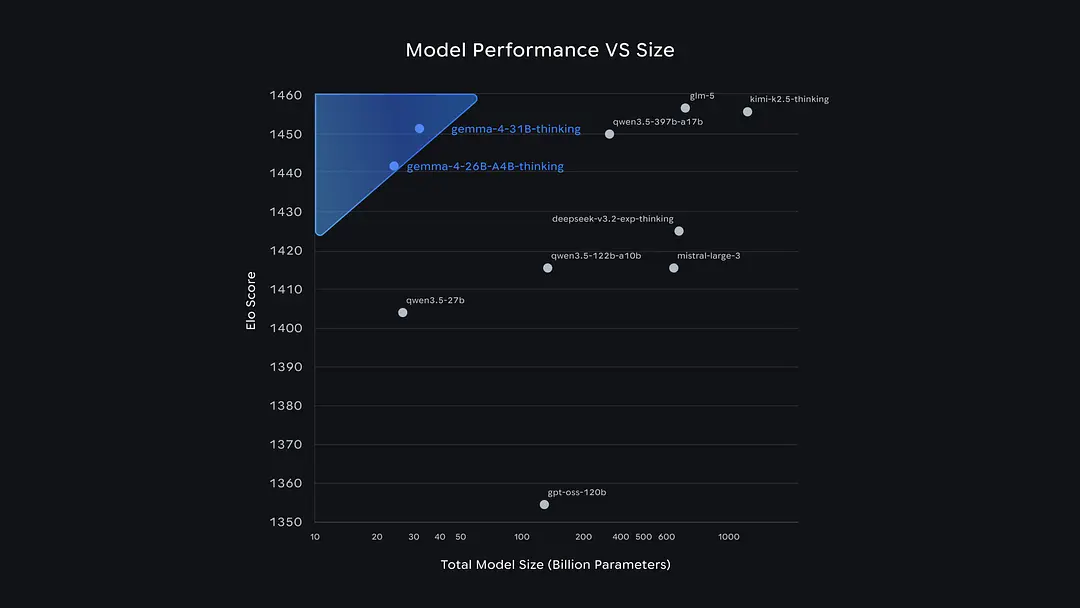

在 Arena 排行榜上位居其前的開源模型主要來自中國團隊。Gemma 4 與 Qwen 3.5、GLM-5 相差不大,但與 OpenAI 的 GPT-OSS-120B 存在顯著差異。

開發者現在可以在 CometAPI 上找到 GLM-5、Qwen 3.5 等。

Gemma 4 的四個版本

Google 發佈了經精心優化的四種尺寸版本,在效能、效率與部署場景間取得平衡。兩款採用具創新的 Per-Layer Embeddings (PLE) 的稠密架構,面向邊緣效率;一款是 Mixture-of-Experts(MoE),以低作用中參數成本追求高效能;另一款是稠密旗艦。

| Model | Architecture | Total Params | Active Params (MoE) | Effective Params | Context Length | Modalities | Target Hardware |

|---|---|---|---|---|---|---|---|

| Gemma 4 E2B | Dense + PLE | ~5.1B (incl. embeddings) | N/A | 2.3B | 128K | Text, Image, Audio | Smartphones, Raspberry Pi, edge IoT |

| Gemma 4 E4B | Dense + PLE | ~8B (incl. embeddings) | N/A | 4.5B | 128K | Text, Image, Audio | Mobile devices, lightweight GPUs, Jetson |

| Gemma 4 26B A4B | MoE (8 active / 128 total + 1 shared) | 25.2B | 3.8B–4B | N/A | 256K | Text, Image | Workstations, consumer GPUs, local servers |

| Gemma 4 31B | Dense | 30.7B | N/A | N/A | 256K | Text, Image | High-end GPUs (fits on single H100/A100 in FP16) |

Gemma 4 E2B 與 E4B(邊緣最佳化):使用 PLE 在極少參數開銷下提供逐層專門化。非常適合電池供電或記憶體受限裝置。音訊編碼器(USM-style Conformer,~300M 參數)支援語音轉文字與翻譯。

Gemma 4 26B A4B(MoE):雖然總參數超過 25B,但推理時僅啟用 ~4B 參數。在計算成本大幅降低的情況下,提供接近 31B 的效能——是成本效率擴展的理想選擇。

Gemma 4 31B(稠密):以極致能力為目標的旗艦版。在全精度下可放入單顆 80GB GPU,並位居各大開源模型排行榜前列。

所有模型均包含經指令調優(“-it”)的變體,針對對話、推理與工具使用進行最佳化,另有預訓練基座版本可供微調。兩款大模型採取不同路徑:31B 稠密模型追求極致品質,是微調的最佳基礎;26B MoE 模型優先速度,推理時僅啟用 38 億參數,詞元生成顯著更快,但整體品質略低。

兩款小模型 E2B 與 E4B 專為手機與 IoT 設備設計:可完全離線運行,節省記憶體與電力。此外,這些小型模型具備大型模型所沒有的能力:原生音訊輸入,可直接進行語音識別。

Gemma 4 的核心能力

Gemma 4 在真實世界 AI 應用最關鍵的領域中表現出色:

1. 進階推理與思考模式

可透過系統提示或 enable_thinking=True 啟用逐步推理。輸出結構化的 <|think|> 標記,後接最終答案。無需額外微調即可顯著提升複雜任務表現。

2. 多模態理解

- 視覺:物件偵測(JSON 邊界框)、OCR(多語)、文件/PDF 解析、圖表理解、UI 理解、手寫辨識,以及可變解析度影像處理(token 配額:70–1120 token)。

- 影片:最長 60 秒(1 fps 影格處理)。

- 音訊(僅 E2B/E4B):自動語音辨識(ASR)與語音轉文字翻譯(最長 30 秒)。

- 交錯輸入:可任意順序混合文字、圖像與音訊。

3. 代理式工作流程與函式呼叫

原生工具使用支援,使自主代理能進行多步規劃、API 呼叫、應用導覽與任務完成。在 τ2-bench(代理工具使用)表現強勁。

4. 程式碼與開發者工具

卓越的程式碼生成、補全、偵錯與倉庫級理解能力。支援 JSON 結構化輸出以便無縫整合。31B 在 LiveCodeBench v6 上取得 80.0% 分數,使其成為適合離線開發場景的本地優先 AI 程式助理。

5. 長上下文與多語

可穩定處理 128K–256K token(經 MRCR needle-in-haystack 測試)。預訓練資料涵蓋至 2025 年 1 月,跨語種表現強勁。不僅是多語翻譯,而是原生覆蓋 140+ 語言的訓練。

基準數據:Gemma 4 表現解析

Gemma 4 為開源模型樹立新標準。31B 與 26B 變體達到曾經屬於更大型專有系統的分數,而邊緣模型則超越 Gemma 3 的更大前代。

完整基準結果(Instruction-Tuned 模型)

| Benchmark | Category | Gemma 4 31B | Gemma 4 26B A4B | Gemma 4 E4B | Gemma 4 E2B | Gemma 3 27B (no think) |

|---|---|---|---|---|---|---|

| MMLU Pro | 推理與知識 | 85.2% | 82.6% | 69.4% | 60.0% | 67.6% |

| AIME 2026 (no tools) | 數學 | 89.2% | 88.3% | 42.5% | 37.5% | 20.8% |

| GPQA Diamond | 研究生級科學 | 84.3% | 82.3% | 58.6% | 43.4% | 42.4% |

| Tau2 (avg) | 代理工具使用 | 76.9% | 68.2% | 42.2% | 24.5% | 16.2% |

| LiveCodeBench v6 | 程式設計 | 80.0% | 77.1% | 52.0% | 44.0% | 29.1% |

| Codeforces ELO | 競賽程式設計 | 2150 | 1718 | 940 | 633 | 110 |

| MMMU Pro | 多模態推理 | 76.9% | 73.8% | 52.6% | 44.2% | 49.7% |

| MATH-Vision | 數學 + 視覺 | 85.6% | 82.4% | 59.5% | 52.4% | 46.0% |

| MRCR v2 (8-needle, 128K) | 長上下文 | 66.4% | 44.1% | 25.4% | 19.1% | 13.5% |

關鍵觀察:

- 相較 Gemma 3 的巨大躍進:31B 將 AIME 數學從 20.8% 提升至 89.2%,LiveCodeBench 從 29.1% 提升至 80.0%。

- MoE 效率:26B A4B 在推理時計算顯著更少,卻幾乎接近 31B 表現。

- 邊緣優勢:E4B 與 E2B 在多項指標上超越 Gemma 3 27B,儘管尺寸小 6–10 倍。

- 排行榜表現:31B 在 Arena AI(文字)約 1452 分;26B A4B 約 1441 分。據報 26B 變體在使用者偏好與程式設計上優於更大型的模型,例如 Qwen 3.5 397B。

視覺與音訊基準證實其在未經專門微調的情況下,即具備強大的開箱即用多模態表現。

生態與工具支援

Gemma 4 享有即時且廣泛的生態整合:

- Hugging Face:首日支援

transformers、pipeline("any-to-any")、GGUF、ONNX 與多模態處理器。 - 本地執行環境:Ollama、Llama.cpp(LM Studio、Jan)、MLX(Apple Silicon with TurboQuant)、Mistral.rs(Rust)、Transformers.js(WebGPU 瀏覽器推理)。

- 微調:TRL、Unsloth、PEFT、Vertex AI,並支援完整多模態資料集。

- 硬體最佳化:NVIDIA RTX/DGX Spark/Jetson(透過 TensorRT-LLM)、Google AI Edge 工具,以及 Android/iOS 裝置端部署。

- 代理框架:OpenClaw、Hermes、Pi 與 CARLA 模擬測試。

- 雲端/Studio:Google AI Studio 可快速測試;Kaggle Models 可下載。

這個生態讓 Gemma 4 能在筆電、伺服器或邊緣裝置上於數分鐘內完成部署。

限制與安全:

- 訓練數據截止:2025 年 1 月(若無工具,無法即時獲取新知)。

- 音訊僅限語音(非音樂);影片上限 60 秒。

- 仍有幻覺風險——建議使用思考模式與驗證。

- 安全性:遵循 Google AI Principles 進行嚴格過濾與評估;開發者應加入應用層面的防護。

為何 Gemma 4 在 2026 年具有意義

Gemma 4 正在普及前沿 AI。結合多模態智慧、代理能力與 Apache 2.0 的自由,並具硬體無關的高效率,讓開發者與企業能以安全、私密、低成本的方式在規模上構建 AI 解決方案。「每參數智慧」的突破——特別是邊緣模型超越昨日旗艦級開源模型——預示著 AI 真正無所不在的轉變。

無論是在手機上運行 2B 模型,還是在本地運行 31B 的強大模型,Gemma 4 都證明開源 AI 在實用性方面已趕上(甚至在許多情況下超越)封閉替代方案。