Luma AI 已成為消費者和產消者內容創作領域最受關注的工具之一:它是一款應用程式和雲端服務,可以將智慧型手機照片和影片轉換為逼真的 3D NeRF,並透過其 Dream Machine / Ray2 模型根據文字或圖像提示生成圖像和短影片。但速度是創作者首先要考慮的實際問題之一:捕捉、渲染或影片生成實際需要多長時間?

Luma AI 需要多長時間來產生 Dream Machine(文字→影片)剪輯?

官方基線時間

Luma 的產品頁面和學習中心提供了其圖像和短視頻生成流程的快速基準時間:在付費用戶和內部基準測試的正常情況下,圖像批次以幾十秒為單位,短視頻作業以幾秒到幾分鐘為單位。這些官方指標反映了在 Luma 基礎設施(Ray2 / Dream Machine 堆疊)上優化的模型運行,並且是小型短視頻的最佳情況。

您應該預期的實際範圍

邊緣情況/免費套餐或尖峰負載:免費用戶或需求旺盛時會產生等待 個小時裡 或作業“卡在佇列中”,直到容量釋放;社區貼文記錄了高峰時段或中斷期間長達數小時的等待。如果低延遲至關重要,請考慮這種可變性,並考慮付費/優先選項。

小型社群影片(5-15秒):在許多情況下,單獨的生成步驟可以在 不到一分鐘到幾分鐘 對於正常負載期間的付費用戶來說 - 但是當您包括排隊,預處理和串流/匯出步驟時,總掛鐘時間可能會更長。

更高細節或更長的剪輯(20-60秒):這些可以採取 幾分鐘到幾十分鐘尤其是在要求更高的解析度、更複雜的攝影機移動或迭代優化的情況下。第三方評論和用戶帳戶報告的典型時間 5-30分鐘 製作更複雜的短片。

Luma AI 需要多長時間才能完成 3D 捕捉(NeRF/Genie/手機捕捉)?

典型的 3D 擷取工作流程及其時間設定文件

Luma 的 3D 捕捉工具(移動捕捉應用程式 + 類似 Genie 的功能)可以將一組照片或一段錄製的影片轉換為類似 NeRF 的 3D 模型或紋理網格。與 Dream Machine 的短影片不同,3D 重建的工作量更大:它必須收集大量幀、估計相機姿態、優化體積幾何並合成紋理。公開教程和實踐指南報告了 實際處理時間從幾分鐘到幾個小時取決於捕獲長度和品質。一個常被引用的教學範例顯示 30分鐘到一個小時 對於中等捕獲;其他捕獲類型(長演練、高解析度幀)可能需要更長時間。

代表性範圍

- 快速物體/產品掃描(20-80 張照片,短時間拍攝): 幾分鐘到大約30分鐘.

- 房間規模或步行捕捉(數百到數千幀): 30分鐘到幾個小時,取決於輸入大小和最終導出保真度。

- 遊戲引擎的高保真導出(網格、高解析度紋理):為網格生成、重新拓撲和烘焙增加額外的時間——這可以將工作推到 個小時裡.

為什麼 3D 比短影片拍攝時間更長

3D 重建是迭代式且優化繁重的:該模型需要跨多幀細化體積場和紋理預測,這需要大量的計算。 Luma 的後端並行化了大部分工作,但每個作業的計算規模仍然大於單一短視訊的產生。

影響Luma AI處理時間的主要因素有哪些?

模型和管道選擇(Ray2、Photon、Genie、Modify Video)

不同的 Luma 模型和功能針對不同的權衡而設計:Ray2 和 Dream Machine 優先考慮照片級真實視頻生成和低延遲交互式反饋,而 Photon 和 Genie 則針對圖像增強或 3D 重建進行了優化,並且設計上可能更重。選擇保真度設定更高的模型會增加計算時間。官方文件和 API 描述了多個影響運行時的模型端點和品質標誌。

輸入大小和複雜性

- 幀數/照片數:更多輸入=更多優化步驟。

- 解析度:更高的輸出解析度和更高解析度的輸入會增加處理時間。

- 請求的剪輯的長度:較長的剪輯需要更多的渲染和運動連貫性檢查。

帳戶等級、排隊和優先級

付費訂閱和企業/API 用戶通常會獲得優先權或更高的速率限制。免費套餐用戶在系統壓力較大時通常會遇到更長的排隊時間。社群報告也證實了這一點:付費套餐通常可以減少等待時間並提高吞吐量。

系統負載和時間

實際使用者執行緒顯示,在尖峰時段或重大功能發布引發流量激增時,生成時間可能會激增。 Luma 團隊不斷更新基礎設施(請參閱更新日誌)以解決容量問題,但短暫的延遲仍然會發生。

網路/上傳時間和客戶端設備

對於擷取工作流程而言,上傳速度和裝置效能至關重要:上傳數 GB 的大型擷取檔案會延長處理開始前的等待時間。 Luma 的文檔註明了最大文件大小,並推薦了採集最佳實踐,以最大程度地減少不必要的資料傳輸。

我如何才能提前估計工作時間並減少等待?

快速估算清單

- 對你的工作進行分類:影像、短影片(<15 秒)、長影片(>15 秒)或 3D 捕捉。

- 計數輸入:照片數量/影片長度(秒)/擷取檔案大小。

- 決定品質:低、標準或高保真度-保真度越高 = 計算時間越長。

- 檢查帳戶等級:免費、付費、企業;考慮可能的排隊因素。

- 進行簡短測試:建立一個 5-10 秒的測驗作業來收集真實世界的基線。

提升吞吐量的實用技巧

- 使用建議的捕獲模式 (平滑的攝影機運動,一致的照明),因此重建收斂速度更快。 Luma 的學習中心和行動應用程式頁面提供了捕捉最佳實踐。

- 減少輸入大小 在可接受的情況下:在上傳之前裁剪、下方採樣或修剪素材,以減少處理時間和成本。

- 選擇較低品質的草稿預設,然後只有當您對構圖滿意時才以高品質完成。

- 安排非尖峰時段的繁忙班次 如果可以的話;社區報告表明,黃金時段以外的排隊人數會減少。

- 考慮 API / 企業選項 如果您需要規模和可預測的 SLA;Luma 的 API 和變更日誌顯示了對效能和新端點(如修改影片)的持續投資,以簡化工作流程。

Luma 的時間數字與其他工具相比如何?

比較產生影像/視訊或 NeRF 服務非常複雜,因為每個提供者都會針對不同的權衡(品質、速度和成本)進行最佳化。對於影像和超短視訊生成,Luma 的 Dream Machine(尤其是與 Ray2 Flash 配合使用)在亞分鐘級互動延遲方面具有競爭力,這與領先的面向消費者的生成服務水準一致。對於全場景 NeRF 捕捉和高保真 3D 模型創建,雲端運算需求和排隊推送時間比快速影像產生器更高:預計會有更大的差異,並據此制定計劃。合作夥伴文件和第三方文件通常表明 簡短的渲染需要幾分鐘,而複雜的 3D 流程則需要幾小時(甚至更長).

最終判決——多久 將 Luma 採取 my 工作?

沒有一個單一的數字適合所有使用者或所有工作。請使用以下實用的基準來估算:

- 影像生成(夢想機器): 正常負載下,每個小批次約 20-30 秒。

- 短視頻生成(Dream Machine/Ray2): 短片的播放時間為幾十秒到幾分鐘;Ray2 Flash 在支援的流程上速度會明顯更快。

- 3D捕捉→NeRF: 高度可變。 最佳情況: 對於小物體和輕物體的計算時間為數分鐘; 最壞情況(已報告): 在需求旺盛或捕獲量巨大的情況下,可能需要數小時甚至數天的時間。如果您需要確定的時間表,請購買優先/企業計劃,或進行預生產試點測試,並在您的日程安排中預留緩衝時間。

入門

CometAPI 是一個統一的 API 平台,它將來自領先供應商(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)的 500 多個 AI 模型聚合到一個開發者友好的介面中。透過提供一致的身份驗證、請求格式和回應處理,CometAPI 顯著簡化了將 AI 功能整合到您的應用程式中的過程。無論您是建立聊天機器人、影像產生器、音樂作曲家,還是資料驅動的分析流程,CometAPI 都能讓您更快地迭代、控製成本,並保持與供應商的兼容性——同時也能充分利用整個 AI 生態系統的最新突破。

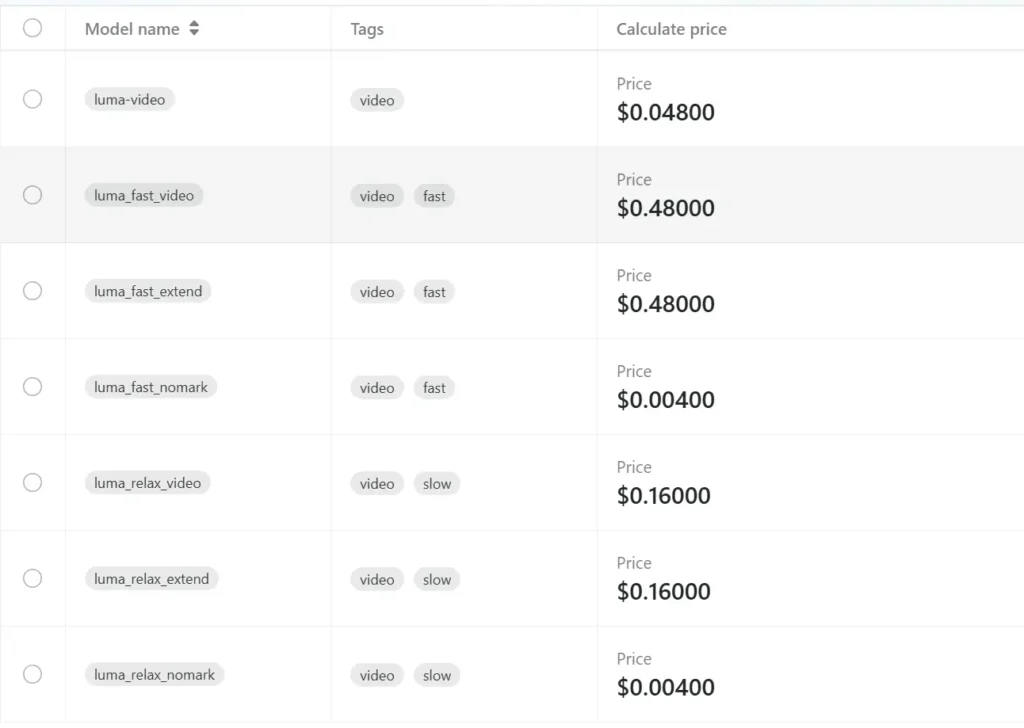

開發人員可以訪問 亮度 API 通過 彗星API,列出的最新模型版本截至本文發布之日。首先,探索該模型的功能 游乐场 並諮詢 API指南 以獲得詳細說明。造訪前請確保您已經登入CometAPI並取得API金鑰。 彗星API 提供遠低於官方價格的價格,助您整合: