中國智庫 Z.ai(原名智浦 AI)發布開源 GLM 4.5 系列,再次成為新聞焦點。 GLM-4.5 定位於現有大型語言模型的經濟高效、高性能替代方案,預計將重塑代幣經濟,並為新創公司、企業和研究機構提供民主化的使用管道。這篇綜合文章探討了 GLM-4.5 系列的起源、定價結構和實際價值,並解答了每個利害關係人心中的兩個關鍵問題:它的成本是多少?它是否值得?

什麼是 GLM 4.5 系列?

Z.ai 的 GLM 4.5 系列基於「代理」AI 框架構建,這意味著該模型可以自主地將複雜任務分解為更小、更連續的子任務,從而提高精度並減少冗餘計算。這與那些一次處理所有問題的單片 LLM 形成了鮮明對比。根據 Z.ai 介紹,GLM 4.5 在其核心架構中原生嵌入了推理和行動規劃功能,無需外部編排即可實現多步驟工作流程,例如資料視覺化生成或端對端文件處理。

GLM 4.5 系列由 Z.ai 開發,代表了最新一代開源混合專家 (MoE) 大型語言模型,旨在將高級推理、程式碼產生和代理功能統一在一個架構中。它主要有兩種版本:旗艦版 GLM 4.5 (總參數 355 B,其中活動參數 32 B)和打火機 GLM 4.5-Air (總計 106 B,活躍 12 B)。兩種變體都利用混合推理機制——「思考模式」用於複雜的、工具支援的推理,「非思考模式」用於快速、直接的完成——滿足從全端開發到自主代理工作流程的廣泛用例。

核心技術規格:

- 參數:GLM 4.5 具有 355 億個參數,每次推理都會涉及 32 億個活躍子集,以優化硬體使用率和吞吐量。

- 混合式專家 (MoE):此系列利用 MoE 架構,將令牌動態路由到專家子網路以提高效率。

- 上下文視窗:在選定平台(例如 SiliconFlow)上擴展到 128 K 令牌,以容納大型文件和程式碼庫。

- 生成速度:高速變體超過 100 個令牌/秒,適合即時應用。

- 混合推理模式:使用者可以在「思考」模式(完全啟動 MoE 進行深度推理)和「非思考」模式(最少激活進行快速、即時回應)之間切換,讓開發人員能夠對效能和速度進行細粒度的控制。

該系列中有哪些變體?

- GLM 4.5(標準):總計 355 B / 32 B 個有效參數。主要設計用於在推理、編碼和代理任務中實現性能平衡。

- GLM 4.5-Air:輕量級 106 B 總計 / 12 B 活動參數版本,針對具有嚴格硬體或延遲限制的場景量身定制 - 提供同類產品中具有競爭力的準確性。

GLM 4.5 系列的價格是多少?

輸入和輸出代幣價格是多少?

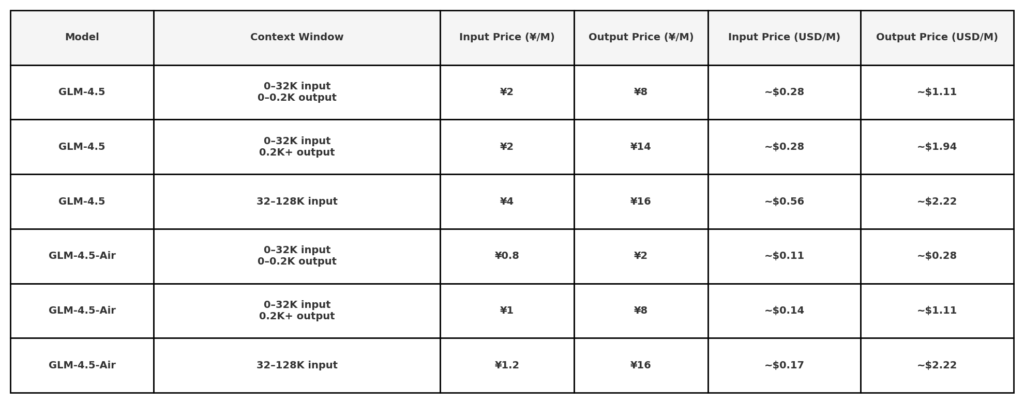

根據 Z.ai 的公共 API 定價揭露,GLM 4.5 的定價為:

注意:非常低的費率($0.11/$0.28)可能僅限於小令牌長度或特定促銷活動。限時所有型號 50% 折扣,有效期至 31 年 2025 月 XNUMX 日。其他型號請參考 辦公室價格頁面.

在 CometAPI 上,該系列捆綁了略有不同的分級定價,請參閱 GLM-4.5 API:

| 型號 | 介紹 | 價格 |

glm-4.5 | 我們最強大的推理模型,擁有 355 億個參數 | 輸入代幣 0.48 美元 輸出代幣 1.92 美元 |

glm-4.5-air | 經濟實惠 輕量級 性能強勁 | 輸入代幣 0.16 美元 輸出代幣 1.07 美元 |

glm-4.5-x | 高性能強推理超快速反應 | 輸入代幣 1.60 美元 輸出代幣 6.40 美元 |

glm-4.5-airx | 輕量級 強勁性能 超快響應 | 輸入代幣 0.02 美元 輸出代幣 0.06 美元 |

glm-4.5-flash | 性能強勁,非常適合推理編碼和代理 | 輸入代幣 3.20 美元 輸出代幣 12.80 美元 |

GLM 4.5 的定價與 DeepSeek 和 Western LLM 相比如何?

在 2025 年世界人工智慧大會上,Z.ai 明確將 GLM 4.5 定位為 DeepSeek(中國之前的成本領先者)的挑戰者,承諾其「代幣成本僅為其一小部分」且硬體佔用空間僅為 DeepSeek R1 模型的一半。

- 深尋R1:每百萬代幣約有 0.14 美元的投入和 0.60 美元的輸出。

- GLM 4.5:聲稱在輸入和輸出方面都比 DeepSeek 低 20–30%。

- 西方基準:OpenAI 的 GPT-4 和Google的 Gemini 的價格範圍為每百萬代幣 3 至 15 美元,這使得 GLM 4.5 的成本降低了一個數量級。

這種定價策略反映了中國更廣泛的人工智慧經濟模式:更精簡的計算、更小的模型以及積極的削價以搶佔市場份額。

GLM 4.5 系列值得嗎?

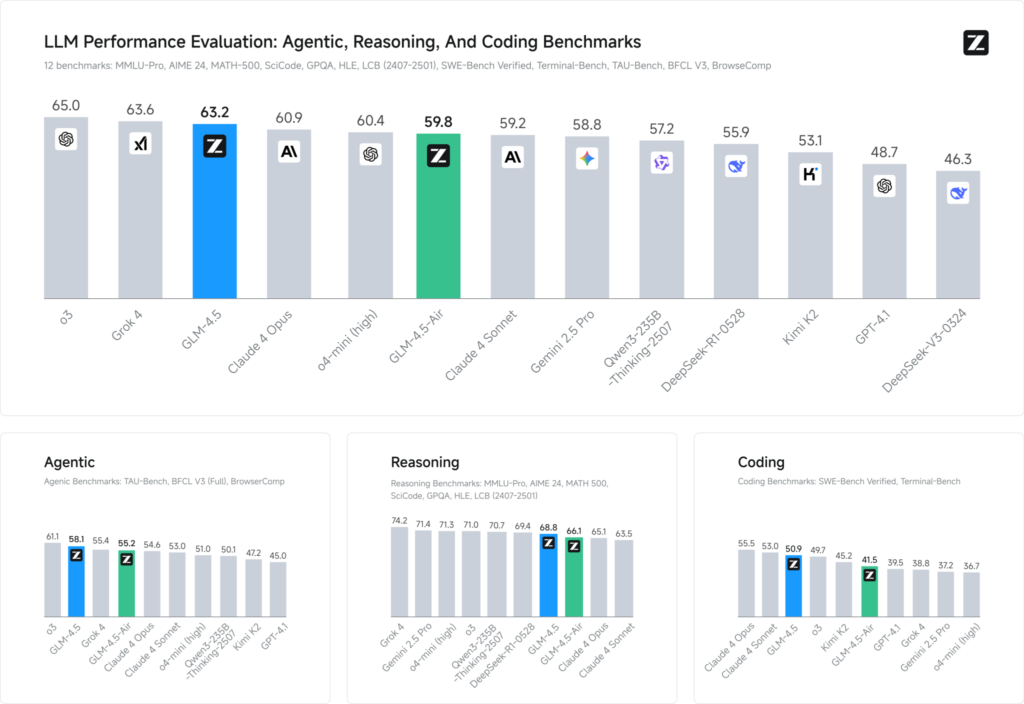

對 12 個代表性資料集(涵蓋 MMLU Pro、MATH 500、SciCode、Terminal-Bench 和 TAU-Bench)的基準評估表明,GLM 4.5 在全球排名第三,僅次於 xAI 的 Grok 3 和 OpenAI 的 o4,但在開源產品中排名第一。

在編碼任務(LiveCodeBench、SWE-Bench)中,GLM 4.5 的混合專家設計有助於實現頂級程式碼產生品質;而在推理(AIME 24、MMLU Pro)中,其多步驟規劃可實現與閉源同類產品相當的穩健準確率。輕量級 Air 變體在其參數範圍內(100 B 規模)保持了具有競爭力的得分,使其成為邊緣部署和嵌入式系統的誘人選擇。

績效基準

- 智力指數:GLM 4.5 分數 66 在綜合智力指數(MMLU Pro、MATH 500、AIME 24)上,超過了許多開源和商業中端模型。

- 推理延遲:第一個令牌的平均時間 0.89秒,對於複雜的推理任務具有競爭力,但與一些優化的閉源模型相比,吞吐量略慢(≈45.7 個令牌/秒)。

- 代理工作流程:展示了對多步驟工具使用和動態程式碼產生的強大命令,其勝率高達 對陣 Kimi K54 的命中率為 ~2% 81% 針對 Qwen3‑Coder 在獨立編碼評估中。

哪些實際用例可以顯示投資報酬率?

- 全端開發:GLM-4.5 可以透過多輪提示建立整個 Web 應用程式(從 HTML/CSS/JavaScript 中的前端佈局到後端資料庫模式),將原型製作週期從幾天縮短到幾小時。

- 複雜文件分析:擴展的 128 K 上下文視窗使法律、金融和科學公司能夠一次解析多頁合約或研究報告,從而減少分割開銷。

- 自動化代理商工作流程:混合推理允許創建自主腳本(例如,網頁抓取機器人、交易代理),這些腳本可以透過多步驟過程進行推理,而只需最少的人為幹預。

定量案例研究表明 60% 減少開發人員執行以程式碼為中心的任務的時間 40% 更快完成長篇內容分析。

潛在的缺點和注意事項是什麼?

任何技術都存在利弊權衡。潛在的採用者應留意監管、營運和生態系統等因素。

限制

支援和服務等級協定 (SLA):與商業提供者不同,開源提供者可能不提供企業級 SLA 或全天候支援。

吞吐量約束:雖然上下文視窗很大,但每秒令牌的速率落後於一些推理優化的閉源對應物,可能會影響即時應用程式。

營運開銷:自架 MoE 模型需要精心編排(專家路由、記憶體管理),以避免效能瓶頸和成本超支。

需要哪些基礎建設投資?

- 計算佔用空間: 即使具有 MoE 效率,託管 GLM-4.5 的標準版本也需要具有 ≥80 GB 記憶體的 GPU 和強大的 NVLink 互連以實現低延遲推理。

- 微調開銷: 針對特定領域的任務自訂模型可能需要大量的 GPU 週期,從而在實現令牌計費節省之前增加前期成本。

- 保養: 內部部署將更新、安全性修補程式和擴充功能的責任從供應商轉移到內部 DevOps 團隊。

如何開始使用 GLM-4.5?

開始 GLM-4.5 整合涉及幾個簡單的步驟 - 特別是考慮到開源劇本和廣泛的第三方支援。

哪些 API 和平台支援 GLM-4.5?

- 彗星API API:完全相容 OpenAI 的端點,具有 Python、JavaScript 和 Java 中的 SDK。

- 直接 Z.ai 端點:提供官方支援和早期存取功能,例如多代理編排。

- 社區鏡像:快速成長的開源執行時間主機(例如,Ollama、AutoGPT-CLI),可實現本地推理。

開發人員可以在哪裡找到工具和文件?

- Z.ai 官方文件: 有關安裝、快速工程和 MoE 優化的綜合指南。

- GitHub 儲存庫: 用於程式碼產生、檢索增強生成 (RAG) 和與主要編排工具相容的代理框架的範例筆記本。

- 社區論壇: Hugging Face 等平台上的活躍討論板,從業者在這裡分享微調配方、提示庫和效能基準。

結論

GLM-4.5 系列在當今競爭激烈的人工智慧領域樹立了顯著的標竿:為開發者、企業和研究機構提供無與倫比的性價比。代幣價格低至每百萬輸入代幣 0.11 美元,每百萬輸出代幣 0.28 美元(促銷折扣進一步降低了 50%),其基準性能堪比甚至超越更大型的專有模型,GLM-4.5 為以代碼為中心的應用、長格式理解和代理工作流程帶來了可觀的投資回報。

入門

CometAPI 是一個統一的 API 平台,它將來自領先供應商(例如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等)的 500 多個 AI 模型聚合到一個開發者友好的介面中。透過提供一致的身份驗證、請求格式和回應處理,CometAPI 顯著簡化了將 AI 功能整合到您的應用程式中的過程。無論您是建立聊天機器人、影像產生器、音樂作曲家,還是資料驅動的分析流程,CometAPI 都能讓您更快地迭代、控製成本,並保持與供應商的兼容性——同時也能充分利用整個 AI 生態系統的最新突破。

開發人員可以訪問 GLM-4.5 空氣 API GLM-4.5 API 通過 彗星API,列出的最新版本的 Claude 模型截至本文發布日期。首先,探索該模型的功能 游乐场 並諮詢 API指南 以獲得詳細說明。造訪前請確保您已經登入CometAPI並取得API金鑰。 彗星API 提供遠低於官方價格的價格,幫助您整合。