在 2025–2026 年,AI 工具版圖持續整合:閘道 API(例如 CometAPI)擴展以提供類 OpenAI 的介面存取數百款模型,而終端使用者的 LLM 應用(例如 AnythingLLM)則持續改進其「Generic OpenAI」提供者,讓桌面與本地優先的應用能呼叫任何相容 OpenAI 的端點。這使得如今可輕鬆將 AnythingLLM 的流量透過 CometAPI 路由,享有模型選擇、成本路由與統一計費等優勢,同時仍使用 AnythingLLM 的本地 UI 與 RAG/代理功能。

什麼是 AnythingLLM,為什麼要將它連接到 CometAPI?

什麼是 AnythingLLM?

AnythingLLM 是一個開源、全功能的 AI 應用與本地/雲端用戶端,用於建立聊天助理、檢索增強生成(RAG)工作流程,以及由 LLM 驅動的代理。它提供流暢的 UI、開發者 API、工作區/代理功能,並支援本地與雲端 LLM——預設以隱私為核心,並可透過外掛擴充。AnythingLLM 暴露了一個 Generic OpenAI 提供者,使其能與相容 OpenAI 的 LLM API 溝通。

什麼是 CometAPI?

CometAPI 是一個商用的 API 聚合平台,透過單一類 OpenAI 的 REST 介面與統一計費,提供對 500+ AI 模型 的存取。實務上,它讓你能透過相同的 https://api.cometapi.com/v1 端點與單一 API 金鑰(格式為 sk-xxxxx),呼叫多家供應商的模型(OpenAI、Anthropic、Google/Gemini 變體、影像/音訊模型等)。CometAPI 支援標準的 OpenAI 風格端點,例如 /v1/chat/completions、/v1/embeddings 等,讓已支援 OpenAI 相容 API 的工具得以輕鬆適配。

為什麼要將 AnythingLLM 與 CometAPI 整合?

三個實用理由:

- 模型選擇與供應商彈性:AnythingLLM 可透過其 Generic OpenAI 包裝器使用「任何相容 OpenAI」的 LLM。將該包裝器指向 CometAPI,即可在不改動 AnythingLLM UI 或流程的情況下,立即存取數百款模型。

- 成本/營運最佳化:使用 CometAPI 可集中切換模型(或降級至更便宜的模型)以控管成本,並將帳單統一,而非管理多個供應商金鑰。

- 更快的試驗迭代:你可在相同的 AnythingLLM UI 中 A/B 不同模型(例如

gpt-4o、gpt-4.5、Claude 變體或開源多模態模型),用於代理、RAG 回覆、摘要與多模態任務。

整合前需要準備的環境與條件

系統與軟體要求(高層次)

- 可執行 AnythingLLM 的桌面或伺服器(Windows、macOS、Linux)——桌面安裝或自託管實例。確認你使用的是具備「LLM Preferences / AI Providers」設定的近期版本。

- CometAPI 帳號與 API 金鑰(

sk-xxxxx形式的祕鑰)。你會在 AnythingLLM 的 Generic OpenAI 提供者中使用它。 - 你的機器可連線至

https://api.cometapi.com的網路連通性(防火牆不可阻擋對外的 HTTPS)。 - 選用但建議:現代的 Python 或 Node 環境以進行測試(Python 3.10+ 或 Node 18+)、curl,以及 HTTP 用戶端(Postman / HTTPie),在接入 AnythingLLM 前先驗證 CometAPI。

AnythingLLM 特定條件

Generic OpenAI LLM 提供者是模擬 OpenAI API 表面的端點之推薦路徑。AnythingLLM 的文件提醒此提供者偏向開發者使用,你應理解自己提供的輸入。若你使用串流或你的端點不支援串流,AnythingLLM 在 Generic OpenAI 中提供了可停用串流的設定。

安全與運維檢查清單

- 將 CometAPI 金鑰視為機密——不要提交至版本庫;盡量儲存在作業系統金鑰鏈或環境變數中。

- 如果你計畫在 RAG 中使用敏感文件,請確保端點的隱私保證符合你的合規需求(檢視 CometAPI 的文件/條款)。

- 針對最大 tokens 與上下文視窗做決策,防止失控的費用。

如何將 AnythingLLM 配置為使用 CometAPI(逐步)?

以下為具體步驟——之後附上環境變數與程式碼片段,便於在將設定寫入 AnythingLLM UI 前先測試連線。

步驟 1 — 取得你的 CometAPI 金鑰

- 在 CometAPI 註冊或登入。

- 前往「API Keys」產生金鑰——你會獲得一個看起來像

sk-xxxxx的字串。請妥善保管。

步驟 2 — 以快速請求驗證 CometAPI 可用

使用 curl 或 Python 呼叫簡單的聊天補全端點,確認連線無誤。

cURL 範例

curl -X POST "https://api.cometapi.com/v1/chat/completions" \

-H "Authorization: Bearer sk-xxxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "gpt-4o",

"messages": ,

"max_tokens": 50

}'

若返回 200,且 JSON 響應中包含 choices 陣列,表示你的金鑰與網路均正常。(CometAPI 的文件展示了其 OpenAI 風格的表面與端點)

Python 範例(requests)

import requests

url = "https://api.cometapi.com/v1/chat/completions"

headers = {"Authorization": "Bearer sk-xxxxx", "Content-Type": "application/json"}

payload = {

"model": "gpt-4o",

"messages": ,

"max_tokens": 64

}

r = requests.post(url, json=payload, headers=headers, timeout=15)

print(r.status_code, r.json())

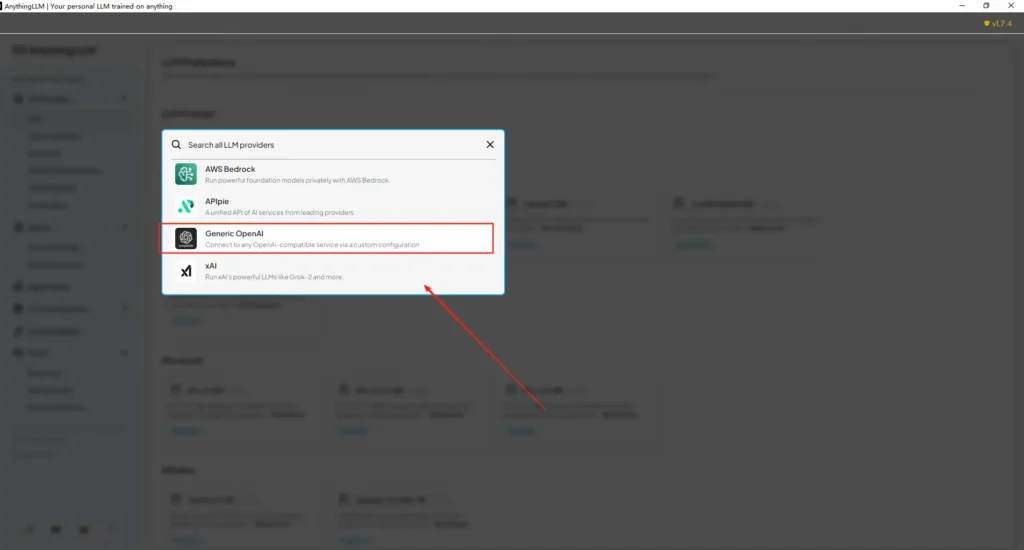

步驟 3 — 配置 AnythingLLM(UI)

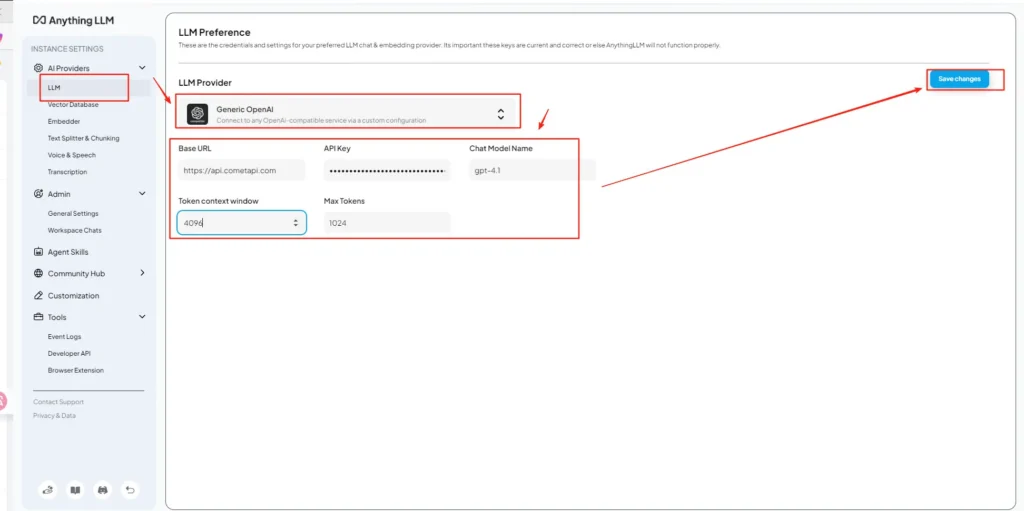

開啟 AnythingLLM → Settings → AI Providers → LLM Preferences(或你版本中的相近路徑)。使用 Generic OpenAI 提供者,並依下列方式填寫:

API Configuration(範例)

• 進入 AnythingLLM 設定選單,在 AI Providers 下找到 LLM Preferences。

• 選擇 Generic OpenAI 作為模型提供者,在 URL 欄位輸入https://api.cometapi.com/v1。

• 將來自 CometAPI 的sk-xxxxx貼入 API key 欄位。依實際模型填入 Token 上下文視窗與 Max Tokens。你也可以在此頁自訂模型名稱,例如新增gpt-4o模型。

此作法符合 AnythingLLM 的「Generic OpenAI」指引(開發者包裝器)與 CometAPI 的 OpenAI 相容基底 URL。

步驟 4 — 設定模型名稱與 Token 限制

在同一個設定頁面,依照 CometAPI 公布的名稱精確新增或自訂模型名稱(例如 gpt-4o、minimax-m2、kimi-k2-thinking),以便 AnythingLLM 的 UI 將這些模型呈現給使用者。CometAPI 會為各供應商公布模型字串。

步驟 5 — 在 AnythingLLM 中測試

啟動新對話或使用現有工作區,若你有多個提供者請選擇 Generic OpenAI,挑選你新增的某個 CometAPI 模型,執行簡單提示詞。若得到連貫的回覆,即表示整合成功。

AnythingLLM 內部如何使用這些設定

AnythingLLM 的 Generic OpenAI 包裝器會構造 OpenAI 風格的請求(/v1/chat/completions、/v1/embeddings),因此只要指定基底 URL 並提供 CometAPI 金鑰,AnythingLLM 就會透明地將聊天、代理呼叫與嵌入請求經由 CometAPI 路由。若你使用 AnythingLLM 的代理(@agent 流程),它們也會沿用相同提供者。

最佳實踐與可能的陷阱有哪些?

最佳實踐

- 使用符合模型的上下文設定:在 AnythingLLM 中的 Token 上下文視窗與 Max Tokens 應與你在 CometAPI 選擇的模型一致。設定不匹配會導致意外截斷或呼叫失敗。

- 保護你的 API 金鑰:將 CometAPI 金鑰儲存在環境變數與/或 Kubernetes/祕密管理工具中;切勿提交至 git。若在 UI 輸入金鑰,AnythingLLM 會將其儲存在本地設定——請將主機儲存視為敏感資產。

- 以較便宜/較小的模型起步:在開發過程先以低成本模型試驗,將高階模型保留給正式環境。CometAPI 明確支援成本切換與統一計費。

- 監控使用量並設定警示:CometAPI 提供使用量儀表板——設定預算/警報以避免意外帳單。

- 隔離測試代理與工具:AnythingLLM 的代理可觸發動作;請先在安全提示詞與測試環境中驗證。

常見陷阱

- UI 與

.env衝突:自託管時,UI 設定可能覆寫.env(反之亦然)。若重啟後設定被還原,請檢查產生的/app/server/.env。社群曾回報LLM_PROVIDER重置。 - 模型名稱不匹配:使用 CometAPI 未提供的模型名稱會導致閘道返回 400/404。請務必在 CometAPI 模型清單確認可用模型。

- Token 限制與串流:若你需要串流回覆,請確認該 CometAPI 模型支援串流(以及你的 AnythingLLM UI 版本也支援)。不同供應商在串流語義上可能存在差異。

此整合可實現哪些實際用例?

檢索增強生成(RAG)

使用 AnythingLLM 的文件載入器 + 向量資料庫,搭配 CometAPI 的 LLM 產生具上下文的回答。你可嘗試「便宜的嵌入 + 昂貴的聊天」組合,或全部交由 CometAPI 以統一計費。RAG 流程是 AnythingLLM 的核心內建功能。

代理自動化

AnythingLLM 支援 @agent 工作流程(瀏覽頁面、呼叫工具、運行自動化)。將代理的 LLM 呼叫透過 CometAPI 路由,可在控制/解讀階段自由選擇模型,無需修改代理程式碼。

多模型 A/B 測試與成本優化

可依工作區或功能切換模型(例如生產用 gpt-4o、開發用 gpt-4o-mini)。CometAPI 讓模型替換變得簡單,並集中成本管理。

多模態流程

CometAPI 提供影像、音訊與專用模型。AnythingLLM 的多模態支援(透過提供者)結合 CometAPI 的模型,讓圖像標註、多模態摘要或音訊轉寫等流程,皆可透過同一介面完成。

結論

CometAPI 持續定位為多模型閘道(500+ 模型、OpenAI 風格 API),這使其天然適配像 AnythingLLM 這類已支援 Generic OpenAI 提供者的應用。同樣地,AnythingLLM 的 Generic 提供者與近期的設定選項,讓連接此類閘道變得直觀。這種趨勢在 2025 年後期簡化了試驗與生產遷移。

如何開始使用 Comet API

CometAPI 是一個整合超過 500 種 AI 模型的統一 API 平台,涵蓋領先供應商——如 OpenAI 的 GPT 系列、Google 的 Gemini、Anthropic 的 Claude、Midjourney、Suno 等——並匯聚於單一、對開發者友善的介面。透過一致的驗證機制、請求格式與回應處理,CometAPI 大幅簡化了在你的應用中整合 AI 能力的流程。無論你在打造聊天機器人、圖像生成、音樂創作,或資料驅動的分析管線,CometAPI 都能讓你更快速迭代、控管成本、保持供應商中立,同時掌握 AI 生態中的最新突破。

要開始,探索 CometAPI 的模型能力於 Playground,並參考 API guide 以取得詳細說明。存取前,請先登入 CometAPI 並取得 API 金鑰。CometAPI 提供遠低於官方價格的費率,協助你快速接入。

準備好了嗎?→ Sign up for CometAPI today!