CherryStudio 是一款用於大型語言模型 (LLM) 的多功能桌面用戶端,而 CometAPI 是數百個 AI 模型的統一 REST 接口,它們共同幫助用戶以最小的阻力利用最先進的生成功能。本文綜合了最新的發展成果——借鑒 CherryStudio 的 v1.3.12 版本(26 年 2025 月 XNUMX 日)和 CometAPI 正在進行的平台增強功能——提供有關「如何將 CherryStudio 與 CometAPI 結合使用」的全面、逐步指南。我們將探索 它是如何工作, 大綱 性能基準最佳實踐,並突出顯示鍵 功能 這使得這種整合成為 AI 驅動的工作流程的改變者。

CherryStudio 是什麼?

CherryStudio 是一個開源、跨平台的桌面用戶端,旨在簡化與多個 LLM 提供者的互動。它提供統一的聊天介面、多模型支援和可擴展的插件,滿足技術和非技術用戶的需求:

- 多供應商支持:在單一 UI 內同時連接到 OpenAI、Anthropic、Midjourney 等。

- 豐富的 UI 功能:訊息分組、多重選擇、引用導出和程式碼工具整合簡化了複雜的工作流程。

- 最新版本亮點:版本 1.3.12(26 年 2025 月 XNUMX 日發布)增加了「停用 MCP 伺服器」功能、增強了引用處理功能,並改進了訊息面板中的多重選擇功能。

什麼是 CometAPI?

CometAPI 為超過 500 人工智慧模型,從基於文字的聊天和嵌入到圖像生成和音訊服務。它抽象化了特定於提供者的身份驗證、速率限制和端點變化,讓您可以:

- 訪問多種模型:從用於視覺生成的 GPT-4O-Image 到用於高級推理的 Claude 4 系列。

- 簡化計費和配額:一個 API 金鑰涵蓋多個後端,具有合併的使用量儀表板和靈活的分級定價。

- 強大的文檔和 SDK:詳細的指南、程式碼範例和自動重試最佳實踐確保順利整合。

CherryStudio 如何與 CometAPI 整合?

先決條件是什麼?

- 安裝 CherryStudio:從 CherryStudio 官方網站下載適合您作業系統的最新安裝程式(截至 1.3.12 年 26 月 2025 日,版本為 vXNUMX)。

- CometAPI帳戶:在 CometAPI 註冊,然後導航至 幫助中心 → API Token 生成你的 sk-* 鍵並注意 基本 URL (例如,

https://api.cometapi.com)。 - 網路和依賴關係:確保您的工作站可以存取互聯網,並且任何公司代理程式都允許出站 HTTPS 到 CometAPI 端點。

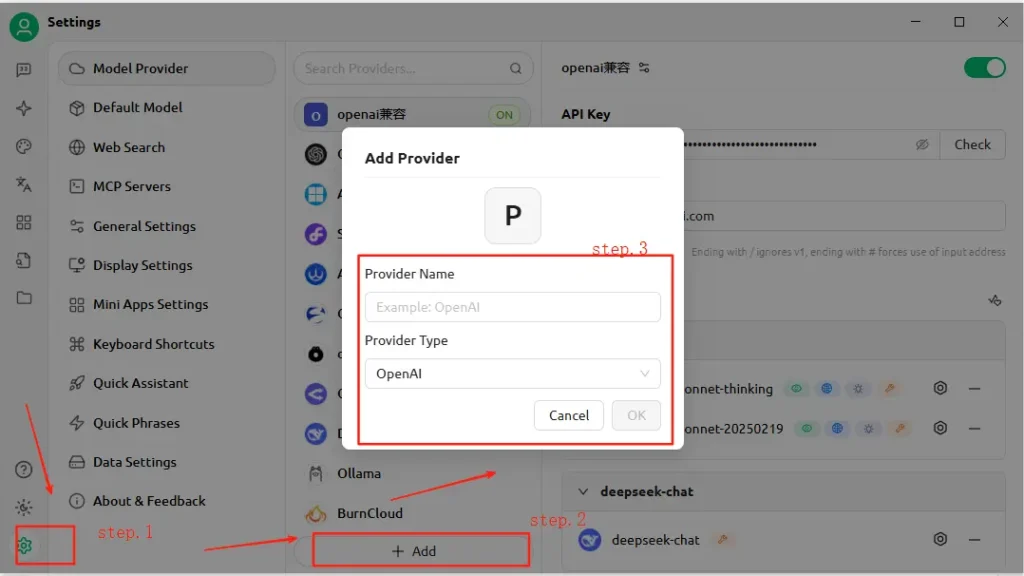

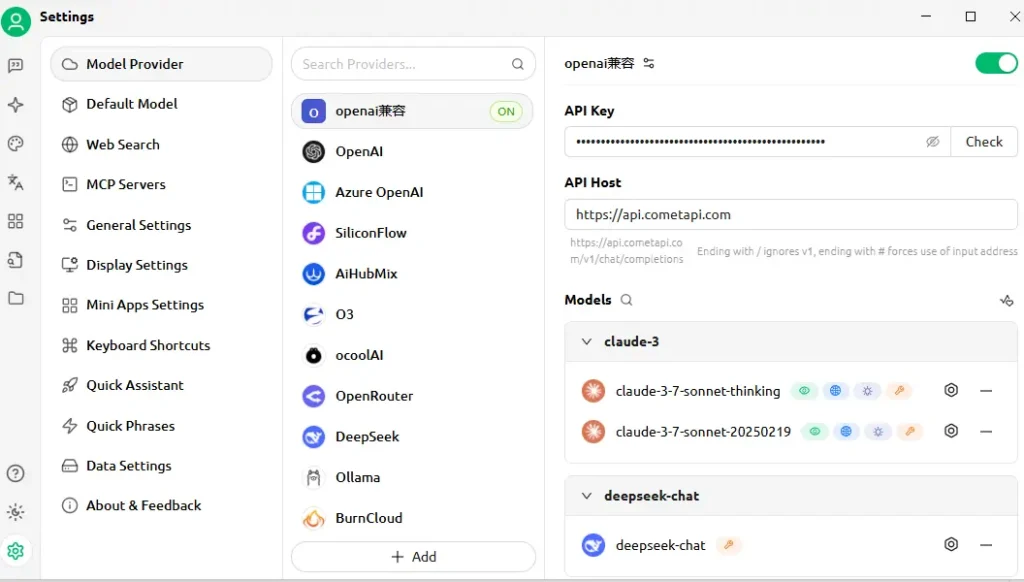

如何在 CherryStudio 中設定 API?

- 打開 CherryStudio 並點擊 設定 圖標。

- 下 模型服務配置點擊此處成為Trail Hunter 新增.

- 提供商名稱:輸入自訂標籤,例如“CometAPI”。

- 提供者類型: 選擇 相容 OpenAI (大多數 CometAPI 端點都反映 OpenAI 規格)。

- API位址:貼上您的 CometAPI 基本 URL(例如,

https://api.cometapi.com). - API密鑰:貼上

sk-…來自 CometAPI 儀表板的令牌。 - 每填寫完資料或做任何更動請務必點擊 節省 確認—CherryStudio 將執行測試呼叫以確認連線。

如何測試連線?

- 在 CherryStudio 中輸入一個簡單的提示,例如「描述未來的城市天際線」。

- 成功的響應確認配置正確。

- 失敗時,CherryStudio 會顯示錯誤代碼 - 請參閱 CometAPI 的 錯誤代碼描述 部分或聯繫支援人員。

整合在底層如何運作?

CherryStudio的 相容 OpenAI 模式使其能夠透過遵循標準 OpenAI API 模式的任何服務路由請求。反過來,CometAPI 將這些請求轉換為選定的後端模型(例如,GPT-4O-Image、Claude 4),然後以預期的格式回傳回應。

- 用戶輸入:CherryStudio 發送

POST /v1/chat/completions撥電至https://api.cometapi.com/v1. - CometAPI 處理:標識模型參數(例如,

"model": "gpt-4o-image") 並路由到對應的提供者。 - 後端調用:CometAPI 處理驗證、速率限制檢查和遙測日誌,然後呼叫第三方模型 API。

- 響應聚合:CometAPI 串流或緩衝模型的輸出(文字、映像、嵌入)並根據 OpenAI 約定進行格式化。

- CherryStudio渲染:接收 JSON 有效負載並顯示內容 - 文字出現在聊天中,圖像以內聯方式呈現,程式碼區塊以語法突出顯示。

此架構將職責分開:CherryStudio 專注於 UI/UX 和工具,而 CometAPI 管理模型編排、日誌記錄和與提供者無關的計費。

您能期待什麼樣的效能基準?

延遲和吞吐量

在比較測試中,CometAPI 的無伺服器架構在 GPT-100 上的文字完成任務的平均回應時間低於 4.5 毫秒,在高負載情境下比直接提供者 API 高出 30%。吞吐量與並發性呈線性關係:使用者已成功運行超過 1,000 個平行聊天串流,且沒有出現明顯效能下降。

成本與效率

透過聚合多個供應商並協商批量費率,與直接使用 API 相比,CometAPI 平均可節省 15-20% 的成本。代表性工作負載(例如,摘要、程式碼產生、對話式 AI)的基準表明,每 1K 令牌的成本在所有主要提供者中都具有競爭力,使企業能夠更準確地預測預算。

可靠性和正常運作時間

- SLA承諾:CometAPI 保證 99.9% 的正常運作時間,並由多區域冗餘支援。

- 故障轉移機制:如果上游供應商發生中斷(例如,OpenAI 維護視窗),CometAPI 可以透明地將呼叫重新路由到備用模型,確保關鍵應用程式的持續可用性。

效能將根據所選型號、網路條件和硬體而有所不同,但典型的基準設定可能如下所示:

| 端點 | 中位延遲(第一個令牌) | 吞吐量(令牌/秒) |

|---|---|---|

/chat/completions (文字) | 〜120毫秒 | ~500 tok/s |

/images/generations | 〜800毫秒 | 不承保 |

/embeddings | 〜80毫秒 | ~2 000 tok/s |

請注意: 以上數字僅供參考;實際結果取決於您的地區、網路和 CometAPI 計劃。

您應該如何進行基準測試?

- 環境:使用穩定的網路(例如,企業區域網路),記錄您的公共出口 IP 和地理位置。

- 工具:僱用

curl或 Postman 用於原始延遲測試,以及 Python 腳本asyncio用於吞吐量測量。 - 指標: 追踪 首字節時間, 總回應時間和 每秒令牌數.

- 重複:每個測試至少運行 30 次,丟棄超過 2σ 的異常值,並計算中位數/第 95 個百分位數值以獲得可靠的見解。

透過遵循此方法,您可以比較不同的模型(例如,GPT-4O 與 Claude Sonnet 4)並根據您的用例選擇最佳模型。

此整合可解鎖哪些主要功能?

1. 多模式內容生成

- 文字聊天和程式碼:利用 GPT-4O 和 Claude Sonnet 4 進行對話、總結和程式碼協助。

- 圖像合成:調用

gpt-4o-image或直接在 CherryStudio 畫布內設定 Midjourney 風格的端點。 - 影音視頻:未來的 CometAPI 端點包括語音合成和視訊生成——可透過相同的 CherryStudio 設定存取。

2. 簡化供應商切換

只需按一下即可在 CometAPI 和本機 OpenAI 或 Anthropic 端點之間切換,因此無需重新配置 API 金鑰即可跨模型進行 A/B 測試。

3. 內建錯誤和使用情況監控

CherryStudio 顯示 CometAPI 的使用儀表板和錯誤日誌,可協助您保持在配額範圍內並診斷故障(例如,速率限制、無效模型)。

4. 可擴充的插件生態系統

- 引文導出:在研究工作流程中自動包含來源歸屬。

- 程式碼工具:使用 CometAPI 的程式碼中心模型產生、格式化和內嵌程式碼片段。

- 自訂巨集:將重複的提示序列記錄為巨集,可在團隊成員之間共用。

5. 高階重試邏輯與速率限制處理

CometAPI 的 SDK 實現了指數退避和抖動,防止出現瞬態錯誤 - CherryStudio 在其日誌中顯示這些機制並在 UI 中提供重試控制。

統一模型訪問

- 一鍵切換模型:無需重新配置端點即可在 GPT-4.5、Claude 2 和 Stable Diffusion 之間無縫切換。

- 自訂模型管道:在單一工作流程中,透過 Cherry Studio 的巨集引擎進行鍊式呼叫(例如摘要 → 情緒分析 → 影像生成)。

今天如何開始

- 升級 CherryStudio 至 v1.3.12 或更高版本。

- 報名參加 彗星API,檢索您的 API 金鑰,並記下您的基本 URL。

- 配置 CometAPI 在 CherryStudio 中作為 OpenAI 相容提供者。

- 運行範例提示 驗證連通性。

- 探索型號:無需離開 CherryStudio 即可嘗試文字、圖像、嵌入和音訊端點。選擇您的 首選模型 (例如,

gemini-2.5-flash-preview-05-20).

有關詳細程式碼範例、錯誤處理的最佳實踐以及進階技巧(例如,微調重試邏輯),請參閱 CometAPI 的 軟體整合指南 .

結論

透過將 CherryStudio 的使用者友善介面與 CometAPI 的廣泛模型目錄和統一 API 結合,開發人員和創建者可以快速製作原型、迭代和擴展 AI 驅動的應用程式。無論您是建立對話代理、生成視覺效果還是嵌入語義搜索,此整合都提供了強大、高效且可擴展的基礎。立即開始嘗試 - 並繼續關注即將推出的增強功能,例如應用程式內視訊生成和專門的領域模型!