Gemini 2.5 Flash 的設計旨在在不犧牲輸出品質的前提下,提供快速回應。它支援多模態輸入,包括文字、影像、音訊與視訊,適用於多元應用。該模型可透過 Google AI Studio 與 Vertex AI 等平台存取,為開發者提供無縫整合至各類系統所需的工具。

基本資訊(功能)

Gemini 2.5 Flash 引入多項亮點功能,使其在 Gemini 2.5 系列中脫穎而出:

- 混合推理:開發者可設定 thinking_budget 參數,以精細控制模型在輸出前用於內部推理的權杖數量。

- 帕累托前沿:定位於最佳成本效能點,Flash 在 2.5 系列中提供最佳性價比。

- 多模態支援:原生處理文字、影像、視訊與音訊,實現更豐富的對話與分析能力。

- 100 萬權杖上下文:無可匹敵的上下文長度,讓單次請求即可進行深度分析與長文理解。

模型版本

Gemini 2.5 Flash 已歷經以下關鍵版本:

- gemini-2.5-flash-lite-preview-09-2025: 增強工具可用性:在複雜、多步驟任務上的表現提升,SWE-Bench Verified 分數提高 5%(由 48.9% 提升至 54%)。效率提升:啟用推理時,以更少的權杖產出更高品質輸出,降低延遲與成本。

- Preview 04-17:具備「思考」能力的搶先體驗版本,可透過 gemini-2.5-flash-preview-04-17 使用。

- 穩定版全面可用(GA):自 2025 年 6 月 17 日起,穩定端點 gemini-2.5-flash 取代預覽版,並在維持 5 月 20 日預覽版 API 不變的前提下,確保生產級可靠性。

- 預覽版淘汰:預覽端點計畫於 2025 年 7 月 15 日關閉;使用者須於該日前遷移至 GA 端點。

截至 2025 年 7 月,Gemini 2.5 Flash 已公開穩定可用(與 gemini-2.5-flash-preview-05-20 無變更)。若您使用 gemini-2.5-flash-preview-04-17,現有的預覽定價將持續至 2025 年 7 月 15 日該模型端點按計畫淘汰之時,屆時端點將關閉。您可以遷移至全面可用的模型 gemini-2.5-flash。

更快、更便宜、更聰明:

- 設計目標:低延遲 + 高吞吐 + 低成本;

- 在推理、多模態處理與長文本任務上整體加速;

- 權杖使用量降低 20–30%,大幅降低推理成本。

技術規格

輸入上下文視窗:最多 100 萬個權杖,支援大幅度的上下文保留。

輸出權杖:單次回應可產生最多 8,192 個權杖。

支援的模態:文字、影像、音訊與視訊。

整合平台:可透過 Google AI Studio 與 Vertex AI 使用。

定價:具競爭力的權杖計費模型,有助於具成本效益的部署。

技術細節

在底層實作上,Gemini 2.5 Flash 是一個以 transformer 為基礎的大型語言模型,訓練資料涵蓋網頁、程式碼、影像與視訊。關鍵技術規格包括:

多模態訓練:透過多種模態對齊訓練,Flash 可無縫混合文字與影像、視訊或音訊,適用於影片摘要或音訊描述等任務。

動態思考流程:實作內部推理循環,模型會在最終輸出前進行規劃並拆解複雜提示。

可配置的思考預算:thinking_budget 可從 0(無推理)設為最高 24,576 權杖,允許在延遲與答案品質間取捨。

工具整合:支援 Grounding with Google Search、Code Execution、URL Context 與 Function Calling,能從自然語言提示直接驅動真實世界動作。

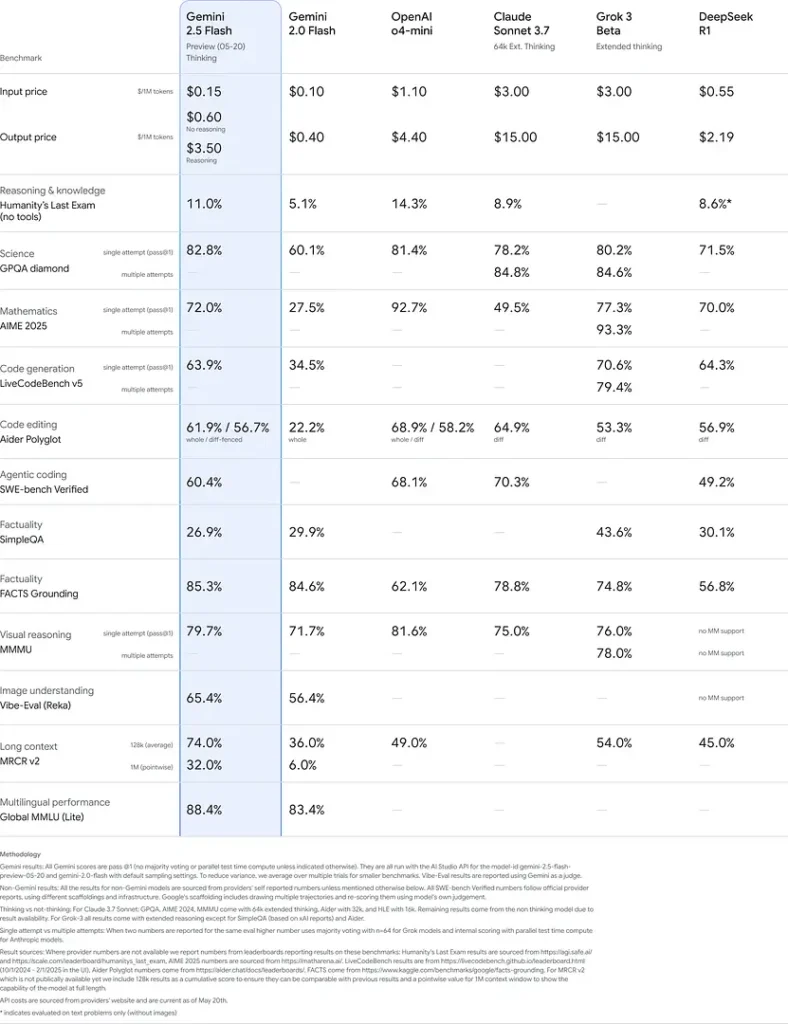

基準測試表現

在嚴格的評測中,Gemini 2.5 Flash 展現出業界領先的表現:

- LMArena Hard Prompts:在具挑戰性的 Hard Prompts 基準上僅次於 2.5 Pro,展現強大的多步推理能力。

- MMLU 分數 0.809:以 0.809 的 MMLU 準確率超越模型平均水準,體現其廣泛領域知識與推理實力。

- 延遲與吞吐:解碼速度達 271.4 tokens/sec,0.29 s Time-to-First-Token,非常適合對延遲敏感的工作負載。

- 性價比領先:以 \$0.26/1 M tokens 的價格,Flash 在關鍵基準上表現持平或超越同類同時壓低成本。

這些結果顯示 Gemini 2.5 Flash 在推理、科學理解、數學問題求解、程式設計、視覺理解與多語言能力方面具備競爭優勢:

侷限

- 安全風險:模型可能呈現「說教式」語氣,並在邊界案例查詢中特別容易產生看似合理但實則錯誤或帶偏見的輸出(幻覺)。嚴格的人為審查仍然至關重要。

- 速率限制:API 使用受速率限制(在預設等級為 10 RPM、250,000 TPM、250 RPD),可能影響批次處理或高流量應用。

- 智能下限:作為 flash 模型雖然表現優異,但在高難度的代理型任務(如高階程式設計或多代理協作)上,準確度仍不及 2.5 Pro。

- 成本取捨:儘管具備最佳性價比,廣泛使用思考模式會增加整體權杖消耗,使深度推理的提示成本上升。