2025年11月19日至20日,OpenAI發布了兩項相關但不同的升級: GPT-5.1-Codex-Max一種新的 Codex 代理編碼模型,強調長時程編碼、詞符效率和“壓縮”,以支援多視窗會話; GPT-5.1 專業版一個經過更新的專業級 ChatGPT 模型,針對複雜、專業的工作進行了調整,能夠提供更清晰、更強大的答案。

GPT-5.1-Codex-Max是什麼?它試圖解決什麼問題?

GPT-5.1-Codex-Max 是 OpenAI 專門針對編碼工作流程而最佳化的 Codex 模型,需要滿足特定要求。 持續的、長遠的推理與執行普通模型在處理極長的上下文時可能會遇到困難——例如,多檔案重構、複雜的代理循環或持久的 CI/CD 任務——而 Codex-Max 的設計初衷就是為了解決這個問題。 自動壓縮和管理跨多個上下文視窗的會話狀態這使得它能夠作為一個涵蓋數千個(甚至更多)代幣的單一項目持續協同工作。 OpenAI 將 Codex-Max 定位為讓具備程式碼能力的智能體真正適用於擴展工程工作的下一步。

GPT-5.1-Codex-Max是什麼?它試圖解決什麼問題?

GPT-5.1-Codex-Max 是 OpenAI 專門針對編碼工作流程而最佳化的 Codex 模型,需要滿足特定要求。 持續的、長遠的推理與執行普通模型在處理極長的上下文時可能會遇到困難——例如,多檔案重構、複雜的代理循環或持久的 CI/CD 任務——而 Codex-Max 的設計初衷就是為了解決這個問題。 自動壓縮和管理跨多個上下文視窗的會話狀態使其能夠作為一個涵蓋數千(或更多)個代幣的單一項目繼續連貫地運作。

OpenAI 將其描述為“在開發週期的每個階段都更快、更聰明、更有效率”,並且明確地旨在取代 GPT-5.1-Codex 作為 Codex 表面中的預設模型。

功能快照

- 多視窗連續性壓縮: 精簡並保留關鍵上下文,以確保在數百萬個令牌和數小時內都能連貫運作。 0

- 與 GPT-5.1-Codex 相比,令牌效率有所提高: 在某些程式碼基準測試中,對於類似的推理工作量,思維代幣最多可減少約 30%。

- 長期代理持久性: 內部觀察發現,代理可以持續運行數小時/數天(OpenAI 記錄了超過 24 小時的內部運行)。

- 平台整合: 目前已在 Codex CLI、IDE 擴充、雲端和程式碼審查工具中提供;API 存取即將推出。

- Windows環境支援: OpenAI 特別指出,Codex 工作流程首次支援 Windows,擴大了實際開發者的覆蓋範圍。

它與同類產品(例如 GitHub Copilot、其他編碼人工智慧)相比如何?

與按需補全工具相比,GPT-5.1-Codex-Max 被定位為更自主、更長期的協作助理。雖然 Copilot 和類似的助手擅長在編輯器內進行短期補全,但 Codex-Max 的優勢在於協調多步驟任務、跨會話保持狀態一致性,以及處理需要規劃、測試和迭代的工作流程。也就是說,大多數團隊的最佳方案是混合使用:使用 Codex-Max 處理複雜的自動化任務和持續的代理任務,而使用更輕量級的助理進行行級補全。

GPT-5.1-Codex-Max 的工作原理是什麼?

什麼是「壓縮」?它如何實現長時間運作的工作?

一項核心技術進步是 壓實—一種內部機制,用於清理會話歷史記錄,同時保留關鍵的上下文訊息,以便模型能夠跨多個會話持續運行。 多種 上下文視窗。實際上,這意味著接近上下文限制的 Codex 會話將被壓縮(較舊或價值較低的詞元將被匯總/保留),以便智能體擁有一個全新的窗口,並可以持續迭代直至任務完成。 OpenAI 報告稱,在內部運作中,該模型曾連續工作超過 24 小時。

自適應推理和令牌效率

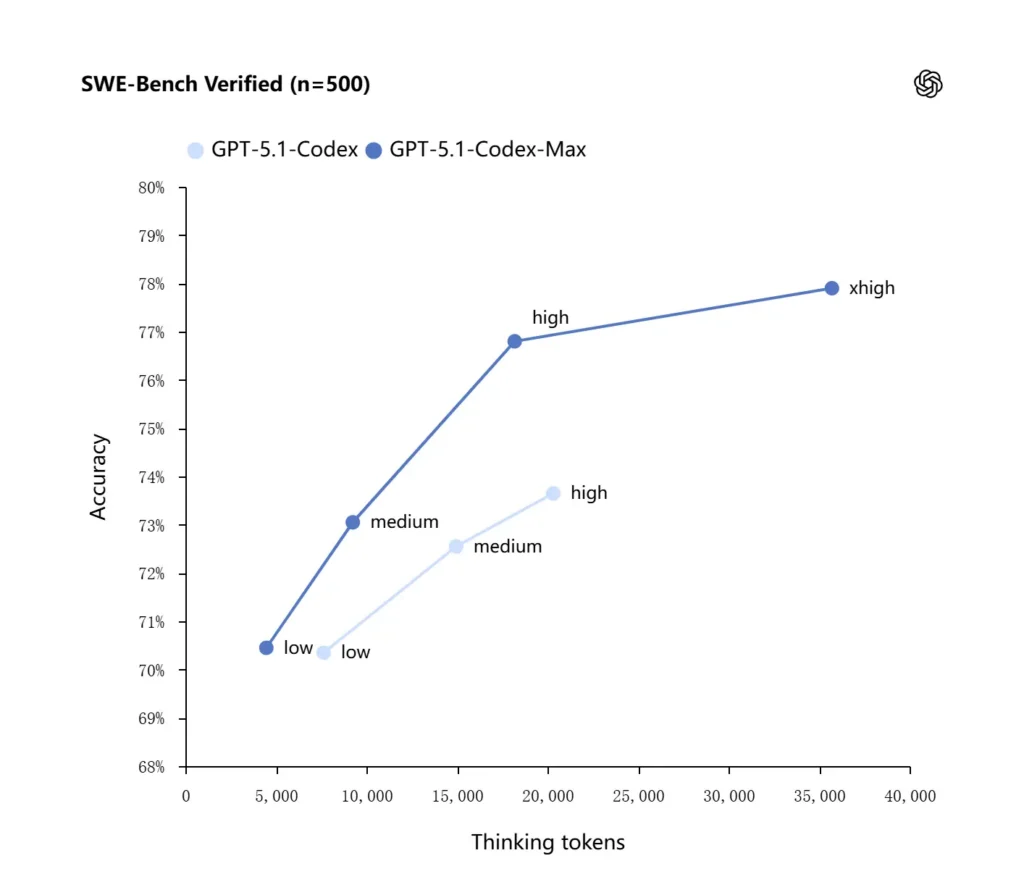

GPT-5.1-Codex-Max 應用了改進的推理策略,使其更有效率地利用詞元:在 OpenAI 公佈的內部基準測試中,Max 模型在顯著減少「思考」詞元數量的情況下,實現了與 GPT-5.1-Codex 相似或更優的性能——OpenAI 指出大約 減少 30% 在SWE-bench上驗證了該模型在推理工作量相同的情況下的思考能力。此外,該模型還引入了一種「超高(xhigh)」推理工作量模式,用於對延遲不敏感的任務,允許其投入更多內部推理以獲得更高品質的輸出。

系統整合和代理工具

Codex-Max 正在 Codex 工作流程(CLI、IDE 擴充功能、雲端平台和程式碼審查介面)中分發,以便與實際的開發者工具鏈進行互動。早期整合包括 Codex CLI 和 IDE 代理程式(VS Code、JetBrains 等),API 存取計劃隨後推出。其設計目標不僅是更聰明的程式碼合成,更是一個能夠運行多步驟工作流程的人工智慧:開啟檔案、執行測試、修復錯誤、重構並重新運行。

GPT-5.1-Codex-Max 在基準測試和實際工作中表現如何?

持續推理和長期任務

評估結果表明,學生在持續推理和長期任務方面均有顯著進步:

- OpenAI內部評估在內部實驗中,Codex-Max 可以連續工作“超過 24 小時”,並且將 Codex 與開發者工具整合後,內部工程生產力指標(例如使用率和拉取請求吞吐量)有所提升。這些是 OpenAI 的內部聲明,顯示實際應用中任務層面的生產力有所提升。

- 獨立評估(METR):METR的獨立報告衡量了 觀察到的50%時間範圍 (此統計量代表模型能夠持續完成長時間任務的中位數)對於 GPT-5.1-Codex-Max 而言約為 2小時40分鐘 (信賴區間較寬),相較於 GPT-5 在類似測量中的 2 小時 17 分鐘,Codex-Max 的持續一致性有了顯著提升。 METR 的方法和信賴區間強調了變異性,但結果支持了 Codex-Max 能夠提升實際長期表現的說法。

程式碼基準

OpenAI 報告稱,其在前沿編碼評估方面取得了顯著進步,尤其是在 SWE-bench Verified 測試中,GPT-5.1-Codex-Max 的表現優於 GPT-5.1-Codex,且詞元效率更高。該公司強調,在相同的「中等」推理難度下,Max 模型能夠以大約減少 30% 的推理詞元數量獲得更佳結果;對於允許更長內部推理時間的用戶,xhigh 模式可以進一步提升答案質量,但會增加延遲。

| GPT-5.1-Codex(高) | GPT-5.1-Codex-Max(xhigh) | |

| SWE-bench 驗證 (n=500) | 73.7% | 77.9% |

| SWE-Lancer IC SWE | 66.3% | 79.9% |

| 終端工作台 2.0 | 52.8% | 58.1% |

GPT-5.1-Codex-Max 與 GPT-5.1-Codex 相比有何不同?

性能和目的差異

- 範圍: GPT-5.1-Codex 是 GPT-5.1 系列的高性能編碼變體; Codex-Max 明確表示是具有代理能力的、具有長遠視野的後繼者,旨在成為 Codex 和類似 Codex 的環境的建議預設值。

- 代幣效率: Codex-Max 在 SWE-bench 和內部使用中均顯示出顯著的令牌效率提升(OpenAI 聲稱減少了約 30% 的思考令牌)。

- 情境管理: Codex-Max 引入了壓縮和原生多視窗處理功能,以支援超過單一上下文視窗的任務;Codex 本身並沒有以相同的規模提供這種功能。

- 工具準備: Codex-Max 以 CLI、IDE 和程式碼審查介面上的預設 Codex 模型發布,標誌著生產開發人員工作流程的遷移。

何時使用哪種模型?

- 使用 GPT-5.1-Codex 適用於互動式編碼輔助、快速編輯、小型重構以及低延遲使用場景,其中所有相關上下文都可以輕鬆地顯示在單一視窗中。

- 使用 GPT-5.1-Codex-Max 適用於多檔案重構、需要多次迭代周期的自動化代理任務、類似 CI/CD 的工作流程,或當您需要模型在多次互動中保持專案級視角時。

實用的提示模式,以及能達到最佳效果的範例?

行之有效的提示模式

- 明確目標和限制條件: “重構 X,保留公共 API,保留函數名稱,並確保測試 A、B、C 通過。”

- 提供最少的可複現上下文: 請提供失敗測試的連結、堆疊追蹤資訊以及相關的檔案片段,而不是轉儲整個程式碼庫。 Codex-Max 會根據需要壓縮歷史記錄。

- 對於複雜任務,請使用逐步說明: 將大型作業分解成一系列子任務,並讓 Codex-Max 遍歷這些子任務(例如,「1) 執行測試 2) 修復前 3 個失敗的測試 3) 執行程式碼檢查器 4) 總結變更」)。

- 要求解釋並說明差異: 請同時提供修補程式和簡要說明,以便人工審核人員能夠快速評估其安全性和意圖。

範例提示模板

重構任務

“重構

payment/用於提取支付處理的模組payment/processor.py保持現有呼叫者的公共函數簽名穩定。建立單元測試。process_payment()測試案例涵蓋成功、網路故障和無效卡片三種情況。運行測試套件,並以統一差異格式傳回失敗的測試案例和修補程式。

錯誤修復 + 測試

「一項測試

tests/test_user_auth.py::test_token_refresh出現故障並顯示回溯訊息。請調查根本原因,提出修改最小的修復方案,並添加單元測試以防止回歸。應用補丁並運行測試。

迭代式公關策略

「實作功能 X:新增端點

POST /api/export此介面用於串流傳輸匯出結果並已進行身份驗證。建立端點,新增文檔,建立測試,並提交一個包含摘要和手動操作清單的 PR。

對於其中大多數,首先… 中等 努力;切換到 xhigh 當您需要模型對多個文件和多個測試迭代進行深度推理時。

如何存取 GPT-5.1-Codex-Max

目前哪裡可以買到

OpenAI 已將 GPT-5.1-Codex-Max 整合到 Codex工具 目前:Codex CLI、IDE 擴充、雲端和程式碼審查流程預設使用 Codex-Max(您也可以選擇 Codex-Mini)。 API 的可用性正在準備中;GitHub Copilot 已發布包含 GPT-5.1 和 Codex 系列模型的公開預覽版。

開發者可以存取 GPT-5.1-Codex-Max 和 GPT-5.1-Codex API 透過 CometAPI。首先,探索模型功能。彗星API ,詳見 游乐场 並查閱 API 指南以取得詳細說明。造訪前,請確保您已登入 CometAPI 並取得 API 金鑰。 COMetAPI 提供遠低於官方價格的價格,幫助您整合。

準備出發了嗎? → 立即註冊 CometAPI !

如果您想了解更多有關 AI 的提示、指南和新聞,請關注我們 VK, X 不和!

快速入門(實用逐步指南)

- 請確保您擁有存取權限: 確認您的 ChatGPT/Codex 產品計劃(Plus、Pro、Business、Edu、Enterprise)或您的開發者 API 計劃是否支援 GPT-5.1/Codex 系列模型。

- 安裝 Codex CLI 或 IDE 擴充功能: 如果要在本機上執行程式碼任務,請安裝 Codex CLI 或適用於 VS Code / JetBrains / Xcode 的 Codex IDE 擴充功能(視情況而定)。在支援的配置中,工具預設使用 GPT-5.1-Codex-Max。

- 選擇推理努力程度: 從...開始 中等 對於大多數任務來說,這已經足夠了。對於深度調試、複雜重構,或者當你希望模型進行更深入的思考且不關心反應延遲時,請切換到 高 or xhigh 模式。用於快速小幅修復, 低 是合理的。

- 提供倉庫上下文: 為模型提供一個清晰的起點——一個程式碼倉庫 URL 或一組文件以及一條簡短的指令(例如,「重構支付模組以使用非同步 I/O 並添加單元測試,保留函數級契約」)。 Codex-Max 會在接近上下文限制時壓縮歷史記錄並繼續任務。

- 迭代測試: 模型產生補丁後,運行測試套件並將失敗結果回饋給正在進行的測試會話。壓縮和多視窗連續性功能使 Codex-Max 能夠保留重要的失敗測試上下文並進行迭代。

總結:

GPT-5.1-Codex-Max 代表著向智慧編碼助理邁出的重要一步,它能夠以更高的效率和推理能力支援複雜、長時間運行的工程任務。其技術進步(壓縮、推理模式、Windows 環境訓練)使其非常適合現代工程組織——前提是團隊將該模型與保守的操作控制、清晰的人機互動策略和強大的監控相結合。對於謹慎採用 Codex-Max 的團隊而言,它有望改變軟體的設計、測試和維護方式——將重複性的工程基礎工作轉化為人與模型之間更高價值的協作。